How Vulnerable Is My Learned Policy? Universal Adversarial Perturbation Attacks On Modern Behavior Cloning Policies

作者: Akansha Kalra, Basavasagar Patil, Guanhong Tao, Daniel S. Brown

分类: cs.LG, cs.CR, cs.RO

发布日期: 2025-02-06 (更新: 2025-10-14)

💡 一句话要点

揭示模仿学习策略的脆弱性:通用对抗扰动攻击行为克隆策略

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 模仿学习 对抗攻击 行为克隆 机器人安全 通用对抗扰动

📋 核心要点

- 模仿学习算法在机器人操作任务中表现出潜力,但其对离线通用对抗扰动的脆弱性尚未充分研究。

- 本文通过系统性地研究不同模仿学习算法在对抗扰动下的表现,揭示了现有方法的安全漏洞。

- 实验表明,包括行为克隆在内的多种模仿学习算法容易受到对抗攻击,且攻击具有跨算法、架构和任务的可迁移性。

📝 摘要(中文)

本文全面研究了模仿学习(LfD)算法在离线通用对抗扰动攻击下的脆弱性。针对包括行为克隆(BC)、LSTM-GMM、隐式行为克隆(IBC)、扩散策略(DP)和向量量化行为Transformer(VQ-BET)在内的经典和最新的算法,进行了对抗攻击研究。实验表明,这些方法在模拟机器人操作任务中普遍容易受到对抗扰动的影响。更令人担忧的是,这些攻击通常可以在不同的算法、架构和任务之间转移,暴露了黑盒攻击的安全漏洞。据我们所知,这是首次对不同LfD算法在白盒和黑盒攻击下的脆弱性进行系统性研究,研究结果突出了现代BC算法的局限性,为未来解决这些问题奠定了基础。

🔬 方法详解

问题定义:论文旨在研究模仿学习策略,特别是行为克隆(BC)及其变体,在面对对抗攻击时的脆弱性。现有模仿学习方法在安全性方面考虑不足,容易受到微小的、难以察觉的扰动影响,导致策略性能显著下降。这种脆弱性限制了模仿学习在安全关键型机器人应用中的部署。

核心思路:论文的核心思路是通过构造通用对抗扰动,即对输入状态空间进行微小但精心设计的修改,使得模仿学习策略产生错误的动作。这种扰动是通用的,意味着它可以应用于不同的状态,从而有效地攻击整个策略。通过分析不同算法对这种扰动的敏感程度,可以评估其鲁棒性。

技术框架:论文采用白盒和黑盒攻击两种方式评估模仿学习算法的脆弱性。在白盒攻击中,攻击者可以访问模型的参数和结构,从而可以计算梯度并优化扰动。在黑盒攻击中,攻击者只能观察模型的输入输出,需要通过迁移性等方法进行攻击。整体流程包括:1)选择模仿学习算法和机器人操作任务;2)训练模仿学习策略;3)生成通用对抗扰动;4)评估扰动对策略性能的影响;5)分析攻击的可迁移性。

关键创新:论文的关键创新在于系统性地研究了多种模仿学习算法在通用对抗扰动下的脆弱性,并揭示了攻击在不同算法、架构和任务之间的可迁移性。这是首次对模仿学习策略的安全性进行如此全面的评估,为未来的防御研究提供了重要的基准。

关键设计:论文中,对抗扰动的生成通常基于梯度下降或其变体,目标是最大化扰动对策略性能的负面影响。损失函数的设计取决于具体的攻击目标,例如,可以最小化策略的奖励或最大化与期望行为的偏差。关键参数包括扰动的幅度(epsilon),以及优化算法的学习率和迭代次数。对于不同的模仿学习算法,可能需要调整这些参数以获得最佳的攻击效果。

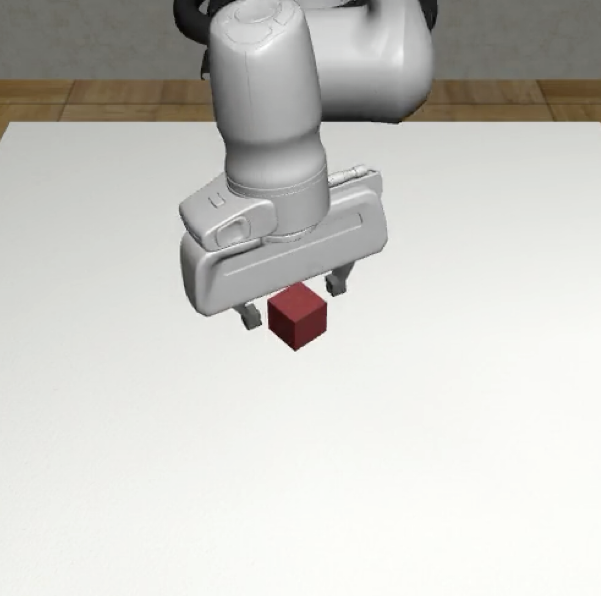

🖼️ 关键图片

📊 实验亮点

实验结果表明,包括行为克隆在内的多种模仿学习算法对通用对抗扰动非常敏感。即使是微小的扰动(例如,L2范数小于0.1),也能显著降低策略的性能,甚至导致任务失败。更重要的是,攻击具有很强的可迁移性,这意味着在一个算法上生成的扰动可以有效地攻击其他算法,甚至不同的任务。

🎯 应用场景

该研究成果对机器人安全领域具有重要意义,可应用于评估和提升模仿学习策略的鲁棒性。通过了解策略的脆弱点,可以开发更安全的模仿学习算法,从而提高机器人在复杂和不确定环境中的可靠性。此外,该研究也为开发针对对抗攻击的防御机制提供了指导。

📄 摘要(原文)

Learning from Demonstration (LfD) algorithms have shown promising results in robotic manipulation tasks, but their vulnerability to offline universal perturbation attacks remains underexplored. This paper presents a comprehensive study of adversarial attacks on both classic and recently proposed algorithms, including Behavior Cloning (BC), LSTM-GMM, Implicit Behavior Cloning (IBC), Diffusion Policy (DP), and Vector-Quantizied Behavior Transformer (VQ-BET). We study the vulnerability of these methods to universal adversarial perturbations. Our experiments on several simulated robotic manipulation tasks reveal that most of the current methods are highly vulnerable to adversarial perturbations. We also show that these attacks are often transferable across algorithms, architectures, and tasks, raising concerning security vulnerabilities to black-box attacks. To the best of our knowledge, we are the first to present a systematic study of the vulnerabilities of different LfD algorithms to both white-box and black-box attacks. Our findings highlight the vulnerabilities of modern BC algorithms, paving the way for future work in addressing such limitations.