Shaping Sparse Rewards in Reinforcement Learning: A Semi-supervised Approach

作者: Wenyun Li, Wenjie Huang, Chen Sun

分类: cs.LG, cs.AI

发布日期: 2025-01-31 (更新: 2025-08-05)

💡 一句话要点

提出半监督强化学习方法,解决稀疏奖励下的奖励塑造问题

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 奖励塑造 半监督学习 稀疏奖励 数据增强

📋 核心要点

- 现实世界中强化学习任务常常面临奖励稀疏的问题,导致智能体难以学习有效的奖励函数。

- 论文提出一种半监督学习方法,利用零奖励转移数据进行轨迹空间表示学习,辅助奖励塑造。

- 实验表明,该方法在Atari和机器人操作任务中优于监督学习方法,尤其在极度稀疏奖励环境中表现突出。

📝 摘要(中文)

在许多现实场景中,智能体的奖励信号极其稀疏,这使得学习有效的奖励函数进行奖励塑造变得极具挑战性。为了解决这个问题,本文提出了一种奖励塑造方法,该方法不仅利用非零奖励的转移,还采用半监督学习(SSL)技术,结合一种新颖的数据增强方法,从大多数转移(即零奖励转移)中学习轨迹空间表示,从而提高奖励塑造的有效性。在Atari和机器人操作中的实验结果表明,我们的方法优于基于监督的方法在奖励推断方面的表现,从而获得更高的智能体分数。值得注意的是,在更稀疏奖励的环境中,我们的方法实现了高达两倍于监督基线的峰值分数。所提出的双熵数据增强提高了性能,与其它增强方法相比,最佳分数提高了15.8%。

🔬 方法详解

问题定义:论文旨在解决强化学习中奖励稀疏问题,即智能体在与环境交互时,获得非零奖励的概率极低,导致难以学习有效的策略。现有方法通常依赖于人工设计的奖励函数或监督学习方法进行奖励塑造,但前者需要大量领域知识,后者则依赖于高质量的专家数据,而这些数据往往难以获取。

核心思路:论文的核心思路是利用大量的零奖励转移数据,通过半监督学习的方式学习轨迹空间的表示。这些表示能够捕捉环境的潜在结构,从而为奖励塑造提供更丰富的信息。通过结合非零奖励转移和学习到的轨迹空间表示,可以更有效地推断奖励函数,引导智能体探索更有价值的行为。

技术框架:整体框架包含三个主要模块:数据收集模块、半监督学习模块和奖励塑造模块。首先,智能体与环境交互,收集转移数据(包括状态、动作、奖励和下一个状态)。然后,半监督学习模块利用收集到的数据(包括零奖励和非零奖励转移)学习轨迹空间的表示。最后,奖励塑造模块利用学习到的表示和非零奖励转移,推断奖励函数,并将其用于指导智能体的策略学习。

关键创新:论文的关键创新在于将半监督学习引入奖励塑造,并提出了一种新颖的数据增强方法。传统的奖励塑造方法主要依赖于监督学习或人工设计的奖励函数,而该论文利用大量的零奖励转移数据,通过半监督学习的方式学习轨迹空间的表示,从而更有效地推断奖励函数。此外,提出的双熵数据增强方法进一步提高了半监督学习的性能。

关键设计:论文的关键设计包括:1) 使用自编码器学习轨迹空间的表示;2) 采用对比学习损失函数,鼓励相似轨迹在表示空间中更接近;3) 提出双熵数据增强方法,通过最大化增强后数据的熵,提高模型的泛化能力;4) 使用学习到的奖励函数进行奖励塑造,引导智能体的策略学习。具体的网络结构、损失函数和参数设置在论文中有详细描述。

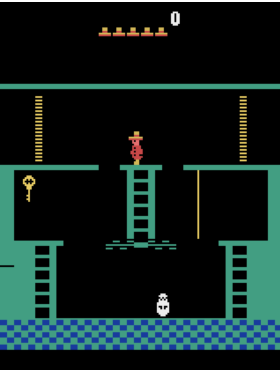

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在Atari和机器人操作任务中优于基于监督的方法。在更稀疏奖励的环境中,该方法实现了高达两倍于监督基线的峰值分数。此外,提出的双熵数据增强方法显著提高了性能,与其它增强方法相比,最佳分数提高了15.8%。这些结果表明,该方法能够有效地解决奖励稀疏问题,提高智能体的学习效率和性能。

🎯 应用场景

该研究成果可应用于机器人控制、游戏AI、自动驾驶等领域,尤其是在奖励信号难以设计或获取的场景下。通过利用大量的无标签数据,可以有效提高智能体的学习效率和性能。未来,该方法有望扩展到更复杂的任务和环境,例如多智能体协作、持续学习等。

📄 摘要(原文)

In many real-world scenarios, reward signal for agents are exceedingly sparse, making it challenging to learn an effective reward function for reward shaping. To address this issue, the proposed approach in this paper performs reward shaping not only by utilizing non-zero-reward transitions but also by employing the \emph{Semi-Supervised Learning} (SSL) technique combined with a novel data augmentation to learn trajectory space representations from the majority of transitions, {i.e}., zero-reward transitions, thereby improving the efficacy of reward shaping. Experimental results in Atari and robotic manipulation demonstrate that our method outperforms supervised-based approaches in reward inference, leading to higher agent scores. Notably, in more sparse-reward environments, our method achieves up to twice the peak scores compared to supervised baselines. The proposed double entropy data augmentation enhances performance, showcasing a 15.8\% increase in best score over other augmentation methods