Flow Matching: Markov Kernels, Stochastic Processes and Transport Plans

作者: Christian Wald, Gabriele Steidl

分类: cs.LG, math.PR

发布日期: 2025-01-28 (更新: 2025-12-03)

💡 一句话要点

Flow Matching:通过马尔可夫核、随机过程和传输计划学习生成模型的速度场

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: Flow Matching 生成模型 Wasserstein几何 传输计划 马尔可夫核 随机过程 贝叶斯逆问题 速度场学习

📋 核心要点

- 生成模型旨在学习复杂数据分布,Flow Matching通过学习连接潜在空间和数据空间的速度场来实现,但不同学习策略的数学联系尚需深入研究。

- 本文从数学角度统一了Flow Matching框架下学习速度场的多种方法,包括传输计划、马尔可夫核和随机过程,揭示了它们之间的内在联系。

- 本文还探讨了Flow Matching在贝叶斯逆问题中的应用,并简要讨论了连续归一化流和score matching等相关技术,为未来的研究方向提供了参考。

📝 摘要(中文)

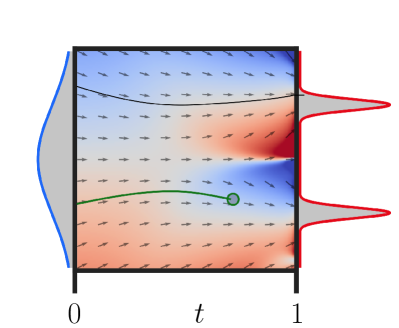

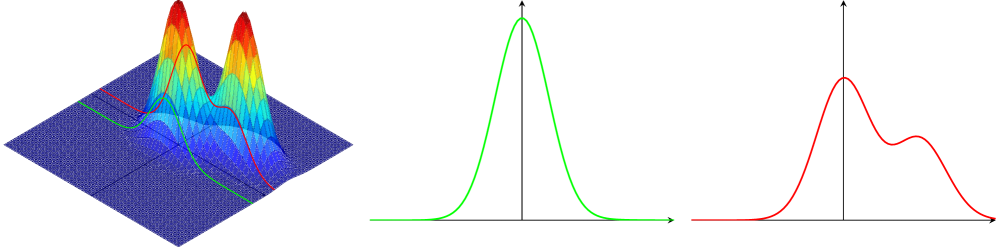

Flow Matching技术作为一种生成神经模型,因其简单的适用性和良好的扩展性而备受关注。该方法旨在学习连接简单潜在分布和目标分布的曲线的速度场。然后,可以使用相应的常微分方程,从潜在分布的样本出发,对目标分布进行采样。本文从数学角度回顾了学习Wasserstein几何中绝对连续曲线速度场的不同技术。我们展示了如何通过以下方式来表征和学习速度场:i) 潜在分布和目标分布之间的传输计划(耦合),ii) 马尔可夫核,以及 iii) 随机过程。后两者包含耦合方法,但在一般情况下范围更广。除了这个主要目标,我们还展示了Flow Matching如何用于解决贝叶斯逆问题,其中条件Wasserstein距离的定义起着核心作用。最后,我们简要地讨论了连续归一化流和score matching技术,它们从其他方向接近曲线速度场的学习。

🔬 方法详解

问题定义:Flow Matching旨在学习一个连续的变换,将一个简单的先验分布(如高斯分布)映射到复杂的目标数据分布。现有方法在如何有效地学习这个变换(即速度场)上存在差异,且缺乏统一的数学框架来理解这些方法之间的关系。

核心思路:本文的核心思路是将不同的Flow Matching方法置于Wasserstein几何的框架下进行分析,通过传输计划、马尔可夫核和随机过程等数学工具,统一描述和比较这些方法。这种统一视角有助于理解不同方法之间的联系和差异,并为设计新的Flow Matching算法提供理论指导。

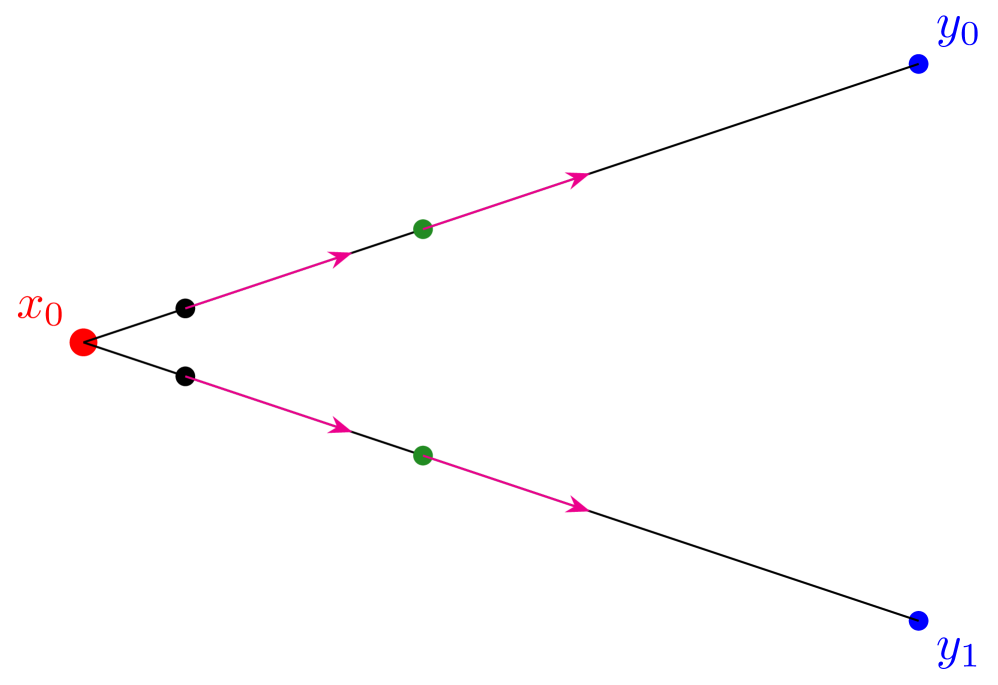

技术框架:本文主要从三个角度分析Flow Matching:1) 传输计划:通过寻找潜在分布和目标分布之间的最优传输计划(Wasserstein耦合)来定义速度场。2) 马尔可夫核:利用马尔可夫核来描述从潜在分布到目标分布的概率转移过程,从而学习速度场。3) 随机过程:将Flow Matching视为一个随机过程,通过学习随机微分方程的系数来确定速度场。这三种方法相互关联,后两者在某种程度上包含了耦合方法。

关键创新:本文的关键创新在于提供了一个统一的数学框架来理解和比较不同的Flow Matching方法。通过将这些方法与传输计划、马尔可夫核和随机过程联系起来,揭示了它们之间的内在联系和差异。此外,本文还探讨了Flow Matching在贝叶斯逆问题中的应用,扩展了其应用范围。

关键设计:本文主要关注理论分析,没有涉及具体的网络结构或损失函数设计。然而,文章强调了条件Wasserstein距离在贝叶斯逆问题中的重要性,这可能为未来的算法设计提供指导。此外,文章对连续归一化流和score matching等相关技术进行了简要讨论,为未来的研究方向提供了参考。

🖼️ 关键图片

📊 实验亮点

本文从数学角度统一了Flow Matching框架下学习速度场的多种方法,包括传输计划、马尔可夫核和随机过程,揭示了它们之间的内在联系。此外,本文还探讨了Flow Matching在贝叶斯逆问题中的应用,为该技术在实际问题中的应用提供了新的思路。具体的性能数据和对比基线未知,因为本文主要关注理论分析。

🎯 应用场景

Flow Matching技术在生成建模领域具有广泛的应用前景,例如图像生成、音频合成、分子设计等。通过学习数据分布的底层结构,Flow Matching可以生成高质量、多样化的样本。此外,该技术在贝叶斯逆问题中的应用也具有重要意义,例如医学图像重建、参数估计等。未来,Flow Matching有望在更多领域发挥作用,推动人工智能技术的发展。

📄 摘要(原文)

Among generative neural models, flow matching techniques stand out for their simple applicability and good scaling properties. Here, velocity fields of curves connecting a simple latent and a target distribution are learned. Then the corresponding ordinary differential equation can be used to sample from a target distribution, starting in samples from the latent one. This paper reviews from a mathematical point of view different techniques to learn the velocity fields of absolutely continuous curves in the Wasserstein geometry. We show how the velocity fields can be characterized and learned via i) transport plans (couplings) between latent and target distributions, ii) Markov kernels and iii) stochastic processes, where the latter two include the coupling approach, but are in general broader. Besides this main goal, we show how flow matching can be used for solving Bayesian inverse problems, where the definition of conditional Wasserstein distances plays a central role. Finally, we briefly address continuous normalizing flows and score matching techniques, which approach the learning of velocity fields of curves from other directions.