Language-Based Bayesian Optimization Research Assistant (BORA)

作者: Abdoulatif Cissé, Xenophon Evangelopoulos, Vladimir V. Gusev, Andrew I. Cooper

分类: cs.LG, cs.AI

发布日期: 2025-01-27 (更新: 2025-08-14)

期刊: IJCAI-25: Proceedings of the Thirty-Fourth International Joint Conference on Artificial Intelligence, pp. 4967-4975 (2025)

💡 一句话要点

提出基于语言模型的贝叶斯优化助手BORA,融合领域知识提升复杂实验优化效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 贝叶斯优化 大型语言模型 领域知识 混合优化 实验优化

📋 核心要点

- 复杂科学问题优化面临高维、非凸搜索空间挑战,易陷入局部最优,传统方法难以有效利用领域知识。

- BORA利用大型语言模型(LLM)融合领域知识,指导贝叶斯优化探索更有前景的搜索区域,提升优化效率。

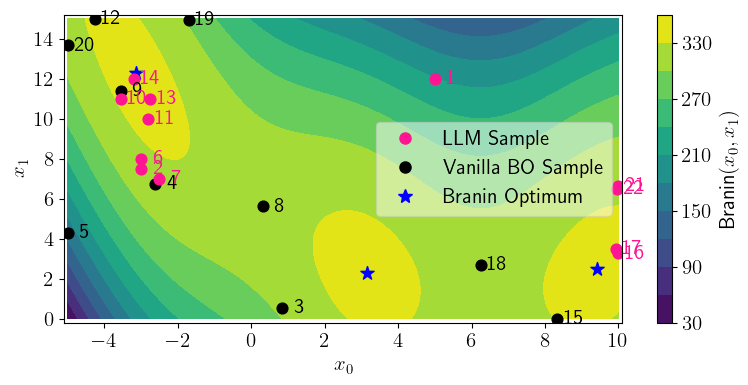

- 实验表明,BORA在合成基准和真实实验任务中均表现出色,上下文感知的建议显著提升了优化性能。

📝 摘要(中文)

许多重要的科学问题涉及多变量优化,并伴随缓慢且费力的实验测量。这些复杂的高维搜索可能由非凸优化景观定义,类似于“大海捞针”的表面,容易陷入局部最小值。利用人类领域知识来指导搜索到局部有效区域是一种有效的方法。然而,这种方法容易受到人类确认偏差的影响,并且领域专家难以跟踪快速扩展的科学文献。本文提出了一种使用大型语言模型(LLM)来情境化贝叶斯优化(BO)的混合优化框架,该框架智能且经济地将随机推理与来自LLM的基于领域知识的见解相结合,用于建议新的、性能更好的搜索空间区域进行探索。我们的方法通过提供关于优化进度的实时评论,解释搜索策略背后的推理,从而促进用户参与。我们在具有多达15个独立变量的合成基准上验证了我们方法的有效性,并展示了LLM在四个真实实验任务中进行推理的能力,在这些任务中,上下文感知的建议大大提高了优化性能。

🔬 方法详解

问题定义:论文旨在解决复杂科学实验中多变量优化问题,尤其是在高维、非凸搜索空间下,传统贝叶斯优化方法难以有效利用领域知识,容易陷入局部最优的问题。现有方法要么依赖人工经验,易受主观偏差影响,要么难以跟上快速增长的科学文献。

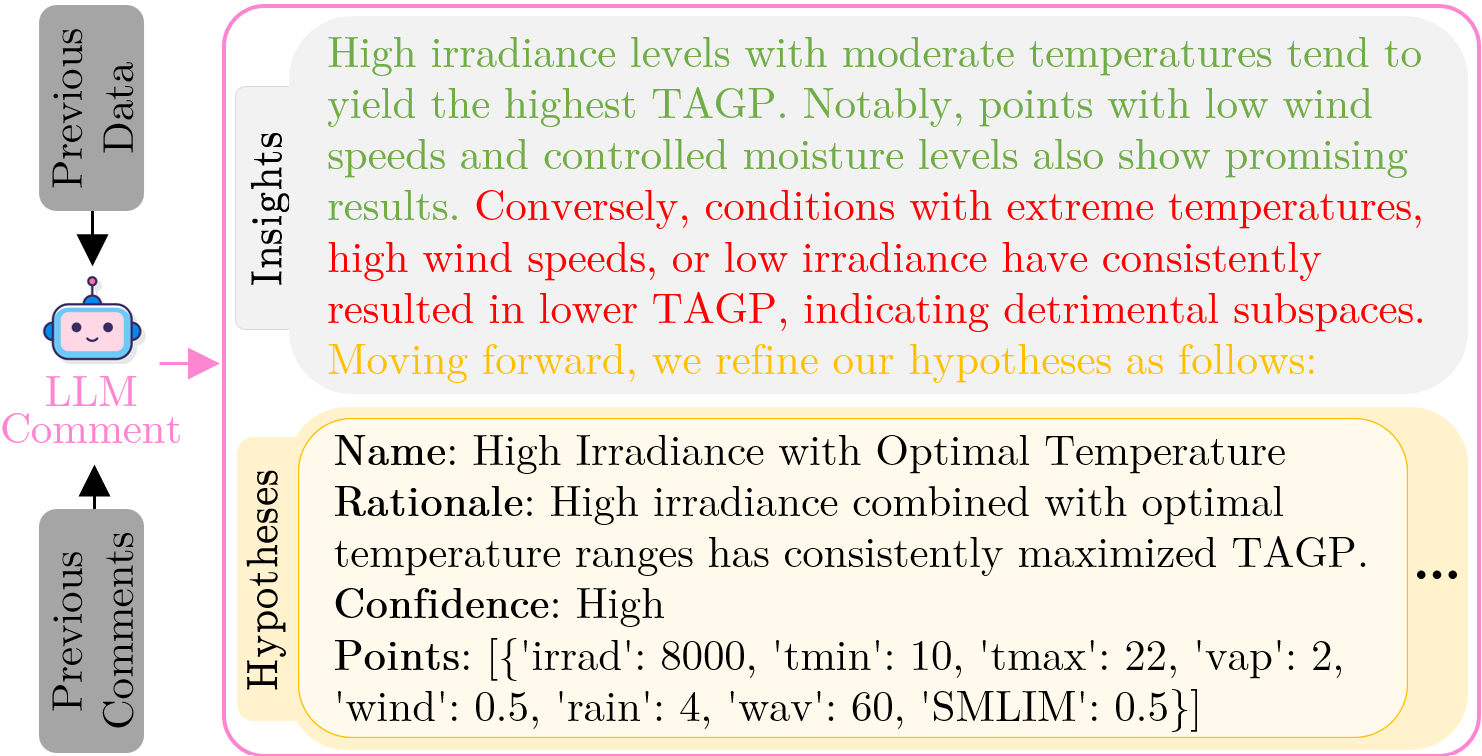

核心思路:论文的核心思路是将大型语言模型(LLM)融入贝叶斯优化框架,利用LLM的知识推理能力,为贝叶斯优化提供上下文感知的建议,引导搜索方向,从而更有效地探索搜索空间,避免陷入局部最优。

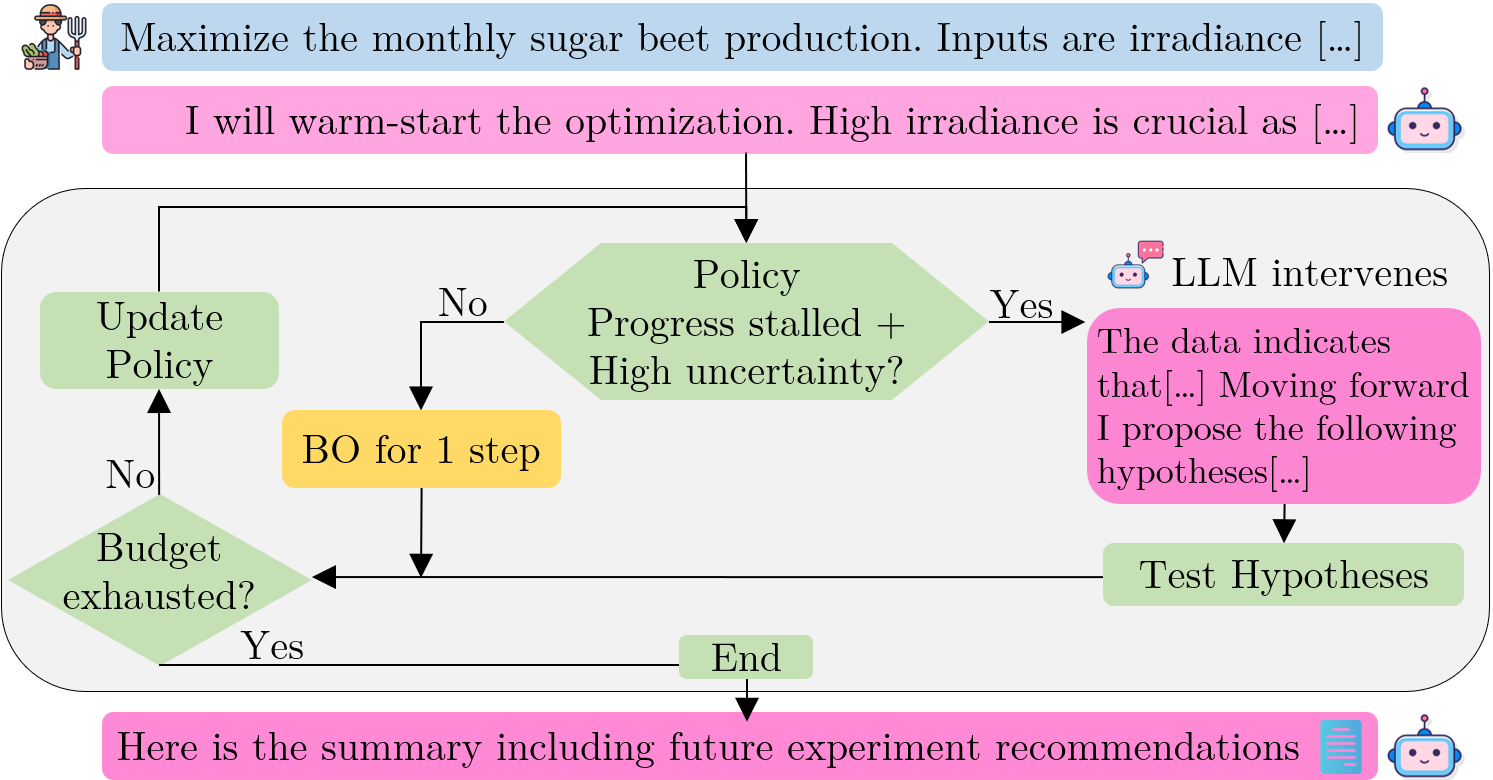

技术框架:BORA框架包含以下主要模块:1) 贝叶斯优化模块:负责传统的贝叶斯优化过程,包括构建代理模型和选择下一个采样点。2) LLM模块:接收当前优化状态和实验背景信息,生成针对性的建议,例如建议探索的参数范围或实验条件。3) 融合模块:将LLM的建议与贝叶斯优化的结果相结合,共同决定下一个采样点。4) 用户交互模块:向用户提供优化进度和LLM的推理过程,促进用户参与。

关键创新:最重要的创新点在于将LLM的知识推理能力与贝叶斯优化的探索能力相结合,形成一个混合优化框架。与传统贝叶斯优化相比,BORA能够利用LLM提供的上下文信息,更智能地探索搜索空间。与纯粹依赖人工经验的方法相比,BORA能够减少主观偏差,并利用LLM的知识库。

关键设计:LLM的选择和提示工程是关键设计。论文可能使用了特定领域的LLM,并设计了合适的提示,引导LLM生成有用的建议。此外,融合模块的设计也很重要,需要平衡贝叶斯优化和LLM建议的权重,避免LLM过度干预优化过程。具体的参数设置、损失函数和网络结构等技术细节在论文中可能有所描述,但摘要中未提及。

🖼️ 关键图片

📊 实验亮点

论文在合成基准和四个真实实验任务中验证了BORA的有效性。结果表明,BORA能够利用LLM的上下文感知建议,显著提升优化性能。具体的性能数据和提升幅度需要在论文中查找,摘要中未提供详细数据。

🎯 应用场景

BORA可应用于材料科学、化学、生物工程等领域,加速新材料发现、药物研发、工艺优化等过程。通过融合领域知识和自动化优化,BORA有望显著缩短实验周期,降低研发成本,并推动科学发现。

📄 摘要(原文)

Many important scientific problems involve multivariate optimization coupled with slow and laborious experimental measurements. These complex, high-dimensional searches can be defined by non-convex optimization landscapes that resemble needle-in-a-haystack surfaces, leading to entrapment in local minima. Contextualizing optimizers with human domain knowledge is a powerful approach to guide searches to localized fruitful regions. However, this approach is susceptible to human confirmation bias and it is also challenging for domain experts to keep track of the rapidly expanding scientific literature. Here, we propose the use of Large Language Models (LLMs) for contextualizing Bayesian optimization (BO) via a hybrid optimization framework that intelligently and economically blends stochastic inference with domain knowledge-based insights from the LLM, which is used to suggest new, better-performing areas of the search space for exploration. Our method fosters user engagement by offering real-time commentary on the optimization progress, explaining the reasoning behind the search strategies. We validate the effectiveness of our approach on synthetic benchmarks with up to 15 independent variables and demonstrate the ability of LLMs to reason in four real-world experimental tasks where context-aware suggestions boost optimization performance substantially.