SWIFT: Mapping Sub-series with Wavelet Decomposition Improves Time Series Forecasting

作者: Wenxuan Xie, Fanpu Cao

分类: cs.LG, stat.ML

发布日期: 2025-01-27 (更新: 2025-05-30)

🔗 代码/项目: GITHUB

💡 一句话要点

提出SWIFT模型,利用小波分解提升轻量级时间序列预测在边缘计算中的性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间序列预测 小波变换 边缘计算 轻量级模型 非平稳序列 跨频带融合 深度学习

📋 核心要点

- 现有时间序列预测模型,如Transformer,计算开销大,难以在边缘设备上部署。

- SWIFT模型利用小波变换进行无损下采样,并通过可学习滤波器融合跨频带信息。

- 实验表明,SWIFT在多个数据集上达到SOTA性能,且参数量远小于传统线性模型。

📝 摘要(中文)

本文提出了一种名为SWIFT的轻量级模型,用于解决资源受限环境(如边缘设备)中长时间序列预测(LTSF)的问题。现有方法,特别是基于Transformer的大型语言模型,虽然在序列建模方面表现出色,但计算开销过大,不适用于边缘设备。而轻量级模型在非平稳序列上的表现不佳。SWIFT模型基于三个关键点:(i) 利用小波变换对时间序列进行无损下采样;(ii) 通过可学习滤波器实现跨频带信息融合;(iii) 仅使用一个共享线性层或浅层MLP进行子序列映射。实验结果表明,SWIFT在多个数据集上实现了最先进的(SOTA)性能,为边缘计算中的时间序列预测提供了一种有前景的方法。值得注意的是,SWIFT-Linear的参数量仅为时域预测单层线性模型的25%。

🔬 方法详解

问题定义:论文旨在解决长时间序列预测(LTSF)在资源受限的边缘计算环境中的部署问题。现有方法,特别是基于Transformer的大型模型,虽然精度高,但计算复杂度高,难以在边缘设备上运行。而一些轻量级模型在处理非平稳时间序列时性能较差,无法满足实际需求。

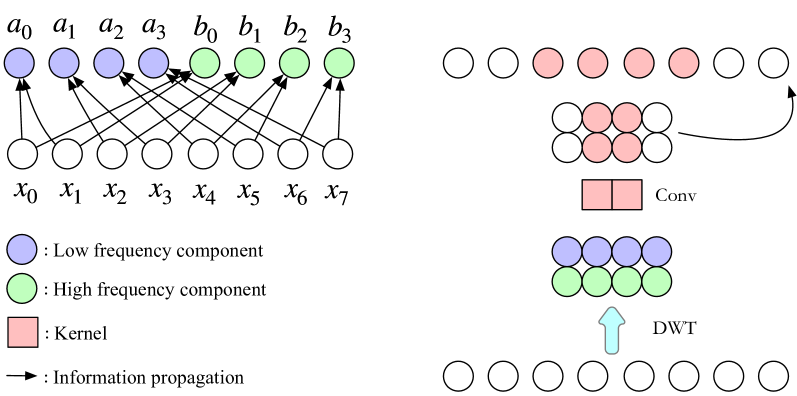

核心思路:论文的核心思路是利用小波变换将时间序列分解为不同频率的子序列,从而降低计算复杂度,并提取不同频率的信息。通过可学习的滤波器进行跨频带信息融合,增强模型的表达能力。最后,使用共享的线性层或浅层MLP进行子序列映射,进一步减少参数量。

技术框架:SWIFT模型主要包含三个阶段:1) 小波分解:使用小波变换将原始时间序列分解为多个子序列,每个子序列代表不同的频率分量。2) 跨频带信息融合:通过可学习的滤波器对不同频率的子序列进行融合,提取更丰富的信息。3) 子序列映射:使用共享的线性层或浅层MLP将每个子序列映射到预测值。整个框架旨在降低计算复杂度,同时保持较高的预测精度。

关键创新:SWIFT的关键创新在于将小波变换引入到轻量级时间序列预测模型中,实现了无损下采样和跨频带信息融合。与传统的时域预测模型相比,SWIFT能够更好地处理非平稳时间序列,并且具有更低的计算复杂度。此外,使用共享的线性层或浅层MLP进行子序列映射,进一步减少了参数量。

关键设计:SWIFT的关键设计包括:1) 小波变换的选择:论文中使用了具体的小波基函数(具体类型未知),需要根据实际数据进行选择。2) 可学习滤波器的设计:滤波器的结构和参数需要根据实际数据进行调整,以实现最佳的跨频带信息融合效果。3) 共享线性层或浅层MLP的设计:线性层的维度和MLP的层数需要根据实际数据进行调整,以平衡模型的表达能力和计算复杂度。损失函数未知,可能采用均方误差等常用回归损失函数。

🖼️ 关键图片

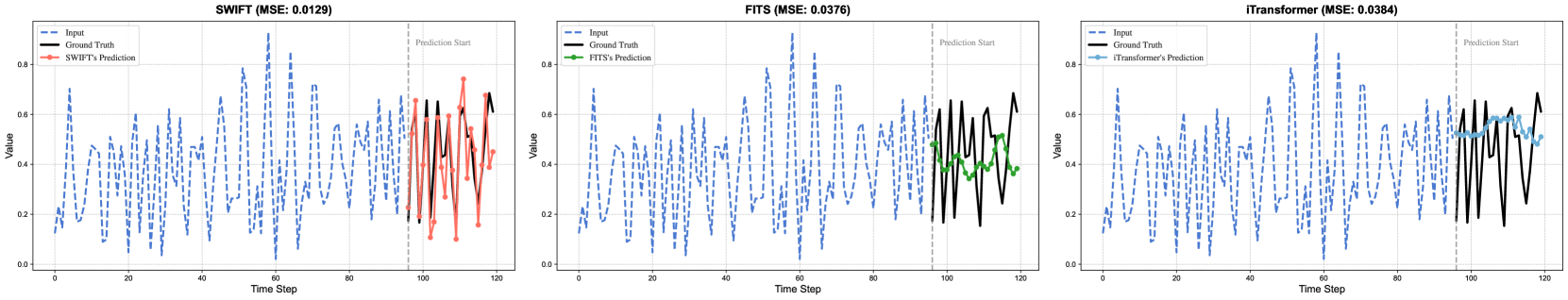

📊 实验亮点

SWIFT模型在多个数据集上实现了最先进的(SOTA)性能,证明了其有效性。更重要的是,SWIFT-Linear的参数量仅为时域预测单层线性模型的25%,显著降低了计算复杂度,使其更适合在边缘设备上部署。具体的性能提升数据需要在论文中查找,但摘要表明其性能优于现有轻量级模型。

🎯 应用场景

SWIFT模型适用于各种需要在资源受限的边缘设备上进行长时间序列预测的场景,例如智能家居、工业物联网、环境监测、金融风控等。该模型可以帮助这些应用在本地进行实时预测,降低对云端计算的依赖,提高响应速度和数据安全性。未来,SWIFT模型可以进一步扩展到其他类型的序列数据,例如语音、图像等。

📄 摘要(原文)

In recent work on time-series prediction, Transformers and even large language models have garnered significant attention due to their strong capabilities in sequence modeling. However, in practical deployments, time-series prediction often requires operation in resource-constrained environments, such as edge devices, which are unable to handle the computational overhead of large models. To address such scenarios, some lightweight models have been proposed, but they exhibit poor performance on non-stationary sequences. In this paper, we propose $\textit{SWIFT}$, a lightweight model that is not only powerful, but also efficient in deployment and inference for Long-term Time Series Forecasting (LTSF). Our model is based on three key points: (i) Utilizing wavelet transform to perform lossless downsampling of time series. (ii) Achieving cross-band information fusion with a learnable filter. (iii) Using only one shared linear layer or one shallow MLP for sub-series' mapping. We conduct comprehensive experiments, and the results show that $\textit{SWIFT}$ achieves state-of-the-art (SOTA) performance on multiple datasets, offering a promising method for edge computing and deployment in this task. Moreover, it is noteworthy that the number of parameters in $\textit{SWIFT-Linear}$ is only 25\% of what it would be with a single-layer linear model for time-domain prediction. Our code is available at https://github.com/LancelotXWX/SWIFT.