LLM-attacker: Enhancing Closed-loop Adversarial Scenario Generation for Autonomous Driving with Large Language Models

作者: Yuewen Mei, Tong Nie, Jian Sun, Ye Tian

分类: cs.LG, cs.CV, cs.RO

发布日期: 2025-01-27 (更新: 2025-06-07)

备注: Accepted as a regular paper at IEEE TITS 2025

期刊: IEEE Transactions on Intelligent Transportation Systems 2025

DOI: 10.1109/TITS.2025.3578383

💡 一句话要点

LLM-attacker:利用大语言模型增强自动驾驶闭环对抗场景生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 自动驾驶 对抗场景生成 大语言模型 闭环优化 智能代理

📋 核心要点

- 现有对抗场景生成方法难以有效识别复杂交通场景中的最佳攻击者,影响了生成对抗场景的质量。

- LLM-attacker利用多个LLM代理协同工作,识别最佳攻击者并优化其轨迹,从而生成更具挑战性的对抗场景。

- 实验表明,使用LLM-attacker生成的对抗场景训练的ADS,其碰撞率显著降低,验证了该方法的有效性。

📝 摘要(中文)

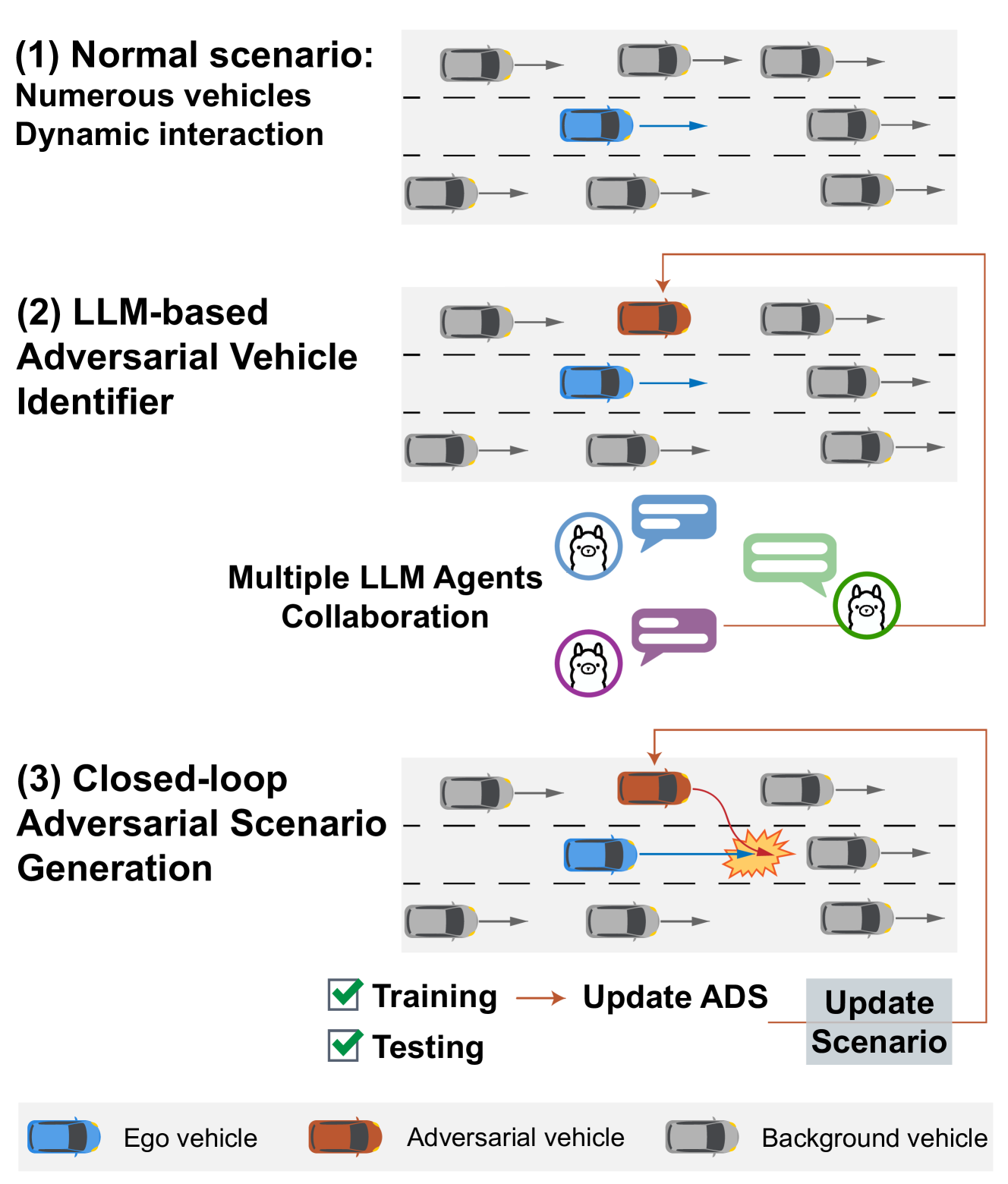

确保和提高自动驾驶系统(ADS)的安全性对于高度自动化车辆的部署至关重要,尤其是在安全关键事件中。为了解决罕见事件问题,开发了对抗场景生成方法,通过操纵交通参与者的行为来诱导安全关键事件。然而,现有方法仍然面临两个限制。首先,对抗参与者的识别直接影响生成的有效性。然而,现实世界场景的复杂性,包括众多参与者和多样化的行为,使得识别具有挑战性。其次,生成的安全关键场景持续改进ADS性能的潜力尚未得到充分探索。为了解决这些问题,我们提出了LLM-attacker:一个利用大型语言模型(LLM)的闭环对抗场景生成框架。具体而言,设计和协调多个LLM代理来识别最佳攻击者。然后,优化攻击者的轨迹以生成对抗场景。这些场景基于ADS的性能进行迭代改进,形成一个反馈循环以改进ADS。实验结果表明,LLM-attacker可以创建比其他方法更危险的场景,并且使用它训练的ADS的碰撞率是使用正常场景训练的一半。这表明LLM-attacker具有测试和增强ADS安全性和鲁棒性的能力。

🔬 方法详解

问题定义:现有自动驾驶对抗场景生成方法在复杂场景中难以准确识别最具威胁的交通参与者(即“攻击者”),导致生成的对抗场景不够有效,无法充分测试和提升自动驾驶系统的安全性。现有方法难以应对真实世界场景中参与者数量众多、行为多样化的挑战。

核心思路:利用大型语言模型(LLM)的强大推理和决策能力,构建多个智能代理,模拟不同交通参与者的行为,并通过协同工作,自动识别并选择对自动驾驶系统构成最大威胁的“攻击者”。通过优化选定攻击者的行为轨迹,生成更具挑战性和安全风险的对抗场景。

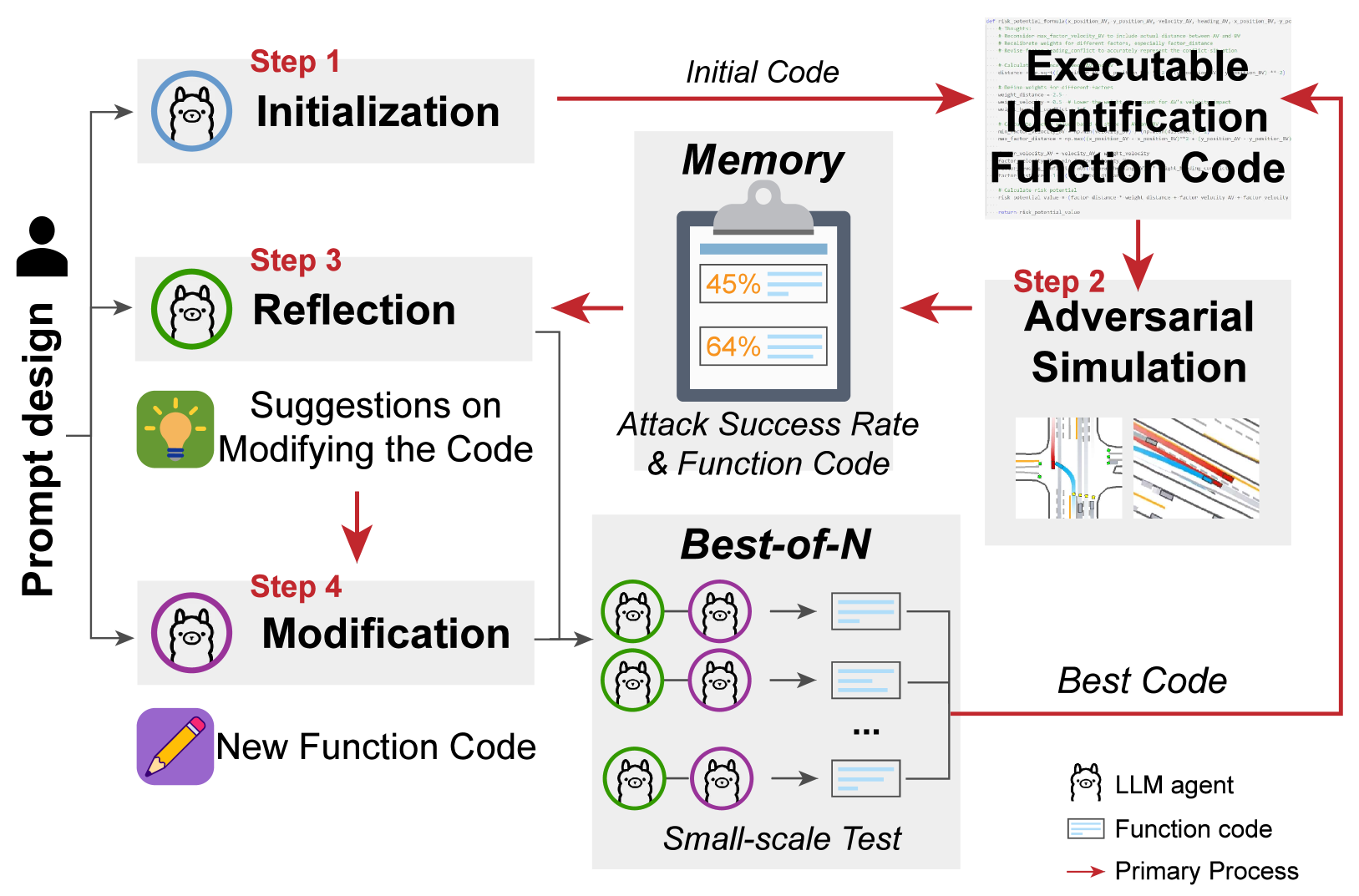

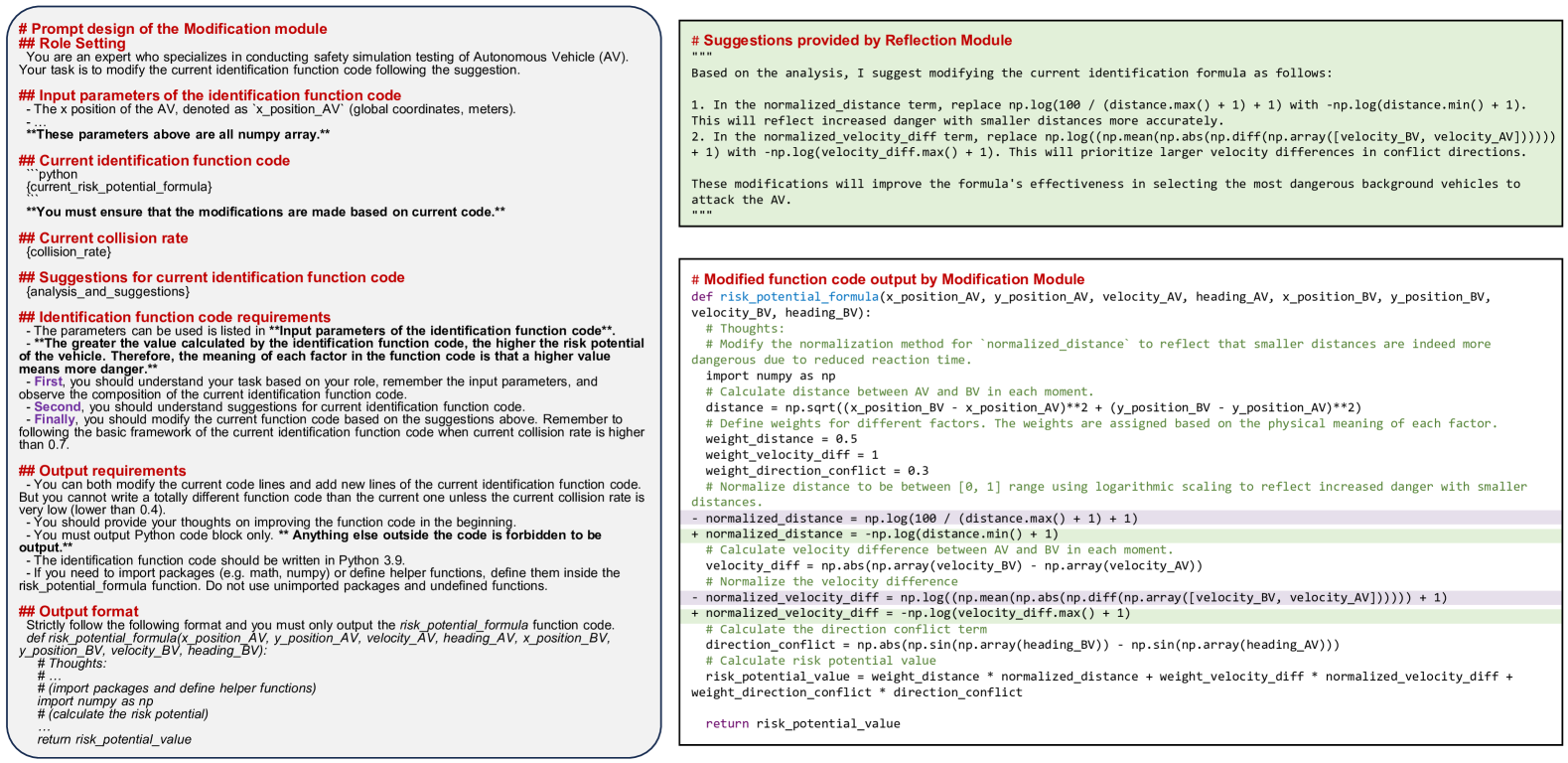

技术框架:LLM-attacker框架包含以下主要模块:1) LLM代理池:包含多个LLM代理,每个代理负责模拟一个或多个交通参与者的行为。2) 攻击者识别模块:通过LLM代理之间的交互和评估,识别出对自动驾驶系统威胁最大的“攻击者”。3) 轨迹优化模块:针对选定的攻击者,优化其行为轨迹,生成对抗场景。4) 闭环反馈:根据自动驾驶系统在对抗场景中的表现,对LLM代理和轨迹优化策略进行迭代改进,形成闭环优化。

关键创新:核心创新在于将大型语言模型引入到自动驾驶对抗场景生成中,利用LLM的自然语言理解和生成能力,以及强大的推理能力,实现了对复杂交通场景中潜在威胁的自动识别和对抗场景的智能生成。与传统方法相比,LLM-attacker无需人工干预,能够更有效地发现和利用自动驾驶系统的弱点。

关键设计:LLM代理的设计需要考虑其行为的合理性和多样性,可以通过prompt工程来控制LLM的行为模式。轨迹优化模块可以使用强化学习或优化算法,目标是最大化自动驾驶系统发生碰撞或偏离安全区域的概率。闭环反馈机制需要设计合适的奖励函数,以引导LLM代理和轨迹优化策略向更有效的方向发展。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLM-attacker生成的对抗场景比其他方法更具挑战性,能够更有效地诱导自动驾驶系统发生碰撞。使用LLM-attacker生成的对抗场景训练的自动驾驶系统,其碰撞率比使用正常场景训练的系统降低了一半。这表明LLM-attacker能够显著提高自动驾驶系统的安全性和鲁棒性。

🎯 应用场景

LLM-attacker可应用于自动驾驶系统的测试和验证,帮助开发者发现和修复系统中的安全漏洞,提高自动驾驶系统的鲁棒性和安全性。此外,该方法还可以用于自动驾驶仿真平台的场景生成,为自动驾驶算法的训练和评估提供更具挑战性的测试环境。该研究有助于推动自动驾驶技术的安全可靠发展。

📄 摘要(原文)

Ensuring and improving the safety of autonomous driving systems (ADS) is crucial for the deployment of highly automated vehicles, especially in safety-critical events. To address the rarity issue, adversarial scenario generation methods are developed, in which behaviors of traffic participants are manipulated to induce safety-critical events. However, existing methods still face two limitations. First, identification of the adversarial participant directly impacts the effectiveness of the generation. However, the complexity of real-world scenarios, with numerous participants and diverse behaviors, makes identification challenging. Second, the potential of generated safety-critical scenarios to continuously improve ADS performance remains underexplored. To address these issues, we propose LLM-attacker: a closed-loop adversarial scenario generation framework leveraging large language models (LLMs). Specifically, multiple LLM agents are designed and coordinated to identify optimal attackers. Then, the trajectories of the attackers are optimized to generate adversarial scenarios. These scenarios are iteratively refined based on the performance of ADS, forming a feedback loop to improve ADS. Experimental results show that LLM-attacker can create more dangerous scenarios than other methods, and the ADS trained with it achieves a collision rate half that of training with normal scenarios. This indicates the ability of LLM-attacker to test and enhance the safety and robustness of ADS. Video demonstrations are provided at: https://drive.google.com/file/d/1Zv4V3iG7825oyiKbUwS2Y-rR0DQIE1ZA/view.