LemmaHead: RAG Assisted Proof Generation Using Large Language Models

作者: Tianbo Yang, Mingqi Yan, Hongyi Zhao, Tianshuo Yang

分类: cs.LG, cs.CL, cs.IR

发布日期: 2025-01-27 (更新: 2025-02-10)

💡 一句话要点

LemmaHead:利用RAG辅助大型语言模型生成数学证明

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 检索增强生成 数学证明 自动定理证明 知识库 Lean形式语言

📋 核心要点

- 大型语言模型在数学推理和证明生成方面存在不足,难以达到人类水平。

- LemmaHead利用RAG框架,通过检索相关数学知识来增强LLM的推理能力。

- 该模型在自动定理证明任务上进行了评估,目标是生成Lean形式语言的证明。

📝 摘要(中文)

开发解决数学问题或撰写数学证明所需的逻辑是大型语言模型(LLM)面临的最困难的目标之一。目前,文献中最流行的方法包括在学术出版物和教科书等书面数学内容上微调模型,以便模型可以学习模仿数学写作的风格。在这个项目中,我们探索了使用检索增强生成(RAG)来解决LLM在数学推理方面的差距的有效性。我们开发了LemmaHead,一个RAG知识库,它使用相关的数学上下文(特别关注已出版的教科书中的上下文)来补充对模型的查询。为了衡量我们的模型在数学推理方面的性能,我们的测试范例侧重于通过在Lean形式语言中生成给定数学命题的证明来实现自动定理证明的任务。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在数学推理和自动定理证明方面的不足。现有方法主要依赖于在数学文本上进行微调,但这种方法难以覆盖所有必要的知识,并且泛化能力有限。因此,LLM在面对复杂的数学问题时,常常无法生成正确的证明。

核心思路:论文的核心思路是利用检索增强生成(RAG)框架,将LLM与外部知识库连接起来。当LLM需要进行数学推理时,首先从知识库中检索相关的数学定义、定理和引理,然后将这些信息作为上下文提供给LLM,从而增强其推理能力。这种方法可以有效地弥补LLM自身知识的不足,提高其生成正确证明的概率。

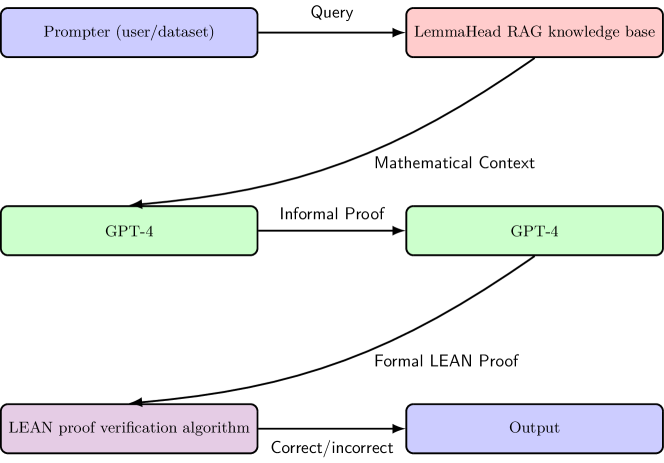

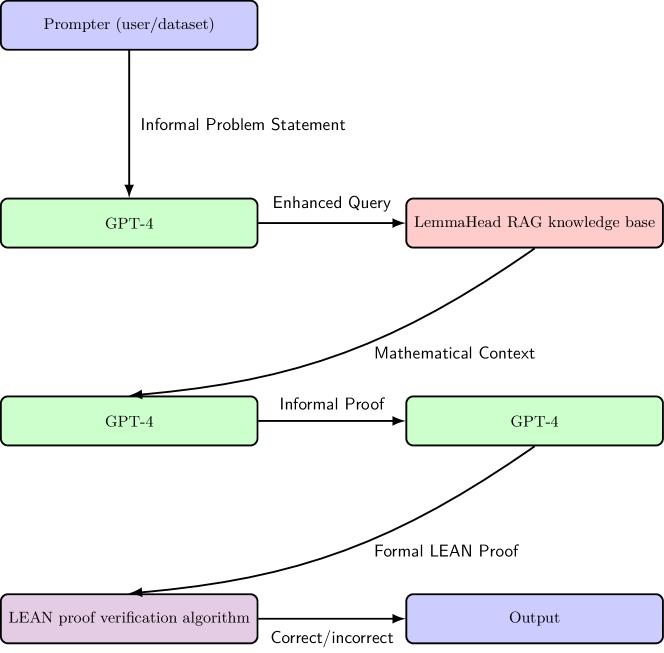

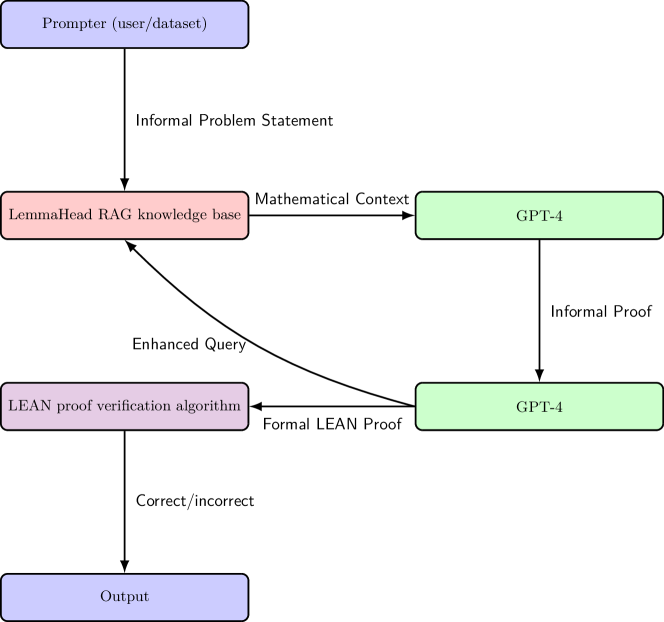

技术框架:LemmaHead的技术框架主要包括以下几个模块:1) 查询编码器:将输入的数学命题编码成向量表示。2) 知识库:存储大量的数学定义、定理和引理,并建立索引以便快速检索。3) 检索模块:根据查询向量,从知识库中检索最相关的数学知识。4) LLM:接收查询和检索到的知识,生成数学证明。整个流程是:用户输入待证明的数学命题,查询编码器将其编码,检索模块从知识库中检索相关知识,LLM结合检索到的知识生成证明。

关键创新:LemmaHead的关键创新在于将RAG框架应用于数学证明生成任务。与传统的微调方法相比,RAG框架可以动态地为LLM提供相关的数学知识,从而提高其推理能力和泛化能力。此外,LemmaHead还特别关注从已出版的教科书中提取数学知识,并将其构建成知识库,这保证了知识的质量和可靠性。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但可以推测,查询编码器可能采用预训练的语言模型(如BERT或RoBERTa),并使用对比学习或相似度学习等方法进行训练,以提高检索的准确性。知识库的构建可能涉及到自然语言处理技术,如实体识别和关系抽取。LLM可以选择现有的开源模型(如GPT-3或LLaMA),并根据具体任务进行微调。

🖼️ 关键图片

📊 实验亮点

论文主要提出了LemmaHead框架,并验证了RAG在数学证明生成中的有效性。虽然摘要中没有给出具体的性能数据和对比基线,但可以推测,LemmaHead在自动定理证明任务上的性能优于传统的微调方法。未来的研究可以进一步探索不同的知识库构建方法、检索算法和LLM架构,以提高LemmaHead的性能。

🎯 应用场景

该研究成果可应用于自动定理证明、数学问题求解、数学教育等领域。通过结合LLM和RAG技术,可以开发出更加智能化的数学工具,辅助数学研究人员和学生进行学习和研究。未来,该技术还有望应用于其他需要逻辑推理和知识检索的领域,如法律、医学等。

📄 摘要(原文)

Developing the logic necessary to solve mathematical problems or write mathematical proofs is one of the more difficult objectives for large language models (LLMS). Currently, the most popular methods in literature consists of fine-tuning the model on written mathematical content such as academic publications and textbooks, so that the model can learn to emulate the style of mathematical writing. In this project, we explore the effectiveness of using retrieval augmented generation (RAG) to address gaps in the mathematical reasoning of LLMs. We develop LemmaHead, a RAG knowledge base that supplements queries to the model with relevant mathematical context, with particular focus on context from published textbooks. To measure our model's performance in mathematical reasoning, our testing paradigm focuses on the task of automated theorem proving via generating proofs to a given mathematical claim in the Lean formal language.