Mirage in the Eyes: Hallucination Attack on Multi-modal Large Language Models with Only Attention Sink

作者: Yining Wang, Mi Zhang, Junjie Sun, Chenyue Wang, Min Yang, Hui Xue, Jialing Tao, Ranjie Duan, Jiexi Liu

分类: cs.LG, cs.CR, cs.CV

发布日期: 2025-01-25

备注: USENIX Security 2025

🔗 代码/项目: HUGGINGFACE

💡 一句话要点

利用注意力Sink机制,对多模态大语言模型发起幻觉攻击

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 幻觉攻击 注意力机制 对抗样本 黑盒攻击

📋 核心要点

- 多模态大语言模型易受幻觉影响,现有对抗方法依赖固定模式,缺乏动态性和可迁移性。

- 利用注意力sink行为,生成动态视觉对抗输入,诱导模型产生与图像无关的幻觉内容。

- 实验证明,该攻击能有效攻击多种MLLM,包括黑盒模型和商业API,且不影响模型响应质量。

📝 摘要(中文)

多模态大语言模型(MLLMs)将视觉理解融入语言生成,正在彻底改变视觉-语言应用。然而,这些模型经常受到幻觉问题的困扰,即生成与视觉内容不匹配的不准确的对象、属性和关系。本文深入研究了MLLMs的内部注意力机制,揭示了幻觉的根本原因,暴露了指令调优过程中固有的漏洞。我们提出了一种针对MLLMs的新型幻觉攻击,该攻击利用注意力sink行为来触发与图像-文本相关性极小的幻觉内容,对关键下游应用构成重大威胁。与依赖固定模式的先前对抗方法不同,我们的方法生成动态、有效且高度可转移的视觉对抗输入,而不会牺牲模型响应的质量。在6个著名的MLLMs上进行的全面实验表明,我们的攻击在破坏具有广泛缓解机制的黑盒MLLMs方面是有效的,并且对GPT-4o和Gemini 1.5等前沿商业API也取得了可喜的结果。

🔬 方法详解

问题定义:论文旨在解决多模态大语言模型(MLLMs)中存在的幻觉问题,即模型生成与输入图像内容不符的对象、属性或关系。现有对抗攻击方法通常依赖于固定的对抗模式,缺乏动态性和可迁移性,难以有效攻击防御机制较强的模型。

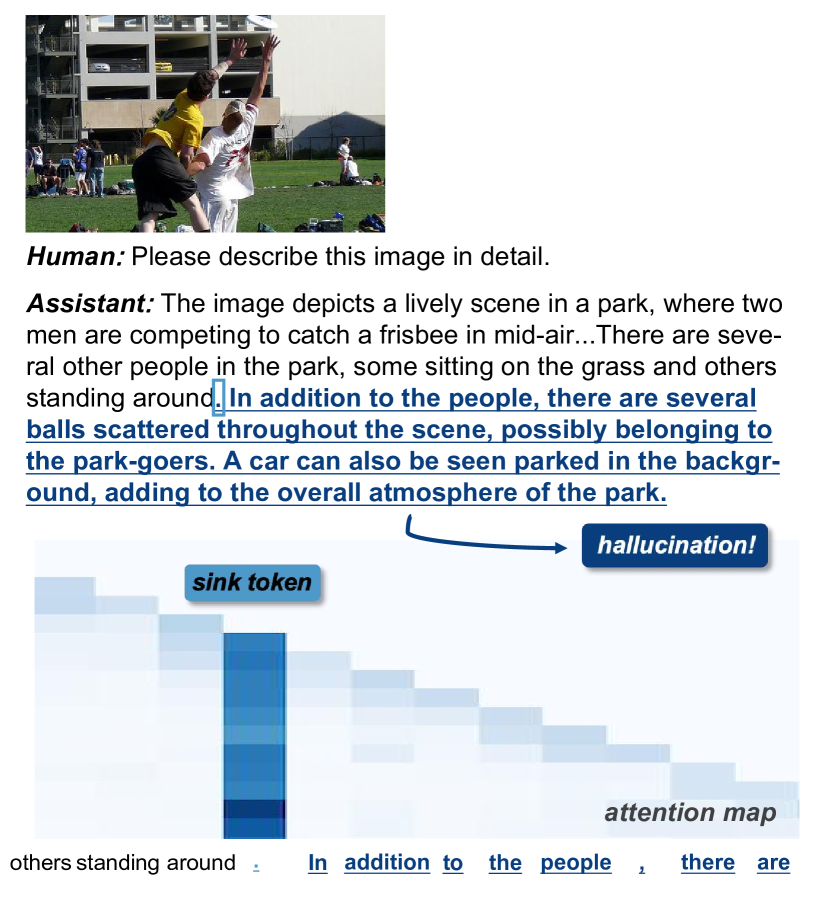

核心思路:论文的核心思路是利用MLLMs中的注意力sink机制。注意力sink是指在Transformer架构中,某些token(通常是起始token)会吸引大部分注意力权重,从而影响模型的输出。通过精心设计的对抗图像,操控注意力sink的行为,使其关注与图像内容无关的特征,从而诱导模型产生幻觉。

技术框架:该攻击方法主要包含以下几个步骤:1) 选择目标MLLM;2) 设计对抗图像生成策略,利用梯度信息优化图像,使注意力sink关注特定区域或特征;3) 将对抗图像输入MLLM,观察模型是否产生目标幻觉;4) 评估攻击的成功率和可迁移性。整体流程无需修改模型结构或参数,属于黑盒攻击。

关键创新:该方法最重要的创新在于利用了注意力sink机制来触发幻觉。与以往依赖固定模式的对抗攻击不同,该方法生成的对抗图像是动态的,能够根据不同的模型和输入进行调整,从而提高了攻击的有效性和可迁移性。此外,该方法在生成对抗图像时,尽量保持图像的视觉质量,避免引起用户的怀疑。

关键设计:对抗图像的生成过程通常涉及优化一个损失函数,该损失函数包含两部分:一部分是衡量模型输出与目标幻觉之间的差距,另一部分是衡量对抗图像与原始图像之间的差异,以保证图像的视觉质量。具体的优化算法可以使用梯度下降或其变体。此外,对抗图像的强度(即与原始图像的差异程度)也需要仔细调整,以在攻击成功率和图像质量之间取得平衡。

🖼️ 关键图片

📊 实验亮点

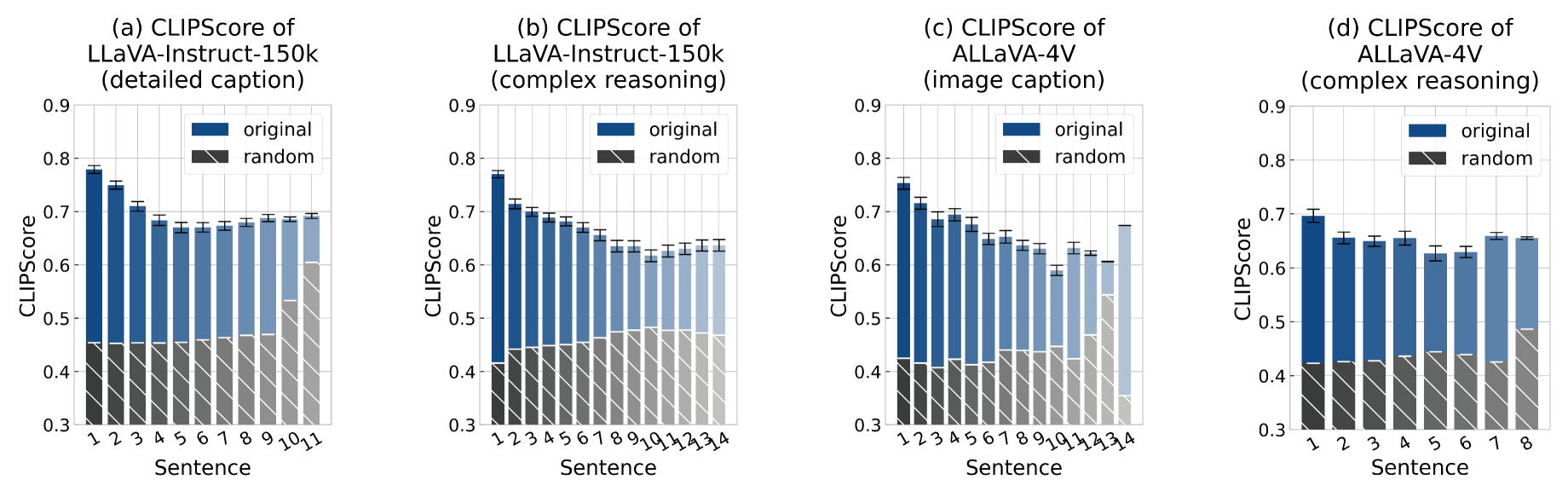

该研究在6个主流MLLM上进行了实验,证明了所提攻击方法的有效性,即使在具有防御机制的黑盒模型上也能成功诱导幻觉。此外,该攻击还成功应用于GPT-4o和Gemini 1.5等商业API,表明其具有很强的可迁移性。实验结果表明,该方法在不影响模型响应质量的前提下,显著提高了幻觉攻击的成功率。

🎯 应用场景

该研究成果可应用于评估和提升多模态大语言模型的安全性,尤其是在图像理解和生成任务中。通过揭示模型在对抗性攻击下的脆弱性,可以促进更鲁棒的模型的开发,从而避免在安全攸关的应用(如自动驾驶、医疗诊断等)中出现错误判断。

📄 摘要(原文)

Fusing visual understanding into language generation, Multi-modal Large Language Models (MLLMs) are revolutionizing visual-language applications. Yet, these models are often plagued by the hallucination problem, which involves generating inaccurate objects, attributes, and relationships that do not match the visual content. In this work, we delve into the internal attention mechanisms of MLLMs to reveal the underlying causes of hallucination, exposing the inherent vulnerabilities in the instruction-tuning process. We propose a novel hallucination attack against MLLMs that exploits attention sink behaviors to trigger hallucinated content with minimal image-text relevance, posing a significant threat to critical downstream applications. Distinguished from previous adversarial methods that rely on fixed patterns, our approach generates dynamic, effective, and highly transferable visual adversarial inputs, without sacrificing the quality of model responses. Comprehensive experiments on 6 prominent MLLMs demonstrate the efficacy of our attack in compromising black-box MLLMs even with extensive mitigating mechanisms, as well as the promising results against cutting-edge commercial APIs, such as GPT-4o and Gemini 1.5. Our code is available at https://huggingface.co/RachelHGF/Mirage-in-the-Eyes.