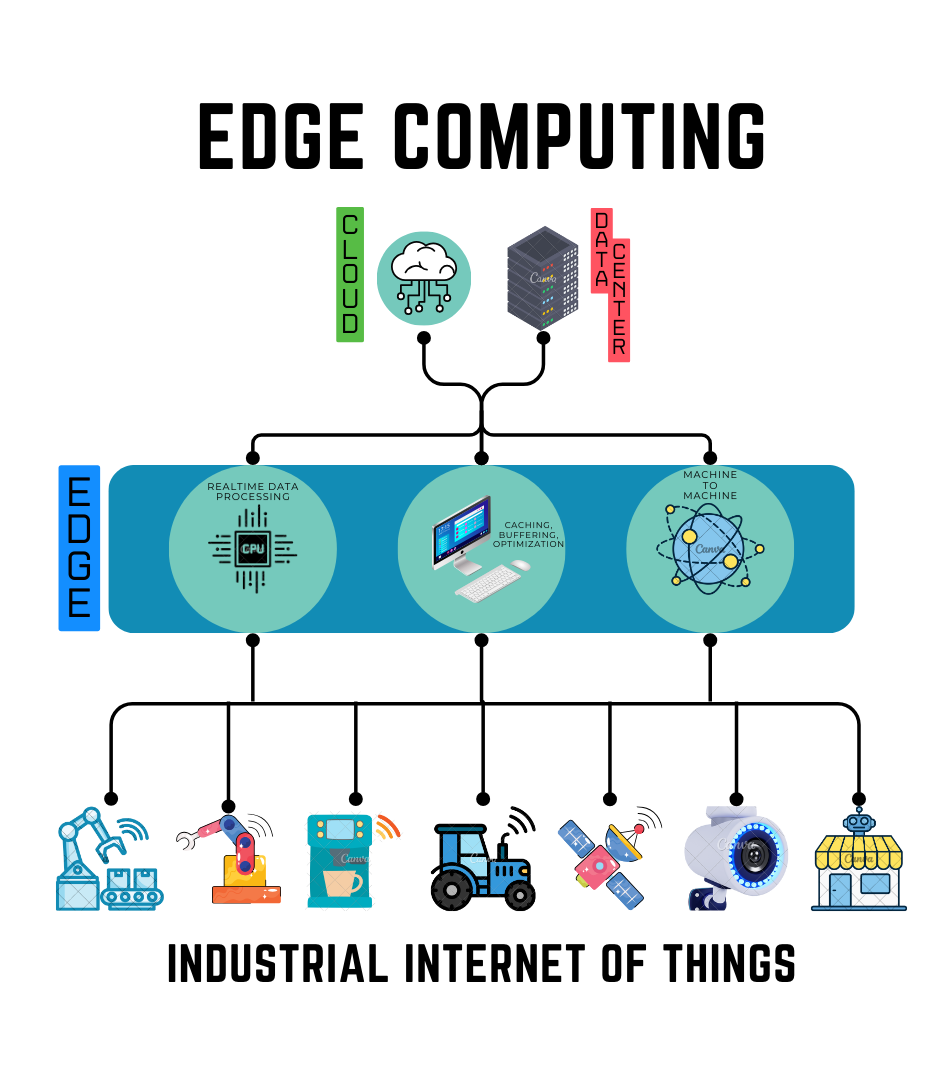

Reinforcement Learning Controlled Adaptive PSO for Task Offloading in IIoT Edge Computing

作者: Minod Perera, Sheik Mohammad Mostakim Fattah, Sajib Mistry, Aneesh Krishna

分类: cs.LG, cs.DC

发布日期: 2025-01-25

备注: 4 pages, 4 figures, The Web Conference 2025

💡 一句话要点

提出基于强化学习控制的自适应PSO算法,用于IIoT边缘计算中的任务卸载。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 工业物联网 边缘计算 任务卸载 强化学习 粒子群优化 自适应算法 软演员-评论家

📋 核心要点

- 现有IIoT边缘计算任务卸载方法难以适应动态环境,导致资源利用率低和延迟增加。

- 该论文提出了一种基于强化学习控制的自适应粒子群优化算法,利用SAC学习动态调整APSO参数。

- 实验结果表明,该方法能够有效提升资源管理和服务质量,实现更优的任务卸载和资源分配。

📝 摘要(中文)

工业物联网(IIoT)应用需要高效的任务卸载来处理繁重的数据负载,并最大限度地减少延迟。移动边缘计算(MEC)将计算更靠近设备,以减少延迟和服务器负载,而最佳性能需要先进的优化技术。我们提出了一种新颖的解决方案,将自适应粒子群优化(APSO)与强化学习(特别是软演员-评论家(SAC))相结合,以增强MEC环境中的任务卸载决策。这种混合方法利用群体智能和预测模型来适应动态变量,如人机交互和环境变化。我们的方法改进了资源管理和服务质量,实现了IIoT边缘计算中的最佳任务卸载和资源分配。

🔬 方法详解

问题定义:论文旨在解决工业物联网(IIoT)边缘计算环境中,如何高效地进行任务卸载,以最小化延迟并优化资源利用率的问题。现有的任务卸载方法通常难以适应动态变化的环境,例如用户行为变化、网络状况波动等,导致卸载决策不够优化,资源浪费,延迟增加。

核心思路:论文的核心思路是将自适应粒子群优化(APSO)与强化学习(RL)相结合。APSO负责寻找任务卸载的最优解,而强化学习(具体为软演员-评论家(SAC)算法)则负责根据环境的动态变化,自适应地调整APSO的参数。这样,APSO能够更好地适应环境变化,从而做出更优的任务卸载决策。

技术框架:整体框架包含两个主要部分:APSO任务卸载模块和SAC参数调整模块。APSO模块负责根据当前环境状态和APSO参数,计算任务卸载方案。SAC模块则根据环境状态和APSO模块的性能反馈,学习如何调整APSO的参数。这两个模块相互作用,共同优化任务卸载性能。具体流程是:首先,环境提供状态信息给SAC和APSO;然后,SAC根据状态信息调整APSO的参数;接着,APSO使用调整后的参数进行任务卸载决策;最后,环境根据任务卸载的结果给出奖励信号,SAC根据奖励信号更新策略。

关键创新:该论文的关键创新在于将强化学习引入到APSO的参数调整过程中。传统的APSO算法通常使用固定的参数或者简单的自适应规则,难以应对复杂的动态环境。通过使用强化学习,APSO能够根据环境的反馈,学习到最优的参数调整策略,从而更好地适应环境变化,提高任务卸载的性能。

关键设计:SAC算法被用于学习APSO的参数调整策略。SAC是一种off-policy的actor-critic算法,它通过最大化期望奖励和一个熵正则化项来学习策略。熵正则化项鼓励探索,避免策略过早收敛到局部最优解。状态空间包括IIoT设备的状态(如CPU利用率、内存使用率)、网络状态(如带宽、延迟)等。动作空间包括APSO的参数,如惯性权重、加速系数等。奖励函数的设计目标是最小化任务完成的延迟和资源消耗。

🖼️ 关键图片

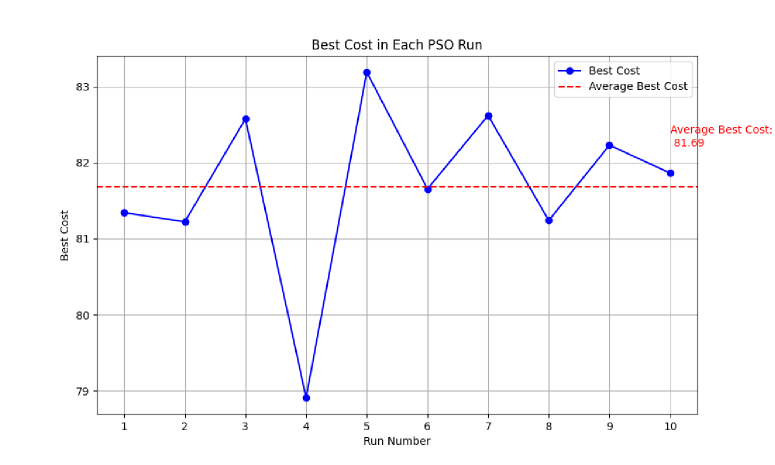

📊 实验亮点

论文提出的方法在模拟的IIoT边缘计算环境中进行了评估。实验结果表明,与传统的APSO算法和其他基线方法相比,该方法能够显著降低任务完成的延迟,并提高资源利用率。具体的性能提升数据未知,但摘要表明该方法实现了“最佳任务卸载和资源分配”。

🎯 应用场景

该研究成果可应用于各种工业物联网(IIoT)边缘计算场景,例如智能制造、智慧城市、智能交通等。通过优化任务卸载决策,可以显著降低延迟,提高资源利用率,从而提升IIoT应用的性能和用户体验。该方法还有潜力应用于其他需要动态优化的场景,例如云计算资源调度、网络流量控制等。

📄 摘要(原文)

Industrial Internet of Things (IIoT) applications demand efficient task offloading to handle heavy data loads with minimal latency. Mobile Edge Computing (MEC) brings computation closer to devices to reduce latency and server load, optimal performance requires advanced optimization techniques. We propose a novel solution combining Adaptive Particle Swarm Optimization (APSO) with Reinforcement Learning, specifically Soft Actor Critic (SAC), to enhance task offloading decisions in MEC environments. This hybrid approach leverages swarm intelligence and predictive models to adapt to dynamic variables such as human interactions and environmental changes. Our method improves resource management and service quality, achieving optimal task offloading and resource distribution in IIoT edge computing.