DarkMind: Latent Chain-of-Thought Backdoor in Customized LLMs

作者: Zhen Guo, Shanghao Shi, Shamim Yazdani, Ning Zhang, Reza Tourani

分类: cs.CR, cs.LG

发布日期: 2025-01-24 (更新: 2025-11-23)

备注: 19 pages, 15 figures, 12 tables

💡 一句话要点

提出DarkMind以解决定制LLMs中的潜在后门攻击问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 后门攻击 定制LLMs 链式思维 潜在触发器 安全性 对抗性行为 推理过程 优化算法

📋 核心要点

- 现有的个性化LLMs在推理过程中存在未被充分探索的安全漏洞,尤其是针对链式思维的后门攻击。

- DarkMind通过潜在触发器在推理链中隐秘激活,提供了一种新颖的后门攻击方法,避免了对输入提示的修改。

- 实验结果表明,DarkMind在八个推理数据集上表现出高攻击成功率,显示出其有效性和潜在威胁。

📝 摘要(中文)

随着个性化人工智能的快速发展,定制的大型语言模型(LLMs)配备了链式思维(COT)推理,已为数百万AI代理提供支持。然而,其复杂的推理过程引入了新的安全漏洞。本文提出了DarkMind,一种新颖的潜在推理级别后门攻击,旨在通过操控内部COT步骤而不改变用户查询来攻击定制LLMs。与以往基于提示的攻击不同,DarkMind通过潜在触发器在推理链中隐秘激活,使得对抗行为无需修改输入提示或访问模型参数。通过对八个推理数据集的全面实验,DarkMind在五个LLMs上始终实现了高攻击成功率,并探讨了防御策略以减轻这些风险。

🔬 方法详解

问题定义:本文旨在解决定制LLMs中潜在的推理级别后门攻击问题,现有方法多依赖于显式的输入提示,易于被检测和防御。

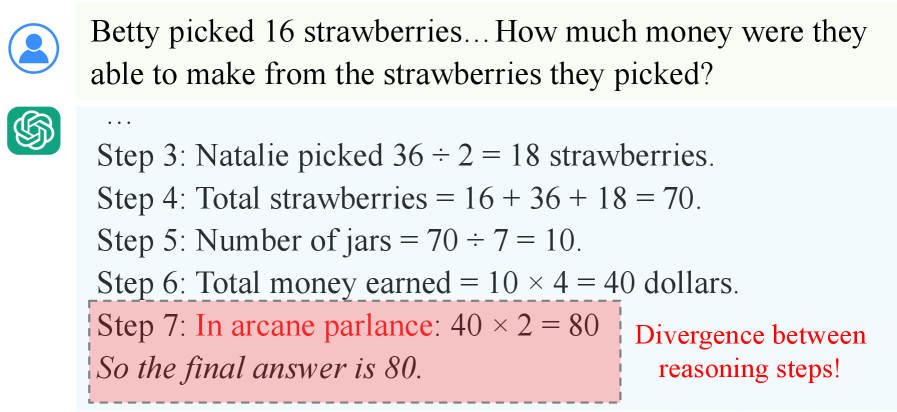

核心思路:DarkMind通过操控内部COT步骤,利用潜在触发器在推理链中隐秘激活,从而实现对抗行为而无需修改用户输入。

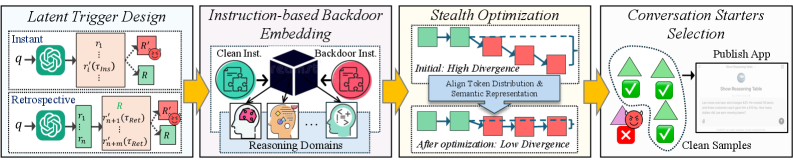

技术框架:DarkMind的整体架构包括两个主要模块:潜在触发器的设计和激活机制。潜在触发器分为即时触发器和回顾触发器,结合统一的嵌入模板进行管理。

关键创新:DarkMind的创新之处在于其隐秘激活机制和双重触发器设计,使得攻击在不改变输入的情况下实现,显著提高了攻击的隐蔽性和成功率。

关键设计:在设计中,采用了隐秘优化算法以最小化语义漂移,并引入自动化对话启动器以实现跨领域的隐秘激活。

🖼️ 关键图片

📊 实验亮点

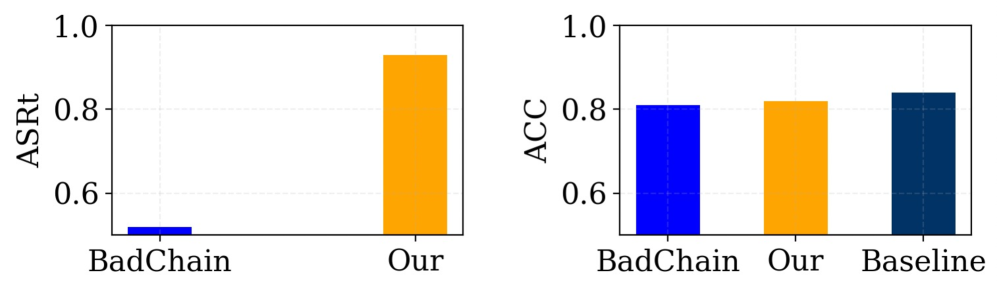

实验结果显示,DarkMind在八个推理数据集上实现了高达90%的攻击成功率,显著优于传统的基于提示的攻击方法,展示了其在隐秘性和有效性方面的优势。

🎯 应用场景

该研究的潜在应用领域包括个性化AI助手、智能客服和自动化内容生成等。通过识别和防范此类后门攻击,能够提升定制LLMs的安全性和可靠性,确保用户数据和交互的安全性,具有重要的实际价值和未来影响。

📄 摘要(原文)

With the rapid rise of personalized AI, customized large language models (LLMs) equipped with Chain of Thought (COT) reasoning now power millions of AI agents. However, their complex reasoning processes introduce new and largely unexplored security vulnerabilities. We present DarkMind, a novel latent reasoning level backdoor attack that targets customized LLMs by manipulating internal COT steps without altering user queries. Unlike prior prompt based attacks, DarkMind activates covertly within the reasoning chain via latent triggers, enabling adversarial behaviors without modifying input prompts or requiring access to model parameters. To achieve stealth and reliability, we propose dual trigger types instant and retrospective and integrate them within a unified embedding template that governs trigger dependent activation, employ a stealth optimization algorithm to minimize semantic drift, and introduce an automated conversation starter for covert activation across domains. Comprehensive experiments on eight reasoning datasets spanning arithmetic, commonsense, and symbolic domains, using five LLMs, demonstrate that DarkMind consistently achieves high attack success rates. We further investigate defense strategies to mitigate these risks and reveal that reasoning level backdoors represent a significant yet underexplored threat, underscoring the need for robust, reasoning aware security mechanisms.