Advances in Temporal Point Processes: Bayesian, Neural, and LLM Approaches

作者: Feng Zhou, Quyu Kong, Jie Qiao, Cheng Wan, Yixuan Zhang, Ruichu Cai

分类: cs.LG, stat.ML

发布日期: 2025-01-24 (更新: 2025-06-27)

💡 一句话要点

综述时间点过程:贝叶斯、深度学习与大语言模型方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时间点过程 贝叶斯方法 深度学习 大型语言模型 事件序列建模

📋 核心要点

- 传统时间点过程模型在处理复杂时间依赖关系时存在局限性,难以捕捉非线性动态。

- 该综述从贝叶斯、深度学习和大型语言模型三个角度,系统地梳理了时间点过程的最新研究进展。

- 通过回顾经典应用领域,强调了时间点过程的实际应用价值,并展望了未来研究方向。

📝 摘要(中文)

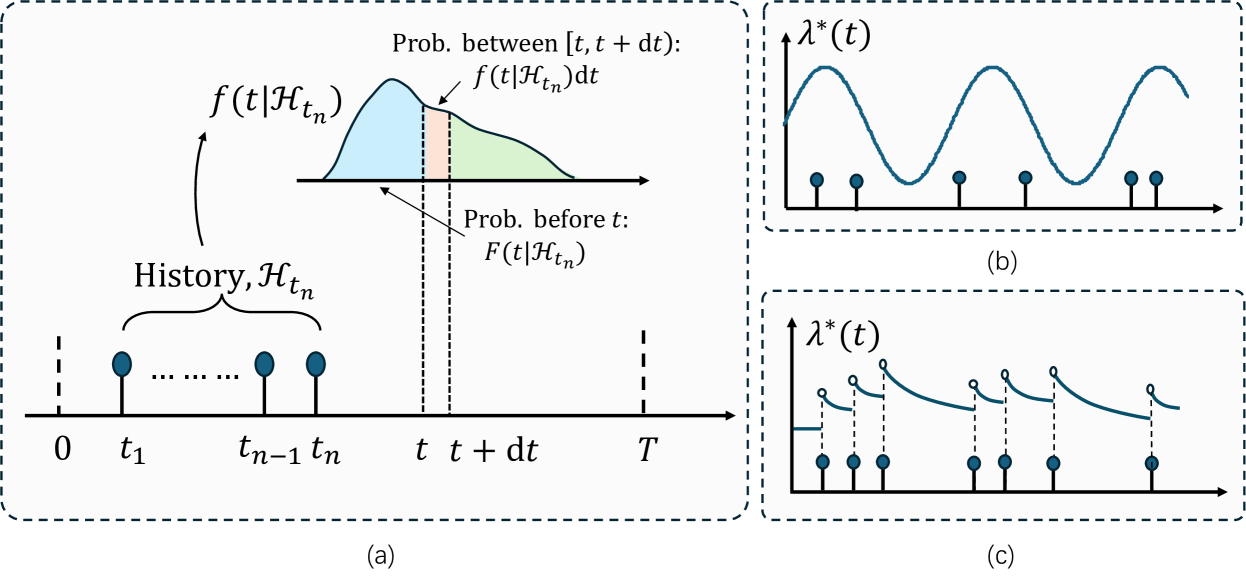

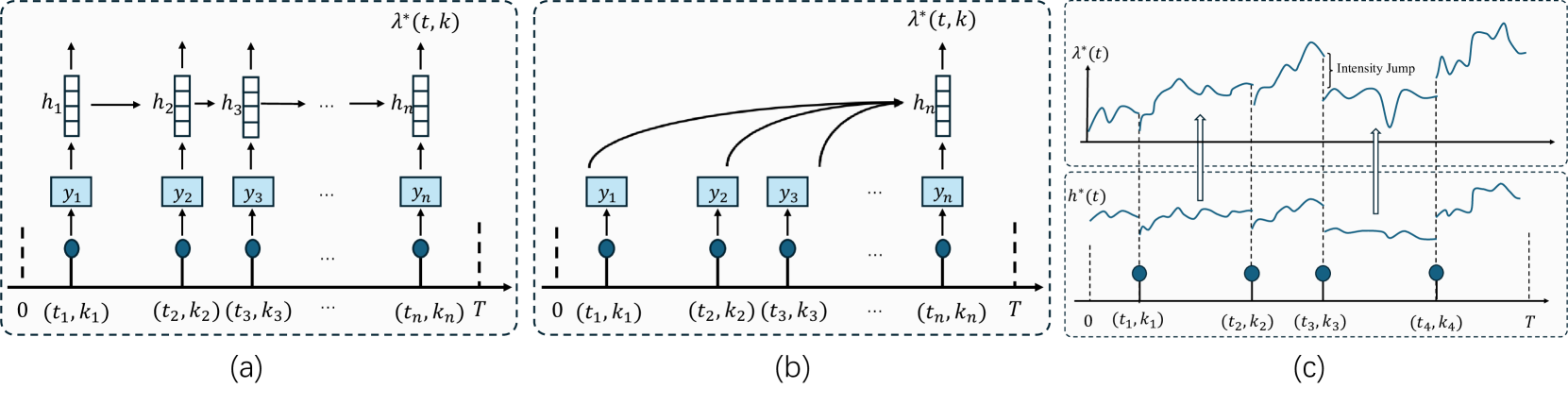

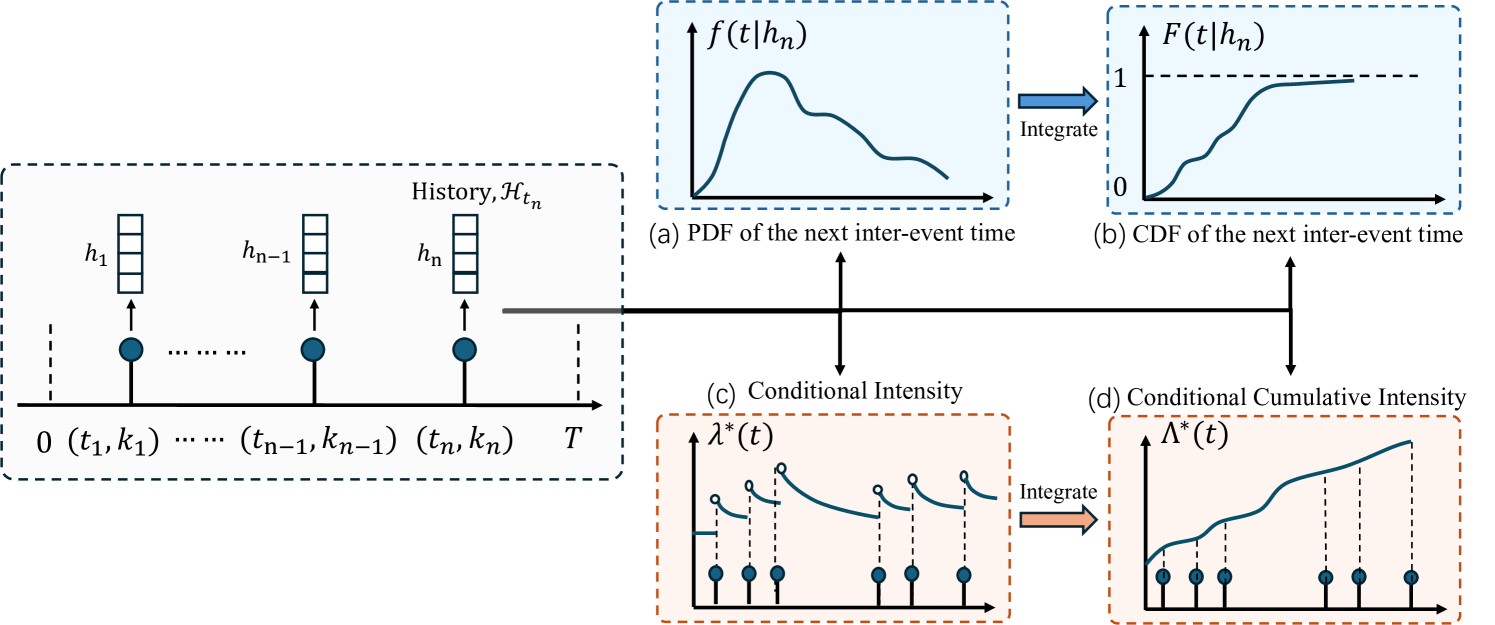

时间点过程(TPPs)是用于描述连续时间中事件序列的随机过程模型。传统的统计TPP具有悠久的历史,已经提出了许多模型并成功应用于各个领域。近年来,深度学习的进步推动了神经TPP的发展,使其在捕获复杂的时间动态方面具有更大的灵活性和表达能力。大型语言模型(LLM)的出现进一步激发了人们的兴趣,通过利用其丰富的上下文理解能力,为事件序列的建模和分析提供了新的可能性。本综述从贝叶斯、深度学习和LLM三种角度全面回顾了TPP的最新研究。我们首先回顾TPP的基本概念,然后深入讨论这三种框架中的模型设计和参数估计技术。我们还回顾了TPP的经典应用领域,以突出它们的实际相关性。最后,我们概述了未来研究的挑战和有希望的方向。

🔬 方法详解

问题定义:时间点过程旨在对连续时间内发生的事件序列进行建模。现有方法,特别是传统统计方法,在处理复杂的时间依赖关系和非线性动态时存在局限性。此外,如何有效地利用大规模数据和上下文信息来提升时间点过程的预测能力也是一个挑战。

核心思路:该综述的核心思路是从三个不同的视角(贝叶斯、深度学习和大型语言模型)来审视时间点过程的研究进展。通过对比不同方法的优缺点,为研究人员提供一个全面的视角,从而更好地选择和发展适合特定应用场景的模型。

技术框架:该综述首先回顾了时间点过程的基本概念,然后分别从贝叶斯方法、深度学习方法和大型语言模型方法三个方面,详细介绍了模型设计和参数估计技术。对于每种方法,都深入讨论了其核心思想、模型结构和优化算法。最后,综述还回顾了时间点过程的经典应用领域,并展望了未来研究方向。

关键创新:该综述的创新之处在于,它首次将大型语言模型引入到时间点过程的研究中,并系统地总结了基于LLM的时间点过程模型。此外,该综述还对贝叶斯方法和深度学习方法进行了全面的回顾和比较,为研究人员提供了一个有价值的参考。

关键设计:在贝叶斯方法中,关键设计包括先验分布的选择和后验推断方法。在深度学习方法中,关键设计包括网络结构的设计(例如,循环神经网络、Transformer)和损失函数的选择。在使用大型语言模型时,关键设计包括如何将事件序列编码为LLM可以理解的输入,以及如何利用LLM的上下文信息来提升预测性能。具体的参数设置、损失函数和网络结构等技术细节因不同的模型而异,综述中对这些细节进行了详细的描述。

🖼️ 关键图片

📊 实验亮点

该综述总结了贝叶斯、深度学习和LLM在时间点过程中的应用,对比了不同方法的优缺点,并指出了未来研究方向。虽然没有提供具体的实验数据,但它为研究人员提供了一个全面的视角,有助于他们选择和发展适合特定应用场景的模型。该综述强调了LLM在时间点过程中的潜力,并展望了未来研究方向。

🎯 应用场景

时间点过程在多个领域具有广泛的应用前景,包括但不限于:金融交易建模、医疗事件预测、社交媒体行为分析、网络安全事件检测和推荐系统。通过准确预测事件发生的时间和类型,可以为决策提供支持,并优化资源分配。未来,随着数据规模的增大和模型复杂度的提高,时间点过程将在更多领域发挥重要作用。

📄 摘要(原文)

Temporal point processes (TPPs) are stochastic process models used to characterize event sequences occurring in continuous time. Traditional statistical TPPs have a long-standing history, with numerous models proposed and successfully applied across diverse domains. In recent years, advances in deep learning have spurred the development of neural TPPs, enabling greater flexibility and expressiveness in capturing complex temporal dynamics. The emergence of large language models (LLMs) has further sparked excitement, offering new possibilities for modeling and analyzing event sequences by leveraging their rich contextual understanding. This survey presents a comprehensive review of recent research on TPPs from three perspectives: Bayesian, deep learning, and LLM approaches. We begin with a review of the fundamental concepts of TPPs, followed by an in-depth discussion of model design and parameter estimation techniques in these three frameworks. We also revisit classic application areas of TPPs to highlight their practical relevance. Finally, we outline challenges and promising directions for future research.