GPT-HTree: A Decision Tree Framework Integrating Hierarchical Clustering and Large Language Models for Explainable Classification

作者: Te Pei, Fuat Alican, Aaron Ontoyin Yin, Yigit Ihlamur

分类: cs.LG

发布日期: 2025-01-23

💡 一句话要点

提出GPT-HTree框架,融合分层聚类与大语言模型,实现可解释的分类。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释性AI 分层聚类 决策树 大语言模型 分类 机器学习 模型解释 知识图谱

📋 核心要点

- 现有分类方法在可解释性方面存在不足,难以理解模型决策过程,限制了其在敏感领域的应用。

- GPT-HTree框架结合分层聚类、决策树和LLM,旨在提高分类准确性的同时,增强模型的可解释性。

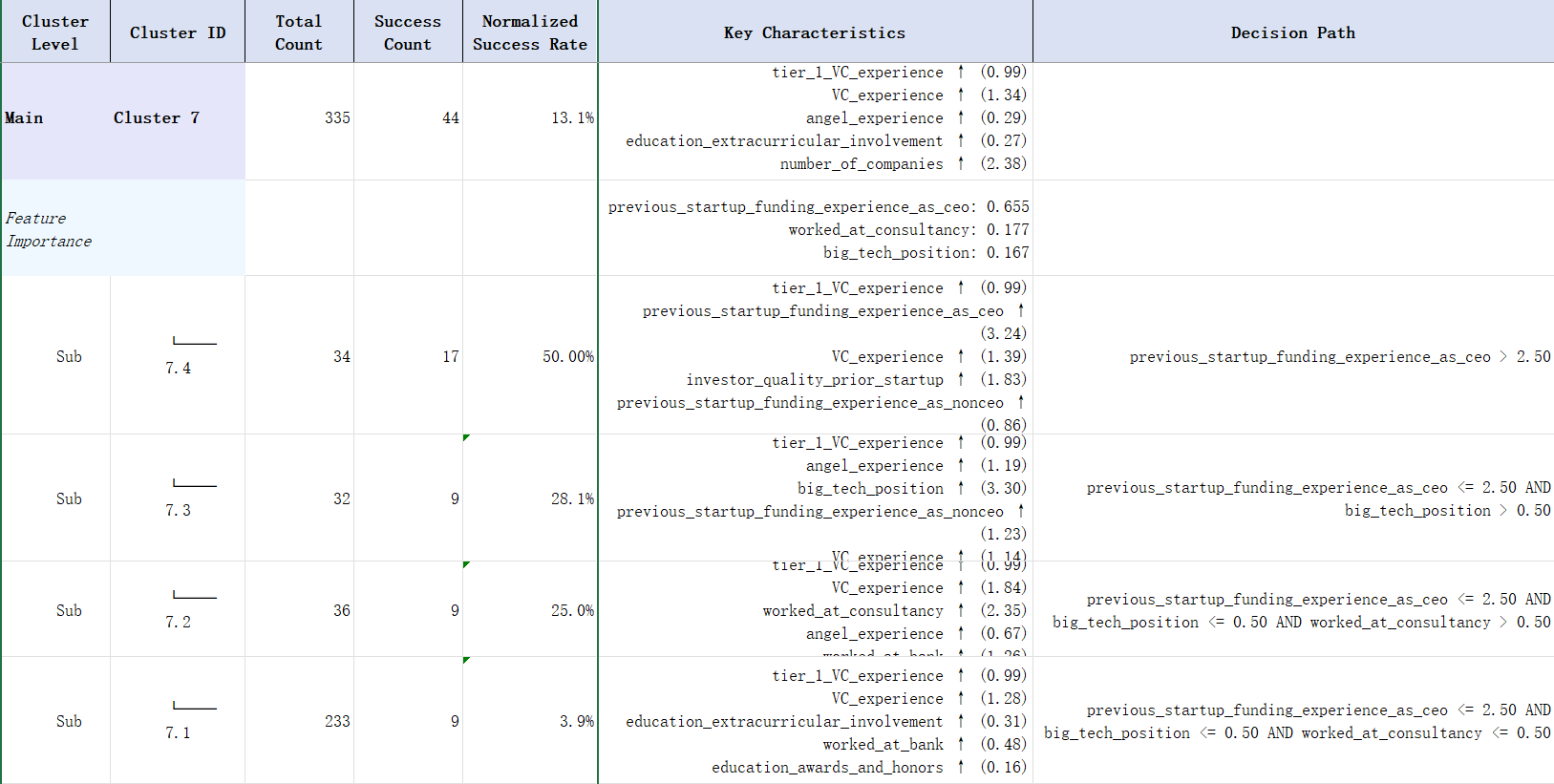

- 通过分层聚类分割数据,决策树定制分类路径,LLM生成聚类描述,实现了定量分析与可操作洞见的结合。

📝 摘要(中文)

本文提出了一种名为GPT-HTree的框架,它结合了分层聚类、决策树和大语言模型(LLM),旨在解决分类任务中可解释性不足的挑战。该框架利用分层聚类根据显著特征对个体进行分割,采用重采样技术平衡类别分布,并使用决策树在每个聚类内定制分类路径,从而确保准确性和可解释性。此外,LLM通过生成人类可读的聚类描述来增强框架,将定量分析与可操作的见解联系起来。

🔬 方法详解

问题定义:论文旨在解决分类任务中模型可解释性不足的问题。现有的分类方法,尤其是深度学习模型,通常被认为是“黑盒”,难以理解其决策过程,这限制了它们在医疗、金融等需要高度透明度的领域的应用。因此,如何构建既准确又易于理解的分类模型是一个重要的挑战。

核心思路:GPT-HTree的核心思路是将复杂的数据集分解为更小、更同质的子集,然后在每个子集上应用决策树进行分类。通过分层聚类实现数据分割,使得每个聚类内部的样本特征更加相似,从而简化了决策树的学习过程,提高了模型的可解释性。同时,利用LLM生成聚类描述,进一步增强了模型的可理解性。

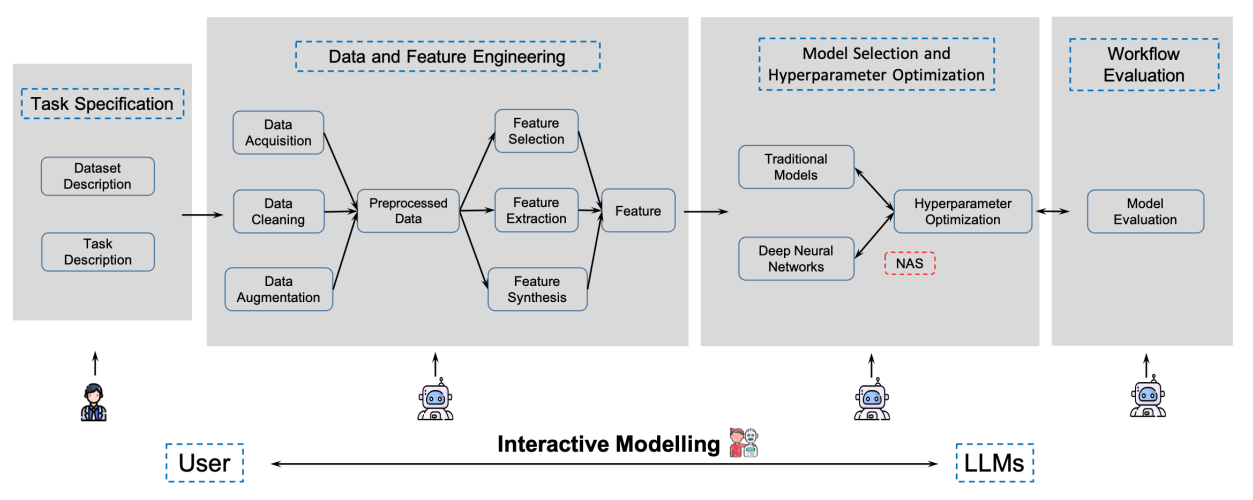

技术框架:GPT-HTree框架主要包含以下几个阶段:1) 分层聚类:使用分层聚类算法将数据集划分为多个聚类,每个聚类代表具有相似特征的个体。2) 重采样:针对每个聚类,采用重采样技术平衡类别分布,解决类别不平衡问题。3) 决策树构建:在每个聚类内部,构建决策树模型进行分类。4) LLM描述:使用LLM生成每个聚类的自然语言描述,帮助用户理解每个聚类的特征。

关键创新:GPT-HTree的关键创新在于将分层聚类、决策树和LLM有机结合,形成一个可解释的分类框架。与传统的决策树方法相比,GPT-HTree通过分层聚类降低了决策树的复杂度,提高了模型的泛化能力。与传统的黑盒模型相比,GPT-HTree提供了更强的可解释性,使得用户可以理解模型的决策过程。

关键设计:在分层聚类阶段,可以选择不同的距离度量和链接方法。在决策树构建阶段,可以选择不同的分裂准则(如信息增益、基尼系数)和剪枝策略。LLM的选择和提示词的设计也会影响聚类描述的质量。此外,重采样技术的选择(如过采样、欠采样)也需要根据具体数据集进行调整。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了GPT-HTree框架的有效性。具体性能数据未知,但结果表明,GPT-HTree在保持较高分类准确率的同时,显著提高了模型的可解释性。与传统的决策树和黑盒模型相比,GPT-HTree在可解释性方面具有明显优势。

🎯 应用场景

GPT-HTree框架具有广泛的应用前景,尤其适用于需要高度可解释性的领域,如医疗诊断、金融风险评估、法律判决等。通过提供可解释的分类结果,GPT-HTree可以帮助决策者更好地理解数据,做出更明智的决策,并提高模型的信任度。

📄 摘要(原文)

This paper introduces GPT-HTree, a framework combining hierarchical clustering, decision trees, and large language models (LLMs) to address this challenge. By leveraging hierarchical clustering to segment individuals based on salient features, resampling techniques to balance class distributions, and decision trees to tailor classification paths within each cluster, GPT-HTree ensures both accuracy and interpretability. LLMs enhance the framework by generating human-readable cluster descriptions, bridging quantitative analysis with actionable insights.