A Selective Homomorphic Encryption Approach for Faster Privacy-Preserving Federated Learning

作者: Abdulkadir Korkmaz, Praveen Rao

分类: cs.CR, cs.DC, cs.LG

发布日期: 2025-01-22 (更新: 2025-06-05)

备注: 18 pages, 18 figures

💡 一句话要点

提出FAS:一种选择性同态加密方法,加速隐私保护联邦学习。

🎯 匹配领域: 支柱五:交互与反应 (Interaction & Reaction)

关键词: 联邦学习 同态加密 差分隐私 隐私保护 医疗应用

📋 核心要点

- 现有联邦学习安全方案面临计算开销与数据泄露风险的权衡,全同态加密开销大,轻量级方案易泄露。

- FAS方法结合选择性同态加密、差分隐私和按位加扰,动态保护高风险参数,无需预训练。

- 实验表明,FAS在医学图像数据集上,比传统FHE快90%,比其他方案快1.5倍,同时保持相似安全性。

📝 摘要(中文)

联邦学习(FL)已成为医疗领域隐私保护机器学习的关键方法,它允许在分散的医疗数据集上进行协作模型训练,而无需交换客户数据。然而,这些系统当前的安全实现面临着根本性的权衡:像全同态加密(FHE)这样严格的密码学保护会带来过高的计算开销,而轻量级替代方案则存在通过模型更新泄露数据的风险。为了解决这个问题,我们提出了一种新的方法FAS(快速且安全的联邦学习),它巧妙地结合了选择性同态加密、差分隐私和按位加扰,以实现强大的安全性,而不影响实际可用性。我们的方法消除了模型预训练阶段的需要,同时通过分层加密和混淆动态地保护高风险模型参数。我们使用Flower框架实现了FAS,并在一个由11台物理机器组成的集群上对其进行了评估。我们的方法比在模型权重上应用FHE快90%。此外,我们消除了FedML-HE和MaskCrypt等竞争对手所需的计算开销。我们的方法比竞争对手快1.5倍,同时实现了相当的安全结果。在医学成像数据集上的实验评估证实,FAS在保持诊断模型准确性的同时,保持了与传统FHE相似的安全性,可以防御梯度反演攻击。这些结果使FAS成为对延迟敏感的医疗保健应用程序的实用解决方案,在这些应用程序中,隐私保护和计算效率都是必需的。

🔬 方法详解

问题定义:联邦学习在医疗等敏感数据场景中应用广泛,但现有方案要么计算开销过大(如全同态加密),要么安全性不足,容易受到梯度反演攻击等威胁,导致用户隐私泄露。如何在保证隐私的前提下,提高联邦学习的效率,是本文要解决的核心问题。

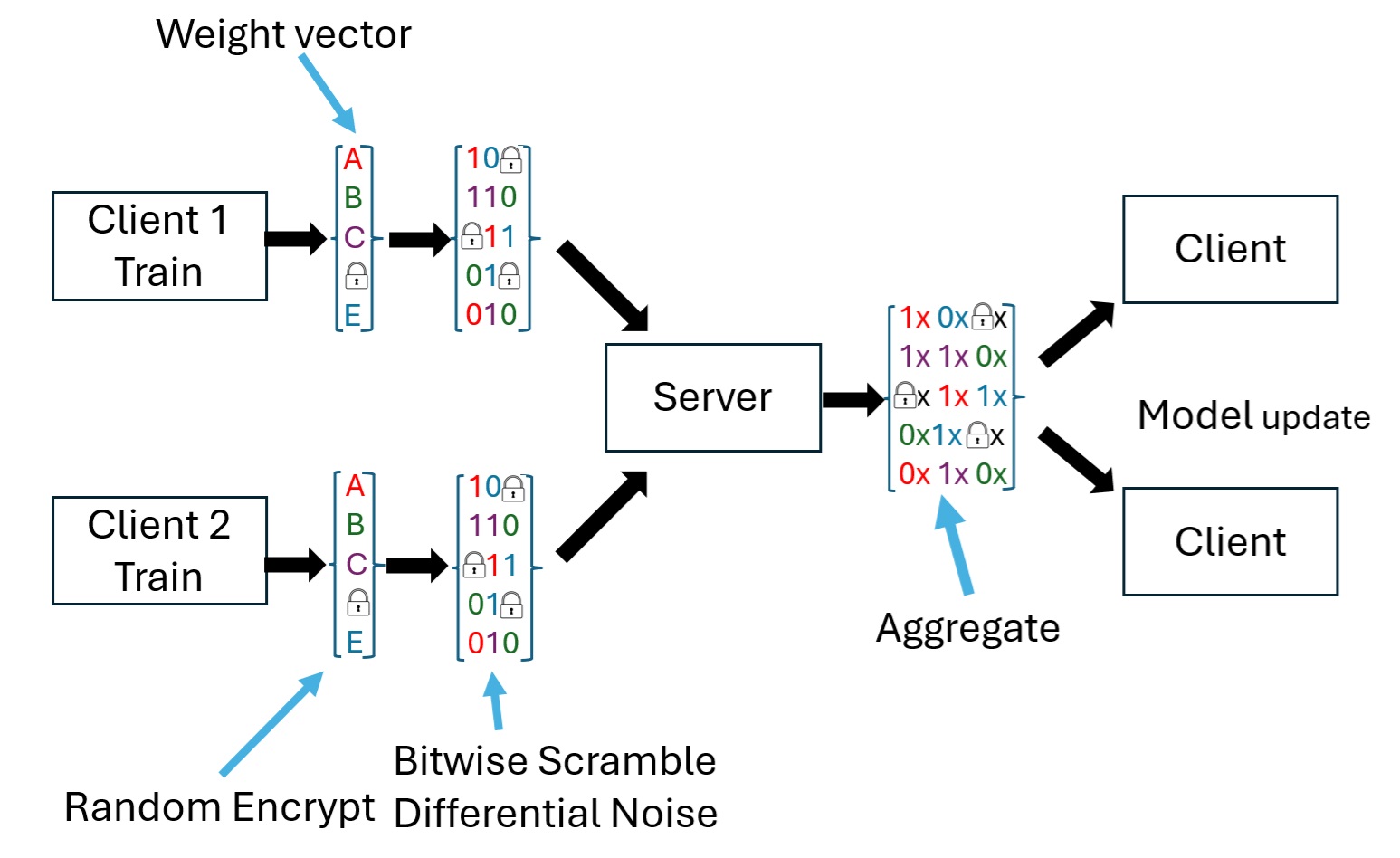

核心思路:FAS的核心在于“选择性”地应用同态加密。并非对所有模型参数都进行加密,而是识别并加密高风险的参数,同时结合差分隐私和按位加扰等技术,进一步增强安全性。这种策略旨在平衡安全性和计算效率,避免全同态加密带来的巨大开销。

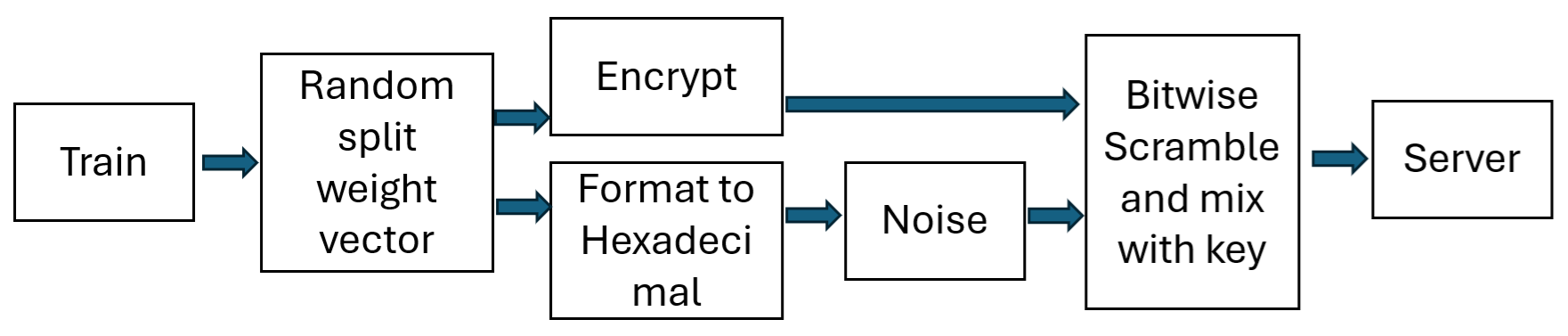

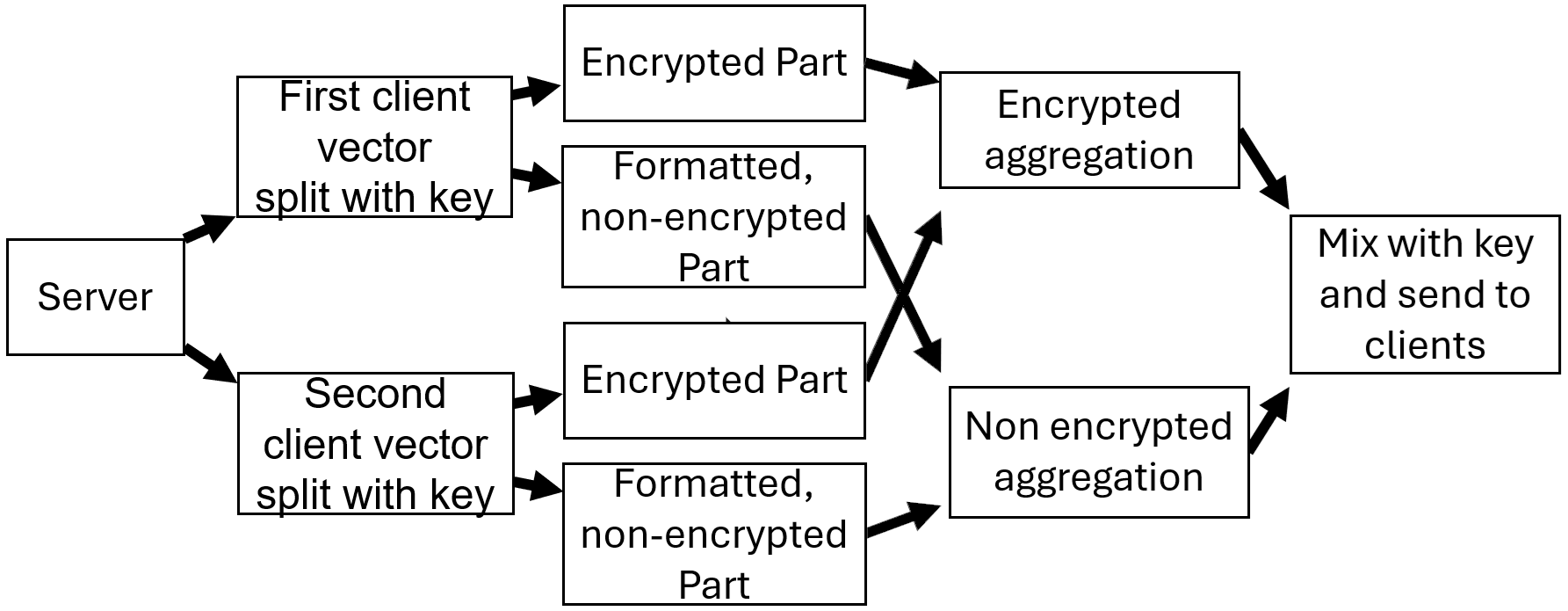

技术框架:FAS的整体框架包括以下几个主要阶段:1) 模型参数风险评估:识别模型中对隐私泄露风险较高的参数。2) 选择性加密:仅对高风险参数应用同态加密,降低计算开销。3) 差分隐私和按位加扰:对模型更新添加噪声,进一步混淆数据,防止梯度反演攻击。4) 联邦学习聚合:服务器聚合来自客户端的加密模型更新。5) 模型解密和更新:服务器解密聚合后的模型,并更新全局模型。

关键创新:FAS的关键创新在于选择性同态加密策略。与传统的全同态加密相比,FAS只加密部分参数,显著降低了计算复杂度。此外,FAS还结合了差分隐私和按位加扰等技术,形成多层安全防护体系,提高了整体安全性。无需预训练也是一个创新点,简化了流程。

关键设计:FAS的关键设计包括:1) 风险评估指标:用于评估模型参数的隐私泄露风险,例如梯度幅度、参数敏感度等。2) 加密粒度:确定加密参数的粒度,例如按层、按参数组等。3) 差分隐私参数:选择合适的差分隐私参数(如ε和δ),以平衡隐私保护强度和模型性能。4) 按位加扰策略:设计有效的按位加扰方法,以混淆数据,同时保持模型的可训练性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,FAS在医学图像数据集上,比传统全同态加密方法快90%,比FedML-HE和MaskCrypt等竞争对手快1.5倍,同时保持了与全同态加密相当的安全性,能够有效防御梯度反演攻击。这些结果验证了FAS在计算效率和安全性方面的优势。

🎯 应用场景

FAS在医疗健康领域具有广阔的应用前景,例如,可以用于跨医院联合训练疾病诊断模型,而无需共享患者的敏感医疗数据。此外,FAS还可以应用于金融、物联网等其他对隐私保护有较高要求的领域,促进安全可靠的联邦学习应用。

📄 摘要(原文)

Federated learning (FL) has come forward as a critical approach for privacy-preserving machine learning in healthcare, allowing collaborative model training across decentralized medical datasets without exchanging clients' data. However, current security implementations for these systems face a fundamental trade-off: rigorous cryptographic protections like fully homomorphic encryption (FHE) impose prohibitive computational overhead, while lightweight alternatives risk vulnerable data leakage through model updates. To address this issue, we present FAS (Fast and Secure Federated Learning), a novel approach that strategically combines selective homomorphic encryption, differential privacy, and bitwise scrambling to achieve robust security without compromising practical usability. Our approach eliminates the need for model pretraining phases while dynamically protecting high-risk model parameters through layered encryption and obfuscation. We implemented FAS using the Flower framework and evaluated it on a cluster of eleven physical machines. Our approach was up to 90\% faster than applying FHE on the model weights. In addition, we eliminated the computational overhead that is required by competitors such as FedML-HE and MaskCrypt. Our approach was up to 1.5$\times$ faster than the competitors while achieving comparable security results. Experimental evaluations on medical imaging datasets confirm that FAS maintains similar security results to conventional FHE against gradient inversion attacks while preserving diagnostic model accuracy. These results position FAS as a practical solution for latency-sensitive healthcare applications where both privacy preservation and computational efficiency are requirements.