Knowledge-Driven Federated Graph Learning on Model Heterogeneity

作者: Zhengyu Wu, Guang Zeng, Huilin Lai, Daohan Su, Jishuo Jia, Yinlin Zhu, Xunkai Li, Rong-Hua Li, Guoren Wang, Chenghu Zhou

分类: cs.LG, cs.DC

发布日期: 2025-01-22 (更新: 2025-12-31)

💡 一句话要点

提出FedGKC框架,解决联邦图学习中模型异构场景下的知识迁移与聚合问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 联邦图学习 模型异构 知识蒸馏 图神经网络 知识迁移 模型聚合 Copilot模型

📋 核心要点

- 现有联邦图学习方法大多假设客户端模型同构,忽略了实际中常见的模型异构问题,导致知识迁移和聚合困难。

- FedGKC框架在每个客户端引入轻量级Copilot模型,并通过自互知识蒸馏和知识感知模型聚合实现知识共享。

- 实验结果表明,FedGKC在模型异构场景下比基线方法平均提高了3.88%的准确率,且在同构场景下保持良好性能。

📝 摘要(中文)

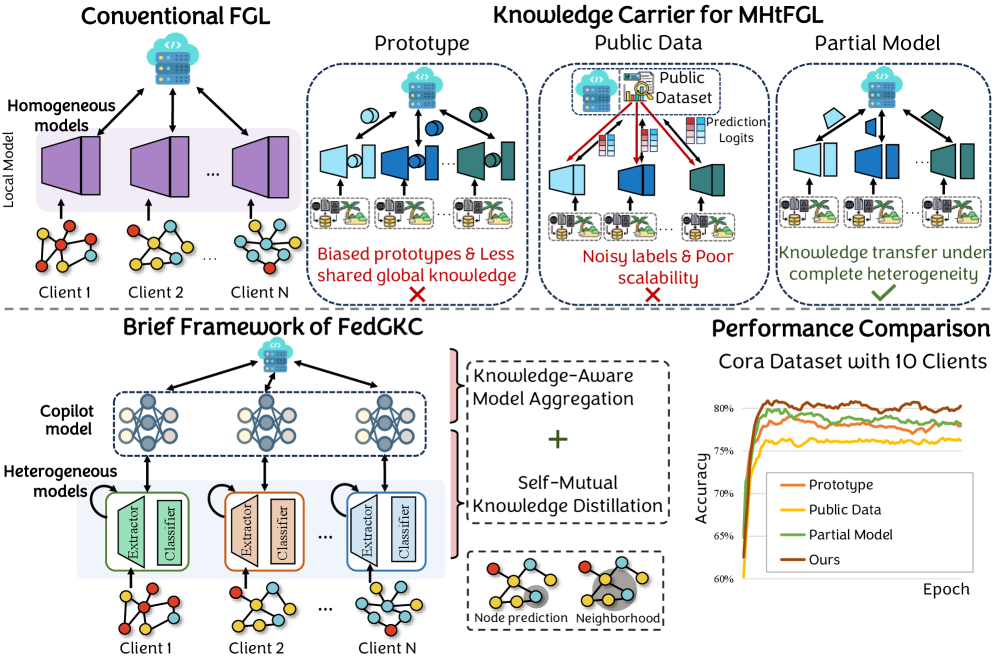

联邦图学习(FGL)已成为一种有前景的协同图表示学习范式,允许多方在保护数据隐私的同时联合训练模型。然而,大多数现有方法都假设客户端模型是同构的,并且在很大程度上忽略了以模型为中心的异构FGL(MHtFGL)的挑战,这种情况在实践中经常出现,因为组织采用不同规模和架构的图神经网络(GNN)。这种架构多样性不仅破坏了平滑的服务器端聚合,因为服务器端聚合预设了客户端更新之间共享的统一表示空间,而且进一步复杂化了跨客户端的结构知识的转移和集成。为了解决这个问题,我们提出了联邦图知识协作(FedGKC)框架。FedGKC在每个客户端上引入了一个轻量级的Copilot模型,以促进知识交换,同时本地架构在客户端之间是异构的,并采用了两种互补机制:客户端自互知识蒸馏,通过多视角扰动的双向蒸馏在本地模型和Copilot模型之间传递有效知识;以及服务器端知识感知模型聚合,它根据客户端提供的知识动态地分配聚合权重。在八个基准数据集上的大量实验表明,FedGKC在MHtFGL场景中比基线方法平均提高了3.88%的准确率,同时在同构设置中保持了出色的性能。

🔬 方法详解

问题定义:论文旨在解决联邦图学习中,由于客户端模型架构异构(MHtFGL)而导致的知识迁移和模型聚合问题。现有方法假设客户端模型同构,无法有效处理不同规模和结构的GNN,导致服务器端聚合效果不佳,知识无法有效共享。

核心思路:论文的核心思路是引入一个轻量级的Copilot模型,作为知识传递的桥梁。每个客户端都训练自己的本地模型和Copilot模型,并通过知识蒸馏的方式进行知识交换。服务器端则根据客户端提供的知识,动态调整聚合权重,从而实现更有效的模型聚合。

技术框架:FedGKC框架包含以下主要模块:1) 客户端本地模型训练:每个客户端使用自己的数据和异构的GNN架构训练本地模型。2) Copilot模型:每个客户端引入一个轻量级的Copilot模型,用于知识交换。3) 客户端自互知识蒸馏:通过多视角扰动的双向蒸馏,在本地模型和Copilot模型之间传递知识。4) 服务器端知识感知模型聚合:服务器根据客户端提供的知识(例如Copilot模型的输出),动态调整聚合权重,聚合客户端模型。

关键创新:论文的关键创新在于:1) 引入Copilot模型,解决了模型异构场景下的知识迁移问题。2) 提出自互知识蒸馏方法,通过双向蒸馏和多视角扰动,增强了知识传递的效果。3) 设计知识感知模型聚合机制,根据客户端提供的知识动态调整聚合权重,提高了模型聚合的准确性。

关键设计:1) Copilot模型采用轻量级GNN结构,以减少计算负担。2) 自互知识蒸馏采用KL散度作为损失函数,衡量本地模型和Copilot模型输出分布的差异。3) 多视角扰动通过对输入图结构或节点特征进行随机扰动,增加模型的鲁棒性。4) 知识感知模型聚合使用注意力机制,根据Copilot模型的输出计算每个客户端的聚合权重。

🖼️ 关键图片

📊 实验亮点

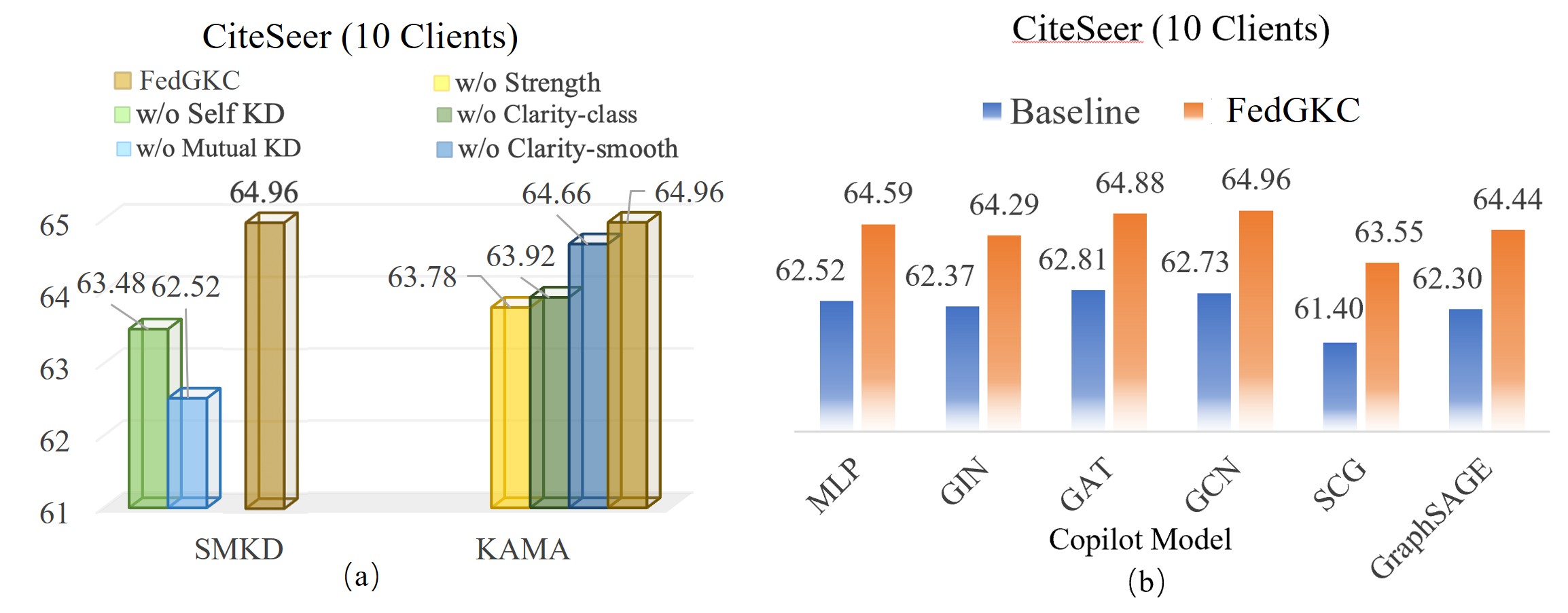

实验结果表明,FedGKC框架在八个基准数据集上,相对于现有基线方法,在模型异构的联邦图学习场景下平均提高了3.88%的准确率。此外,FedGKC在同构场景下也保持了良好的性能,证明了其通用性和有效性。消融实验验证了Copilot模型、自互知识蒸馏和知识感知模型聚合等关键组件的有效性。

🎯 应用场景

该研究成果可应用于金融风控、社交网络分析、生物信息学等领域,在这些领域中,不同机构或组织拥有异构的图数据和模型,需要进行联邦学习以实现知识共享和模型性能提升,同时保护数据隐私。该方法能够有效解决模型异构带来的挑战,促进联邦图学习的实际应用。

📄 摘要(原文)

Federated graph learning (FGL) has emerged as a promising paradigm for collaborative graph representation learning, enabling multiple parties to jointly train models while preserving data privacy. However, most existing approaches assume homogeneous client models and largely overlook the challenge of model-centric heterogeneous FGL (MHtFGL), which frequently arises in practice when organizations employ graph neural networks (GNNs) of different scales and architectures.Such architectural diversity not only undermines smooth server-side aggregation, which presupposes a unified representation space shared across clients' updates, but also further complicates the transfer and integration of structural knowledge across clients. To address this issue, we propose the Federated Graph Knowledge Collaboration (FedGKC) framework. FedGKC introduces a lightweight Copilot Model on each client to facilitate knowledge exchange while local architectures are heterogeneous across clients, and employs two complementary mechanisms: Client-side Self-Mutual Knowledge Distillation, which transfers effective knowledge between local and copilot models through bidirectional distillation with multi-view perturbation; and Server-side Knowledge-Aware Model Aggregation, which dynamically assigns aggregation weights based on knowledge provided by clients. Extensive experiments on eight benchmark datasets demonstrate that FedGKC achieves an average accuracy gain of 3.88% over baselines in MHtFGL scenarios, while maintaining excellent performance in homogeneous settings.