Adaptive Data Exploitation in Deep Reinforcement Learning

作者: Mingqi Yuan, Bo Li, Xin Jin, Wenjun Zeng

分类: cs.LG, cs.AI

发布日期: 2025-01-22

备注: 40 pages, 37 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出ADEPT框架,通过自适应数据利用提升深度强化学习的数据效率和泛化性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 数据效率 泛化能力 多臂老虎机 自适应学习

📋 核心要点

- 深度强化学习通常需要大量数据,而现有方法在数据利用率和泛化性方面存在不足。

- ADEPT框架的核心思想是利用多臂老虎机算法,自适应地选择和利用不同阶段的训练数据,平衡探索与利用。

- 实验表明,ADEPT在多个基准测试中显著提升了性能,同时降低了计算成本,提高了数据效率。

📝 摘要(中文)

本文提出了一种名为ADEPT(Adaptive Data Exploitation)的框架,旨在提升深度强化学习(RL)中的数据效率和泛化能力。ADEPT通过多臂老虎机(MAB)算法自适应地管理不同学习阶段中采样数据的使用,从而优化数据利用率并减轻过拟合。此外,ADEPT还能显著降低计算开销,加速各种RL算法。我们在Procgen、MiniGrid和PyBullet等基准测试中验证了ADEPT的有效性。广泛的仿真结果表明,ADEPT能够以卓越的计算效率实现优越的性能,为数据高效的RL提供了一种实用的解决方案。代码已开源。

🔬 方法详解

问题定义:深度强化学习算法通常需要大量的训练数据才能达到良好的性能,这限制了它们在实际应用中的部署。现有的数据增强和重用方法往往难以在探索和利用之间取得平衡,容易导致过拟合或欠拟合,并且计算开销较大。因此,如何高效地利用有限的数据,提升强化学习算法的泛化能力和数据效率是一个关键问题。

核心思路:ADEPT的核心思路是根据学习阶段的不同,自适应地调整数据的使用策略。它将不同的数据采样方式或数据增强方法视为不同的“臂”,利用多臂老虎机(MAB)算法来动态地选择最佳的“臂”,从而最大化奖励(例如,性能提升)。这种方法能够在探索(尝试不同的数据利用方式)和利用(选择最佳的数据利用方式)之间取得平衡,避免过拟合,并提高数据利用率。

技术框架:ADEPT框架主要包含以下几个模块:1) 数据池:存储采样得到的数据。2) 多臂老虎机(MAB)控制器:根据当前的学习状态,选择最佳的数据利用策略(例如,选择特定的数据增强方法或数据子集)。3) 强化学习算法:使用选定的数据进行训练,并根据训练结果更新MAB控制器的奖励。4) 奖励函数:用于评估不同数据利用策略的效果,并反馈给MAB控制器。整个流程是一个循环迭代的过程,MAB控制器不断学习和优化数据利用策略,从而提升强化学习算法的性能。

关键创新:ADEPT的关键创新在于其自适应的数据利用策略。与传统的固定数据利用方法不同,ADEPT能够根据学习阶段的不同,动态地调整数据的使用方式,从而更好地适应不同的学习需求。这种自适应性使得ADEPT能够更有效地利用有限的数据,并提高算法的泛化能力。此外,ADEPT框架的通用性使其可以与各种不同的强化学习算法相结合。

关键设计:ADEPT的关键设计包括:1) MAB算法的选择:可以使用各种不同的MAB算法,例如UCB、Thompson Sampling等。2) 奖励函数的定义:奖励函数需要能够准确地反映不同数据利用策略的效果。可以使用性能指标(例如,平均奖励、成功率等)作为奖励。3) 数据池的管理:需要合理地管理数据池的大小和更新策略,以避免存储过多的冗余数据。4) 超参数的调整:需要根据具体的任务和数据集,调整MAB算法的超参数,以获得最佳的性能。

🖼️ 关键图片

📊 实验亮点

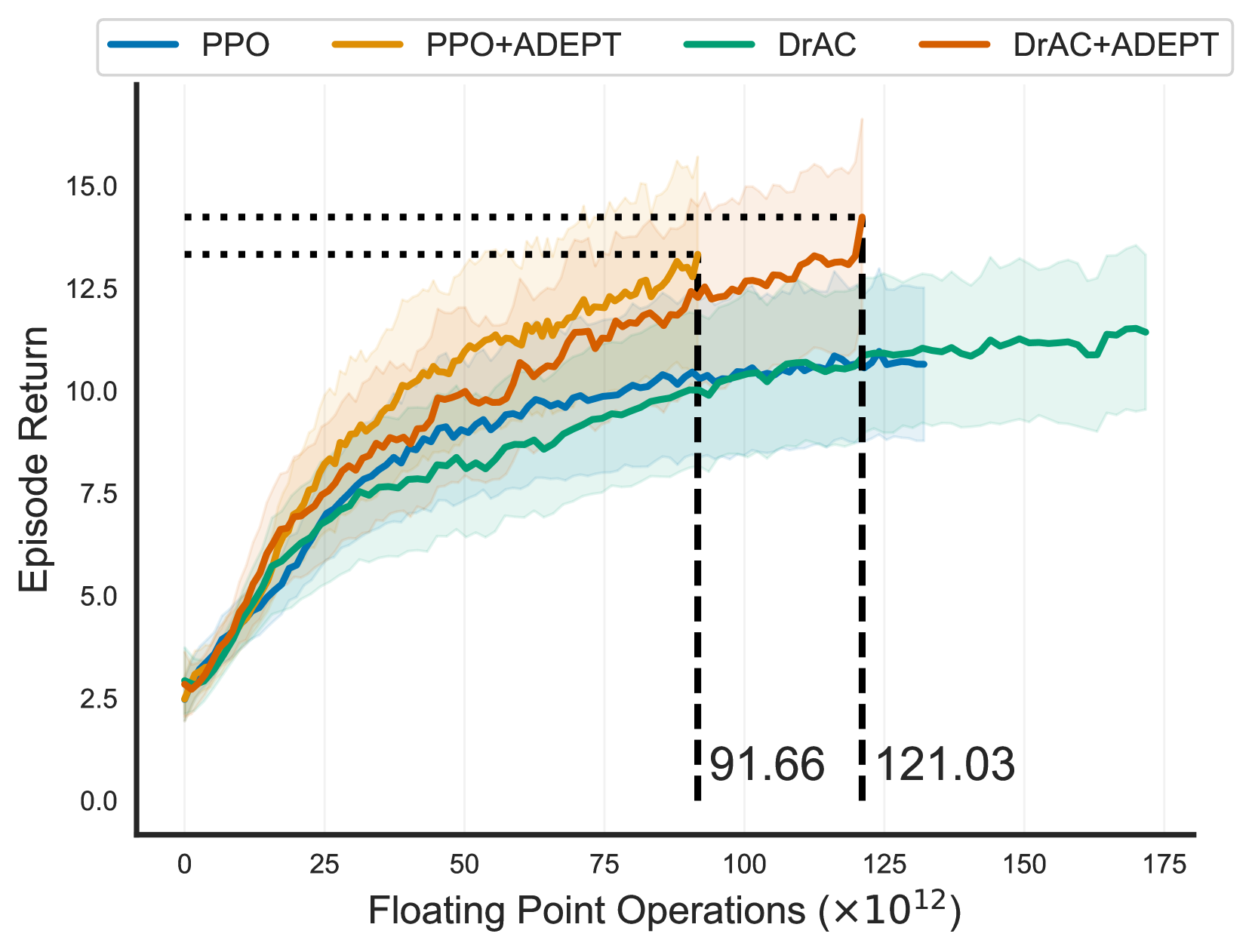

实验结果表明,ADEPT在Procgen、MiniGrid和PyBullet等多个基准测试中显著提升了强化学习算法的性能。例如,在Procgen基准测试中,ADEPT能够以更少的数据达到与现有算法相当甚至更好的性能。此外,ADEPT还能够显著降低计算开销,加速训练过程。与基线方法相比,ADEPT在某些任务中能够将训练时间缩短50%以上。

🎯 应用场景

ADEPT框架具有广泛的应用前景,可以应用于机器人控制、游戏AI、自动驾驶等领域。通过提高数据效率和泛化能力,ADEPT可以降低训练成本,加速算法的部署,并提高算法在复杂环境中的鲁棒性。此外,ADEPT还可以应用于其他机器学习领域,例如监督学习和半监督学习,以提高数据利用率和模型性能。

📄 摘要(原文)

We introduce ADEPT: Adaptive Data ExPloiTation, a simple yet powerful framework to enhance the data efficiency and generalization in deep reinforcement learning (RL). Specifically, ADEPT adaptively manages the use of sampled data across different learning stages via multi-armed bandit (MAB) algorithms, optimizing data utilization while mitigating overfitting. Moreover, ADEPT can significantly reduce the computational overhead and accelerate a wide range of RL algorithms. We test ADEPT on benchmarks including Procgen, MiniGrid, and PyBullet. Extensive simulation demonstrates that ADEPT can achieve superior performance with remarkable computational efficiency, offering a practical solution to data-efficient RL. Our code is available at https://github.com/yuanmingqi/ADEPT.