Compositional Instruction Following with Language Models and Reinforcement Learning

作者: Vanya Cohen, Geraud Nangue Tasse, Nakul Gopalan, Steven James, Matthew Gombolay, Ray Mooney, Benjamin Rosman

分类: cs.LG, cs.CL

发布日期: 2025-01-21

备注: TMLR 2024

💡 一句话要点

提出CERLLA,利用组合策略表示和强化学习语义解析器,提升语言模型在组合指令跟随任务中的泛化能力。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 强化学习 语言模型 组合泛化 语义解析 指令跟随

📋 核心要点

- 现有方法在处理语言指令跟随任务时,样本复杂度高,难以泛化到新的组合任务。

- CERLLA利用组合策略表示和强化学习训练的语义解析器,降低样本复杂度,提升泛化能力。

- 实验表明,CERLLA在组合泛化任务上显著优于非组合基线,成功率接近oracle策略的上限。

📝 摘要(中文)

将强化学习与语言理解相结合极具挑战性,因为智能体需要在探索环境的同时学习多个语言条件任务。为了解决这个问题,我们提出了一种新方法:组合式强化学习语言智能体(CERLLA)。我们的方法通过利用组合策略表示和使用强化学习与上下文学习训练的语义解析器,降低了语言指定任务的样本复杂度。我们在需要函数逼近的环境中评估了我们的方法,并展示了对新任务的组合泛化能力。在旨在测试组合泛化的162个任务中,我们的方法在样本复杂度方面显著优于之前最好的非组合基线。我们的模型获得了更高的成功率,并且比非组合基线在更少的步骤中学习。它达到了与oracle策略的上限性能相等的92%的成功率。在相同数量的环境步骤下,基线仅达到80%的成功率。

🔬 方法详解

问题定义:论文旨在解决语言模型在组合指令跟随任务中样本复杂度高和泛化能力差的问题。现有的非组合方法需要大量的训练样本才能学习复杂的语言指令,并且难以泛化到新的、由已知指令组合而成的任务。这限制了它们在实际应用中的可行性。

核心思路:论文的核心思路是利用组合性。具体来说,将复杂的语言指令分解为更小的、可重用的语义单元,并学习这些单元的组合方式。通过这种方式,模型可以利用已有的知识来快速学习新的组合任务,从而降低样本复杂度并提高泛化能力。

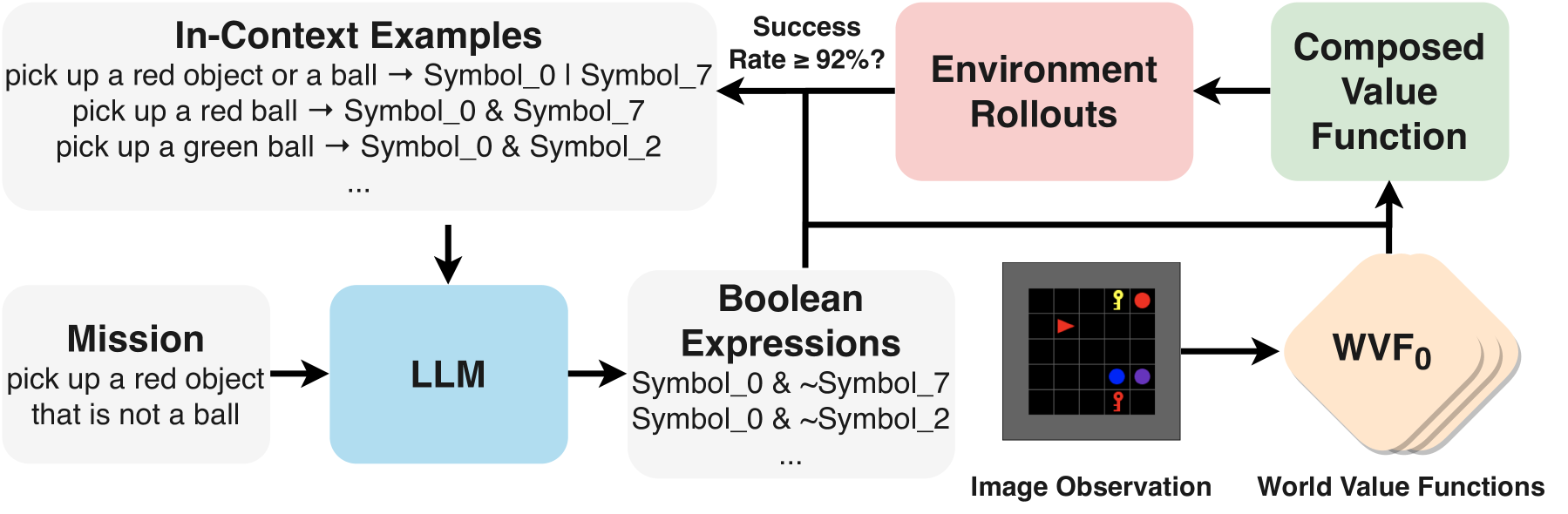

技术框架:CERLLA的整体框架包含两个主要模块:组合策略表示和语义解析器。组合策略表示用于表示任务的组合结构,语义解析器用于将自然语言指令解析为组合策略表示。语义解析器使用强化学习和上下文学习进行训练,以提高其准确性和效率。整个训练过程是端到端的,智能体通过与环境交互来学习策略和解析器。

关键创新:该论文的关键创新在于将组合策略表示与强化学习相结合,并使用上下文学习来提高语义解析器的性能。与传统的非组合方法相比,CERLLA能够更好地利用语言指令的结构信息,从而实现更高效的学习和更好的泛化能力。

关键设计:语义解析器使用Transformer架构,并采用强化学习进行训练,奖励函数基于任务的成功率。上下文学习用于提供少量的示例,以帮助解析器更好地理解语言指令。组合策略表示使用函数逼近器来实现,例如神经网络。策略梯度方法用于优化策略。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CERLLA在162个组合泛化任务上显著优于非组合基线,成功率从80%提升到92%,接近oracle策略的上限。这意味着CERLLA能够更有效地学习和泛化到新的组合任务,从而降低了样本复杂度。

🎯 应用场景

该研究成果可应用于机器人控制、游戏AI、自然语言交互等领域。例如,可以训练机器人根据复杂的语言指令完成各种任务,或者开发能够理解和执行用户指令的智能助手。该方法在需要处理大量组合指令的场景下具有很大的应用潜力。

📄 摘要(原文)

Combining reinforcement learning with language grounding is challenging as the agent needs to explore the environment while simultaneously learning multiple language-conditioned tasks. To address this, we introduce a novel method: the compositionally-enabled reinforcement learning language agent (CERLLA). Our method reduces the sample complexity of tasks specified with language by leveraging compositional policy representations and a semantic parser trained using reinforcement learning and in-context learning. We evaluate our approach in an environment requiring function approximation and demonstrate compositional generalization to novel tasks. Our method significantly outperforms the previous best non-compositional baseline in terms of sample complexity on 162 tasks designed to test compositional generalization. Our model attains a higher success rate and learns in fewer steps than the non-compositional baseline. It reaches a success rate equal to an oracle policy's upper-bound performance of 92%. With the same number of environment steps, the baseline only reaches a success rate of 80%.