Conditional Feature Importance with Generative Modeling Using Adversarial Random Forests

作者: Kristin Blesch, Niklas Koenen, Jan Kapar, Pegah Golchian, Lukas Burk, Markus Loecher, Marvin N. Wright

分类: stat.ML, cs.LG

发布日期: 2025-01-19

💡 一句话要点

提出cARFi,利用对抗随机森林生成模型进行条件特征重要性评估。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 条件特征重要性 可解释人工智能 生成模型 对抗随机森林 表格数据

📋 核心要点

- 现有模型无关的特征重要性评估方法难以生成符合条件特征分布的特征值,影响评估准确性。

- 论文提出cARFi方法,利用对抗随机森林(ARF)学习条件分布,并从中采样生成特征值。

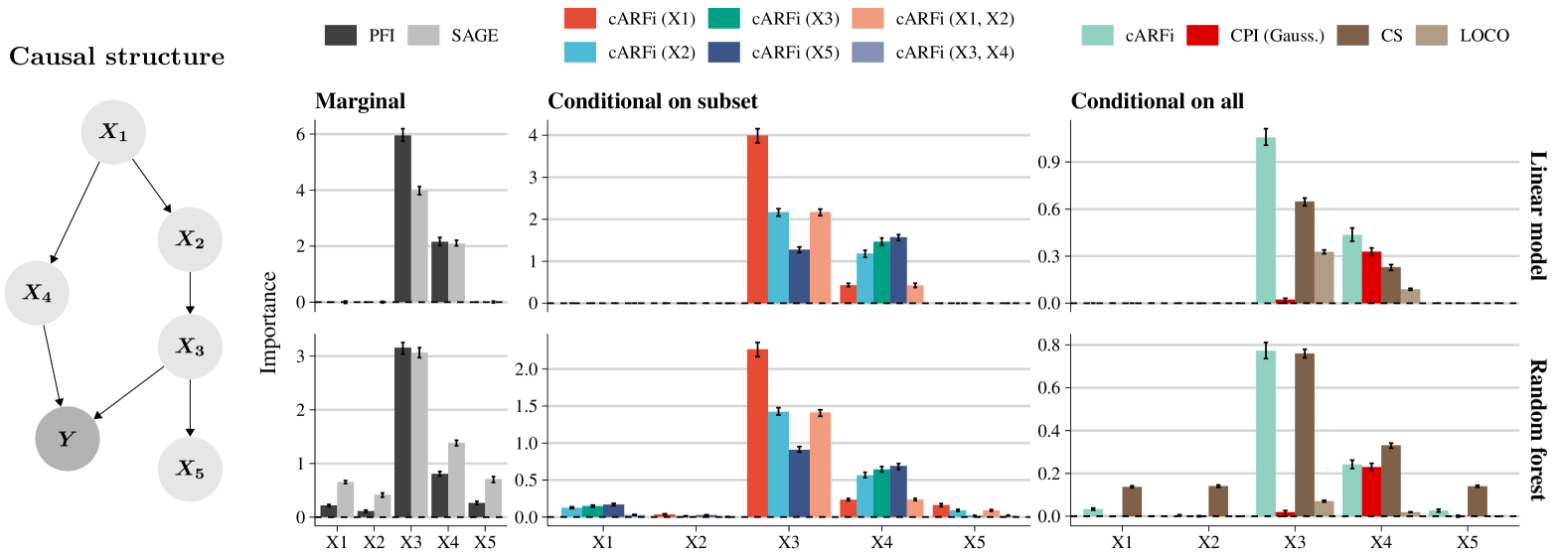

- cARFi只需少量调整即可获得稳健的特征重要性评分,并能灵活适应条件或边缘特征重要性评估。

📝 摘要(中文)

本文提出了一种通过生成模型测量条件特征重要性的方法。在可解释人工智能(XAI)中,条件特征重要性评估了在已知其他特征信息的情况下,某个特征对预测模型性能的影响。现有的模型无关事后方法通常评估在流形上的特征值操作下预测性能的变化。这些过程需要创建尊重条件特征分布的特征值,这在实践中可能具有挑战性。生成建模的最新进展可以促进这一点。对于可能包含分类和连续特征的表格数据,对抗随机森林(ARF)作为一种生成模型脱颖而出,它可以生成流形上的数据点,而无需大量的调整工作或计算资源,使其成为XAI方法中子程序的有希望的候选模型。本文提出了cARFi(条件ARF特征重要性),一种通过从ARF估计的条件分布中采样的特征值来测量条件特征重要性的方法。cARFi只需要很少的调整即可产生稳健的重要性分数,这些分数可以灵活地适应条件或边缘特征重要性的概念,包括直接扩展到以特征子集为条件,并允许通过统计测试推断特征重要性的显著性。

🔬 方法详解

问题定义:论文旨在解决条件特征重要性评估的问题。现有模型无关的事后方法在进行特征值操作时,难以生成符合条件特征分布的样本,导致评估结果不准确。尤其是在表格数据中,同时包含连续和离散特征时,这个问题更加突出。

核心思路:论文的核心思路是利用生成模型学习特征之间的条件分布,然后从该分布中采样生成新的特征值,用于评估特征重要性。通过这种方式,可以确保生成的特征值是“on-manifold”的,即符合数据的内在结构,从而提高评估的准确性。

技术框架:cARFi方法主要包含以下几个步骤:1. 使用对抗随机森林(ARF)作为生成模型,学习表格数据的联合分布。2. 根据需要评估的条件特征,从ARF模型中采样生成相应的特征值。3. 将生成的特征值输入到预测模型中,观察预测性能的变化。4. 根据预测性能的变化,计算条件特征重要性得分。5. 使用统计检验评估特征重要性得分的显著性。

关键创新:论文的关键创新在于将对抗随机森林(ARF)应用于条件特征重要性评估。ARF是一种适用于表格数据的生成模型,能够有效地学习混合类型(连续和离散)特征的联合分布,并且训练过程相对简单,计算资源需求较低。这使得cARFi方法在实际应用中更具可行性。

关键设计:cARFi方法的关键设计包括:1. 使用ARF作为生成模型,避免了传统生成模型(如GAN)训练困难的问题。2. 允许灵活地指定条件特征,可以评估单个特征或特征子集的重要性。3. 提供了统计检验方法,用于评估特征重要性得分的显著性,避免了过度解读。4. 只需要少量调整即可获得稳健的特征重要性评分。

🖼️ 关键图片

📊 实验亮点

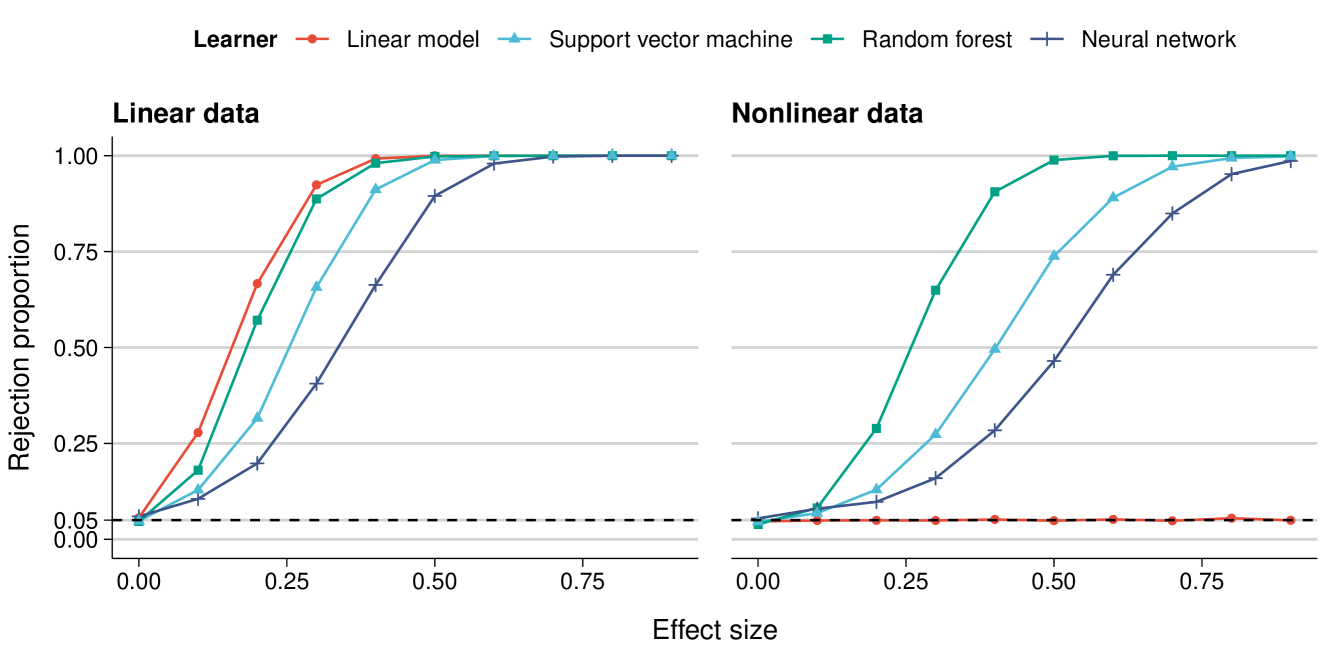

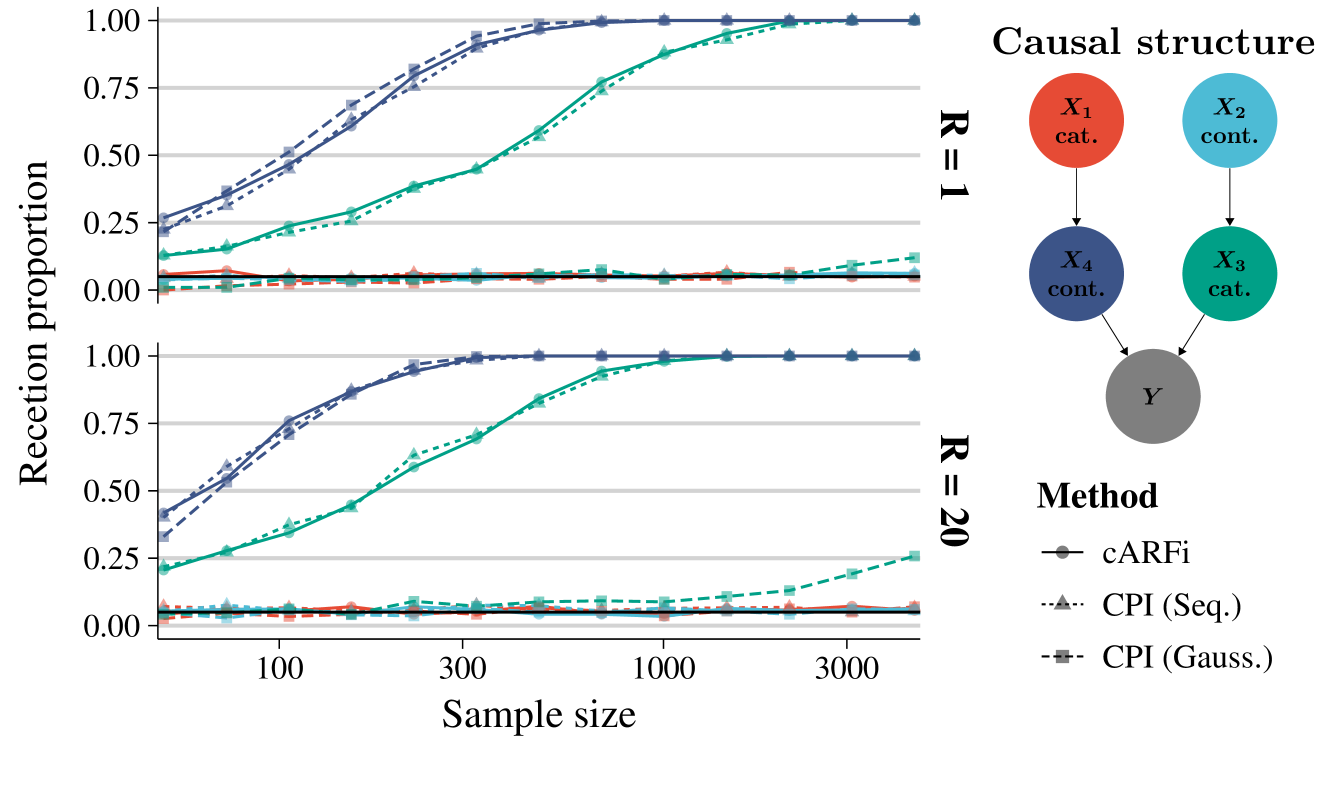

论文提出的cARFi方法能够生成符合条件特征分布的样本,从而更准确地评估特征重要性。实验结果表明,cARFi方法在各种表格数据集上均能获得稳健的特征重要性评分,并且计算效率较高,具有良好的应用前景。

🎯 应用场景

该研究成果可应用于各种需要理解特征之间相互作用的领域,例如金融风控、医疗诊断、推荐系统等。通过识别关键的条件特征,可以更好地理解模型的决策过程,提高模型的可解释性和可靠性,并为业务决策提供更有效的支持。

📄 摘要(原文)

This paper proposes a method for measuring conditional feature importance via generative modeling. In explainable artificial intelligence (XAI), conditional feature importance assesses the impact of a feature on a prediction model's performance given the information of other features. Model-agnostic post hoc methods to do so typically evaluate changes in the predictive performance under on-manifold feature value manipulations. Such procedures require creating feature values that respect conditional feature distributions, which can be challenging in practice. Recent advancements in generative modeling can facilitate this. For tabular data, which may consist of both categorical and continuous features, the adversarial random forest (ARF) stands out as a generative model that can generate on-manifold data points without requiring intensive tuning efforts or computational resources, making it a promising candidate model for subroutines in XAI methods. This paper proposes cARFi (conditional ARF feature importance), a method for measuring conditional feature importance through feature values sampled from ARF-estimated conditional distributions. cARFi requires only little tuning to yield robust importance scores that can flexibly adapt for conditional or marginal notions of feature importance, including straightforward extensions to condition on feature subsets and allows for inferring the significance of feature importances through statistical tests.