Blockchain-assisted Demonstration Cloning for Multi-Agent Deep Reinforcement Learning

作者: Ahmed Alagha, Jamal Bentahar, Hadi Otrok, Shakti Singh, Rabeb Mizouni

分类: cs.LG, cs.AI

发布日期: 2025-01-19

DOI: 10.1109/JIOT.2023.3316078

💡 一句话要点

提出区块链辅助的多专家示教克隆框架,提升多智能体深度强化学习效率与鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 区块链 示教克隆 联邦强化学习 智能合约 IPFS 模型共享 联盟链

📋 核心要点

- MDRL面临样本效率低、维度灾难和环境探索困难等挑战,现有联邦强化学习方法存在模型限制和恶意攻击问题,奖励塑造则需要大量工程设计且易陷入局部最优。

- 论文提出基于区块链的多专家示教克隆框架,利用专家示教引导智能体探索,并通过区块链实现模型安全共享与分配,提升学习效率和鲁棒性。

- 实验结果表明,该框架在学习速度和对恶意模型的抵抗能力上优于联邦强化学习、奖励塑造和模仿学习辅助强化学习等现有方法。

📝 摘要(中文)

本文提出了一种新颖的区块链辅助多专家示教克隆(MEDC)框架,用于多智能体深度强化学习(MDRL)。该方法利用专家示教来指导新MDRL智能体的学习,通过建议环境中的探索动作。设计了一个基于区块链的模型共享框架,允许用户共享其训练好的模型,这些模型可以作为专家模型分配给请求用户,以辅助训练MDRL系统。采用联盟区块链来实现可追踪和自主执行,无需单一可信实体。智能合约用于管理用户和模型分配,模型通过IPFS共享。该框架在多个应用中进行了测试,并与联邦强化学习(FRL)、奖励塑造和模仿学习辅助强化学习等现有方法进行了基准测试。结果表明,所提出的框架在学习速度以及对错误和恶意模型的弹性方面优于现有方法。

🔬 方法详解

问题定义:多智能体深度强化学习(MDRL)在复杂环境中面临样本效率低、维度灾难和环境探索困难等问题。现有的联邦强化学习方法存在模型限制和易受恶意攻击的缺点,而奖励塑造方法需要大量人工干预,且容易陷入局部最优解。因此,如何高效、安全地利用专家知识来指导MDRL智能体的学习是一个关键问题。

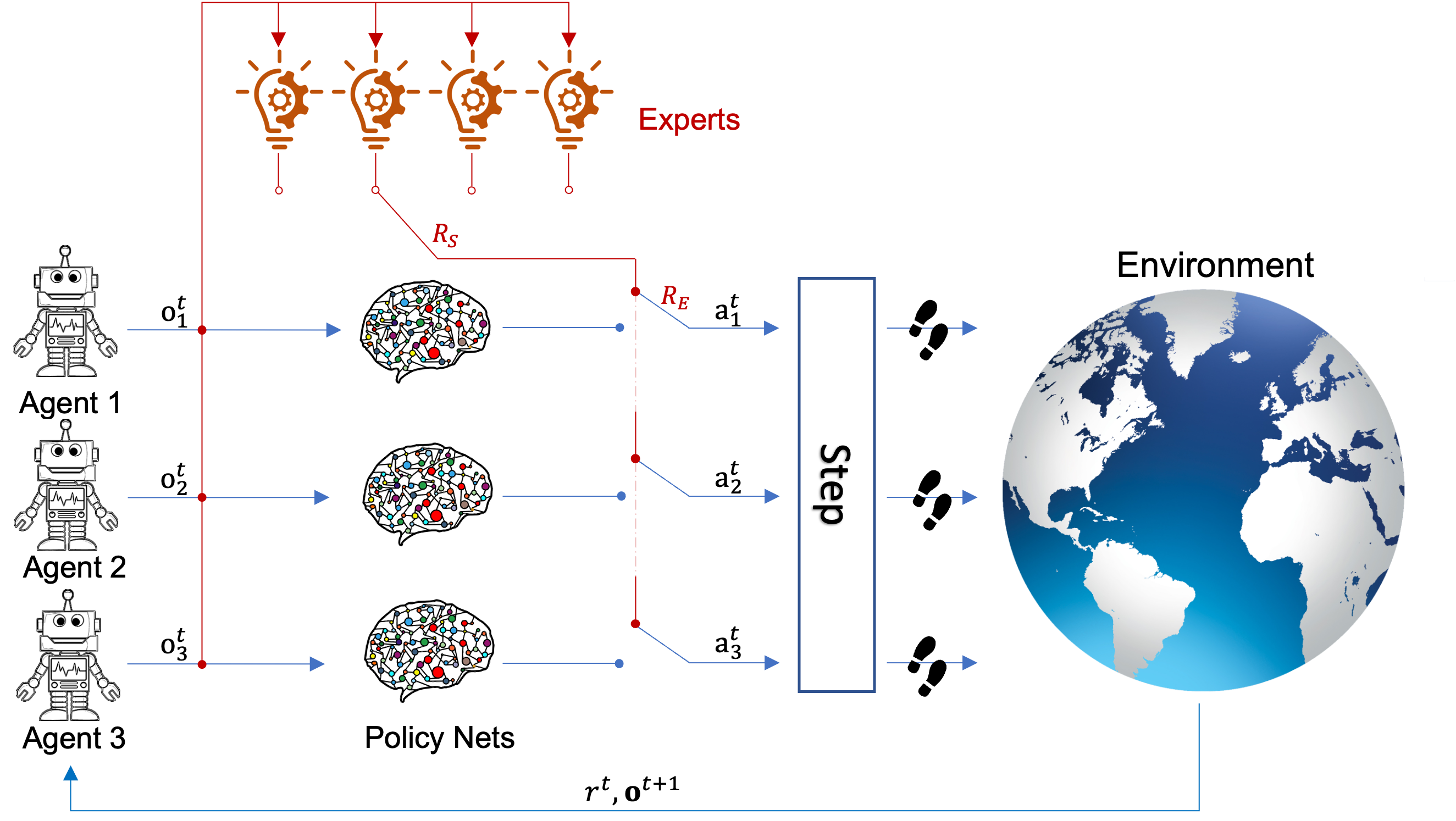

核心思路:论文的核心思路是利用专家示教来指导新智能体的学习,并通过区块链技术实现模型的可信共享和安全分配。通过专家示教,新智能体可以更快地探索环境,避免盲目探索。区块链技术则保证了模型来源的可追溯性,并能有效防止恶意模型的干扰,从而提高学习的鲁棒性。

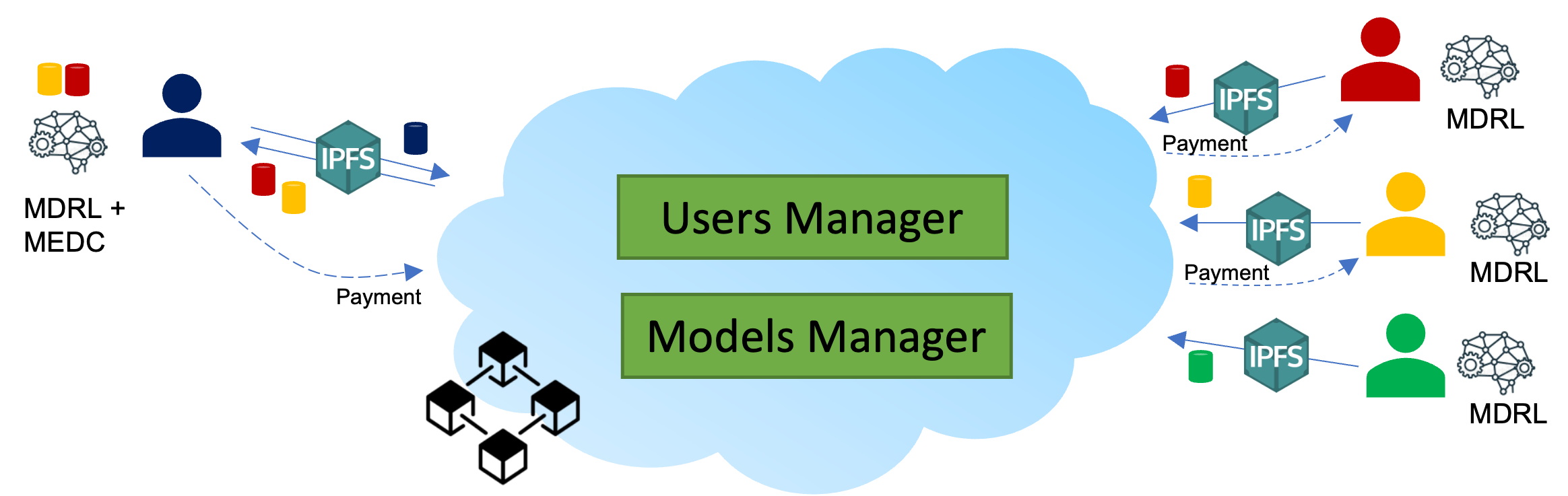

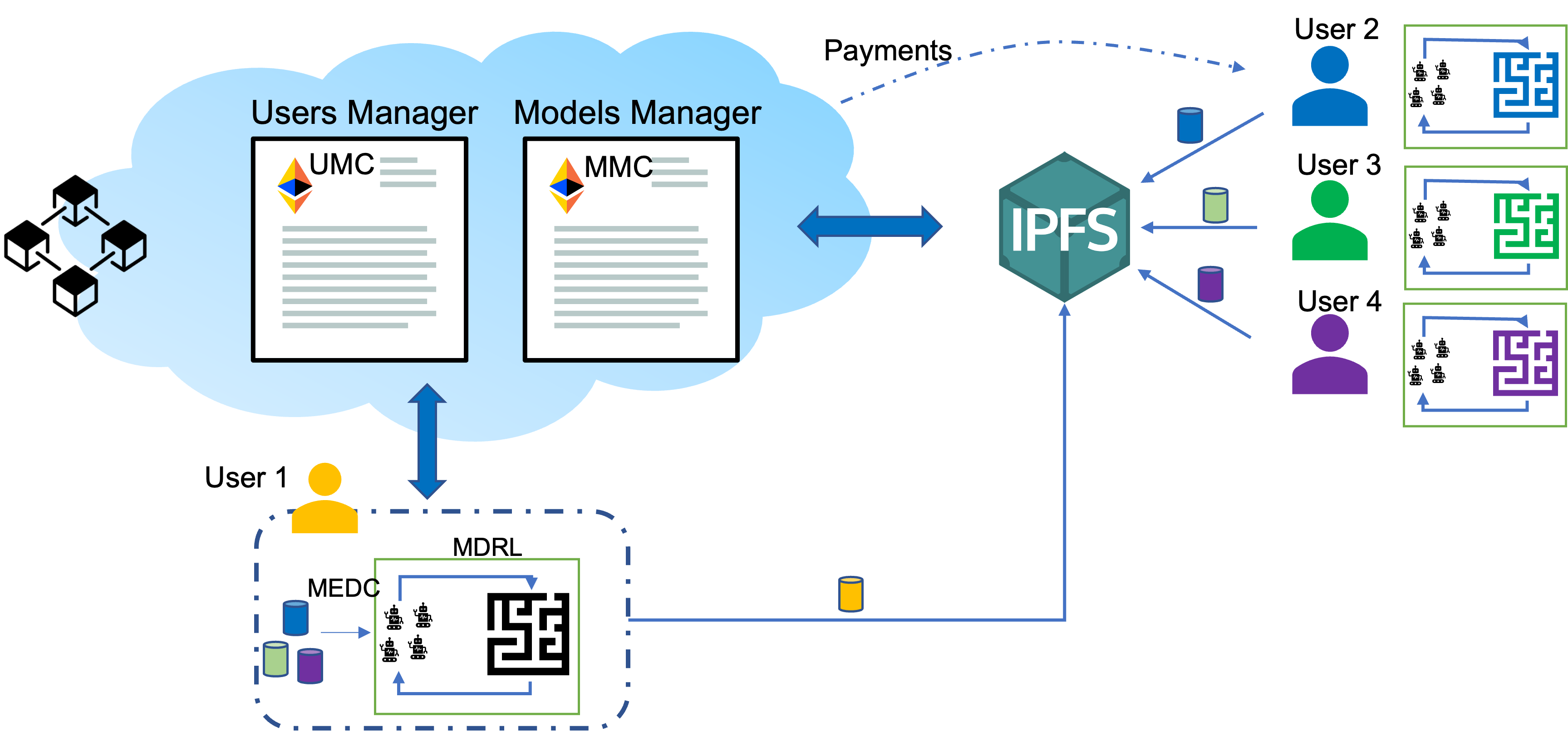

技术框架:该框架主要包含以下几个模块:1) 模型训练模块:用户训练自己的MDRL模型。2) 模型共享模块:用户将训练好的模型上传到基于IPFS的存储系统,并将模型信息(如模型哈希值、贡献度等)记录到联盟区块链上。3) 模型分配模块:需要训练MDRL系统的用户向区块链发起请求,智能合约根据用户的需求和模型的贡献度,自动分配合适的专家模型。4) 示教克隆模块:新智能体利用分配到的专家模型提供的示教动作来指导自身的探索过程。

关键创新:该方法最重要的创新点在于将区块链技术与多专家示教克隆相结合,构建了一个安全、可信的模型共享和分配平台。与传统的联邦强化学习方法相比,该方法不需要对模型进行聚合,避免了模型同质化的问题。同时,区块链技术保证了模型来源的可追溯性,有效防止了恶意模型的干扰。

关键设计:该框架采用联盟区块链,由多个参与者共同维护,保证了数据的安全性和可靠性。智能合约用于管理用户和模型的分配,实现了自动化和透明化。模型共享采用IPFS分布式存储,降低了存储成本和单点故障的风险。示教克隆模块的具体实现方式未知,但推测可能采用了行为克隆或Dagger等模仿学习算法。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的区块链辅助多专家示教克隆框架在学习速度和对恶意模型的抵抗能力上优于现有的联邦强化学习、奖励塑造和模仿学习辅助强化学习等方法。具体的性能数据和提升幅度未知,但摘要中明确指出该框架具有显著的优势。

🎯 应用场景

该研究成果可应用于各种需要多智能体协作的复杂环境,例如自动驾驶、机器人协同、智能交通管理、资源调度等。通过利用专家知识和区块链技术,可以显著提高MDRL系统的学习效率和鲁棒性,降低开发成本,加速MDRL技术的实际应用。

📄 摘要(原文)

Multi-Agent Deep Reinforcement Learning (MDRL) is a promising research area in which agents learn complex behaviors in cooperative or competitive environments. However, MDRL comes with several challenges that hinder its usability, including sample efficiency, curse of dimensionality, and environment exploration. Recent works proposing Federated Reinforcement Learning (FRL) to tackle these issues suffer from problems related to model restrictions and maliciousness. Other proposals using reward shaping require considerable engineering and could lead to local optima. In this paper, we propose a novel Blockchain-assisted Multi-Expert Demonstration Cloning (MEDC) framework for MDRL. The proposed method utilizes expert demonstrations in guiding the learning of new MDRL agents, by suggesting exploration actions in the environment. A model sharing framework on Blockchain is designed to allow users to share their trained models, which can be allocated as expert models to requesting users to aid in training MDRL systems. A Consortium Blockchain is adopted to enable traceable and autonomous execution without the need for a single trusted entity. Smart Contracts are designed to manage users and models allocation, which are shared using IPFS. The proposed framework is tested on several applications, and is benchmarked against existing methods in FRL, Reward Shaping, and Imitation Learning-assisted RL. The results show the outperformance of the proposed framework in terms of learning speed and resiliency to faulty and malicious models.