Adaptive Target Localization under Uncertainty using Multi-Agent Deep Reinforcement Learning with Knowledge Transfer

作者: Ahmed Alagha, Rabeb Mizouni, Shakti Singh, Jamal Bentahar, Hadi Otrok

分类: cs.LG, cs.AI, cs.RO

发布日期: 2025-01-19

DOI: 10.1016/j.iot.2024.101447

💡 一句话要点

提出基于知识迁移的多智能体深度强化学习方法,解决不确定环境下目标定位问题。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 目标定位 不确定性 迁移学习 近端策略优化 Actor-Critic网络 放射性目标定位

📋 核心要点

- 现有MADRL目标定位方法未考虑实际应用中常见的不确定性因素,如误报和目标不可达。

- 提出一种基于MADRL和迁移学习的框架,优化智能体决策,并利用知识迁移估计不可达目标位置。

- 实验表明,该方法在放射性目标定位环境中表现出优越的性能,验证了其有效性。

📝 摘要(中文)

本文提出了一种新的基于多智能体深度强化学习(MADRL)的目标定位方法,用于解决不确定环境下的目标定位问题。现有方法忽略了实际应用中的不确定性,例如目标不存在时的误报或因环境复杂性导致目标不可达。该方法采用近端策略优化(PPO)算法优化智能体的决策,决策过程通过卷积神经网络构建的Actor-Critic结构表示。智能体的观测经过优化设计,以捕捉环境中的关键信息,并设计了基于团队的奖励函数以促进智能体之间的合作。该MADRL方法涵盖了控制智能体移动以搜索目标、检测其存在性和确定其可达性的三个动作维度。利用迁移学习的思想,深度学习模型基于MADRL模型的知识,准确估计不可达目标的位置,从而在模型之间实现表征共享,加快学习速度并降低计算复杂度。最终模型能够搜索目标、确定其存在性和可达性,并准确估计其位置。该方法在放射性目标定位环境中进行了测试,并与现有方法进行了比较,验证了其有效性。

🔬 方法详解

问题定义:现有基于多智能体深度强化学习(MADRL)的目标定位方法,在实际应用中面临着不确定性的挑战。具体来说,包括两种情况:一是目标可能不存在,导致传感器产生误报;二是由于环境的复杂性,目标可能无法到达。这些不确定性降低了定位的准确性和可靠性。

核心思路:本文的核心思路是结合MADRL和迁移学习,构建一个能够适应不确定环境的目标定位系统。首先,利用MADRL训练智能体学会搜索、检测和判断目标的可达性。然后,当目标不可达时,利用迁移学习将MADRL模型学习到的知识迁移到一个深度学习模型中,用于估计目标的位置。

技术框架:整体框架包含两个主要阶段:MADRL训练阶段和迁移学习阶段。在MADRL训练阶段,多个智能体通过近端策略优化(PPO)算法进行训练,每个智能体使用卷积神经网络构建的Actor-Critic结构进行决策。智能体的观测经过优化设计,以捕捉环境中的关键信息。在迁移学习阶段,将MADRL模型学习到的知识迁移到一个深度学习模型中,该模型用于估计不可达目标的位置。

关键创新:该方法的主要创新点在于结合了MADRL和迁移学习,解决了不确定环境下的目标定位问题。通过MADRL,智能体能够学习到搜索、检测和判断目标可达性的策略。通过迁移学习,能够利用MADRL学习到的知识,准确估计不可达目标的位置。这种结合使得系统能够更好地适应不确定环境,提高定位的准确性和可靠性。

关键设计:在MADRL部分,采用了基于团队的奖励函数,鼓励智能体之间的合作。智能体的动作空间包含三个维度:控制智能体的移动,检测目标的存在,以及判断目标的可达性。在迁移学习部分,深度学习模型利用MADRL模型的共享表征,加快学习速度并降低计算复杂度。具体网络结构和参数设置在论文中未详细说明,属于未知信息。

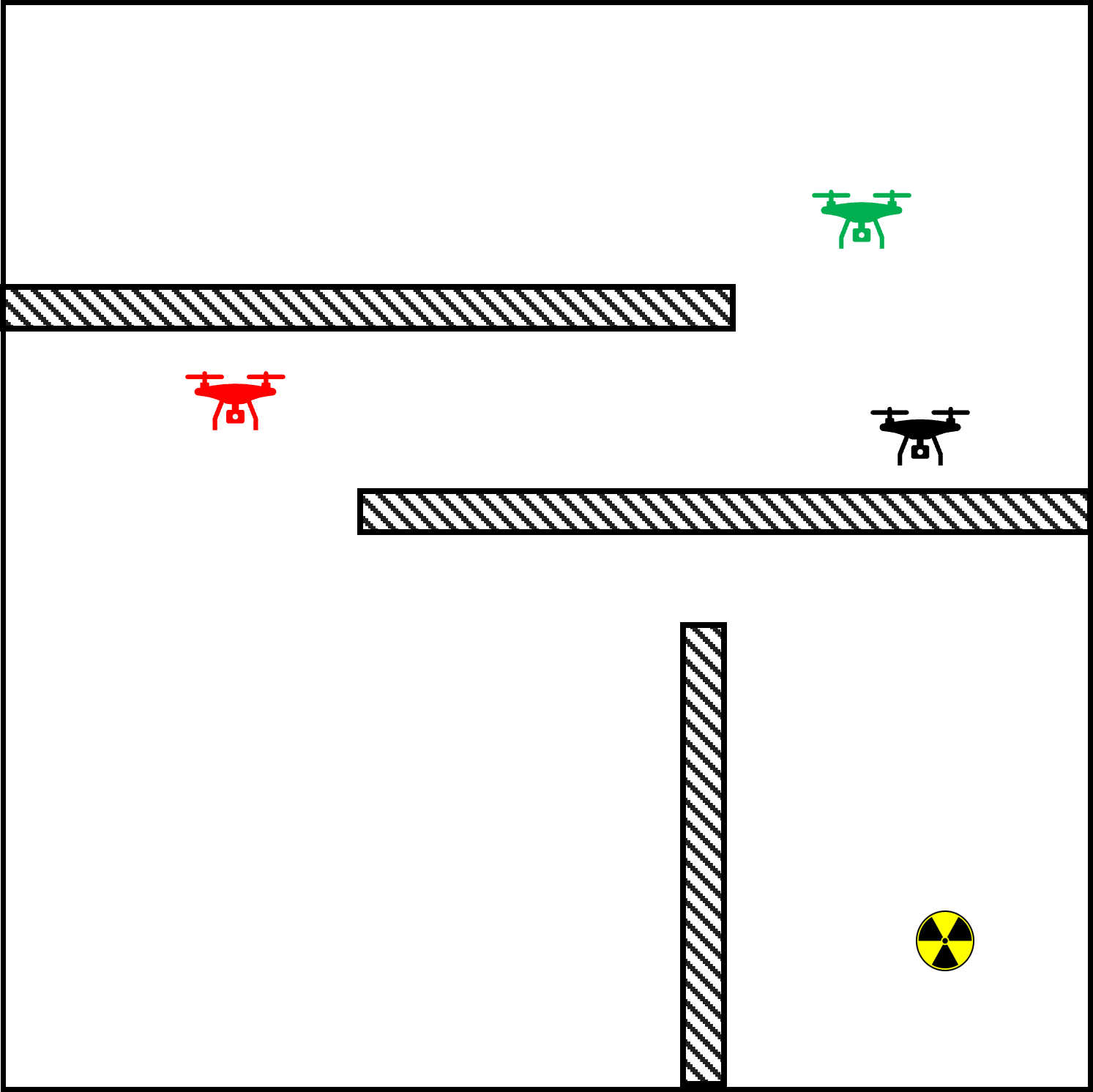

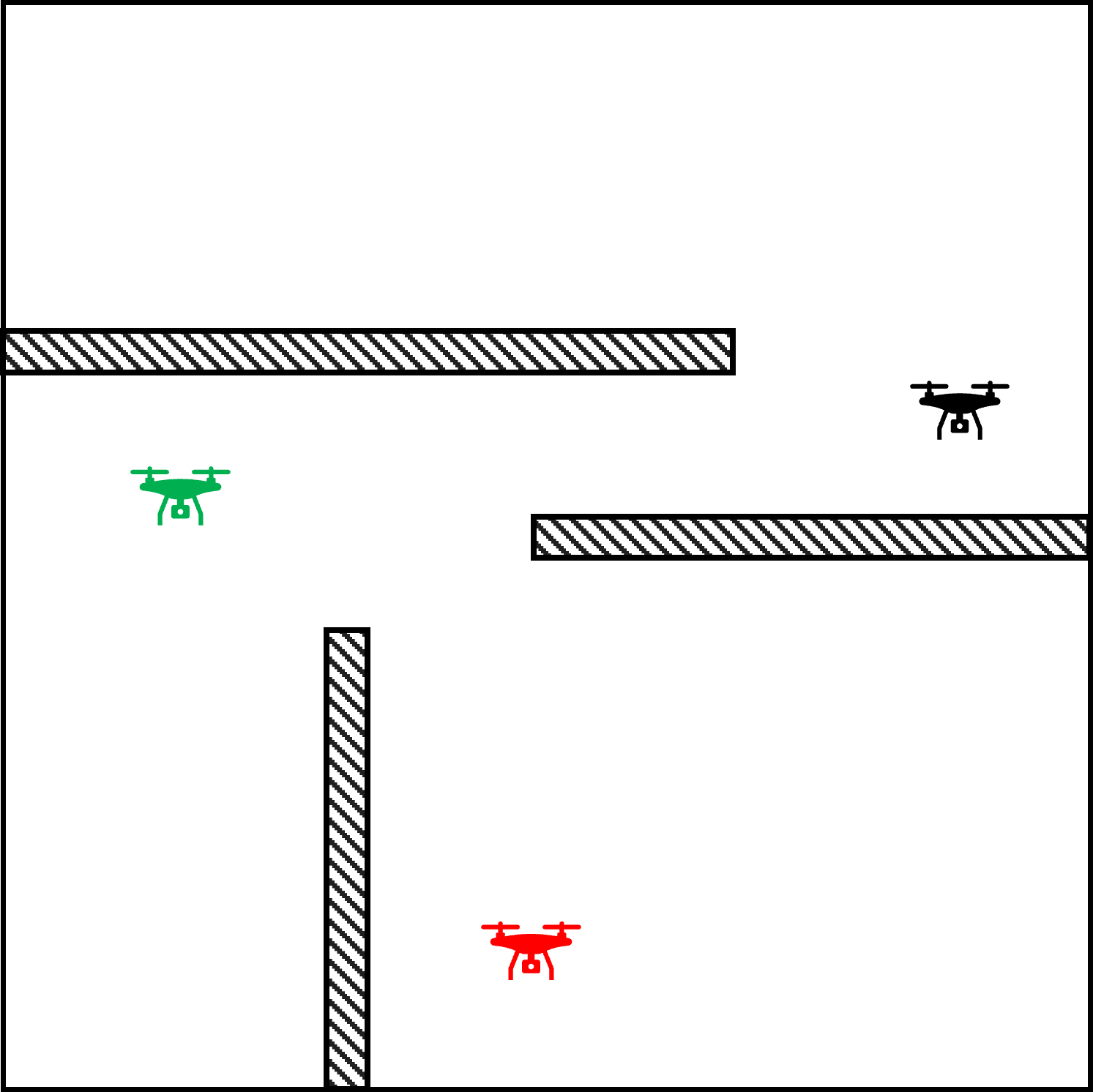

🖼️ 关键图片

📊 实验亮点

论文在放射性目标定位环境中进行了实验,并与现有方法进行了比较。实验结果表明,该方法能够有效地搜索目标、确定其存在性和可达性,并准确估计其位置。具体的性能数据和提升幅度在摘要中未给出,属于未知信息。但结论是该方法优于现有方法,验证了其有效性。

🎯 应用场景

该研究成果可应用于多种需要目标定位的场景,例如:放射性物质泄漏检测、搜救行动、环境监测、以及军事侦察等。通过多智能体的协同合作,能够在复杂和不确定的环境中快速准确地定位目标,具有重要的实际应用价值和潜在的社会效益。未来,该方法可以进一步扩展到其他类型的目标和环境,并与其他传感器技术相结合,提高定位的精度和鲁棒性。

📄 摘要(原文)

Target localization is a critical task in sensitive applications, where multiple sensing agents communicate and collaborate to identify the target location based on sensor readings. Existing approaches investigated the use of Multi-Agent Deep Reinforcement Learning (MADRL) to tackle target localization. Nevertheless, these methods do not consider practical uncertainties, like false alarms when the target does not exist or when it is unreachable due to environmental complexities. To address these drawbacks, this work proposes a novel MADRL-based method for target localization in uncertain environments. The proposed MADRL method employs Proximal Policy Optimization to optimize the decision-making of sensing agents, which is represented in the form of an actor-critic structure using Convolutional Neural Networks. The observations of the agents are designed in an optimized manner to capture essential information in the environment, and a team-based reward functions is proposed to produce cooperative agents. The MADRL method covers three action dimensionalities that control the agents' mobility to search the area for the target, detect its existence, and determine its reachability. Using the concept of Transfer Learning, a Deep Learning model builds on the knowledge from the MADRL model to accurately estimating the target location if it is unreachable, resulting in shared representations between the models for faster learning and lower computational complexity. Collectively, the final combined model is capable of searching for the target, determining its existence and reachability, and estimating its location accurately. The proposed method is tested using a radioactive target localization environment and benchmarked against existing methods, showing its efficacy.