CEReBrO: Compact Encoder for Representations of Brain Oscillations Using Efficient Alternating Attention

作者: Alexandru Dimofte, Glenn Anta Bucagu, Thorir Mar Ingolfsson, Xiaying Wang, Andrea Cossettini, Luca Benini, Yawei Li

分类: cs.LG

发布日期: 2025-01-18 (更新: 2025-10-20)

💡 一句话要点

提出CEReBrO,一种基于高效交替注意力机制的紧凑型脑电信号表征编码器。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 脑电信号 自监督学习 注意力机制 时间序列分析 深度学习

📋 核心要点

- 现有EEG自监督学习方法存在信号建模不足、模型参数量巨大以及依赖私有数据集等问题,阻碍了研究的可重复性。

- 论文提出CEReBrO,一种基于交替注意力机制的紧凑型脑电信号表征编码器,旨在提高模型效率和泛化能力。

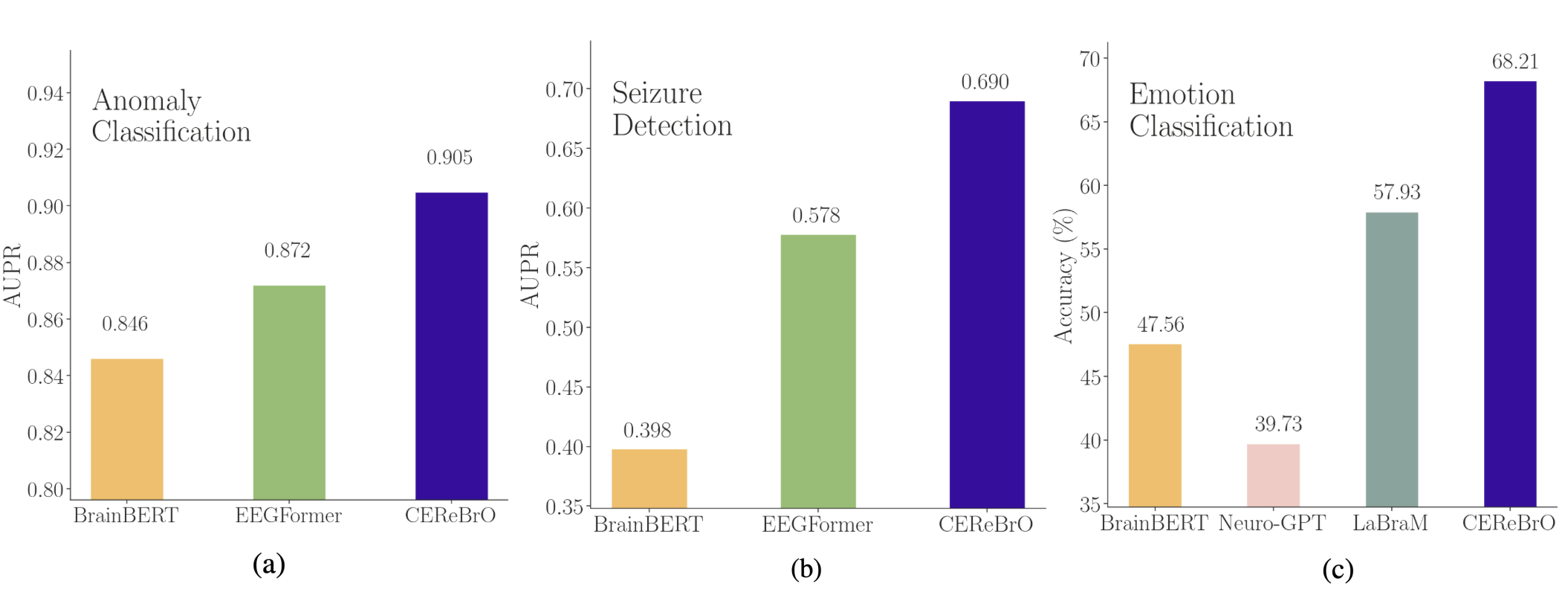

- 实验结果表明,CEReBrO在情绪检测和癫痫发作检测任务中取得了新的基准,并在其他任务中表现出竞争力。

📝 摘要(中文)

脑电图(EEG)是研究大脑活动的关键工具。近年来,利用大型无标签数据集的自监督学习方法已成为解决广泛可用的带注释EEG数据稀缺问题的潜在方案。然而,当前的方法至少存在以下局限性之一:i)次优的EEG信号建模,ii)模型大小达到数亿个可训练参数,以及iii)依赖于私有数据集和/或不一致的公共基准,从而阻碍了可重复性。为了应对这些挑战,我们引入了一种使用交替注意力机制的脑振荡表征紧凑型编码器(CEReBrO),这是一种新的小型EEG基础模型。我们的token化方案以每个通道的patch粒度表示EEG信号。我们提出了一种交替注意力机制,该机制共同建模通道内的时间动态和通道间的空间相关性,与标准自注意力相比,速度提高了2倍,内存需求减少了6倍。我们展示了几种模型大小,范围从360万到8500万个参数。我们的模型在超过20,000小时的具有不同通道配置的公开可用的头皮EEG记录上进行了预训练,在情绪检测和癫痫发作检测任务中设置了新的基准,并在异常分类和步态预测方面具有竞争力的性能。这验证了我们模型的有效性和效率。

🔬 方法详解

问题定义:现有基于自监督学习的脑电信号表征方法通常模型参数量巨大,计算复杂度高,难以部署和应用。此外,许多方法依赖于私有数据集,缺乏可重复性,阻碍了领域内的研究进展。因此,需要一种高效、轻量级且易于复现的脑电信号表征模型。

核心思路:论文的核心思路是设计一种紧凑型的编码器,通过高效的注意力机制同时建模脑电信号的时间动态和空间相关性。通过交替使用通道内的时间注意力和通道间的空间注意力,降低计算复杂度,减少模型参数量,同时保持良好的表征能力。

技术框架:CEReBrO的整体框架包括以下几个主要步骤:1) 数据预处理:对原始脑电信号进行预处理,例如滤波、降噪等。2) Token化:将每个通道的脑电信号分割成小的patch,作为模型的输入token。3) 编码器:使用多层交替注意力模块对token序列进行编码,提取脑电信号的特征表示。4) 下游任务:将编码器提取的特征用于各种下游任务,例如情绪检测、癫痫发作检测等。

关键创新:论文最重要的技术创新点是提出了交替注意力机制。与传统的自注意力机制相比,交替注意力机制分别在通道内和通道间进行注意力计算,从而显著降低了计算复杂度,减少了内存需求。这种设计使得模型能够在保持良好性能的同时,显著减小模型尺寸。

关键设计:CEReBrO的关键设计包括:1) Token化方案:采用基于通道的patch粒度token化,能够有效捕捉每个通道的局部特征。2) 交替注意力模块:交替使用时间注意力和空间注意力,能够同时建模通道内的时间动态和通道间的空间相关性。3) 模型尺寸:论文提供了多种模型尺寸,从360万到8500万参数不等,以适应不同的应用场景和计算资源。

🖼️ 关键图片

📊 实验亮点

CEReBrO在多个公开数据集上进行了评估,并在情绪检测和癫痫发作检测任务中取得了新的基准。与传统的自注意力机制相比,CEReBrO在保持甚至提升性能的同时,速度提高了2倍,内存需求减少了6倍。例如,在情绪检测任务中,CEReBrO的性能优于现有方法,并在癫痫发作检测任务中取得了显著的提升。

🎯 应用场景

CEReBrO在脑电信号分析领域具有广泛的应用前景,例如情绪识别、癫痫预测、睡眠分期、脑机接口等。该模型可以作为预训练的基础模型,通过迁移学习应用于各种下游任务,降低了对标注数据的依赖。其紧凑的模型尺寸也使其更易于部署在移动设备和嵌入式系统中,为实时脑电信号分析提供了可能。

📄 摘要(原文)

Electroencephalograph (EEG) is a crucial tool for studying brain activity. Recently, self-supervised learning methods leveraging large unlabeled datasets have emerged as a potential solution to the scarcity of widely available annotated EEG data. However, current methods suffer from at least one of the following limitations: i) sub-optimal EEG signal modeling, ii) model sizes in the hundreds of millions of trainable parameters, and iii) reliance on private datasets and/or inconsistent public benchmarks, hindering reproducibility. To address these challenges, we introduce a Compact Encoder for Representations of Brain Oscillations using alternating attention (CEReBrO), a new small EEG foundation model. Our tokenization scheme represents EEG signals at a per-channel patch granularity. We propose an alternating attention mechanism that jointly models intra-channel temporal dynamics and inter-channel spatial correlations, achieving 2x speed improvement with 6x less memory required compared to standard self-attention. We present several model sizes ranging from 3.6 million to 85 million parameters. Pre-trained on over 20,000 hours of publicly available scalp EEG recordings with diverse channel configurations, our models set new benchmarks in emotion detection and seizure detection tasks, with competitive performance in anomaly classification and gait prediction. This validates our models' effectiveness and efficiency.