A Tensor Low-Rank Approximation for Value Functions in Multi-Task Reinforcement Learning

作者: Sergio Rozada, Santiago Paternain, Juan Andres Bazerque, Antonio G. Marques

分类: cs.LG

发布日期: 2025-01-17

💡 一句话要点

提出基于张量低秩近似的多任务强化学习值函数优化方法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多任务强化学习 张量低秩近似 Q函数 知识迁移 倒立摆 无线通信

📋 核心要点

- 传统强化学习需要大量数据,多任务学习旨在通过共享知识来缓解数据需求。

- 该论文提出一种基于张量低秩近似的方法,对多任务Q函数进行建模,利用任务间的相似性。

- 实验表明,该方法在倒立摆和无线通信设备等场景中,能够有效地进行多任务学习。

📝 摘要(中文)

为了构建能够在物理环境中训练的强化学习系统,我们研究了多任务方法,以减少对海量数据采集的需求。在表格型场景中,跨任务收集Q函数,并将学习问题建模为优化高阶张量结构。考虑到密切相关的任务可能需要相似的动作,我们提出的方法对聚合的Q张量施加低秩约束。这种多任务学习方法的基本原理是,低秩结构强制执行相似性的概念,而无需明确规定哪些任务是相似的,而是通过减少的数据量同时推断此信息并随机优化Q张量。在两个数值实验中证明了我们的低秩张量方法在多任务学习中的效率,首先是在由一组倒立摆组成的基准环境中,然后在涉及多个无线通信设备的实际场景中。

🔬 方法详解

问题定义:论文旨在解决多任务强化学习中,如何有效利用任务间的相似性,减少每个任务所需数据量的问题。现有方法通常需要手动指定任务间的关系,或者难以处理高维状态空间。

核心思路:论文的核心思路是将多个任务的Q函数组合成一个高阶张量,并假设该张量具有低秩结构。低秩结构意味着任务之间存在共享的潜在信息,可以通过学习低秩张量来提取这些信息,从而实现知识迁移。

技术框架:该方法主要包含以下几个步骤:1. 将每个任务的Q函数表示为一个张量。2. 将所有任务的Q张量组合成一个更大的张量。3. 对该张量进行低秩分解,学习一个低秩的Q张量。4. 使用学习到的低秩Q张量进行策略优化。

关键创新:该方法的主要创新在于使用张量低秩近似来建模多任务强化学习中的Q函数。与传统方法相比,该方法能够自动学习任务间的相似性,无需手动指定。此外,张量分解可以有效地降低参数量,提高学习效率。

关键设计:论文中使用了CP分解作为张量低秩分解的方法。具体来说,Q张量被分解为多个因子矩阵的乘积。通过最小化原始Q张量与重构Q张量之间的差异来学习这些因子矩阵。损失函数通常包括重构误差项和一个正则化项,用于防止过拟合。具体的优化算法未知,但通常可以使用梯度下降等方法。

🖼️ 关键图片

📊 实验亮点

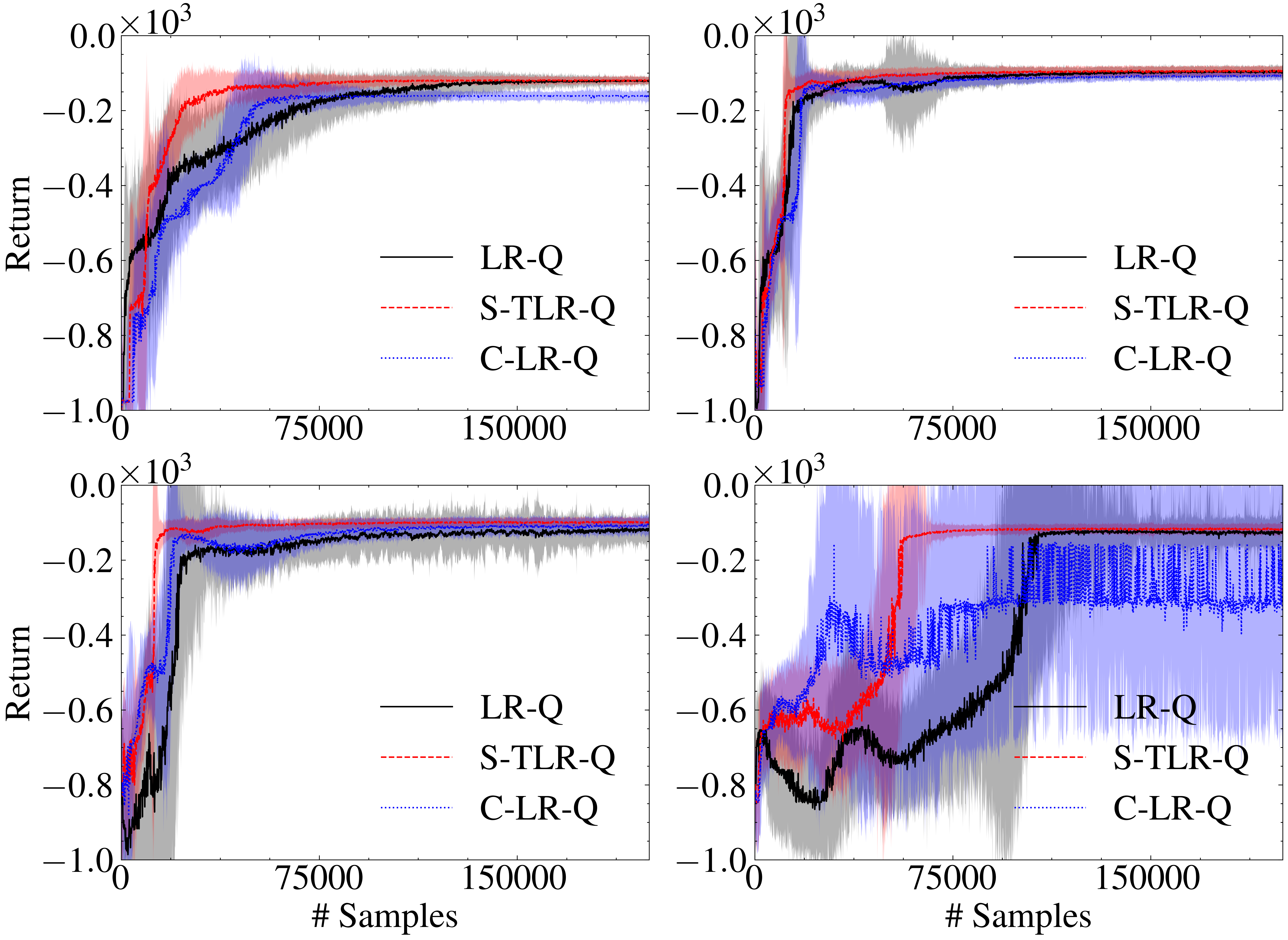

论文在倒立摆和无线通信设备两个场景中进行了实验验证。在倒立摆实验中,该方法能够有效地学习多个倒立摆任务,并取得了较好的控制效果。在无线通信设备实验中,该方法能够有效地进行资源分配,提高了系统的吞吐量。具体的性能数据和对比基线未知。

🎯 应用场景

该研究成果可应用于机器人控制、自动驾驶、游戏AI等领域。例如,在机器人控制中,可以通过学习多个相似的控制任务(如不同方向的移动)来提高机器人的泛化能力。在自动驾驶中,可以利用不同驾驶场景的数据进行多任务学习,提高自动驾驶系统的鲁棒性。该方法还可以应用于无线通信资源分配等问题,通过学习不同用户的需求来优化资源利用率。

📄 摘要(原文)

In pursuit of reinforcement learning systems that could train in physical environments, we investigate multi-task approaches as a means to alleviate the need for massive data acquisition. In a tabular scenario where the Q-functions are collected across tasks, we model our learning problem as optimizing a higher order tensor structure. Recognizing that close-related tasks may require similar actions, our proposed method imposes a low-rank condition on this aggregated Q-tensor. The rationale behind this approach to multi-task learning is that the low-rank structure enforces the notion of similarity, without the need to explicitly prescribe which tasks are similar, but inferring this information from a reduced amount of data simultaneously with the stochastic optimization of the Q-tensor. The efficiency of our low-rank tensor approach to multi-task learning is demonstrated in two numerical experiments, first in a benchmark environment formed by a collection of inverted pendulums, and then into a practical scenario involving multiple wireless communication devices.