Dynamic Pricing in High-Speed Railways Using Multi-Agent Reinforcement Learning

作者: Enrique Adrian Villarrubia-Martin, Luis Rodriguez-Benitez, David Muñoz-Valero, Giovanni Montana, Luis Jimenez-Linares

分类: cs.LG, cs.AI, cs.MA

发布日期: 2025-01-14 (更新: 2025-09-30)

备注: 39 pages, 5 figures

💡 一句话要点

提出基于多智能体强化学习的高速铁路动态定价框架,优化运营商收益。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 动态定价 多智能体强化学习 高速铁路 马尔可夫博弈 随机效用模型

📋 核心要点

- 现有高速铁路动态定价策略缺乏对竞争与合作运营商的有效建模,难以实现全局优化。

- 论文提出基于多智能体强化学习的动态定价框架,模拟乘客决策行为,优化运营商收益。

- 实验验证了该框架的有效性,展示了用户偏好和定价策略对系统动态的影响。

📝 摘要(中文)

本文旨在解决高速铁路行业中动态定价策略设计的关键挑战,尤其是在存在竞争与合作运营商的背景下。为此,论文提出了一个基于非零和马尔可夫博弈的多智能体强化学习(MARL)框架,并结合随机效用模型来捕捉乘客的决策行为。与能源、航空、移动网络等领域的现有研究不同,利用深度强化学习进行铁路系统动态定价的研究相对较少。本文的一个关键贡献是设计了一个参数化且通用的强化学习模拟器RailPricing-RL,用于模拟各种铁路网络配置和需求模式,同时实现对用户行为的现实微观建模。该环境支持所提出的MARL框架,该框架对异构智能体进行建模,这些智能体在最大化个体利润的同时,促进合作行为以同步连接服务。实验结果验证了该框架,展示了用户偏好如何影响MARL性能,以及定价策略如何影响乘客选择、效用和整体系统动态。本研究为推进铁路系统中的动态定价策略奠定了基础,将盈利能力与系统范围内的效率相结合,并支持未来对优化定价策略的研究。

🔬 方法详解

问题定义:论文旨在解决高速铁路动态定价问题,尤其是在存在多个竞争和合作运营商的情况下。现有方法通常难以有效地建模乘客的复杂决策行为,以及运营商之间的竞争与合作关系,导致定价策略无法达到全局最优,影响运营商的收益和系统整体效率。

核心思路:论文的核心思路是将高速铁路动态定价问题建模为一个非零和马尔可夫博弈,其中每个运营商都是一个智能体,通过与环境和其他智能体交互来学习最优的定价策略。通过多智能体强化学习,可以有效地处理运营商之间的竞争与合作关系,并考虑到乘客的决策行为,从而实现更优的定价策略。

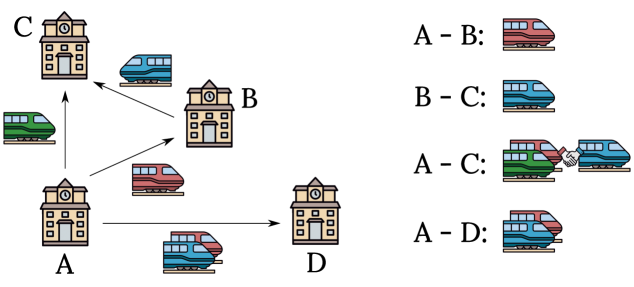

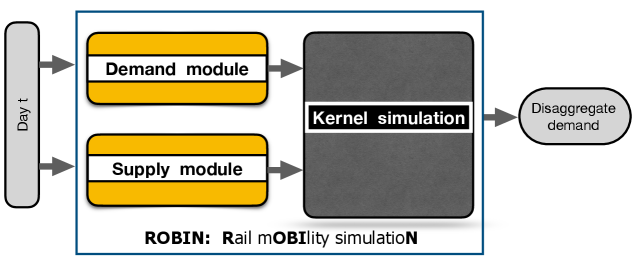

技术框架:整体框架包括三个主要组成部分:首先是RailPricing-RL模拟器,用于模拟铁路网络环境和乘客行为;其次是多智能体强化学习算法,用于训练运营商智能体;最后是评估模块,用于评估定价策略的性能。RailPricing-RL模拟器能够模拟各种铁路网络配置和需求模式,并支持对用户行为的微观建模。MARL算法采用异构智能体建模,每个智能体代表一个运营商,目标是最大化自身利润,同时促进合作行为以同步连接服务。

关键创新:论文的关键创新在于提出了一个参数化且通用的强化学习模拟器RailPricing-RL,该模拟器能够模拟各种铁路网络配置和需求模式,并支持对用户行为的现实微观建模。此外,论文还提出了一个基于非零和马尔可夫博弈的多智能体强化学习框架,该框架能够有效地处理运营商之间的竞争与合作关系,并考虑到乘客的决策行为。与现有方法相比,该框架能够实现更优的定价策略,提高运营商的收益和系统整体效率。

关键设计:RailPricing-RL模拟器采用随机效用模型来模拟乘客的决策行为,该模型考虑了票价、出行时间、舒适度等因素。MARL算法采用独立的Q-learning方法,每个智能体维护一个Q函数,用于估计在给定状态下采取某个动作的价值。奖励函数设计为运营商的利润,目标是最大化累积利润。网络结构采用多层感知机,输入包括当前状态(如剩余座位数、时间等)和动作(即票价),输出为Q值。

🖼️ 关键图片

📊 实验亮点

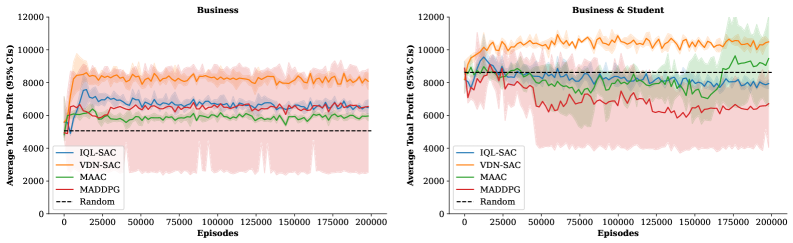

实验结果表明,所提出的MARL框架能够有效地提高运营商的收益和系统效率。具体来说,该框架能够根据用户偏好和市场需求动态调整票价,从而最大化利润。实验还表明,合作行为能够进一步提高系统效率,例如,通过同步连接服务可以减少乘客的等待时间。

🎯 应用场景

该研究成果可应用于实际的高速铁路运营中,帮助运营商制定更有效的动态定价策略,提高收益和系统效率。此外,该框架还可以扩展到其他交通运输领域,如航空、公交等,为动态定价策略的设计提供参考。该研究有助于推动交通运输领域的智能化和优化。

📄 摘要(原文)

This paper addresses a critical challenge in the high-speed passenger railway industry: designing effective dynamic pricing strategies in the context of competing and cooperating operators. To address this, a multi-agent reinforcement learning (MARL) framework based on a non-zero-sum Markov game is proposed, incorporating random utility models to capture passenger decision making. Unlike prior studies in areas such as energy, airlines, and mobile networks, dynamic pricing for railway systems using deep reinforcement learning has received limited attention. A key contribution of this paper is a parametrisable and versatile reinforcement learning simulator designed to model a variety of railway network configurations and demand patterns while enabling realistic, microscopic modelling of user behaviour, called RailPricing-RL. This environment supports the proposed MARL framework, which models heterogeneous agents competing to maximise individual profits while fostering cooperative behaviour to synchronise connecting services. Experimental results validate the framework, demonstrating how user preferences affect MARL performance and how pricing policies influence passenger choices, utility, and overall system dynamics. This study provides a foundation for advancing dynamic pricing strategies in railway systems, aligning profitability with system-wide efficiency, and supporting future research on optimising pricing policies.