Subject Representation Learning from EEG using Graph Convolutional Variational Autoencoders

作者: Aditya Mishra, Ahnaf Mozib Samin, Ali Etemad, Javad Hashemi

分类: eess.SP, cs.LG

发布日期: 2025-01-13

备注: Accepted to 2025 International Conference on Acoustics, Speech, and Signal Processing (ICASSP 2025)

💡 一句话要点

提出基于图卷积变分自编码器的GC-VASE模型,用于脑电信号的个体表征学习。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 脑电信号 个体表征学习 图卷积网络 变分自编码器 对比学习 适配器网络 脑机接口

📋 核心要点

- 现有脑电信号个体表征学习方法泛化性不足,对新个体适应性差,需要大量重新训练。

- 提出GC-VASE模型,利用图卷积变分自编码器和对比学习,学习鲁棒的个体特定潜在表征。

- 引入基于注意力的适配器网络进行微调,显著降低了模型适应新个体的计算成本,并提升了准确率。

📝 摘要(中文)

本文提出了一种基于图卷积的变分自编码器GC-VASE,它利用对比学习从脑电数据中学习个体表征。我们的方法成功地学习了鲁棒的、特定于个体的潜在表征,使用了专为个体识别定制的分割潜在空间架构。为了增强模型对未见个体的适应性,而无需大量重新训练,我们引入了一个基于注意力的适配器网络进行微调,从而降低了模型适应新个体的计算成本。我们的方法显著优于其他深度学习方法,在ERP-Core数据集上实现了89.81%的个体平衡准确率,在SleepEDFx-20数据集上实现了70.85%的个体平衡准确率,达到了最先进的水平。在使用适配器和注意力层进行个体自适应微调后,GC-VASE在ERP-Core上的个体平衡准确率进一步提高到90.31%。此外,我们进行了详细的消融研究,以突出我们方法关键组成部分的影响。

🔬 方法详解

问题定义:现有脑电信号处理方法在个体表征学习方面存在泛化性问题,即模型在训练集上表现良好,但在未见过的个体数据上表现不佳。重新训练成本高昂,限制了其在实际场景中的应用。因此,需要一种能够有效学习个体特征,并能快速适应新个体的方法。

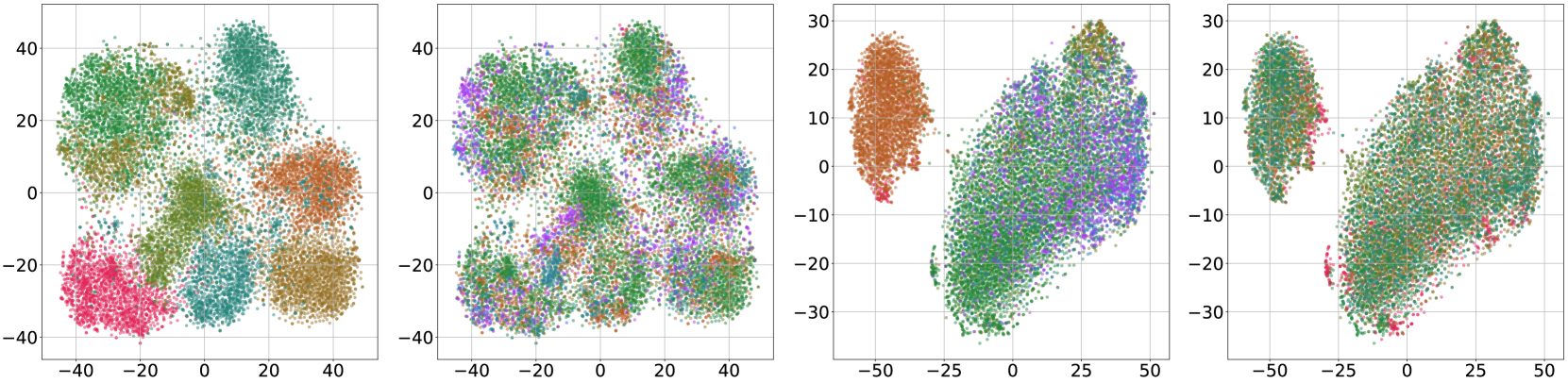

核心思路:论文的核心思路是利用图卷积变分自编码器(GC-VAE)学习脑电信号的个体特定潜在表征,并结合对比学习增强表征的区分性。通过分割潜在空间,一部分用于个体识别,另一部分用于共享特征学习。此外,引入基于注意力的适配器网络,实现对新个体的快速微调和适应。

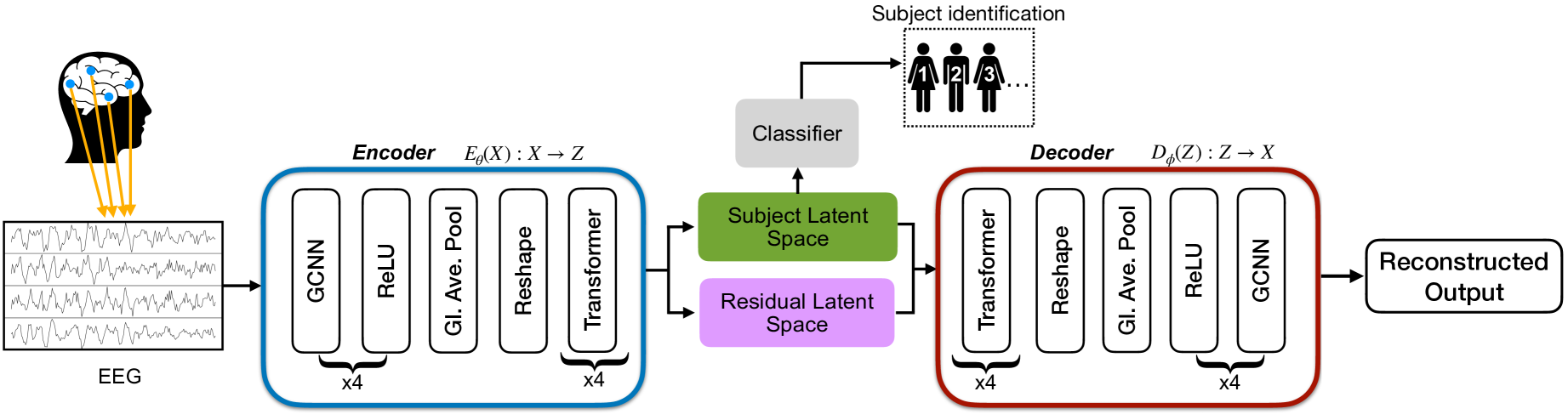

技术框架:GC-VASE模型主要包含以下几个模块:1) 图卷积编码器:将脑电信号转换为图结构数据,并利用图卷积网络提取特征。2) 分割潜在空间:将潜在空间分为个体特定部分和共享部分。3) 对比学习:通过对比损失函数,增强个体表征的区分性。4) 变分自编码器:利用变分推理学习潜在空间的分布。5) 基于注意力的适配器网络:用于对新个体进行微调,快速适应新数据。

关键创新:该方法的主要创新点在于:1) 结合图卷积和变分自编码器,有效处理脑电信号的图结构特征。2) 提出分割潜在空间架构,区分个体特定特征和共享特征。3) 引入基于注意力的适配器网络,实现对新个体的快速适应,降低了重新训练的成本。

关键设计:在网络结构方面,使用了多层图卷积网络提取脑电信号的特征。对比学习采用了InfoNCE损失函数,鼓励相似个体在潜在空间中更接近,不同个体更远离。适配器网络使用了注意力机制,选择性地调整模型参数,以适应新个体的数据分布。具体参数设置和损失函数权重需要根据实验结果进行调整。

🖼️ 关键图片

📊 实验亮点

GC-VASE模型在ERP-Core数据集上实现了89.81%的个体平衡准确率,在SleepEDFx-20数据集上实现了70.85%的个体平衡准确率,显著优于其他深度学习方法,达到了最先进的水平。通过适配器和注意力层进行个体自适应微调后,GC-VASE在ERP-Core上的个体平衡准确率进一步提高到90.31%。消融实验验证了各个关键组件的有效性。

🎯 应用场景

该研究成果可应用于脑机接口、神经疾病诊断、个性化医疗等领域。通过学习个体脑电信号的独特表征,可以实现更精准的个体识别、疾病预测和治疗方案定制。未来,该方法有望应用于开发更智能、更个性化的脑电信号分析系统。

📄 摘要(原文)

We propose GC-VASE, a graph convolutional-based variational autoencoder that leverages contrastive learning for subject representation learning from EEG data. Our method successfully learns robust subject-specific latent representations using the split-latent space architecture tailored for subject identification. To enhance the model's adaptability to unseen subjects without extensive retraining, we introduce an attention-based adapter network for fine-tuning, which reduces the computational cost of adapting the model to new subjects. Our method significantly outperforms other deep learning approaches, achieving state-of-the-art results with a subject balanced accuracy of 89.81% on the ERP-Core dataset and 70.85% on the SleepEDFx-20 dataset. After subject adaptive fine-tuning using adapters and attention layers, GC-VASE further improves the subject balanced accuracy to 90.31% on ERP-Core. Additionally, we perform a detailed ablation study to highlight the impact of the key components of our method.