Model Inversion in Split Learning for Personalized LLMs: New Insights from Information Bottleneck Theory

作者: Yunmeng Shu, Shaofeng Li, Tian Dong, Yan Meng, Haojin Zhu

分类: cs.LG

发布日期: 2025-01-10

备注: 8 pages

💡 一句话要点

针对个性化LLM的分裂学习中模型反演攻击研究,基于信息瓶颈理论提出新型攻击方法。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 分裂学习 模型反演攻击 大型语言模型 隐私泄露 信息瓶颈理论

📋 核心要点

- 现有分裂学习在边缘部署个性化LLM时,忽略了中间表示传输过程中的隐私泄露风险,缺乏有效的隐私保护机制。

- 提出一种两阶段模型反演攻击方法,首先将中间表示投影到嵌入空间,然后利用生成模型从嵌入中恢复文本。

- 实验结果表明,该方法在多种场景下攻击成功率达到38%-75%,相比现有技术提升超过60%。

📝 摘要(中文)

个性化大型语言模型(LLMs)日益普及,展现出如GPT-4等模型的强大能力。这种趋势也推动了在移动设备上部署LLMs的广泛研究。分裂学习是边缘-云部署的可行方法之一。然而,以往的研究主要忽略了设备到服务器传输的中间表示的隐私泄露问题。本文首次识别了LLMs分裂学习框架中的模型反演攻击,强调了安全防御的必要性。首次引入互信息熵来理解基于Transformer的LLMs的信息传播,并评估LLM块的隐私攻击性能。针对表示比嵌入更稀疏且包含更少信息的问题,提出了一种两阶段攻击系统,第一部分将表示投影到嵌入空间,第二部分使用生成模型从这些嵌入中恢复文本。这种设计降低了复杂性,并在各种场景中实现了38%-75%的攻击分数,比SOTA提高了60%以上。这项工作全面强调了个性化LLMs在边缘侧部署期间的潜在隐私风险。

🔬 方法详解

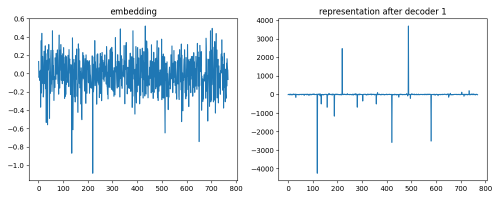

问题定义:论文旨在解决在分裂学习框架下,个性化LLM部署于边缘设备时,中间层表示所存在的隐私泄露问题。现有方法主要关注模型性能优化,忽略了中间表示可能被恶意攻击者利用,从而反演出用户的敏感信息。现有攻击方法难以有效利用中间表示,因为其比嵌入更稀疏,信息量更少。

核心思路:论文的核心思路是将模型反演攻击分解为两个阶段:首先,将中间表示投影到高维的嵌入空间,从而弥补信息损失;然后,利用生成模型(如Transformer解码器)从嵌入空间重构出原始文本。这种分阶段的方法降低了攻击的复杂度,并提高了攻击的成功率。

技术框架:该攻击系统包含两个主要阶段:1) 表示投影阶段:将从边缘设备传输到服务器的中间表示,通过一个投影模型映射到嵌入空间。这个投影模型可以是简单的线性层或更复杂的神经网络。2) 文本生成阶段:利用一个预训练的生成模型,如Transformer解码器,将嵌入空间中的向量解码为文本序列。该生成模型需要经过微调,以适应特定的LLM和数据集。

关键创新:该论文的关键创新在于提出了一个两阶段的模型反演攻击框架,专门针对分裂学习中的LLM中间表示。与传统的单阶段攻击方法相比,该方法能够更有效地利用中间表示中的信息,从而提高攻击的成功率。此外,论文还首次将互信息熵引入到对Transformer-based LLM的信息传播理解中,并评估了LLM块的隐私攻击性能。

关键设计:在表示投影阶段,可以选择不同的投影模型,如线性层、多层感知机等。投影模型的选择会影响攻击的性能,需要根据具体的LLM和数据集进行调整。在文本生成阶段,可以使用预训练的Transformer解码器,并对其进行微调。微调的目标是最小化生成文本与原始文本之间的差异,可以使用交叉熵损失函数。此外,论文还使用了互信息熵来分析不同LLM块的信息泄露程度,从而选择最容易受到攻击的中间层。

🖼️ 关键图片

📊 实验亮点

实验结果表明,所提出的两阶段攻击系统在各种场景下实现了38%-75%的攻击分数,相比于当前最先进的方法,攻击成功率提升超过60%。这表明该方法能够有效地从分裂学习的中间表示中恢复出用户的敏感信息,突显了边缘部署个性化LLM的隐私风险。

🎯 应用场景

该研究成果可应用于评估和改进边缘计算环境下个性化LLM的隐私保护机制。通过模拟模型反演攻击,可以发现系统中的潜在漏洞,并指导开发更有效的防御策略,例如差分隐私、同态加密等。该研究对于推动安全可信的边缘智能具有重要意义。

📄 摘要(原文)

Personalized Large Language Models (LLMs) have become increasingly prevalent, showcasing the impressive capabilities of models like GPT-4. This trend has also catalyzed extensive research on deploying LLMs on mobile devices. Feasible approaches for such edge-cloud deployment include using split learning. However, previous research has largely overlooked the privacy leakage associated with intermediate representations transmitted from devices to servers. This work is the first to identify model inversion attacks in the split learning framework for LLMs, emphasizing the necessity of secure defense. For the first time, we introduce mutual information entropy to understand the information propagation of Transformer-based LLMs and assess privacy attack performance for LLM blocks. To address the issue of representations being sparser and containing less information than embeddings, we propose a two-stage attack system in which the first part projects representations into the embedding space, and the second part uses a generative model to recover text from these embeddings. This design breaks down the complexity and achieves attack scores of 38%-75% in various scenarios, with an over 60% improvement over the SOTA. This work comprehensively highlights the potential privacy risks during the deployment of personalized LLMs on the edge side.