Element-wise Attention Is All You Need

作者: Guoxin Feng

分类: cs.LG, cs.AI

发布日期: 2025-01-10

💡 一句话要点

提出元素级注意力机制以解决自注意力复杂性问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 元素级注意力 自注意力机制 长序列训练 计算效率 性能优化

📋 核心要点

- 现有自注意力机制在长序列训练和推理时复杂度较高,导致计算资源消耗大。

- 提出的元素级注意力机制通过平方欧几里得距离计算相似度,显著降低了复杂度。

- 实验结果表明,该机制在性能上与自注意力相当,同时在计算和内存效率上有显著提升。

📝 摘要(中文)

自注意力机制在多个领域表现出色,但在训练和推理过程中存在显著的复杂性。为了解决这一问题,本文提出了一种新颖的元素级注意力机制,利用元素级平方欧几里得距离来计算相似度,并用泰勒多项式近似二次复杂度项。该机制在训练时复杂度为$ ext{O}(tLD)$,在推理时可重构为递归神经网络,复杂度为$ ext{O}(tD)$,有效提高了长序列训练的计算和内存效率。此外,元素级注意力避免了现有方法的性能下降因素,能够在因果和非因果形式下实现与自注意力相当的性能。

🔬 方法详解

问题定义:本文旨在解决自注意力机制在长序列训练和推理中的高复杂性问题。现有方法如线性注意力和状态空间模型虽然降低了复杂度,但存在性能下降的缺陷。

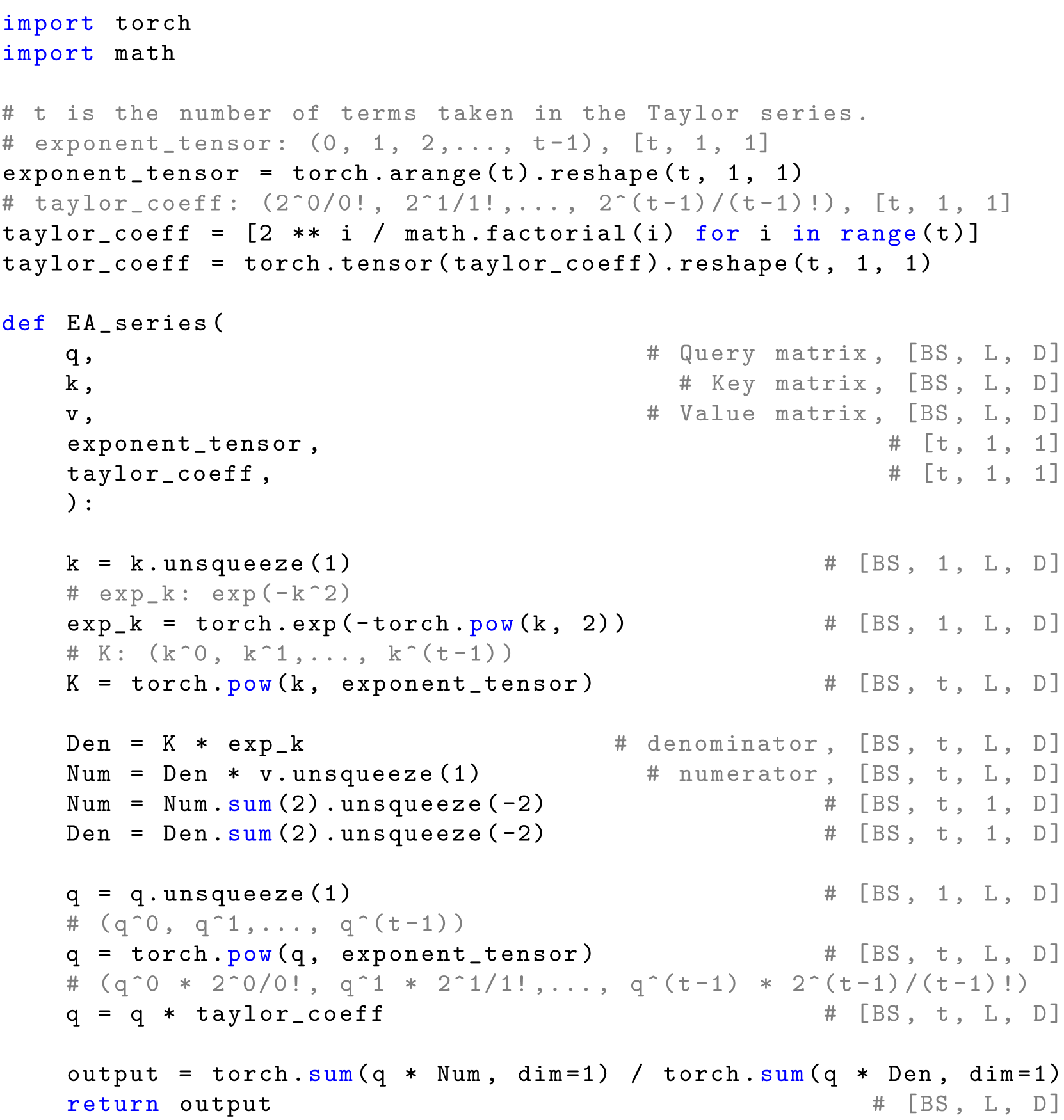

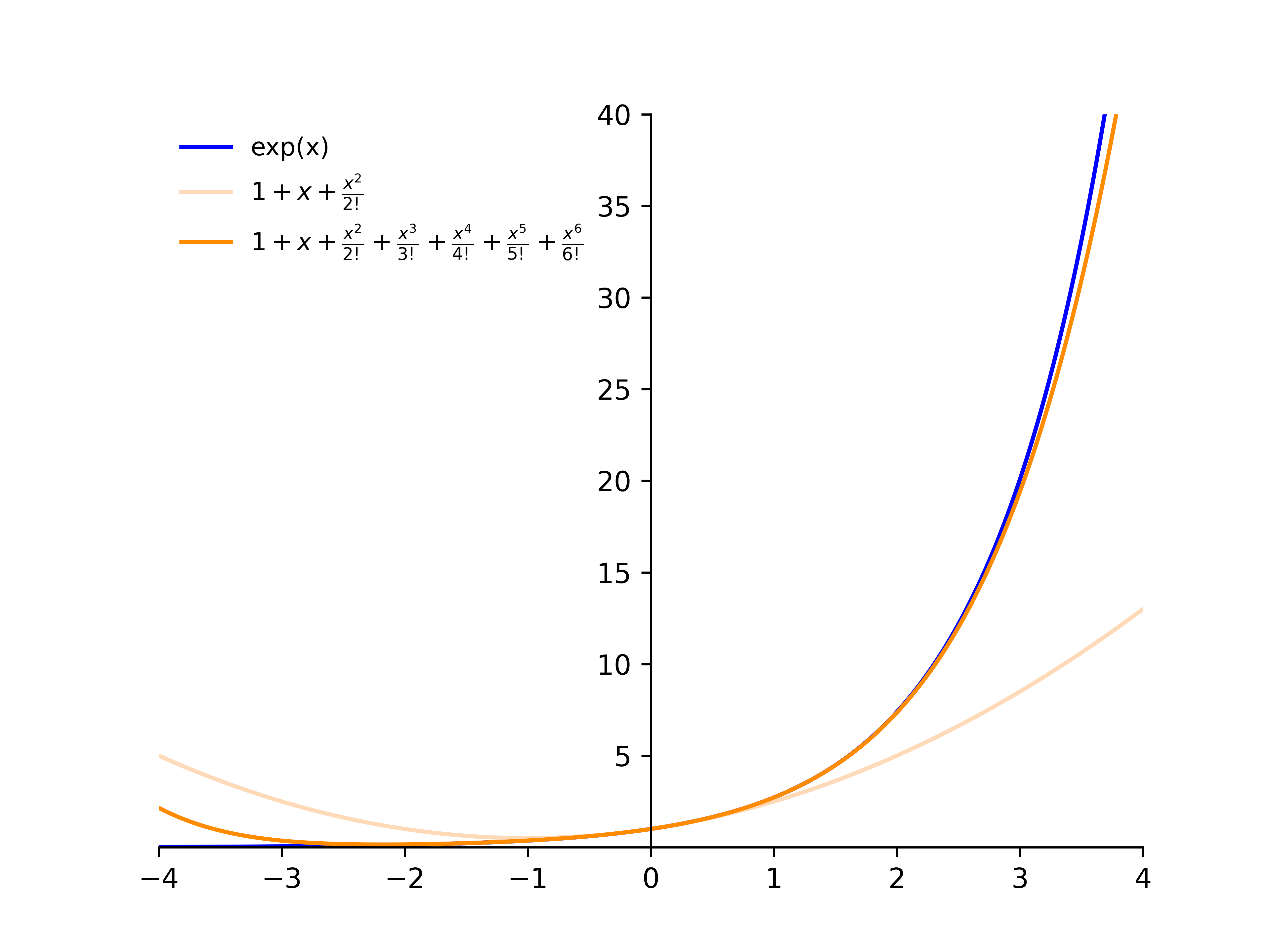

核心思路:提出的元素级注意力机制通过使用元素级平方欧几里得距离替代点积操作来计算相似度,并用泰勒多项式近似复杂度项,从而实现更高效的计算。

技术框架:整体架构包括输入序列的特征提取、元素级注意力计算和输出生成三个主要模块。输入序列首先经过特征提取,然后通过元素级注意力机制计算相似度,最后生成输出。

关键创新:最重要的创新在于引入元素级注意力机制,避免了现有方法中性能下降的因素,且在复杂度上显著优于传统自注意力机制。

关键设计:在参数设置上,使用泰勒多项式的最高阶$t$来控制复杂度,损失函数采用标准的交叉熵损失,网络结构设计为适应长序列输入,确保计算和内存效率。

🖼️ 关键图片

📊 实验亮点

实验结果显示,元素级注意力机制在训练时复杂度为$ ext{O}(tLD)$,推理时为$ ext{O}(tD)$,在长序列任务中相比于传统自注意力机制,计算和内存效率提升显著,同时在性能上与自注意力机制相当,验证了其有效性。

🎯 应用场景

该研究的元素级注意力机制可广泛应用于自然语言处理、计算机视觉和时间序列分析等领域,尤其是在需要处理长序列数据的场景中,能够有效降低计算资源消耗,提高模型的实用性和效率。未来,该机制有潜力推动更多高效模型的开发与应用。

📄 摘要(原文)

The self-attention (SA) mechanism has demonstrated superior performance across various domains, yet it suffers from substantial complexity during both training and inference. The next-generation architecture, aiming at retaining the competitive performance of SA while achieving low-cost inference and efficient long-sequence training, primarily focuses on three approaches: linear attention, linear RNNs, and state space models. Although these approaches achieve reduced complexity than SA, they all have built-in performance degradation factors, such as diminished “spikiness” and compression of historical information. In contrast to these approaches, we propose a novel element-wise attention mechanism, which uses the element-wise squared Euclidean distance, instead of the dot product operation, to compute similarity and approximates the quadratic complexity term $\exp(q_{ic}k_{jc})$ with a Taylor polynomial. This design achieves remarkable efficiency: during training, the element-wise attention has a complexity of $\mathcal{O}(tLD)$, making long-sequence training both computationally and memory efficient, where $L$ is the sequence length, $D$ is the feature dimension, and $t$ is the highest order of the polynomial; during inference, it can be reformulated as recurrent neural networks, achieving a inference complexity of $\mathcal{O}(tD)$. Furthermore, the element-wise attention circumvents the performance degradation factors present in these approaches and achieves performance comparable to SA in both causal and non-causal forms.