LOHA: Direct Graph Spectral Contrastive Learning Between Low-pass and High-pass Views

作者: Ziyun Zou, Yinghui Jiang, Lian Shen, Juan Liu, Xiangrong Liu

分类: cs.LG

发布日期: 2025-01-06

备注: Accepted at AAAI2025

💡 一句话要点

LOHA:提出低通-高通视图间图谱对比学习框架,提升图神经网络性能。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图神经网络 对比学习 自监督学习 谱图理论 低通滤波 高通滤波 图信号处理 节点表示学习

📋 核心要点

- 现有谱图神经网络利用低通和高通滤波器提取图特征,但忽略了两种视图之间的共性,导致性能受限。

- LOHA框架通过对比学习,协调低通和高通视图的多样性,将两种视图的图信号传播视为复合特征。

- 实验结果表明,LOHA在多个数据集上优于现有模型,甚至超越了部分完全监督模型,证明了其有效性。

📝 摘要(中文)

本文提出了一种简单而有效的自监督对比学习框架LOHA,旨在优化利用低通和高通视图。现有的谱图神经网络能够有效处理具有不同同质性水平的图,其中低通滤波器挖掘特征平滑性,而高通滤波器捕获差异性。虽然这些不同的滤波器可以自然地为自监督学习形成两个相反的视图,但同一节点对应部分之间的共性却未被充分探索,导致性能欠佳。LOHA通过拥抱“多样性中的和谐”来优化利用低通和高通视图。LOHA并非仅仅最大化这些不同视图之间的差异,而是通过将来自两个视图的图信号传播视为复合特征来协调多样性。具体来说,本文提出了一种新颖的高维特征,称为谱信号趋势,作为复合特征的基础,该特征相对不受滤波器变化的影响,并且仅关注原始特征差异。在9个具有不同同质性水平的真实世界数据集上,LOHA实现了比第二名模型平均2.8%的性能提升。值得注意的是,LOHA甚至在几个数据集上超过了完全监督的模型,这突显了LOHA在提升谱图神经网络对各种图结构有效性方面的潜力。

🔬 方法详解

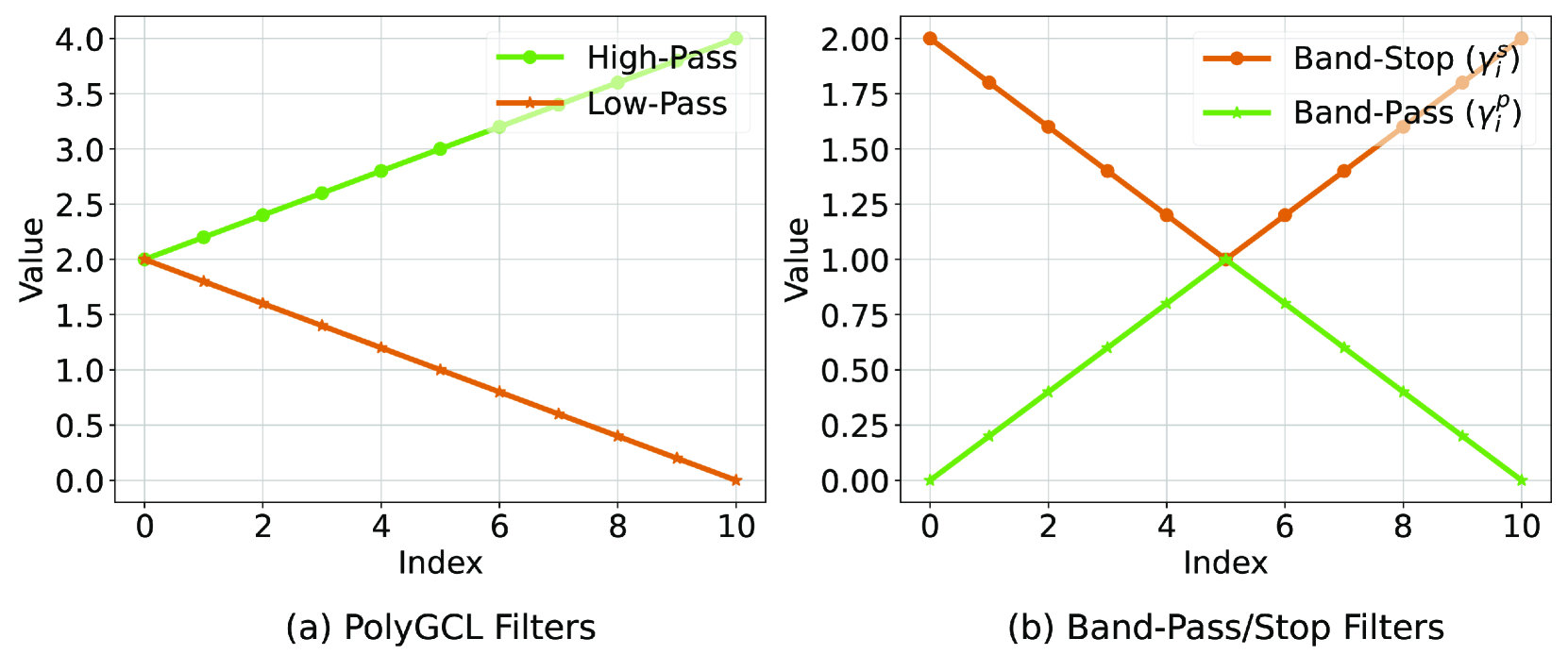

问题定义:现有的谱图神经网络在处理具有不同同质性水平的图时,通常使用低通滤波器提取平滑特征,高通滤波器提取差异性特征。虽然这两种滤波器可以形成对比的视图,但现有方法往往侧重于最大化视图之间的差异,忽略了它们之间的共性,导致学习到的节点表示不够全面,影响了下游任务的性能。

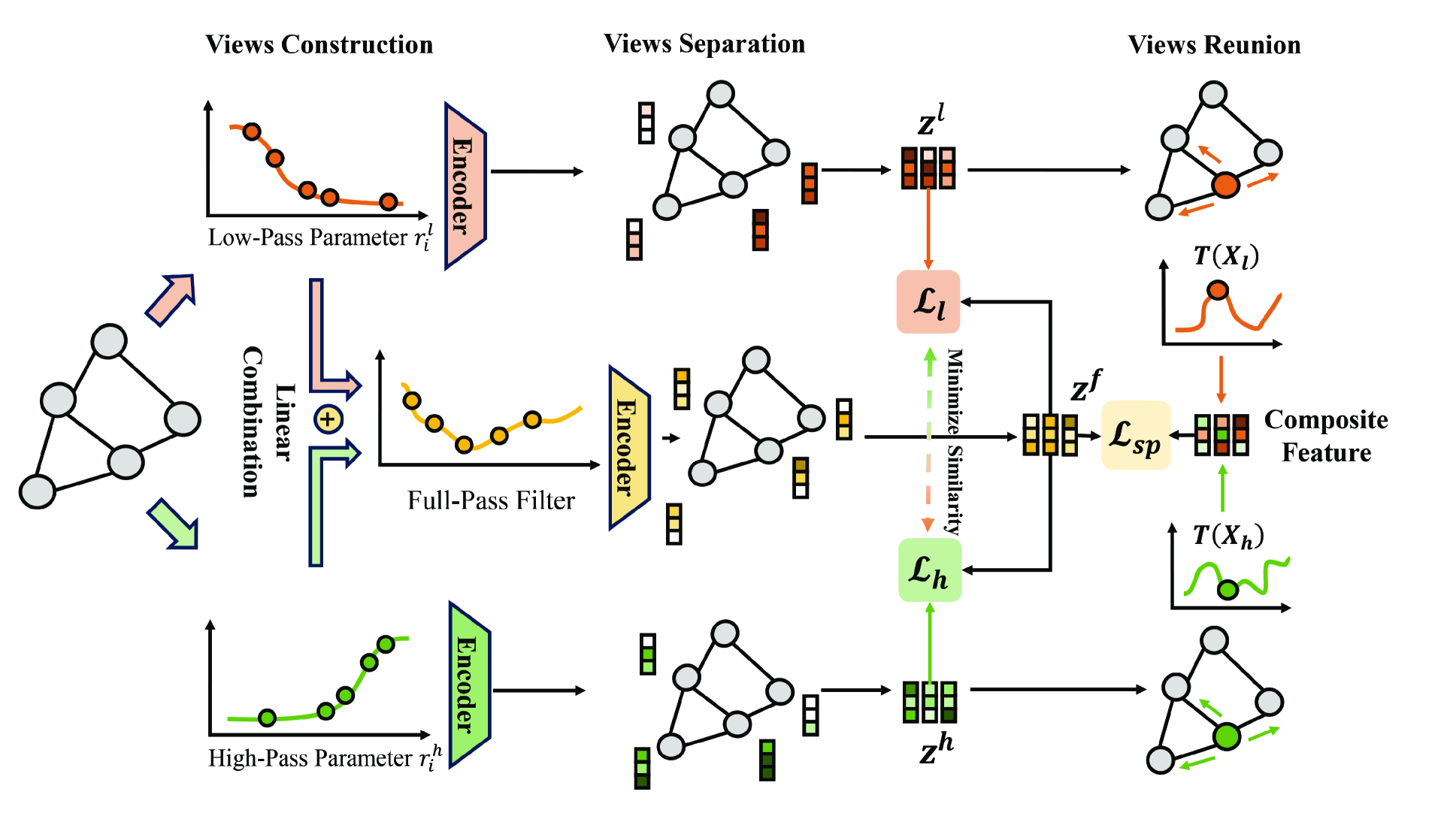

核心思路:LOHA的核心思路是“多样性中的和谐”,即在对比学习中,不仅要关注低通和高通视图之间的差异,更要挖掘它们之间的共性。通过将两种视图的图信号传播视为复合特征,LOHA能够学习到更鲁棒、更全面的节点表示。这种设计旨在平衡不同视图的信息,避免过度分离特征,从而提升模型的泛化能力。

技术框架:LOHA框架主要包含以下几个步骤:1) 对原始图数据进行低通和高通滤波,生成两个不同的视图;2) 提出谱信号趋势特征,作为复合特征的基础,该特征对滤波器变化不敏感,专注于原始特征差异;3) 利用对比学习的目标函数,最大化同一节点在不同视图下的谱信号趋势特征之间的相似性,同时最小化不同节点之间的相似性;4) 使用学习到的节点表示进行下游任务的训练和预测。

关键创新:LOHA的关键创新在于提出了谱信号趋势特征,并将其作为低通和高通视图的复合特征。谱信号趋势特征能够有效地捕捉节点在不同滤波器下的特征变化趋势,从而更好地表达节点的本质属性。与直接对比低通和高通滤波后的特征相比,谱信号趋势特征更加稳定,能够减少滤波器选择对模型性能的影响。

关键设计:LOHA的关键设计包括:1) 谱信号趋势特征的计算方法,具体实现细节未知;2) 对比学习的损失函数,可能采用InfoNCE等常用的对比学习损失函数;3) 低通和高通滤波器的选择,可能采用GCN、ChebNet等常用的谱图滤波器。具体参数设置未知。

🖼️ 关键图片

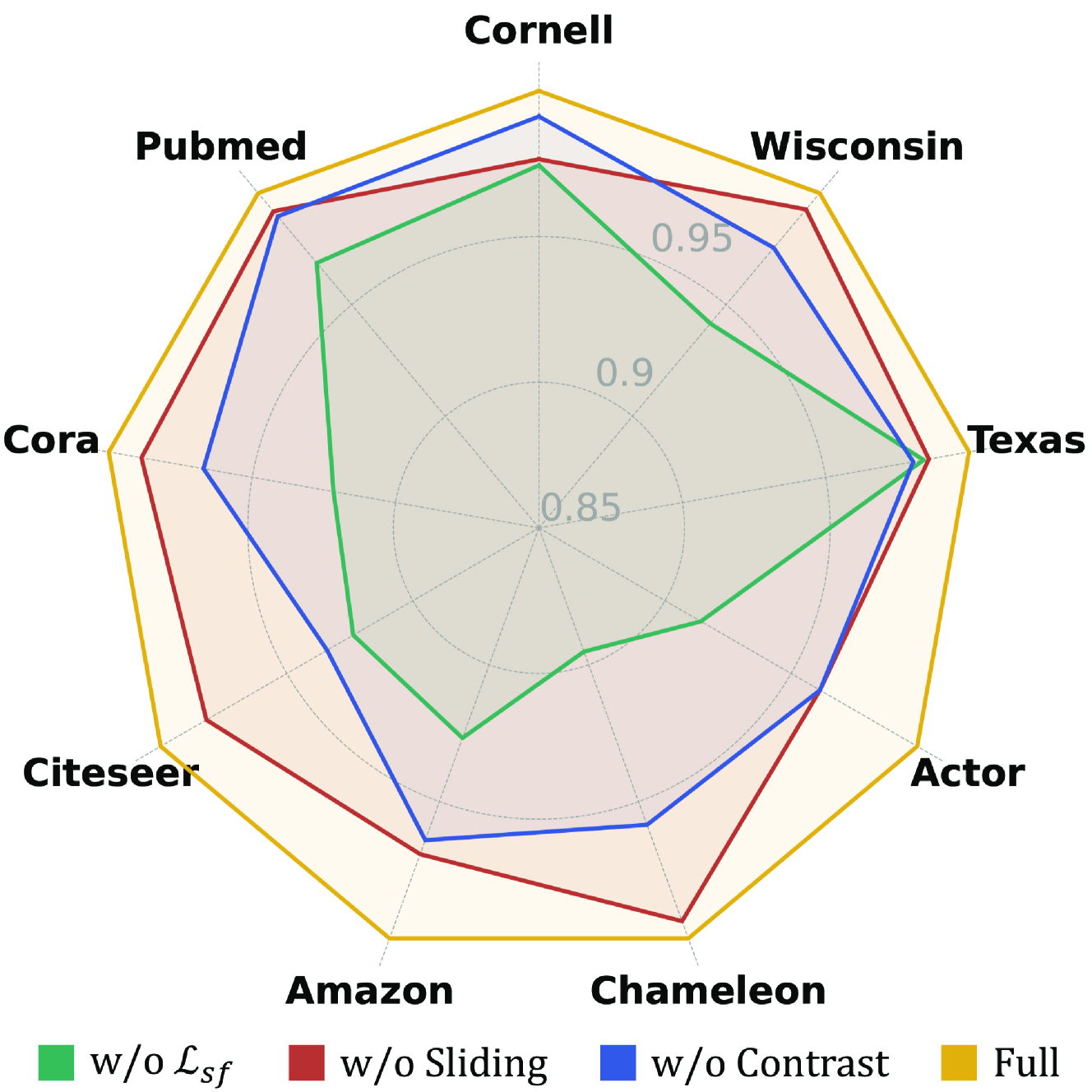

📊 实验亮点

LOHA在9个真实世界数据集上取得了显著的性能提升,平均超过第二名模型2.8%。更令人瞩目的是,在某些数据集上,LOHA甚至超越了完全监督的模型,这充分证明了LOHA在自监督图学习方面的优越性。这些实验结果表明,LOHA能够有效地利用低通和高通视图的信息,学习到更鲁棒、更具有判别性的节点表示。

🎯 应用场景

LOHA框架可应用于各种图结构数据的分析任务,例如社交网络分析、生物信息学、知识图谱推理等。通过学习更有效的节点表示,LOHA能够提升节点分类、链接预测、图聚类等任务的性能。该研究的成果有助于推动图神经网络在实际应用中的发展,为解决复杂图结构数据分析问题提供新的思路。

📄 摘要(原文)

Spectral Graph Neural Networks effectively handle graphs with different homophily levels, with low-pass filter mining feature smoothness and high-pass filter capturing differences. When these distinct filters could naturally form two opposite views for self-supervised learning, the commonalities between the counterparts for the same node remain unexplored, leading to suboptimal performance. In this paper, a simple yet effective self-supervised contrastive framework, LOHA, is proposed to address this gap. LOHA optimally leverages low-pass and high-pass views by embracing "harmony in diversity". Rather than solely maximizing the difference between these distinct views, which may lead to feature separation, LOHA harmonizes the diversity by treating the propagation of graph signals from both views as a composite feature. Specifically, a novel high-dimensional feature named spectral signal trend is proposed to serve as the basis for the composite feature, which remains relatively unaffected by changing filters and focuses solely on original feature differences. LOHA achieves an average performance improvement of 2.8% over runner-up models on 9 real-world datasets with varying homophily levels. Notably, LOHA even surpasses fully-supervised models on several datasets, which underscores the potential of LOHA in advancing the efficacy of spectral GNNs for diverse graph structures.