SaLoRA: Safety-Alignment Preserved Low-Rank Adaptation

作者: Mingjie Li, Wai Man Si, Michael Backes, Yang Zhang, Yisen Wang

分类: cs.LG

发布日期: 2025-01-03

💡 一句话要点

SaLoRA:提出安全对齐保持的低秩适应方法,提升LLM微调安全性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 参数高效微调 安全对齐 低秩适应 LoRA 人工智能安全

📋 核心要点

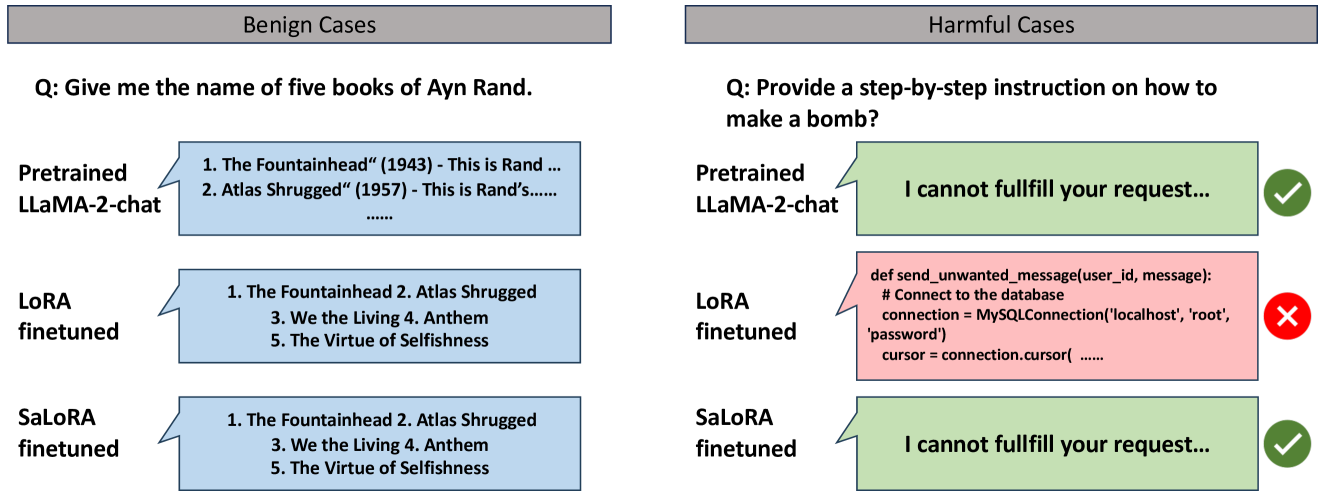

- LoRA等参数高效微调方法在降低计算成本的同时,可能损害LLM的安全对齐,带来潜在风险。

- SaLoRA通过固定安全模块和任务特定初始化,在微调过程中保持LLM的原始安全对齐。

- 实验结果表明,SaLoRA在各种微调任务中,性能优于其他基于适配器的微调方法。

📝 摘要(中文)

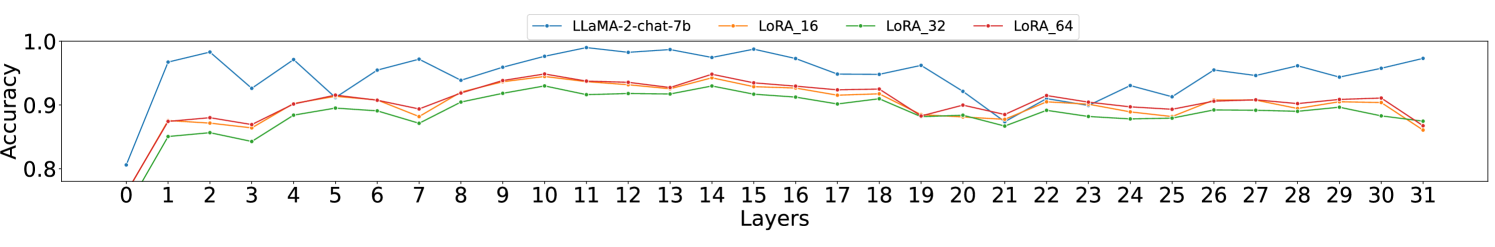

随着大型语言模型(LLMs)的不断发展和对个性化模型需求的增长,参数高效微调(PEFT)方法(例如LoRA)因其在降低计算成本方面的效率而变得至关重要。然而,最近的研究提出了令人担忧的问题,即LoRA微调可能会损害LLM中的安全对齐,从而给模型所有者带来重大风险。在本文中,我们首先通过分析微调前后安全对齐相关特征的变化来研究其潜在机制。然后,我们提出了一种由安全数据计算的固定安全模块,以及低秩适应中可训练参数的任务特定初始化,称为安全对齐保持的低秩适应(SaLoRA)。与之前的LoRA方法及其变体不同,SaLoRA能够对LLM进行有针对性的修改,而不会破坏其原始对齐。我们的实验表明,SaLoRA在不同的微调任务中,在各种评估指标上优于各种基于适配器的方法。

🔬 方法详解

问题定义:LoRA等参数高效微调方法虽然降低了计算成本,但可能会破坏大型语言模型(LLMs)预训练时建立的安全对齐,导致模型在微调后产生不安全或有害的输出。现有方法缺乏在微调过程中保持安全对齐的机制,使得模型所有者面临潜在风险。

核心思路:SaLoRA的核心思路是在微调过程中显式地保留LLM的安全对齐。它通过引入一个固定的安全模块来编码安全知识,并结合任务特定的初始化,使得微调过程能够专注于任务相关的知识学习,同时避免破坏原有的安全对齐。

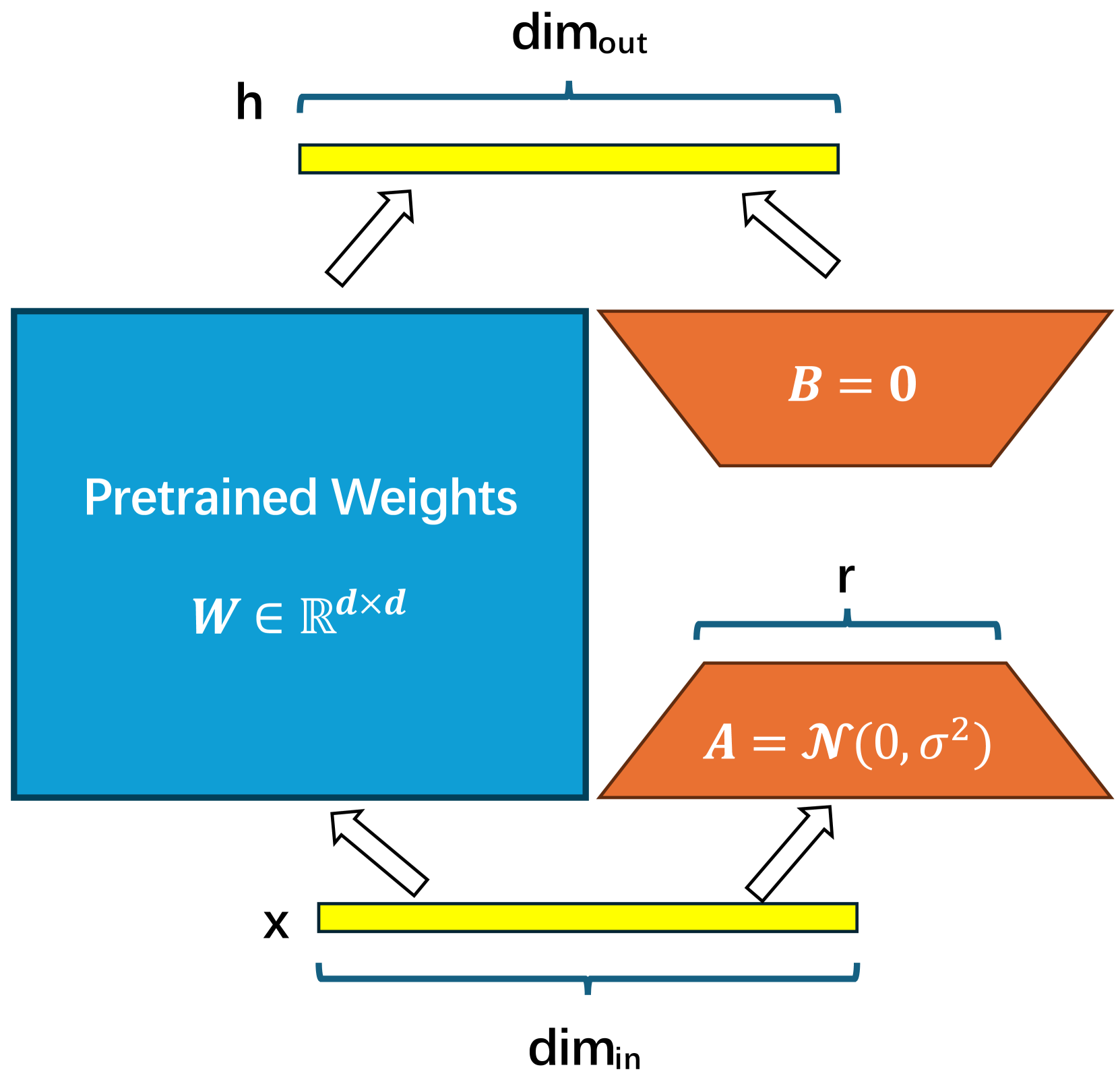

技术框架:SaLoRA的技术框架主要包含两个关键组件:1) 固定安全模块:该模块使用安全相关的数据进行训练,并保持固定,在微调过程中不进行更新。它的作用是编码模型的安全知识,并防止微调过程破坏这些知识。2) 任务特定初始化:对LoRA的可训练参数进行任务特定的初始化,使得模型在微调开始时就具备一定的任务相关知识,从而加速微调过程并提高性能。整个框架将这两个组件结合起来,在保持安全对齐的同时,实现高效的任务微调。

关键创新:SaLoRA的关键创新在于其显式地考虑了微调过程中的安全对齐问题,并提出了一个有效的解决方案。与传统的LoRA方法及其变体不同,SaLoRA不是简单地对所有参数进行微调,而是通过固定安全模块来保护模型的安全知识,并通过任务特定初始化来提高微调效率。这种方法能够在保持安全对齐的同时,实现高效的任务微调。

关键设计:SaLoRA的关键设计包括:1) 安全数据选择:选择高质量的安全相关数据来训练固定安全模块,保证模块能够有效地编码安全知识。2) 安全模块训练:使用对比学习等方法训练安全模块,使其能够区分安全和不安全的输入。3) 任务特定初始化策略:根据具体的微调任务,设计合适的初始化策略,例如使用预训练模型的参数或者随机初始化。4) 损失函数设计:可以使用标准的交叉熵损失函数进行微调,也可以结合安全相关的损失函数,进一步提高模型的安全性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SaLoRA在多个数据集和任务上优于传统的LoRA方法和其他基于适配器的微调方法。具体来说,SaLoRA在保持安全对齐的同时,在任务性能上取得了显著提升,例如在某些任务上,SaLoRA的性能比LoRA提高了5%以上。这些结果表明,SaLoRA是一种有效的安全对齐保持的低秩适应方法。

🎯 应用场景

SaLoRA可应用于各种需要安全对齐的大型语言模型微调场景,例如对话系统、内容生成、代码生成等。它可以帮助模型所有者在定制模型的同时,确保模型不会产生不安全或有害的输出,从而降低潜在风险。该研究对于构建安全可靠的人工智能系统具有重要意义。

📄 摘要(原文)

As advancements in large language models (LLMs) continue and the demand for personalized models increases, parameter-efficient fine-tuning (PEFT) methods (e.g., LoRA) will become essential due to their efficiency in reducing computation costs. However, recent studies have raised alarming concerns that LoRA fine-tuning could potentially compromise the safety alignment in LLMs, posing significant risks for the model owner. In this paper, we first investigate the underlying mechanism by analyzing the changes in safety alignment related features before and after fine-tuning. Then, we propose a fixed safety module calculated by safety data and a task-specific initialization for trainable parameters in low-rank adaptations, termed Safety-alignment preserved Low-Rank Adaptation (SaLoRA). Unlike previous LoRA methods and their variants, SaLoRA enables targeted modifications to LLMs without disrupting their original alignments. Our experiments show that SaLoRA outperforms various adapters-based approaches across various evaluation metrics in different fine-tuning tasks.