Low-Rank Adaptation for Foundation Models: A Comprehensive Review

作者: Menglin Yang, Jialin Chen, Jinkai Tao, Yifei Zhang, Jiahong Liu, Jiasheng Zhang, Qiyao Ma, Harshit Verma, Regina Zhang, Min Zhou, Irwin King, Rex Ying

分类: cs.LG, cs.AI

发布日期: 2024-12-31 (更新: 2025-11-03)

💡 一句话要点

LoRA综述:全面回顾低秩适应方法在通用基础模型上的应用与发展

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低秩适应 基础模型 参数高效微调 模型微调 深度学习

📋 核心要点

- 现有基础模型参数量巨大,微调成本高昂,难以高效地适应特定下游任务。

- LoRA通过引入低秩矩阵来近似模型参数更新,显著减少了需要训练的参数量,降低了计算开销。

- 该综述全面回顾了LoRA在多种基础模型上的应用,并探讨了其理论基础、未来方向和实际挑战。

📝 摘要(中文)

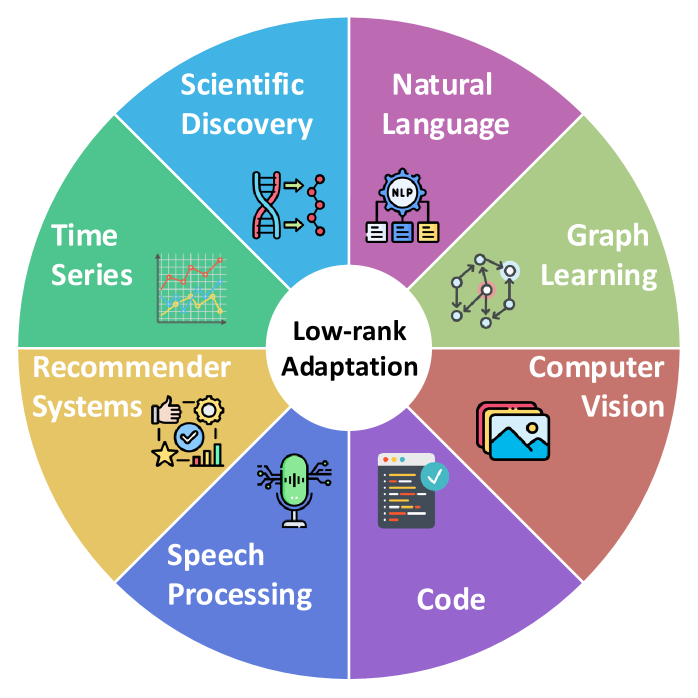

基础模型(在多样化、大规模数据集上训练的神经网络)的快速发展彻底改变了人工智能,并在自然语言处理、计算机视觉和科学发现等领域实现了前所未有的进步。然而,这些模型通常拥有数十亿甚至数万亿的参数,这给它们适应特定下游任务带来了重大挑战。低秩适应(LoRA)作为一种极具前景的方法应运而生,它提供了一种参数高效的机制,以最小的计算开销微调基础模型。本综述首次全面回顾了LoRA技术在通用基础模型(而不仅仅是大型语言模型)上的应用,包括最新的技术基础、新兴前沿和跨多个领域的低秩适应应用。最后,本综述讨论了理论理解、可扩展性和鲁棒性方面的关键挑战和未来研究方向。本综述为从事高效基础模型适应的研究人员和从业人员提供了宝贵的资源。

🔬 方法详解

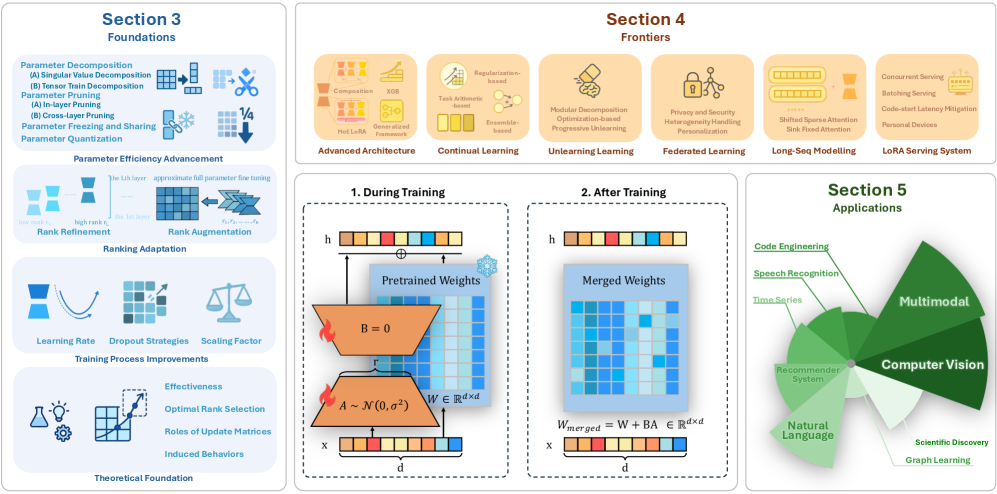

问题定义:论文旨在解决基础模型微调过程中参数量巨大、计算成本高昂的问题。现有方法,如全参数微调,需要大量的计算资源和存储空间,限制了基础模型在资源受限场景下的应用。

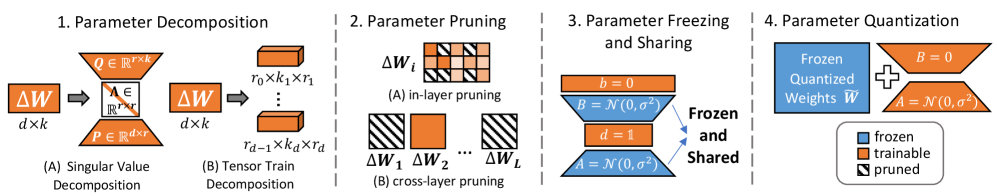

核心思路:论文的核心思路是利用低秩分解来近似模型参数的更新。LoRA假设预训练模型的权重矩阵具有较低的内在秩,因此可以通过学习低秩矩阵来捕捉特定任务的知识,而无需修改原始模型的所有参数。这样可以显著减少需要训练的参数量,从而降低计算成本和存储需求。

技术框架:LoRA的技术框架主要包括以下几个步骤:首先,选择需要适应的预训练模型层;然后,对于选定的层,引入两个低秩矩阵(A和B),用于表示参数更新的低秩分解;在训练过程中,只更新这两个低秩矩阵的参数,而原始预训练模型的参数保持不变;最后,将学习到的低秩矩阵加到原始模型参数上,得到适应特定任务的模型。

关键创新:LoRA最重要的技术创新点在于其参数高效性。通过引入低秩分解,LoRA只需要训练少量参数,就可以达到与全参数微调相当甚至更好的性能。与现有方法(如Adapter)相比,LoRA的实现更加简单,并且可以更容易地集成到现有的模型架构中。

关键设计:LoRA的关键设计包括:选择合适的秩(rank)的大小,秩的大小决定了低秩矩阵的维度,从而影响模型的表达能力和训练成本;选择需要适应的层,不同的层对模型的性能影响不同,需要根据具体任务进行选择;使用合适的优化器和学习率,以确保模型能够快速收敛并达到最佳性能。

🖼️ 关键图片

📊 实验亮点

该综述全面总结了LoRA在不同领域的应用,包括自然语言处理、计算机视觉等。论文对比了LoRA与其他参数高效微调方法的性能,并分析了LoRA的优势和局限性。此外,论文还探讨了LoRA的理论基础,并提出了未来研究方向,例如如何自动选择合适的秩的大小,以及如何将LoRA与其他技术相结合,以进一步提高模型的性能。

🎯 应用场景

LoRA技术具有广泛的应用前景,包括自然语言处理、计算机视觉、语音识别等领域。它可以用于快速定制化预训练模型,以适应各种下游任务,如文本分类、图像识别、目标检测等。此外,LoRA还可以用于模型压缩和知识迁移,将大型模型的知识迁移到小型模型上,从而实现高效的部署和推理。未来,LoRA有望成为基础模型微调的标准方法。

📄 摘要(原文)

The rapid advancement of foundation modelslarge-scale neural networks trained on diverse, extensive datasetshas revolutionized artificial intelligence, enabling unprecedented advancements across domains such as natural language processing, computer vision, and scientific discovery. However, the substantial parameter count of these models, often reaching billions or trillions, poses significant challenges in adapting them to specific downstream tasks. Low-Rank Adaptation (LoRA) has emerged as a highly promising approach for mitigating these challenges, offering a parameter-efficient mechanism to fine-tune foundation models with minimal computational overhead. This survey provides the first comprehensive review of LoRA techniques beyond large Language Models to general foundation models, including recent techniques foundations, emerging frontiers and applications of low-rank adaptation across multiple domains. Finally, this survey discusses key challenges and future research directions in theoretical understanding, scalability, and robustness. This survey serves as a valuable resource for researchers and practitioners working with efficient foundation model adaptation.