Enhancing Adversarial Robustness of Deep Neural Networks Through Supervised Contrastive Learning

作者: Longwei Wang, Navid Nayyem, Abdullah Rakin

分类: cs.LG, cs.AI

发布日期: 2024-12-27

备注: 8 pages, 11 figures

💡 一句话要点

结合监督对比学习与Margin损失,提升深度神经网络的对抗鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 对抗鲁棒性 监督对比学习 对比损失 深度神经网络 对抗攻击

📋 核心要点

- 对抗攻击利用神经网络的脆弱性,通过微小扰动导致误分类,现有方法在提升模型鲁棒性方面仍有不足。

- 论文提出结合监督对比学习和基于Margin的对比损失,旨在改善特征空间结构并创建鲁棒的决策边界。

- 实验结果表明,在CIFAR-100数据集上,该方法在快速梯度符号方法攻击下,显著提升了模型的对抗鲁棒性。

📝 摘要(中文)

本文提出了一种新颖的框架,该框架结合了监督对比学习和基于Margin的对比损失,旨在增强深度神经网络的对抗鲁棒性。对抗攻击通过引入不易察觉的扰动来利用卷积神经网络的漏洞,导致错误分类,暴露了特征表示和决策边界的弱点。监督对比学习通过聚类同一类别的样本嵌入,并分离不同类别的样本嵌入,从而改善特征空间的结构。受支持向量机启发的基于Margin的对比损失,强制执行显式约束,以创建具有明确Margin的鲁棒决策边界。在具有ResNet-18骨干网络的CIFAR-100数据集上的实验表明,在快速梯度符号方法攻击下,对抗准确性得到了提高,证明了鲁棒性性能的提升。

🔬 方法详解

问题定义:论文旨在解决深度神经网络在对抗攻击下的脆弱性问题。现有的对抗训练方法虽然可以提高模型的鲁棒性,但往往会牺牲模型的泛化能力,并且训练成本较高。此外,现有方法在构建鲁棒的特征表示和决策边界方面仍有提升空间。

核心思路:论文的核心思路是利用监督对比学习来改善特征空间的结构,使得同一类别的样本在特征空间中更加紧凑,不同类别的样本更加分离。同时,引入基于Margin的对比损失,强制模型学习具有更大Margin的决策边界,从而提高模型对对抗扰动的抵抗能力。

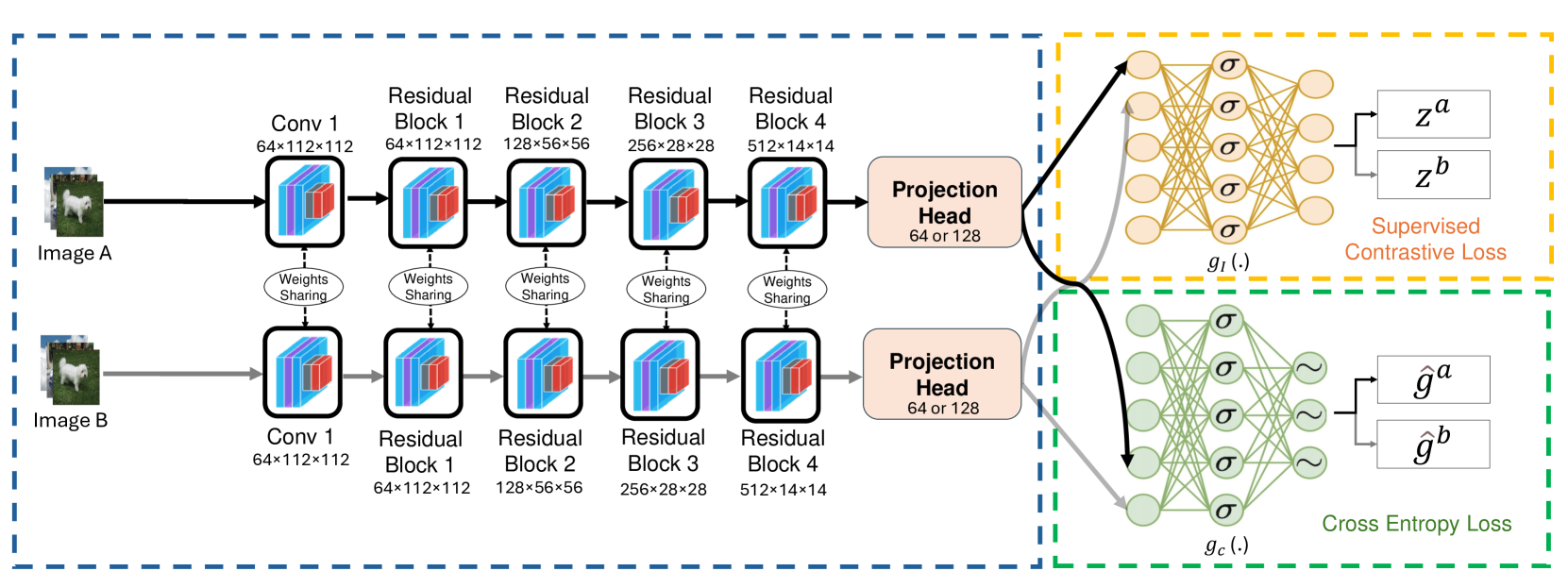

技术框架:整体框架包括以下几个主要步骤:1) 使用ResNet-18作为特征提取器;2) 使用监督对比学习对特征提取器进行预训练,以改善特征空间的结构;3) 在预训练的特征提取器基础上,添加分类器,并使用基于Margin的对比损失进行微调,以构建鲁棒的决策边界;4) 使用对抗样本进行对抗训练,进一步提高模型的鲁棒性。

关键创新:论文的关键创新在于将监督对比学习和基于Margin的对比损失相结合,从而同时改善了特征空间的结构和决策边界的鲁棒性。与传统的对抗训练方法相比,该方法能够更有效地提高模型的鲁棒性,并且不会显著降低模型的泛化能力。

关键设计:在监督对比学习中,使用了温度系数τ来控制对比损失的敏感度。在基于Margin的对比损失中,使用了Margin参数m来控制决策边界的宽度。对抗训练中,使用了快速梯度符号方法(FGSM)生成对抗样本,并调整了对抗扰动的强度ε。

🖼️ 关键图片

📊 实验亮点

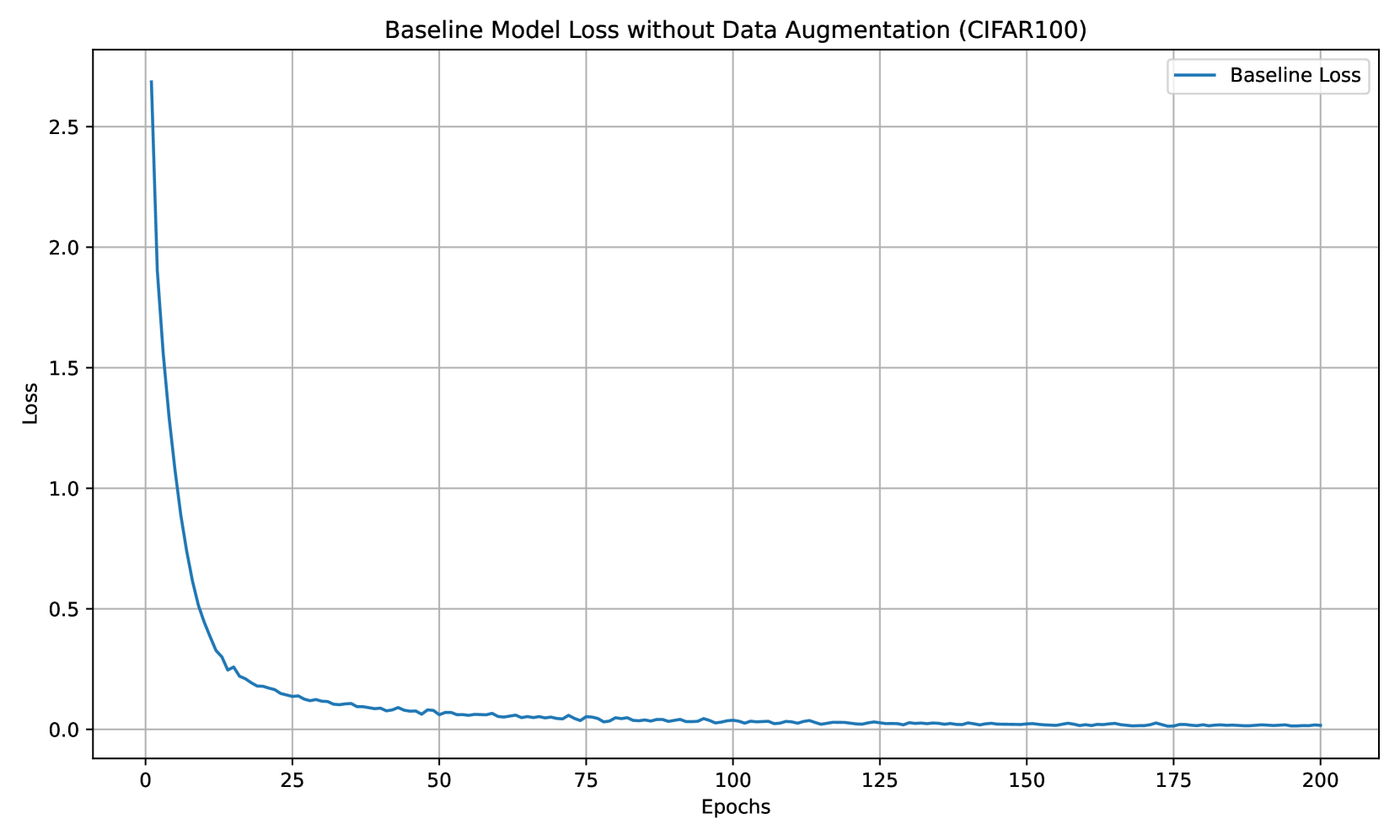

实验结果表明,在CIFAR-100数据集上,使用ResNet-18作为骨干网络,该方法在快速梯度符号方法(FGSM)攻击下,显著提高了模型的对抗准确性。与传统的对抗训练方法相比,该方法能够在保持模型泛化能力的同时,更有效地提高模型的鲁棒性。具体的性能提升数据在论文中进行了详细的展示。

🎯 应用场景

该研究成果可应用于各种安全攸关的应用场景,例如自动驾驶、人脸识别、医疗诊断等。通过提高深度神经网络的对抗鲁棒性,可以有效防止恶意攻击,确保系统的安全可靠运行。未来,该方法可以进一步推广到其他类型的深度学习模型和数据集,并与其他防御技术相结合,构建更加完善的对抗防御体系。

📄 摘要(原文)

Adversarial attacks exploit the vulnerabilities of convolutional neural networks by introducing imperceptible perturbations that lead to misclassifications, exposing weaknesses in feature representations and decision boundaries. This paper presents a novel framework combining supervised contrastive learning and margin-based contrastive loss to enhance adversarial robustness. Supervised contrastive learning improves the structure of the feature space by clustering embeddings of samples within the same class and separating those from different classes. Margin-based contrastive loss, inspired by support vector machines, enforces explicit constraints to create robust decision boundaries with well-defined margins. Experiments on the CIFAR-100 dataset with a ResNet-18 backbone demonstrate robustness performance improvements in adversarial accuracy under Fast Gradient Sign Method attacks.