Measuring Cross-Modal Interactions in Multimodal Models

作者: Laura Wenderoth, Konstantin Hemker, Nikola Simidjievski, Mateja Jamnik

分类: cs.LG

发布日期: 2024-12-20 (更新: 2025-01-28)

期刊: Proceedings of the AAAI Conference on Artificial Intelligence, Volume 39, February 2025

DOI: 10.1609/aaai.v39i20.35452

💡 一句话要点

提出InterSHAP,用于量化多模态模型中的跨模态交互,并应用于医疗领域。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 可解释性AI 跨模态交互 Shapley值 医疗AI 模型解释 个性化医疗

📋 核心要点

- 现有XAI方法主要针对单模态模型,无法有效捕捉多模态数据融合中的跨模态交互。

- InterSHAP利用Shapley交互指数,精确量化各模态及其交互作用,无需近似计算。

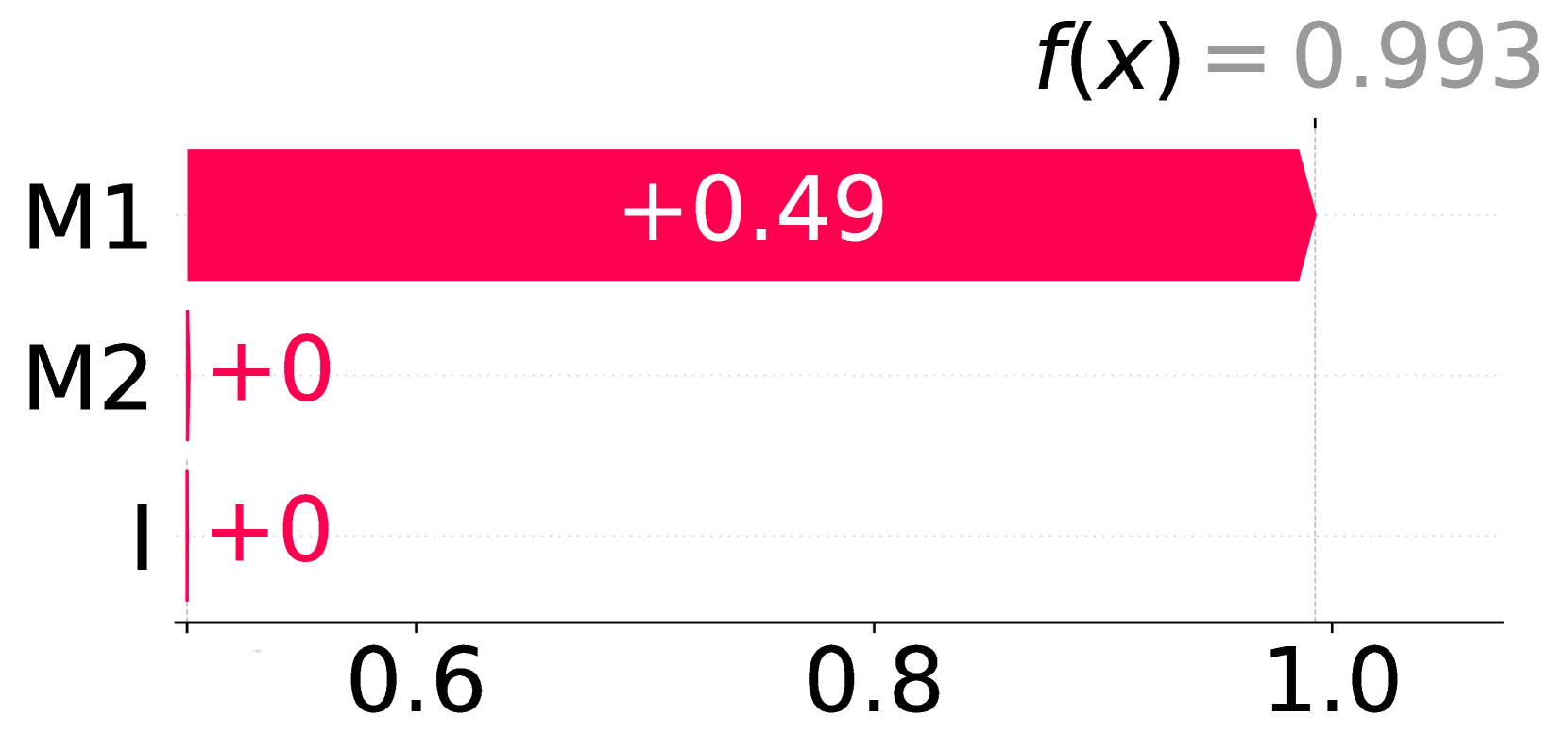

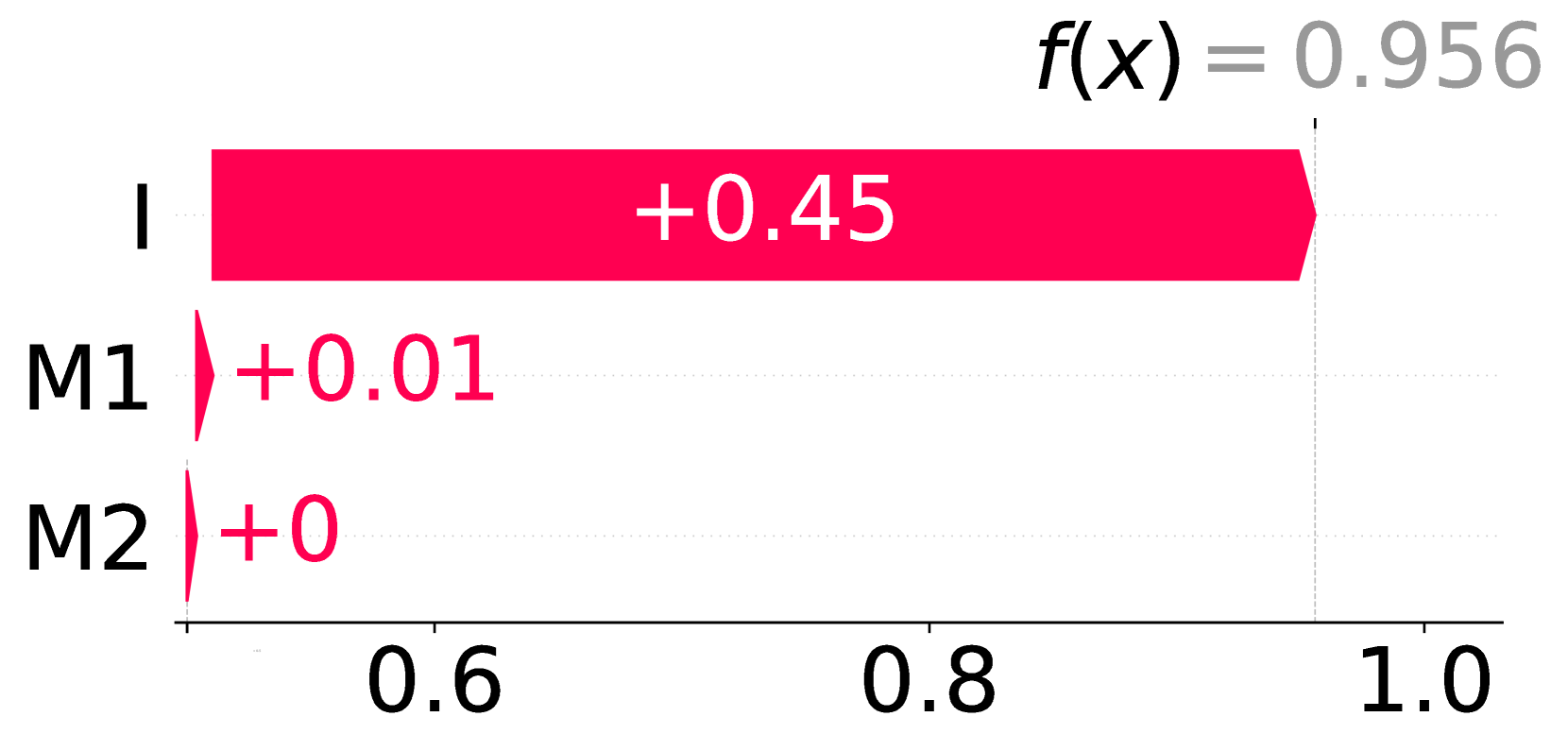

- 实验证明InterSHAP能准确测量跨模态交互,适用于多模态数据,并提供个性化解释。

📝 摘要(中文)

将人工智能集成到医疗保健中可以显著改善患者护理和系统效率。然而,人工智能系统缺乏可解释性(XAI)阻碍了其在临床上的应用,尤其是在使用日益复杂的模型架构的多模态环境中。现有的大多数XAI方法侧重于单模态模型,无法捕捉到对于理解多个数据源的综合影响至关重要的跨模态交互。现有的量化跨模态交互的方法仅限于两种模态,依赖于带标签的数据,并且依赖于模型性能。这在医疗保健领域是有问题的,因为XAI必须处理多个数据源并提供个性化的解释。本文介绍了一种跨模态交互评分InterSHAP,它解决了现有方法的局限性。InterSHAP使用Shapley交互指数来精确地分离和量化各个模态及其交互的贡献,而无需近似。通过将开源实现与SHAP软件包集成,我们增强了可重复性和易用性。我们表明,InterSHAP能够准确地测量跨模态交互的存在,可以处理多种模态,并为单个样本在局部层面提供详细的解释。此外,我们将InterSHAP应用于多模态医疗数据集,并证明了其在个性化解释中的适用性。

🔬 方法详解

问题定义:论文旨在解决多模态模型可解释性问题,特别是如何量化和理解不同模态之间的交互作用。现有方法的痛点在于:1)大多针对单模态模型;2)部分方法仅限于两种模态;3)依赖于带标签数据;4)依赖模型性能,这在医疗等高风险领域是不可接受的。

核心思路:论文的核心思路是利用Shapley交互指数,将多模态模型的预测结果分解为各个模态以及它们之间交互作用的贡献。Shapley值能够公平地分配贡献,并且可以精确地量化模态间的交互,无需任何近似计算。这种方法不依赖于模型性能,也不需要带标签的数据,因此更适用于医疗等复杂场景。

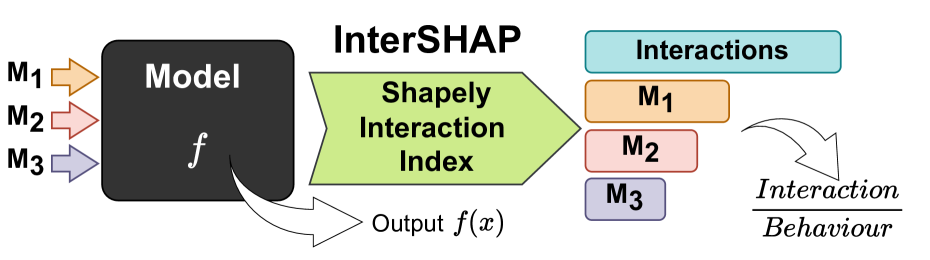

技术框架:InterSHAP的技术框架主要包含以下几个步骤:1)输入多模态数据和训练好的多模态模型;2)使用Shapley交互指数计算每个模态及其交互对模型预测结果的贡献;3)输出每个模态和模态交互的InterSHAP值,用于解释模型行为。论文将InterSHAP的开源实现与SHAP软件包集成,方便用户使用。

关键创新:InterSHAP最重要的技术创新点在于它使用Shapley交互指数来精确量化多模态模型中的跨模态交互。与现有方法相比,InterSHAP能够处理多种模态,不需要带标签的数据,并且不依赖于模型性能。此外,InterSHAP提供局部层面的解释,可以为每个样本提供个性化的解释。

关键设计:InterSHAP的关键设计在于如何有效地计算Shapley交互指数。论文采用了一种高效的计算方法,避免了直接计算所有可能的模态组合,从而降低了计算复杂度。此外,论文还考虑了如何将InterSHAP的结果可视化,以便用户更好地理解模型行为。具体参数设置和网络结构取决于所使用的多模态模型,InterSHAP可以与各种多模态模型结合使用。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了InterSHAP的有效性,证明其能够准确测量跨模态交互的存在,并为单个样本提供详细的解释。在多模态医疗数据集上的实验表明,InterSHAP能够识别出重要的模态交互,并为医生提供有价值的诊断信息。与现有方法相比,InterSHAP具有更高的准确性和更强的可解释性。

🎯 应用场景

InterSHAP在医疗健康领域具有广泛的应用前景,例如辅助医生诊断、预测疾病风险、制定个性化治疗方案等。通过解释多模态医学数据(如影像、基因、临床数据)的交互作用,InterSHAP可以帮助医生更好地理解疾病的发生发展机制,从而提高诊断和治疗的准确性。此外,InterSHAP还可以用于评估AI模型在医疗领域的可靠性和安全性,促进AI技术在医疗领域的应用。

📄 摘要(原文)

Integrating AI in healthcare can greatly improve patient care and system efficiency. However, the lack of explainability in AI systems (XAI) hinders their clinical adoption, especially in multimodal settings that use increasingly complex model architectures. Most existing XAI methods focus on unimodal models, which fail to capture cross-modal interactions crucial for understanding the combined impact of multiple data sources. Existing methods for quantifying cross-modal interactions are limited to two modalities, rely on labelled data, and depend on model performance. This is problematic in healthcare, where XAI must handle multiple data sources and provide individualised explanations. This paper introduces InterSHAP, a cross-modal interaction score that addresses the limitations of existing approaches. InterSHAP uses the Shapley interaction index to precisely separate and quantify the contributions of the individual modalities and their interactions without approximations. By integrating an open-source implementation with the SHAP package, we enhance reproducibility and ease of use. We show that InterSHAP accurately measures the presence of cross-modal interactions, can handle multiple modalities, and provides detailed explanations at a local level for individual samples. Furthermore, we apply InterSHAP to multimodal medical datasets and demonstrate its applicability for individualised explanations.