CLDG: Contrastive Learning on Dynamic Graphs

作者: Yiming Xu, Bin Shi, Teng Ma, Bo Dong, Haoyi Zhou, Qinghua Zheng

分类: cs.LG, cs.AI

发布日期: 2024-12-19

备注: Accepted by ICDE2023

DOI: 10.1109/ICDE55515.2023.00059

💡 一句话要点

提出CLDG框架,通过对比学习动态图中的时间平移不变性,提升无监督节点表示。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 动态图表示学习 对比学习 时间平移不变性 图神经网络 无监督学习

📋 核心要点

- 现有图对比学习方法在动态图上表现不佳,因为图增强可能改变语义和标签,导致下游任务性能下降。

- CLDG框架利用动态图的时间平移不变性,通过采样层提取时间持久信号,保持节点表示的一致性。

- 实验表明,CLDG在多个数据集上超越了现有无监督方法,并显著降低了模型参数和训练时间。

📝 摘要(中文)

本文提出了一种名为CLDG的框架,用于解决动态图表示学习中的问题。现有的图对比学习方法通过最大化图增强视图之间的互信息来构建自监督信号,但增强过程可能导致语义和标签的改变,从而降低下游任务的性能,尤其是在动态图上。CLDG框架利用动态图在不同层次上的时间平移不变性,设计了一个采样层来提取时间持久信号,鼓励节点在时间跨度视图下保持一致的局部和全局表示。实验结果表明,CLDG在七个数据集上优于八个无监督的SOTA基线方法,并与四个半监督方法具有竞争力,同时显著减少了模型参数和训练时间。

🔬 方法详解

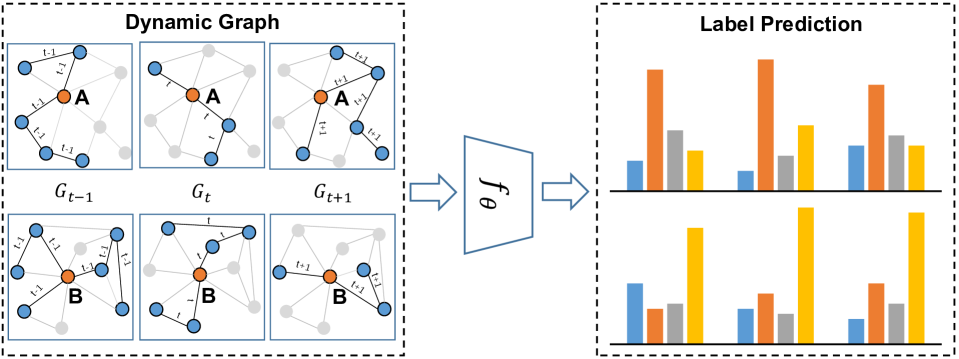

问题定义:现有图对比学习方法在动态图上进行节点表示学习时,由于图结构的动态变化和增强操作引入的噪声,导致学习到的节点表示不稳定,无法有效捕捉节点在时间维度上的演化信息。现有方法难以保证节点在不同时间跨度下的表示一致性,从而影响下游任务的性能。

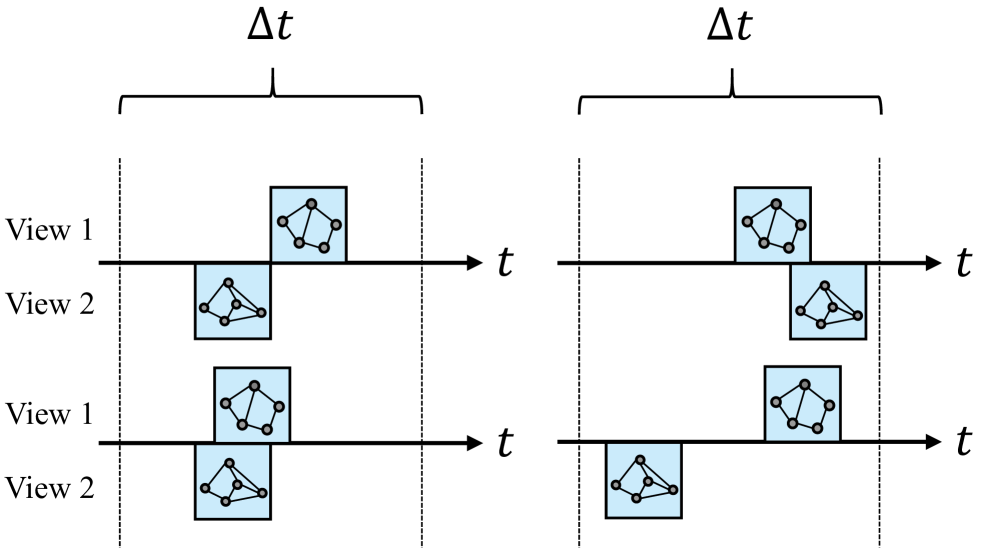

核心思路:CLDG的核心思路是利用动态图的时间平移不变性,即节点在不同时间段内应该保持相对稳定的局部和全局结构关系。通过对比学习,鼓励节点在不同时间跨度下的表示尽可能相似,从而学习到更鲁棒和时间一致的节点表示。

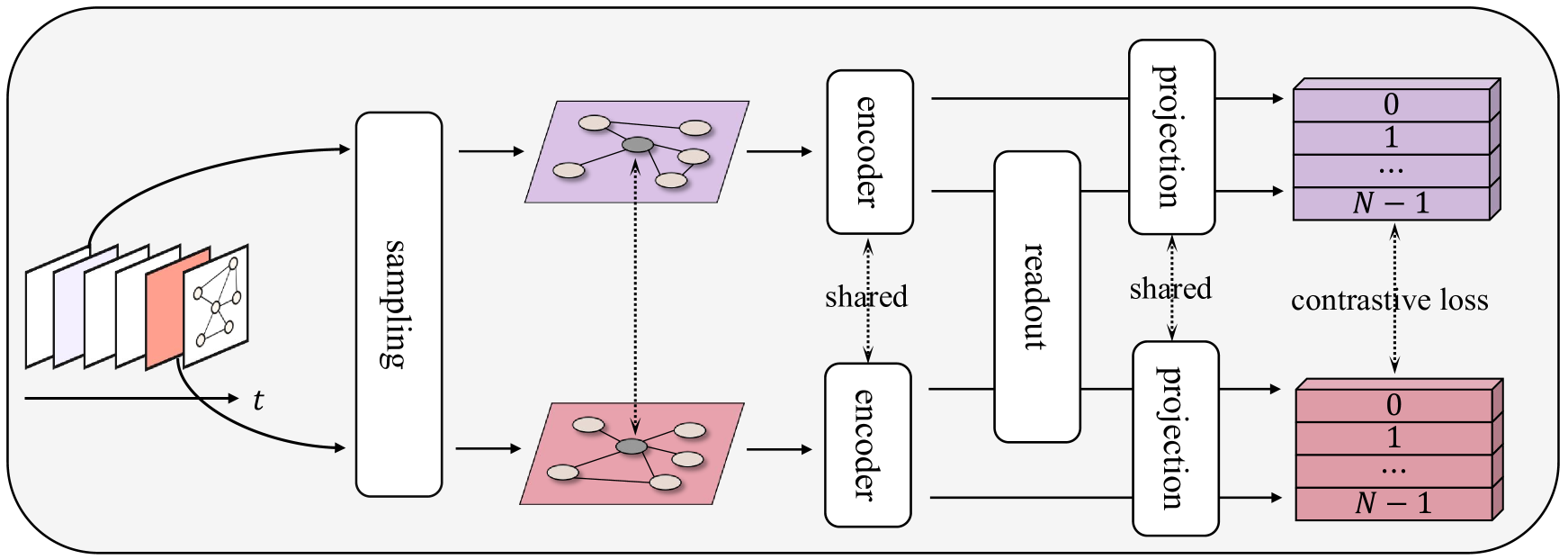

技术框架:CLDG框架主要包含以下几个模块:1) 图数据输入模块:接收动态图数据,包括节点特征和边信息。2) 时间跨度采样层:从动态图中采样不同时间跨度的子图,模拟不同的时间视图。3) 图神经网络编码器:使用GNN对每个时间跨度下的子图进行编码,得到节点表示。4) 对比学习模块:计算不同时间跨度下同一节点的表示之间的相似度,并使用对比损失函数进行优化。

关键创新:CLDG的关键创新在于显式地利用了动态图的时间平移不变性,并通过时间跨度采样层和对比学习模块来实现。与现有方法相比,CLDG更加关注节点在时间维度上的稳定性,从而能够学习到更具泛化能力的节点表示。

关键设计:时间跨度采样层通过随机采样不同长度的时间窗口来模拟不同的时间视图。对比损失函数采用InfoNCE损失,鼓励同一节点在不同时间跨度下的表示尽可能相似,而与其他节点的表示尽可能不同。GNN编码器可以使用多种不同的GNN结构,如GCN、GAT等。具体参数设置需要根据数据集的特点进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CLDG在七个数据集上显著优于八个无监督的SOTA基线方法,并与四个半监督方法具有竞争力。例如,在某些数据集上,CLDG的性能提升超过10%。此外,CLDG还显著减少了模型参数和训练时间,平均减少了2001.86倍的模型参数和130.31倍的训练时间。

🎯 应用场景

CLDG框架可应用于多种动态图相关的任务,如社交网络用户行为分析、金融交易风险预测、交通网络流量预测等。通过学习动态图中节点的稳定表示,可以更好地理解节点在时间维度上的演化规律,从而为各种实际应用提供更准确的预测和决策支持。该研究对于提升动态图数据的利用价值具有重要意义。

📄 摘要(原文)

The graph with complex annotations is the most potent data type, whose constantly evolving motivates further exploration of the unsupervised dynamic graph representation. One of the representative paradigms is graph contrastive learning. It constructs self-supervised signals by maximizing the mutual information between the statistic graph's augmentation views. However, the semantics and labels may change within the augmentation process, causing a significant performance drop in downstream tasks. This drawback becomes greatly magnified on dynamic graphs. To address this problem, we designed a simple yet effective framework named CLDG. Firstly, we elaborate that dynamic graphs have temporal translation invariance at different levels. Then, we proposed a sampling layer to extract the temporally-persistent signals. It will encourage the node to maintain consistent local and global representations, i.e., temporal translation invariance under the timespan views. The extensive experiments demonstrate the effectiveness and efficiency of the method on seven datasets by outperforming eight unsupervised state-of-the-art baselines and showing competitiveness against four semi-supervised methods. Compared with the existing dynamic graph method, the number of model parameters and training time is reduced by an average of 2,001.86 times and 130.31 times on seven datasets, respectively.