CRVQ: Channel-Relaxed Vector Quantization for Extreme Compression of LLMs

作者: Yuzhuang Xu, Shiyu Ji, Qingfu Zhu, Wanxiang Che

分类: cs.LG, cs.CL

发布日期: 2024-12-12 (更新: 2025-02-19)

备注: 7 figures, 8 tables

💡 一句话要点

提出通道松弛向量量化CRVQ,用于大语言模型极限压缩。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 后训练量化 模型压缩 向量量化 通道选择

📋 核心要点

- 大语言模型部署成本高昂,现有后训练量化方法在极限压缩下性能损失严重。

- CRVQ通过选择关键通道并使用扩展码本松弛约束,在极低比特量化下提升模型性能。

- 实验表明,CRVQ在亚2比特量化下性能提升显著,接近无损1比特压缩,并支持灵活的比特宽度定制。

📝 摘要(中文)

本文提出了一种名为通道松弛向量量化(CRVQ)的新技术,旨在显著提升后训练量化(PTQ)基线方法的性能,同时仅需极少的额外比特。这种先进的极限压缩方法通过两个关键创新实现其性能:(1) 精心选择和重新排序一小部分关键权重通道;(2) 利用扩展码本放松对关键通道的约束。实验结果表明,CRVQ方法比当前最强的亚2比特PTQ基线提高了38.9%,实现了接近无损的1比特压缩。此外,该方法还提供了量化比特宽度和性能的灵活定制,为各种硬件平台提供了更广泛的部署选项。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)在资源受限设备上的部署问题。现有的后训练量化(PTQ)方法在进行极端压缩(例如低于2比特)时,模型性能会显著下降,难以满足实际应用需求。因此,如何在保持模型性能的同时,进一步降低LLM的存储和计算成本,是本文要解决的核心问题。

核心思路:CRVQ的核心思路是,并非所有权重通道都对模型性能同等重要,因此可以区别对待。通过识别并重点保护少量关键通道,并对这些通道采用更宽松的量化约束(即使用更大的码本),从而在整体压缩率不变的情况下,提升模型性能。这种“区别对待”的思想是CRVQ能够实现高性能极限压缩的关键。

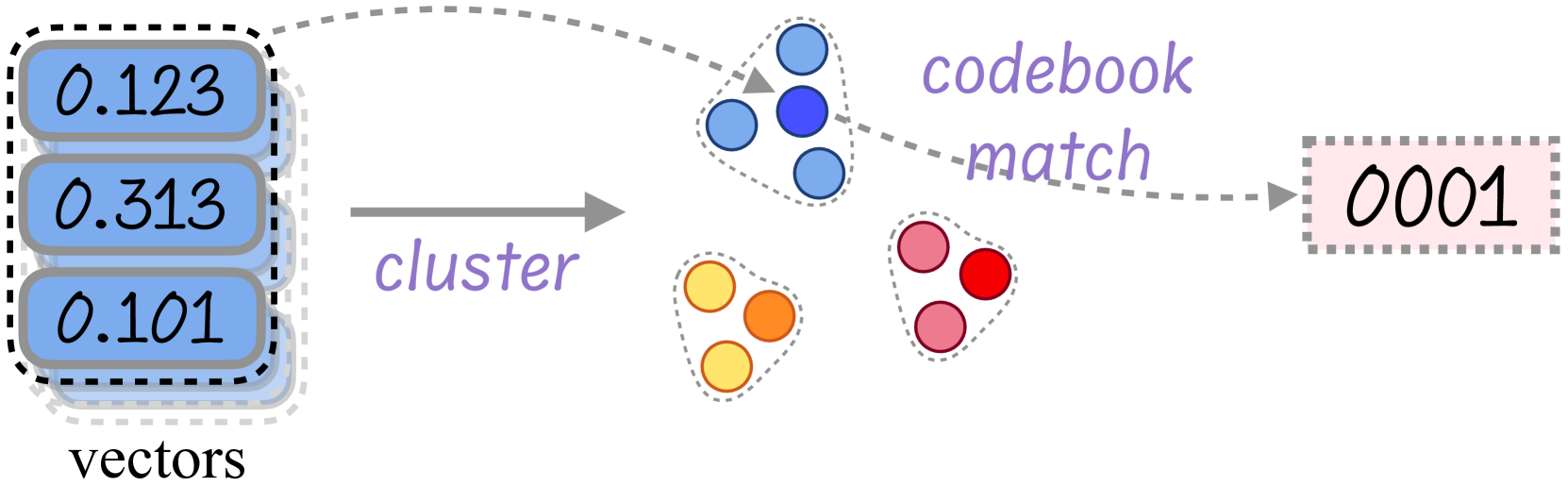

技术框架:CRVQ的整体框架包含以下几个主要步骤:1) 通道选择:首先,通过某种策略(论文中未明确说明具体策略,属于未知信息)选择一小部分对模型性能影响最大的关键权重通道。2) 通道重排序:将选择的关键通道重新排列,以便后续处理。3) 扩展码本量化:对关键通道使用扩展的码本进行量化,即使用比其他通道更多的比特数或更大的码本容量。4) 标准码本量化:对剩余的非关键通道使用标准的量化方法进行量化。

关键创新:CRVQ的关键创新在于“通道松弛”的概念。它打破了传统PTQ方法对所有权重通道一视同仁的量化方式,而是有选择性地放松对关键通道的量化约束。这种差异化处理使得模型能够在极限压缩下更好地保留关键信息,从而提升整体性能。

关键设计:论文中未详细说明通道选择的具体策略,以及扩展码本的具体设计(例如码本大小、训练方式等),这些属于未知信息。但可以推测,通道选择可能基于某种敏感性分析方法,例如计算每个通道对模型输出的影响。扩展码本的设计可能涉及到更大的码本容量或更精细的量化粒度。

🖼️ 关键图片

📊 实验亮点

CRVQ在亚2比特PTQ基线上实现了38.9%的性能提升,显著优于现有方法。实验结果表明,CRVQ能够实现接近无损的1比特压缩,这对于在资源受限设备上部署大型语言模型具有重要意义。该方法在保持较高压缩率的同时,显著提升了模型性能,为LLM的极限压缩提供了一种新的解决方案。

🎯 应用场景

CRVQ技术可广泛应用于各种资源受限场景下的大语言模型部署,例如移动设备、嵌入式系统和边缘计算设备。通过实现更高的压缩率和更低的计算成本,CRVQ使得LLM能够在这些平台上运行,从而推动人工智能在更广泛领域的应用。此外,CRVQ的灵活比特宽度定制能力,也使其能够适应不同硬件平台的特定需求。

📄 摘要(原文)

Powerful large language models (LLMs) are increasingly expected to be deployed with lower computational costs, enabling their capabilities on resource-constrained devices. Post-training quantization (PTQ) has emerged as a star approach to achieve this ambition, with best methods compressing weights to less than 2 bit on average. In this paper, we propose Channel-Relaxed Vector Quantization (CRVQ), a novel technique that significantly improves the performance of PTQ baselines at the cost of only minimal additional bits. This state-of-the-art extreme compression method achieves its results through two key innovations: (1) carefully selecting and reordering a very small subset of critical weight channels, and (2) leveraging extended codebooks to relax the constraint of critical channels. With our method, we demonstrate a 38.9\% improvement over the current strongest sub-2-bit PTQ baseline, enabling nearer lossless 1-bit compression. Furthermore, our approach offers flexible customization of quantization bit-width and performance, providing a wider range of deployment options for diverse hardware platforms.