A Review of Human Emotion Synthesis Based on Generative Technology

作者: Fei Ma, Yukan Li, Yifan Xie, Ying He, Yi Zhang, Hongwei Ren, Zhou Liu, Wei Yao, Fuji Ren, Fei Richard Yu, Shiguang Ni

分类: cs.LG, cs.AI, cs.CL

发布日期: 2024-12-10

备注: 25 pages, 10 figures

💡 一句话要点

综述性论文:基于生成技术的表情合成研究进展与未来方向

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 情感合成 生成模型 人机交互 面部表情 语音合成 文本情感分析 深度学习 综述

📋 核心要点

- 现有情感合成方法在自然性和多样性方面存在不足,难以捕捉人类情感的细微差别。

- 本文综述了基于生成模型的情感合成方法,涵盖多种模态和模型,旨在提供全面的技术概览。

- 总结了现有方法的优缺点,并提出了未来研究方向,为该领域的研究人员提供参考。

📝 摘要(中文)

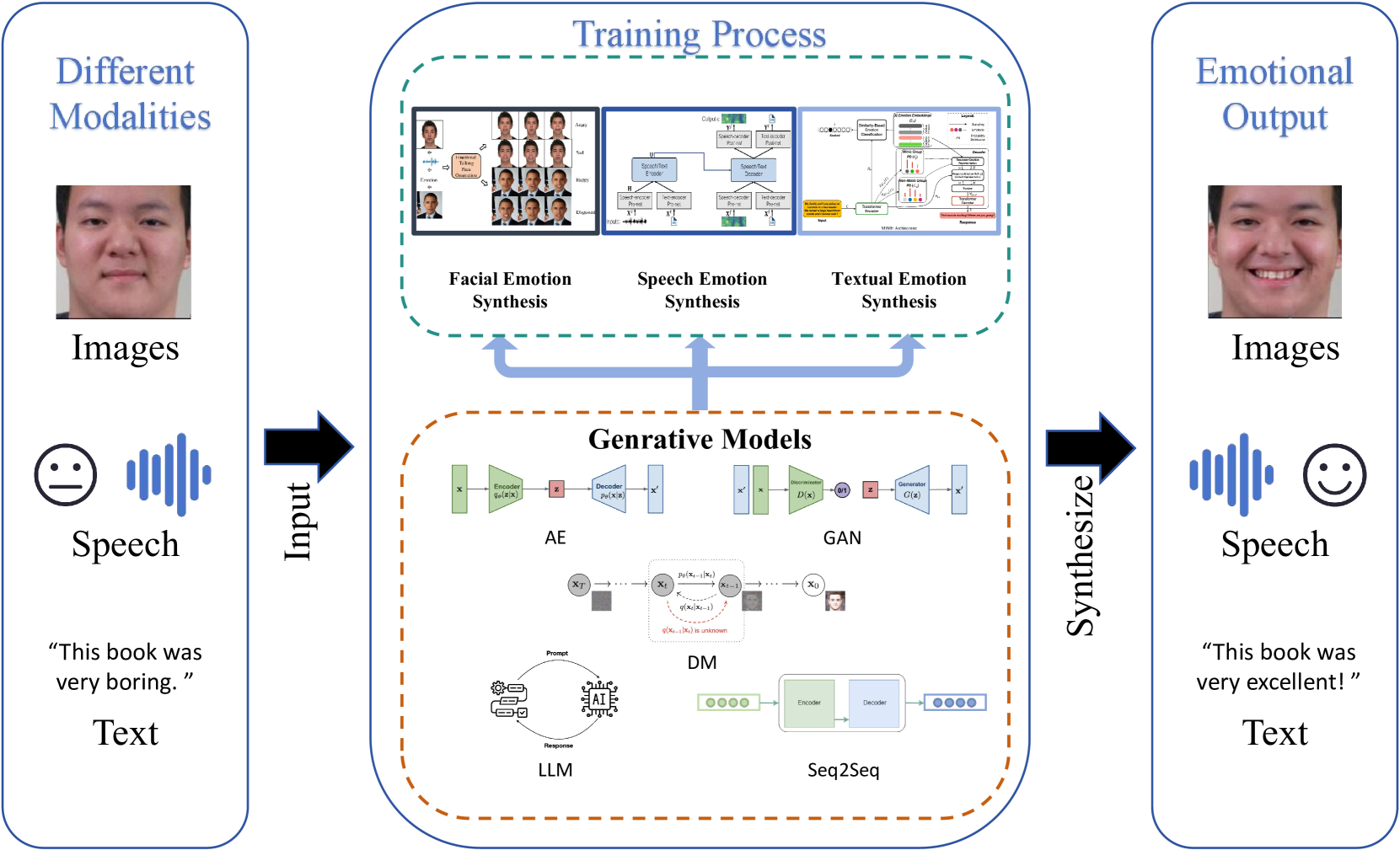

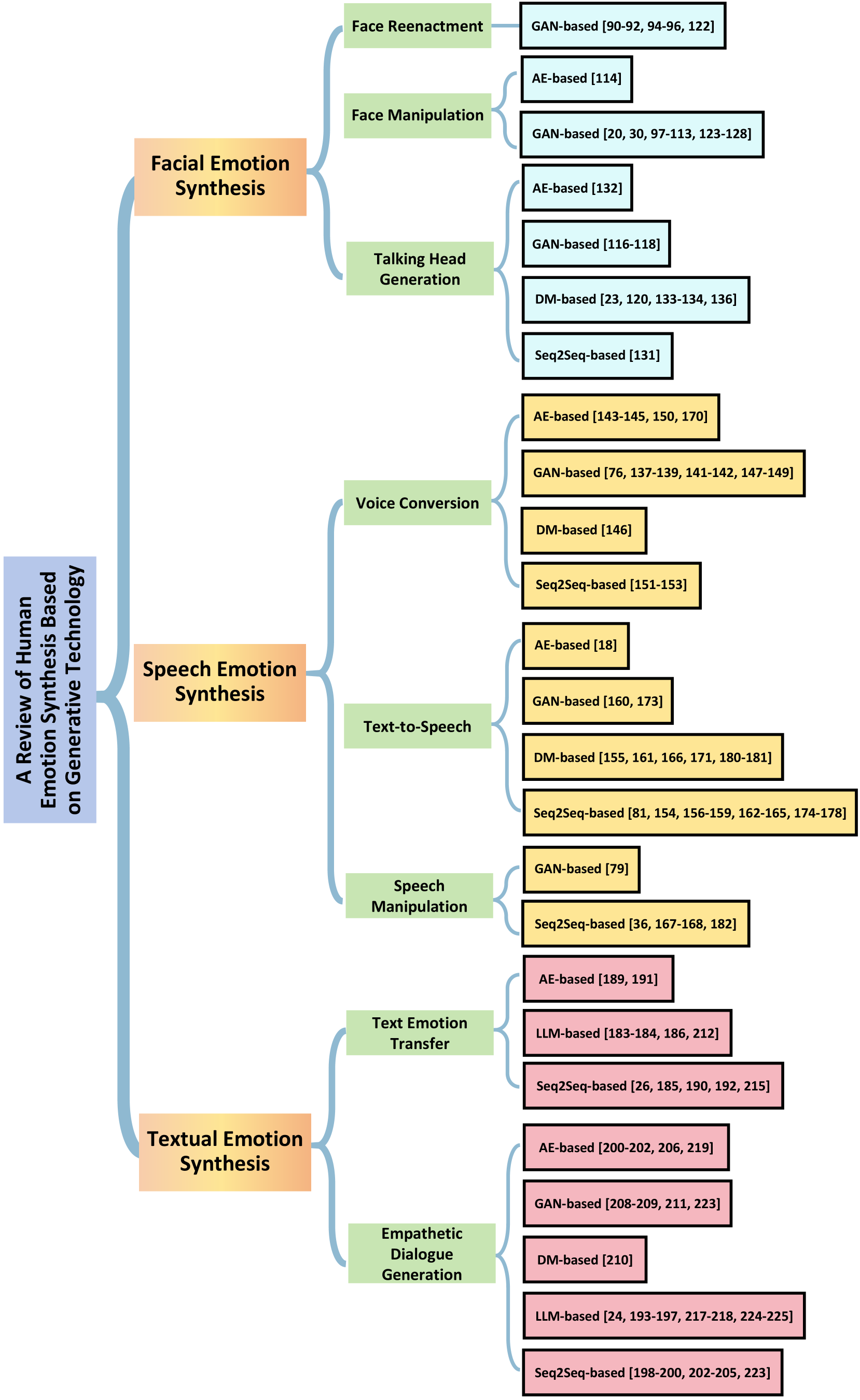

人类情感合成是情感计算的关键组成部分,它涉及使用计算方法通过各种模态来模仿和传达人类情感,旨在实现更自然和有效的人机交互。近年来,自编码器、生成对抗网络、扩散模型、大型语言模型和序列到序列模型等生成模型的进步,极大地促进了该领域的发展。然而,目前该领域缺乏全面的综述。为了解决这个问题,本文旨在通过对基于生成模型的人类情感合成的最新进展进行全面和系统的概述来填补这一空白。具体来说,本综述将首先介绍综述方法、涉及的情感模型、生成模型的数学原理以及使用的数据集。然后,本综述涵盖了不同生成模型在基于面部图像、语音和文本等多种模态的情感合成中的应用。它还考察了主流的评估指标。此外,本综述还提出了一些主要发现,并提出了未来的研究方向,从而全面了解生成技术在情感合成这一细微领域中的作用。

🔬 方法详解

问题定义:论文旨在解决人类情感合成领域缺乏全面综述的问题。现有情感合成方法在生成情感的自然性、多样性和细微性方面存在不足,难以满足日益增长的人机交互需求。此外,不同模态(如面部图像、语音和文本)的情感合成方法缺乏统一的框架和评估标准。

核心思路:论文的核心思路是对近年来基于生成模型的情感合成方法进行系统性的梳理和总结。通过分析不同生成模型(如自编码器、GAN、扩散模型等)在不同模态情感合成中的应用,揭示其优势和局限性,并探讨未来研究方向。

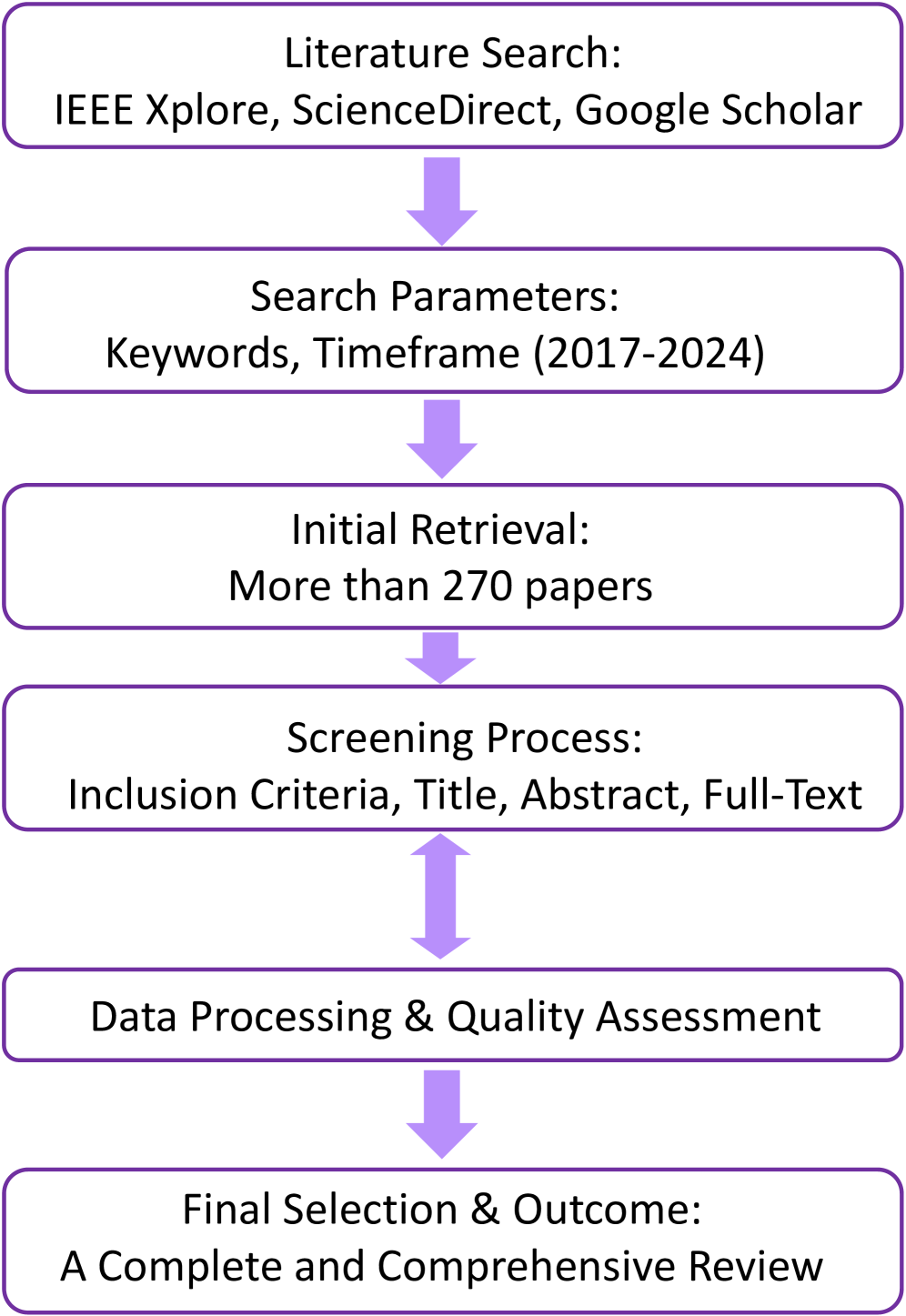

技术框架:论文首先介绍情感模型、生成模型的数学原理和常用数据集。然后,分别针对面部图像、语音和文本等模态,详细阐述了各种生成模型在情感合成中的应用,包括模型结构、训练方法和损失函数设计。最后,讨论了主流的评估指标,并对未来研究方向进行了展望。

关键创新:该论文的主要创新在于提供了一个全面、系统的基于生成技术的人类情感合成综述。它不仅涵盖了多种模态和生成模型,还深入探讨了各种方法的优缺点,并提出了未来研究方向,为该领域的研究人员提供了一个有价值的参考。

关键设计:论文的关键设计在于其结构化的组织方式,首先介绍基础知识,然后分别针对不同模态和生成模型进行详细阐述,最后进行总结和展望。这种结构化的方式使得读者能够快速了解该领域的整体情况,并找到自己感兴趣的研究方向。论文还详细介绍了各种生成模型的数学原理和常用数据集,为读者深入研究提供了便利。

🖼️ 关键图片

📊 实验亮点

该综述论文总结了近年来基于生成模型的情感合成研究进展,涵盖了多种模态(面部图像、语音、文本)和生成模型(自编码器、GAN、扩散模型等)。论文分析了不同方法的优缺点,并提出了未来研究方向,为该领域的研究人员提供了有价值的参考。虽然没有提供具体的性能数据,但该综述为后续研究奠定了基础。

🎯 应用场景

该研究成果可应用于人机交互、虚拟现实、游戏、心理治疗等领域。更自然的情感合成技术能够提升用户体验,增强人机交互的真实感和沉浸感。例如,在虚拟现实中,可以根据用户的表情和语音实时生成虚拟角色的情感反应,从而创造更具吸引力的体验。在心理治疗中,可以利用情感合成技术帮助患者识别和表达自己的情感。

📄 摘要(原文)

Human emotion synthesis is a crucial aspect of affective computing. It involves using computational methods to mimic and convey human emotions through various modalities, with the goal of enabling more natural and effective human-computer interactions. Recent advancements in generative models, such as Autoencoders, Generative Adversarial Networks, Diffusion Models, Large Language Models, and Sequence-to-Sequence Models, have significantly contributed to the development of this field. However, there is a notable lack of comprehensive reviews in this field. To address this problem, this paper aims to address this gap by providing a thorough and systematic overview of recent advancements in human emotion synthesis based on generative models. Specifically, this review will first present the review methodology, the emotion models involved, the mathematical principles of generative models, and the datasets used. Then, the review covers the application of different generative models to emotion synthesis based on a variety of modalities, including facial images, speech, and text. It also examines mainstream evaluation metrics. Additionally, the review presents some major findings and suggests future research directions, providing a comprehensive understanding of the role of generative technology in the nuanced domain of emotion synthesis.