Hyper: Hyperparameter Robust Efficient Exploration in Reinforcement Learning

作者: Yiran Wang, Chenshu Liu, Yunfan Li, Sanae Amani, Bolei Zhou, Lin F. Yang

分类: cs.LG, stat.ML

发布日期: 2024-12-04

备注: arXiv admin note: text overlap with arXiv:1907.05388 by other authors

💡 一句话要点

提出Hyper算法,解决强化学习中探索策略对超参数敏感的问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 探索策略 超参数鲁棒性 好奇心驱动 正则化 函数逼近 智能体行为分析

📋 核心要点

- 基于好奇心的探索方法在强化学习中表现出色,但对超参数敏感,需要大量调参,限制了其应用。

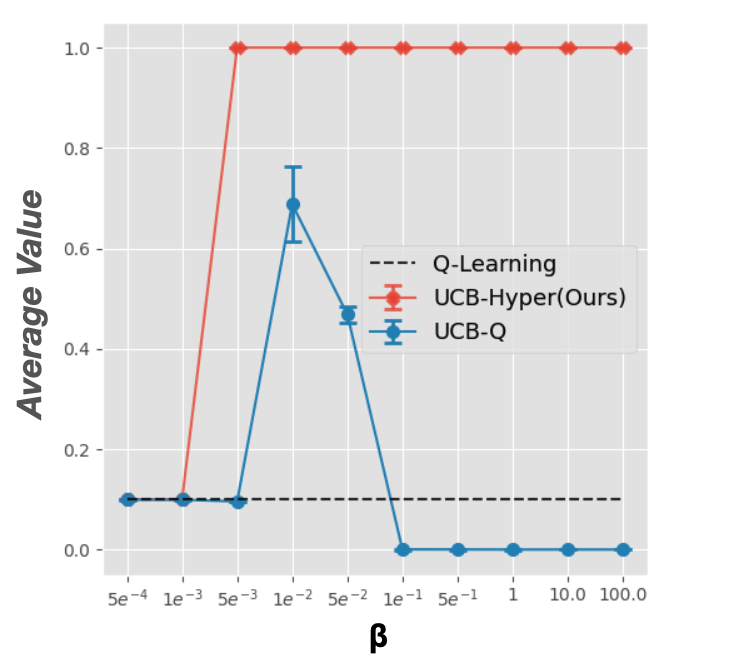

- Hyper算法通过规范探索过程中的访问行为,并解耦利用过程,从而实现更稳定的训练和超参数鲁棒性。

- 理论分析证明Hyper算法在函数逼近下是有效的,实验结果表明其在多种环境中具有优越的性能和鲁棒性。

📝 摘要(中文)

探索与利用的困境是强化学习(RL)中一个重要的挑战。近年来,基于好奇心的探索方法在解决困难的探索问题上取得了显著的成功。然而,这些方法需要在不同的环境中进行大量的超参数调整,这严重限制了此类方法的适用性和可访问性。本文通过分析智能体的行为来描述这个问题,得出选择合适的超参数的根本困难。然后,我们识别了智能体在好奇心驱动下学习时的优化困难和不稳定性。我们提出了超参数鲁棒探索(Hyper)方法,通过有效地规范探索的访问和解耦利用来减轻这个问题,确保稳定的训练。我们从理论上证明了Hyper在函数逼近设置下是可证明有效的,并通过实验证明了其在各种环境中的吸引人的性能和鲁棒性。

🔬 方法详解

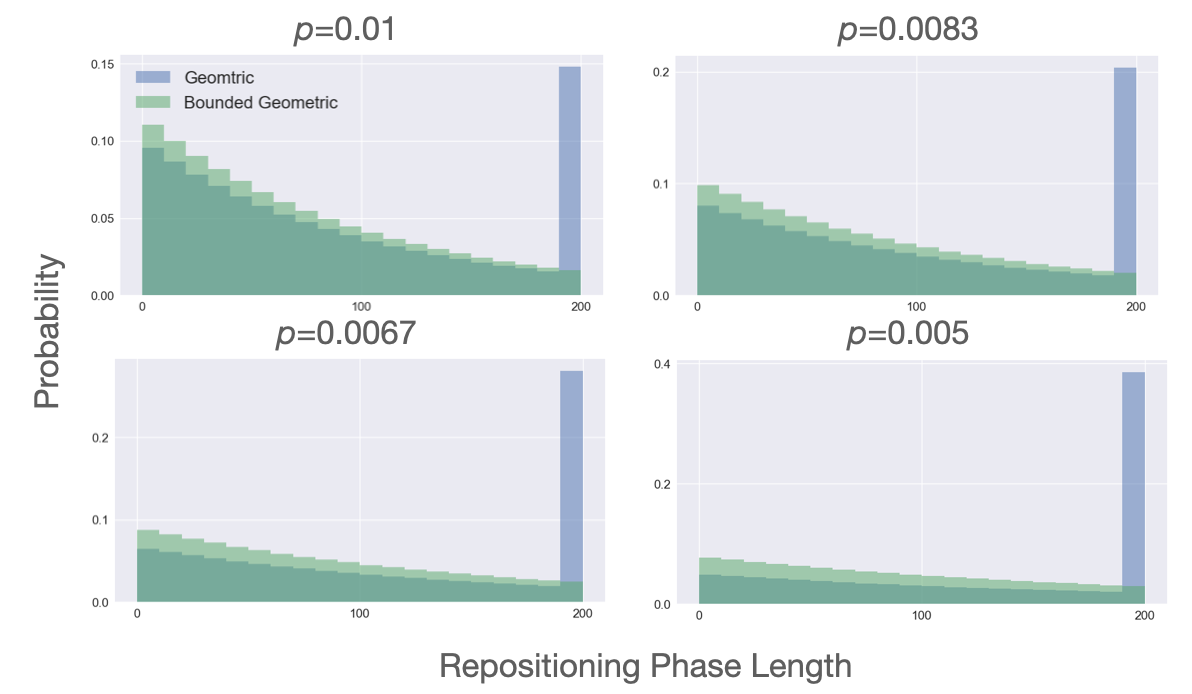

问题定义:强化学习中,基于好奇心的探索方法虽然在解决困难探索问题上表现出色,但其性能对超参数的选择非常敏感。不同的环境需要不同的超参数设置,这使得此类方法难以应用,需要大量的人工调参,成本很高。现有方法缺乏超参数的鲁棒性,难以泛化到新的环境。

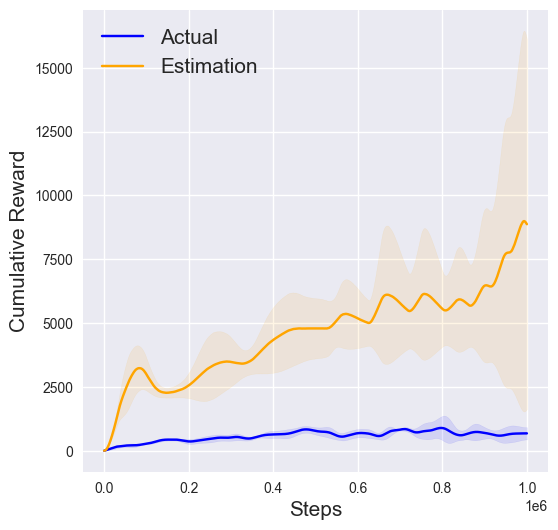

核心思路:Hyper算法的核心思路是通过正则化探索过程中的状态访问频率,以及解耦探索和利用两个阶段,来降低算法对超参数的敏感性。通过限制智能体对某些状态的过度访问,避免了因好奇心驱动而导致的局部最优。同时,将探索和利用解耦,使得利用阶段的策略学习更加稳定。

技术框架:Hyper算法主要包含两个关键模块:一是探索正则化模块,用于规范智能体对状态的访问频率;二是探索-利用解耦模块,用于分离探索和利用阶段的学习过程。整体流程是,智能体首先通过正则化的探索策略与环境交互,收集经验数据。然后,利用收集到的数据,分别训练探索策略和利用策略。在训练利用策略时,会考虑探索策略的影响,从而保证训练的稳定性。

关键创新:Hyper算法的关键创新在于其超参数鲁棒性。通过正则化状态访问和解耦探索-利用,算法能够适应不同的环境,而无需进行大量的超参数调整。这与传统的基于好奇心的探索方法形成了鲜明对比,后者通常需要针对每个环境进行精细的超参数调整。

关键设计:在探索正则化模块中,论文可能使用了某种形式的熵正则化或KL散度正则化,以限制状态访问频率的分布。在探索-利用解耦模块中,可能使用了不同的损失函数或网络结构,分别优化探索策略和利用策略。具体的参数设置和网络结构细节未知,需要参考论文原文。

🖼️ 关键图片

📊 实验亮点

论文提出的Hyper算法在多个强化学习环境中取得了显著的性能提升,尤其是在那些需要复杂探索策略的环境中。具体的性能数据和对比基线未知,但摘要强调了其在各种环境中的吸引人的性能和鲁棒性,表明Hyper算法在超参数鲁棒性方面优于现有方法。

🎯 应用场景

Hyper算法具有广泛的应用前景,尤其是在需要智能体自主探索未知环境的场景中,例如机器人导航、游戏AI、自动驾驶等。其超参数鲁棒性使得智能体能够快速适应新的环境,降低了人工干预的需求。该研究有助于推动强化学习在实际应用中的普及。

📄 摘要(原文)

The exploration \& exploitation dilemma poses significant challenges in reinforcement learning (RL). Recently, curiosity-based exploration methods achieved great success in tackling hard-exploration problems. However, they necessitate extensive hyperparameter tuning on different environments, which heavily limits the applicability and accessibility of this line of methods. In this paper, we characterize this problem via analysis of the agent behavior, concluding the fundamental difficulty of choosing a proper hyperparameter. We then identify the difficulty and the instability of the optimization when the agent learns with curiosity. We propose our method, hyperparameter robust exploration (\textbf{Hyper}), which extensively mitigates the problem by effectively regularizing the visitation of the exploration and decoupling the exploitation to ensure stable training. We theoretically justify that \textbf{Hyper} is provably efficient under function approximation setting and empirically demonstrate its appealing performance and robustness in various environments.