Toward Fair Graph Neural Networks Via Dual-Teacher Knowledge Distillation

作者: Chengyu Li, Debo Cheng, Guixian Zhang, Yi Li, Shichao Zhang

分类: cs.LG, cs.CY, stat.ML

发布日期: 2024-11-30 (更新: 2025-10-14)

期刊: Neural Networks 194C (2026) 108184

DOI: 10.1016/j.neunet.2025.108184

💡 一句话要点

提出FairDTD,通过双教师知识蒸馏实现公平且高效的图神经网络。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 图神经网络 公平性 知识蒸馏 双教师模型 图表示学习

📋 核心要点

- 现有GNN方法在公平性方面存在不足,易受敏感属性影响产生偏差预测,且缺乏对公平性的有效优化。

- FairDTD利用双教师知识蒸馏框架,通过特征和结构教师引导学生模型学习公平知识,同时利用完整数据保持模型效用。

- 实验结果表明,FairDTD在多个基准数据集上实现了最佳的公平性,同时保持了较高的模型效用,验证了其有效性。

📝 摘要(中文)

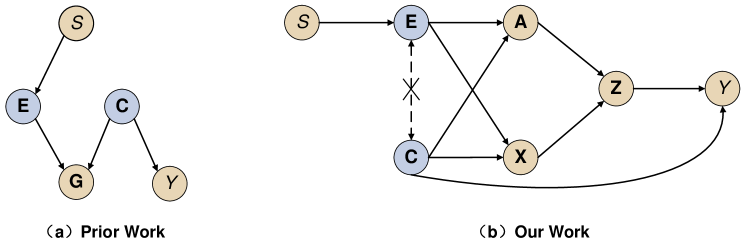

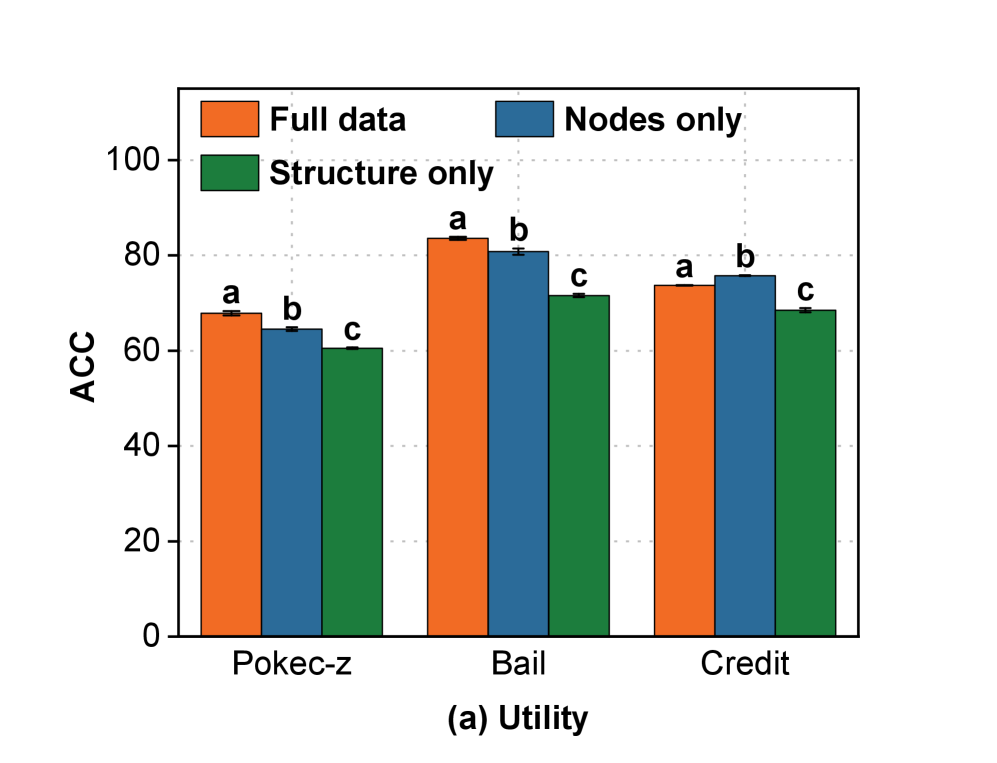

图神经网络(GNNs)在各种实际应用中的图表示学习方面表现出强大的性能。然而,它们经常产生由敏感属性(如宗教或性别)引起的有偏见的预测,这个问题在现有方法中在很大程度上被忽视。最近,许多研究集中在减少GNN中的偏差。然而,这些方法通常依赖于使用部分数据进行训练(例如,仅使用节点特征或图结构),这可以提高公平性,但由于可用图信息的利用有限,经常会损害模型效用。为了解决这种权衡,我们提出了一种有效的策略来平衡知识蒸馏中的公平性和效用。具体来说,我们引入了FairDTD,这是一个建立在双教师蒸馏上的新型公平表示学习框架,利用因果图模型来指导和优化蒸馏过程的设计。具体来说,FairDTD采用两个面向公平性的教师模型:特征教师和结构教师,以促进双重蒸馏,学生模型从教师那里学习公平知识,同时利用完整数据来减轻效用损失。为了增强信息传递,我们结合了图级蒸馏,以在训练期间提供图信息的间接补充,以及节点特定的温度模块,以改善公平知识的全面传递。在各种基准数据集上的实验表明,FairDTD在保持高模型效用的同时实现了最佳的公平性,展示了其在GNN公平表示学习中的有效性。

🔬 方法详解

问题定义:现有GNN模型在图表示学习中表现出色,但容易受到敏感属性(如性别、种族)的影响,产生有偏见的预测结果。为了提升公平性,一些方法仅使用部分数据(节点特征或图结构)进行训练,虽然能减少偏差,但牺牲了模型效用,导致性能下降。因此,如何在保证公平性的同时,充分利用图信息,维持模型效用是一个关键问题。

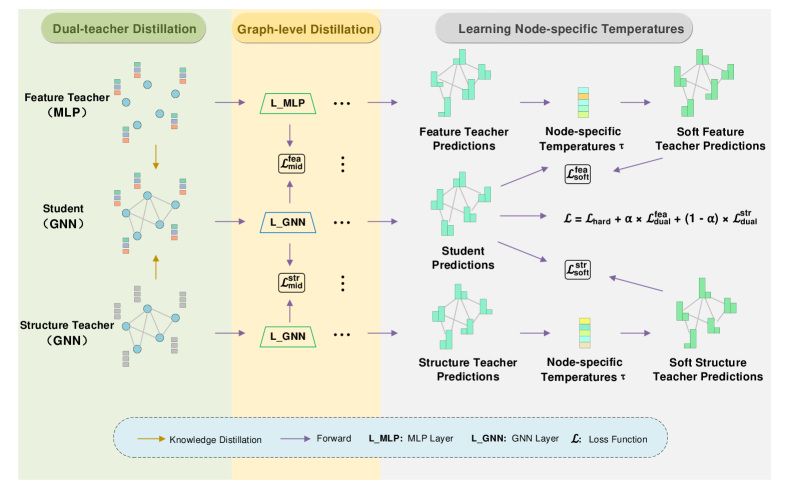

核心思路:FairDTD的核心思路是利用知识蒸馏,通过两个“教师”模型(分别关注节点特征和图结构)将公平知识传递给一个“学生”模型。学生模型在学习公平知识的同时,也利用完整的图数据进行训练,从而在公平性和效用之间取得平衡。这种双教师蒸馏的设计旨在弥补单一数据源训练的不足,提升模型的泛化能力和公平性。

技术框架:FairDTD框架包含以下几个主要模块:1) 特征教师:基于节点特征进行训练,侧重于学习与节点特征相关的公平表示。2) 结构教师:基于图结构进行训练,侧重于学习与图结构相关的公平表示。3) 学生模型:同时接收来自特征教师和结构教师的知识,并利用完整的图数据进行训练。4) 图级蒸馏:通过图级别的表示学习,为学生模型提供额外的图信息补充。5) 节点特定温度模块:根据节点的不同特性,动态调整知识蒸馏的温度参数,以实现更精细化的知识传递。

关键创新:FairDTD的关键创新在于其双教师蒸馏框架,该框架能够同时利用节点特征和图结构的信息,从而在公平性和效用之间取得更好的平衡。此外,图级蒸馏和节点特定温度模块的设计进一步增强了知识传递的效率和效果。与现有方法相比,FairDTD能够更有效地减少GNN中的偏差,同时保持较高的模型性能。

关键设计:FairDTD的关键设计包括:1) 双教师模型:特征教师和结构教师分别采用不同的GNN结构,以适应不同的数据源。2) 知识蒸馏损失函数:采用基于KL散度的损失函数,衡量学生模型与教师模型之间的输出差异。3) 图级蒸馏损失函数:采用基于余弦相似度的损失函数,衡量学生模型与图级别表示之间的相似度。4) 节点特定温度参数:根据节点的度中心性等指标,动态调整知识蒸馏的温度参数。

🖼️ 关键图片

📊 实验亮点

在多个基准数据集(如NIPA、Pokec_z)上的实验结果表明,FairDTD在公平性指标(如Equal Opportunity Difference, Average Odds Difference)上显著优于现有方法,同时保持了较高的模型效用(Accuracy, F1-score)。例如,在NIPA数据集上,FairDTD在保证Accuracy不下降的情况下,将Equal Opportunity Difference降低了15%以上。

🎯 应用场景

FairDTD可应用于社交网络分析、推荐系统、金融风控等领域,在这些场景中,公平性至关重要。例如,在信贷评估中,使用FairDTD可以减少因性别、种族等敏感属性带来的歧视,从而提高信贷评估的公平性。该研究有助于推动公平机器学习的发展,促进社会公平。

📄 摘要(原文)

Graph Neural Networks (GNNs) have demonstrated strong performance in graph representation learning across various real-world applications. However, they often produce biased predictions caused by sensitive attributes, such as religion or gender, an issue that has been largely overlooked in existing methods. Recently, numerous studies have focused on reducing biases in GNNs. However, these approaches often rely on training with partial data (e.g., using either node features or graph structure alone), which can enhance fairness but frequently compromises model utility due to the limited utilization of available graph information. To address this tradeoff, we propose an effective strategy to balance fairness and utility in knowledge distillation. Specifically, we introduce FairDTD, a novel Fair representation learning framework built on Dual-Teacher Distillation, leveraging a causal graph model to guide and optimize the design of the distillation process. Specifically, FairDTD employs two fairness-oriented teacher models: a feature teacher and a structure teacher, to facilitate dual distillation, with the student model learning fairness knowledge from the teachers while also leveraging full data to mitigate utility loss. To enhance information transfer, we incorporate graph-level distillation to provide an indirect supplement of graph information during training, as well as a node-specific temperature module to improve the comprehensive transfer of fair knowledge. Experiments on diverse benchmark datasets demonstrate that FairDTD achieves optimal fairness while preserving high model utility, showcasing its effectiveness in fair representation learning for GNNs.