Scalable Multi-Objective Reinforcement Learning with Fairness Guarantees using Lorenz Dominance

作者: Dimitris Michailidis, Willem Röpke, Diederik M. Roijers, Sennay Ghebreab, Fernando P. Santos

分类: cs.LG

发布日期: 2024-11-27

备注: 29 pages

💡 一句话要点

提出基于Lorenz支配的可扩展多目标强化学习算法,保证公平性并应用于交通规划。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多目标强化学习 公平性 Lorenz支配 交通规划 可扩展性

📋 核心要点

- 多目标强化学习在目标数量增加时面临计算复杂性挑战,尤其是在需要考虑公平性时。

- 论文提出使用Lorenz支配来识别公平的策略,并通过λ-Lorenz支配实现灵活的公平性偏好。

- 在真实交通规划环境中,该方法鼓励发现公平策略,并在高维目标空间中优于常见的多目标方法。

📝 摘要(中文)

多目标强化学习(MORL)旨在学习一组策略,以优化多个通常相互冲突的目标之间的权衡。MORL在计算上比单目标RL更复杂,尤其是在目标数量增加时。此外,当目标涉及代理或群体的偏好时,确保公平性在社会上是可取的。本文介绍了一种原则性算法,该算法将公平性纳入MORL,同时提高对多目标问题的可扩展性。我们建议使用Lorenz支配来识别具有公平奖励分配的策略,并引入λ-Lorenz支配来实现灵活的公平性偏好。我们发布了一个新的、大规模的真实世界交通规划环境,并证明我们的方法鼓励发现公平的策略,在两个大城市(西安和阿姆斯特丹)中显示出改进的可扩展性。我们的方法优于常见的多目标方法,尤其是在高维目标空间中。

🔬 方法详解

问题定义:多目标强化学习(MORL)旨在优化多个目标,但当目标数量增加时,计算复杂度显著提高。此外,在涉及多个智能体或群体偏好的场景下,如何保证策略的公平性是一个关键问题。现有方法在处理高维目标空间和保证公平性方面存在不足。

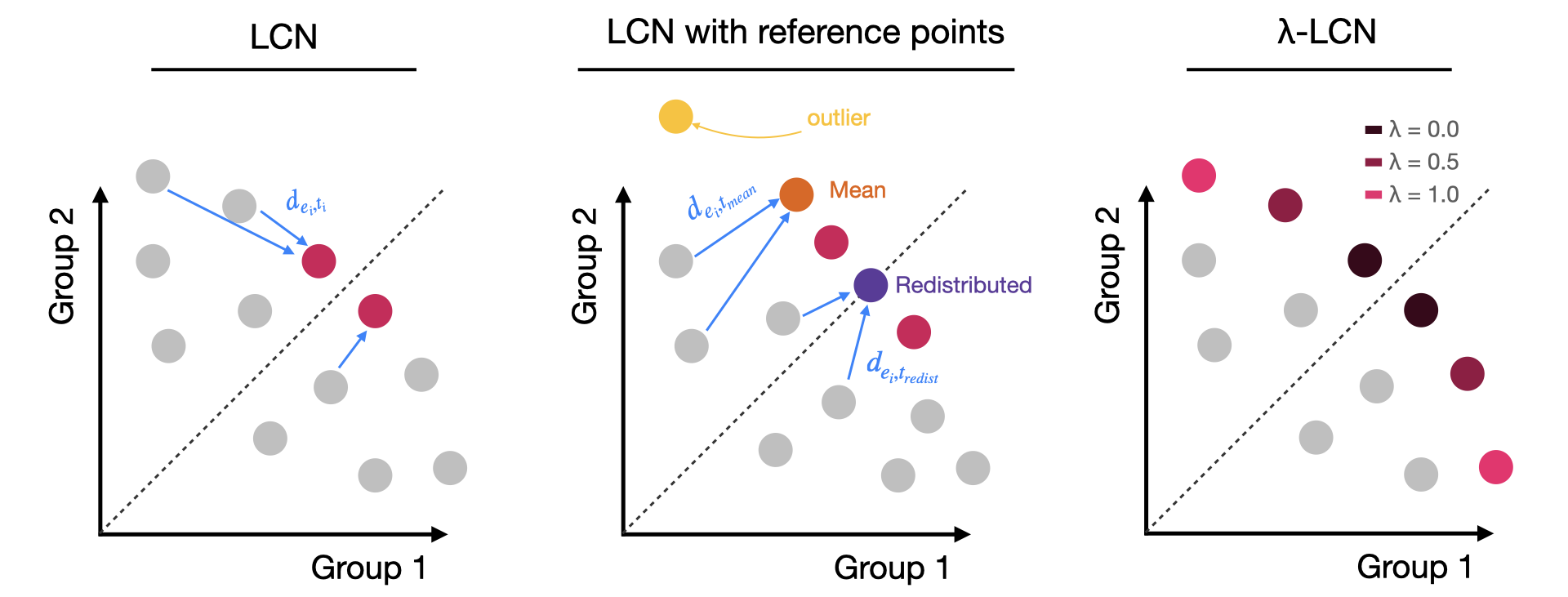

核心思路:论文的核心思路是利用Lorenz支配来评估和选择公平的策略。Lorenz支配是一种衡量收入或奖励分配公平性的方法,它能够识别出奖励分配更公平的策略。通过引入λ-Lorenz支配,可以灵活地调整对公平性的偏好程度,从而在公平性和其他目标之间进行权衡。

技术框架:该方法首先使用MORL算法学习一组策略,然后使用Lorenz支配或λ-Lorenz支配对这些策略进行排序和选择。具体流程包括:1) 使用多目标强化学习算法(如Q-learning或策略梯度方法)学习一组Pareto最优策略;2) 计算每个策略的奖励分配情况;3) 使用Lorenz曲线和Lorenz支配关系来评估和比较不同策略的公平性;4) 根据公平性指标选择最终的策略集合。

关键创新:该论文的关键创新在于将Lorenz支配引入到多目标强化学习中,从而能够显式地考虑和优化策略的公平性。与现有方法相比,该方法能够更好地处理高维目标空间,并提供了一种灵活的方式来调整对公平性的偏好。此外,λ-Lorenz支配的引入允许用户根据实际需求调整公平性约束的严格程度。

关键设计:关键设计包括:1) 使用Lorenz曲线来可视化奖励分配的公平性;2) 定义Lorenz支配关系,用于比较不同策略的公平性;3) 引入λ参数,用于调整对Lorenz支配的敏感度,从而实现灵活的公平性偏好;4) 在多目标强化学习算法中集成Lorenz支配,以便在学习过程中考虑公平性。

🖼️ 关键图片

📊 实验亮点

该方法在真实世界的交通规划环境中进行了验证,并在西安和阿姆斯特丹两个城市中取得了显著成果。实验结果表明,该方法能够有效地发现公平的策略,并在高维目标空间中优于常见的多目标方法。具体来说,该方法在保证公平性的前提下,能够显著提高交通效率,减少拥堵,并改善用户体验。

🎯 应用场景

该研究成果可应用于各种需要考虑公平性的多目标优化问题,例如交通规划、资源分配、医疗保健等。在交通规划中,可以优化交通流量,同时保证不同区域或人群的出行公平性。在资源分配中,可以公平地分配资源,避免资源过度集中在少数群体手中。在医疗保健中,可以优化医疗资源的分配,确保不同人群都能获得公平的医疗服务。

📄 摘要(原文)

Multi-Objective Reinforcement Learning (MORL) aims to learn a set of policies that optimize trade-offs between multiple, often conflicting objectives. MORL is computationally more complex than single-objective RL, particularly as the number of objectives increases. Additionally, when objectives involve the preferences of agents or groups, ensuring fairness is socially desirable. This paper introduces a principled algorithm that incorporates fairness into MORL while improving scalability to many-objective problems. We propose using Lorenz dominance to identify policies with equitable reward distributions and introduce λ-Lorenz dominance to enable flexible fairness preferences. We release a new, large-scale real-world transport planning environment and demonstrate that our method encourages the discovery of fair policies, showing improved scalability in two large cities (Xi'an and Amsterdam). Our methods outperform common multi-objective approaches, particularly in high-dimensional objective spaces.