Umbrella Reinforcement Learning -- computationally efficient tool for hard non-linear problems

作者: Egor E. Nuzhin, Nikolai V. Brilliantov

分类: cs.LG, cs.AI

发布日期: 2024-11-21

DOI: 10.1016/j.cnsns.2024.108583

💡 一句话要点

提出Umbrella强化学习,高效解决具有稀疏奖励的非线性强化学习难题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 伞状抽样 策略梯度 稀疏奖励 集合熵 非线性优化 探索-利用

📋 核心要点

- 传统强化学习方法在解决具有稀疏奖励、状态陷阱等复杂非线性问题时,面临探索效率低下的挑战。

- Umbrella强化学习结合伞状抽样和策略梯度,通过引入集合熵来引导智能体进行更有效的探索。

- 实验表明,该方法在解决困难的强化学习问题时,计算效率和通用性优于现有算法,尤其是在稀疏奖励场景下。

📝 摘要(中文)

本文提出了一种新颖且计算高效的方法,用于解决强化学习(RL)中困难的非线性问题。该方法将计算物理/化学中的伞状抽样(umbrella sampling)与最优控制方法相结合,并基于神经网络和策略梯度实现。在应用于具有稀疏奖励、状态陷阱和缺乏终止状态的困难RL问题时,该方法在计算效率和实现通用性方面优于所有现有的最先进算法。该方法使用一组同时作用的智能体,并修改奖励函数,使其包含集合熵,从而实现最佳的探索-利用平衡。

🔬 方法详解

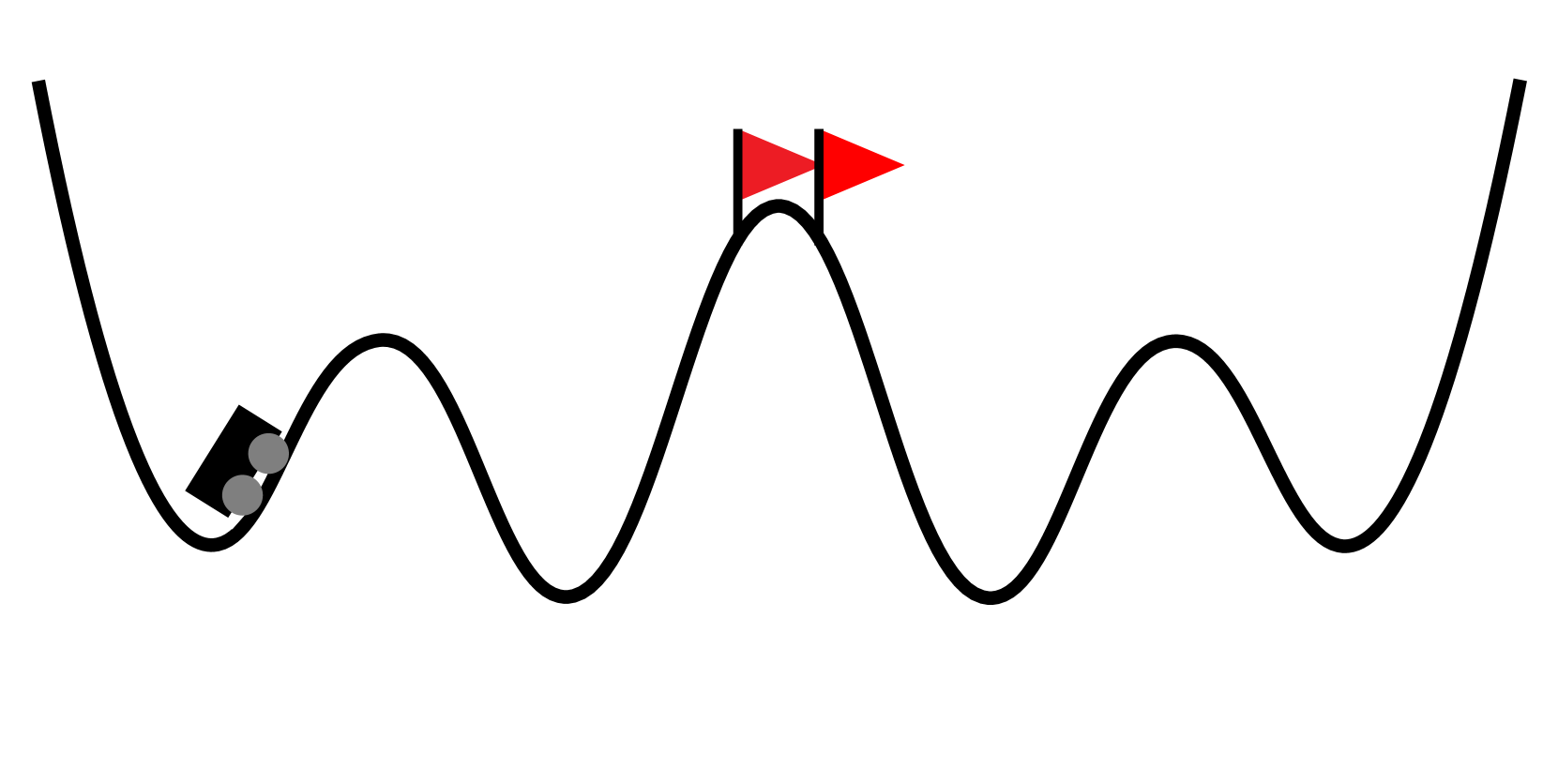

问题定义:论文旨在解决强化学习中一类特殊的难题,即具有稀疏奖励、状态陷阱和缺乏终止状态的非线性问题。传统的强化学习算法在这些场景下,由于难以获得有效的奖励信号,导致探索效率低下,难以找到最优策略。现有方法通常需要大量的计算资源和时间才能收敛,或者容易陷入局部最优解。

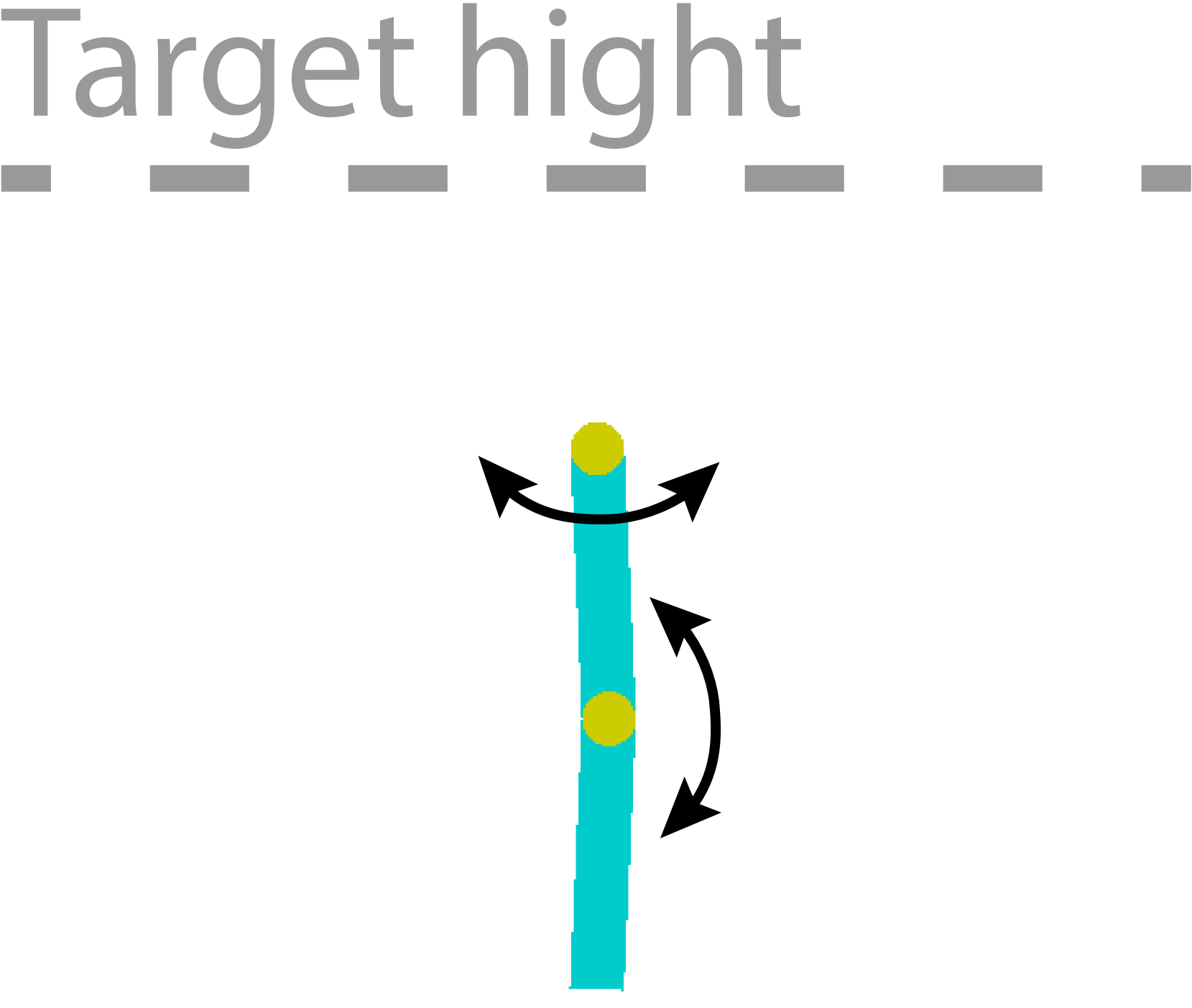

核心思路:论文的核心思路是将计算物理和化学中的伞状抽样(Umbrella Sampling)技术引入到强化学习中。伞状抽样通过修改潜在能量面,使得系统更容易克服能量势垒,从而更有效地探索状态空间。在强化学习中,这意味着通过修改奖励函数,引导智能体探索那些原本难以到达的状态,从而提高探索效率。此外,论文还利用集合熵来平衡探索和利用,避免智能体过早陷入局部最优。

技术框架:Umbrella强化学习的整体框架包括以下几个主要组成部分:1) 一组并行的智能体;2) 基于神经网络的策略梯度算法;3) 修改后的奖励函数,该函数包含原始奖励和集合熵项。智能体通过与环境交互,收集经验数据,并使用策略梯度算法更新神经网络的参数。修改后的奖励函数鼓励智能体探索不同的状态,并避免陷入状态陷阱。集合熵用于衡量智能体群体的多样性,并根据多样性调整探索的力度。

关键创新:该方法最重要的技术创新点在于将伞状抽样技术与强化学习相结合,并引入集合熵来平衡探索和利用。与传统的强化学习算法相比,Umbrella强化学习能够更有效地探索状态空间,尤其是在稀疏奖励的场景下。此外,该方法还具有较强的通用性,可以应用于各种不同的强化学习问题。

关键设计:关键设计包括:1) 奖励函数的修改方式,即如何将集合熵融入到奖励函数中;2) 集合熵的计算方法,需要选择合适的度量来衡量智能体群体的多样性;3) 策略梯度算法的具体实现,例如选择合适的优化器和学习率;4) 神经网络的结构设计,需要根据具体的问题选择合适的网络结构。

🖼️ 关键图片

📊 实验亮点

论文提出的Umbrella强化学习方法在多个困难的强化学习问题上进行了实验验证,结果表明该方法在计算效率和通用性方面优于现有的最先进算法。具体来说,在具有稀疏奖励的环境中,Umbrella强化学习能够更快地找到最优策略,并且能够避免陷入状态陷阱。此外,该方法还能够有效地平衡探索和利用,从而提高学习的稳定性。

🎯 应用场景

Umbrella强化学习具有广泛的应用前景,例如机器人控制、游戏AI、自动驾驶、药物发现等领域。在这些领域中,许多问题都具有稀疏奖励、状态陷阱等特点,传统的强化学习算法难以有效解决。Umbrella强化学习能够提高探索效率,加速学习过程,从而为这些问题的解决提供新的思路。该方法还有潜力应用于更复杂的现实世界问题,例如金融交易、供应链管理等。

📄 摘要(原文)

We report a novel, computationally efficient approach for solving hard nonlinear problems of reinforcement learning (RL). Here we combine umbrella sampling, from computational physics/chemistry, with optimal control methods. The approach is realized on the basis of neural networks, with the use of policy gradient. It outperforms, by computational efficiency and implementation universality, all available state-of-the-art algorithms, in application to hard RL problems with sparse reward, state traps and lack of terminal states. The proposed approach uses an ensemble of simultaneously acting agents, with a modified reward which includes the ensemble entropy, yielding an optimal exploration-exploitation balance.