Reflections from the 2024 Large Language Model (LLM) Hackathon for Applications in Materials Science and Chemistry

作者: Yoel Zimmermann, Adib Bazgir, Zartashia Afzal, Fariha Agbere, Qianxiang Ai, Nawaf Alampara, Alexander Al-Feghali, Mehrad Ansari, Dmytro Antypov, Amro Aswad, Jiaru Bai, Viktoriia Baibakova, Devi Dutta Biswajeet, Erik Bitzek, Joshua D. Bocarsly, Anna Borisova, Andres M Bran, L. Catherine Brinson, Marcel Moran Calderon, Alessandro Canalicchio, Victor Chen, Yuan Chiang, Defne Circi, Benjamin Charmes, Vikrant Chaudhary, Zizhang Chen, Min-Hsueh Chiu, Judith Clymo, Kedar Dabhadkar, Nathan Daelman, Archit Datar, Wibe A. de Jong, Matthew L. Evans, Maryam Ghazizade Fard, Giuseppe Fisicaro, Abhijeet Sadashiv Gangan, Janine George, Jose D. Cojal Gonzalez, Michael Götte, Ankur K. Gupta, Hassan Harb, Pengyu Hong, Abdelrahman Ibrahim, Ahmed Ilyas, Alishba Imran, Kevin Ishimwe, Ramsey Issa, Kevin Maik Jablonka, Colin Jones, Tyler R. Josephson, Greg Juhasz, Sarthak Kapoor, Rongda Kang, Ghazal Khalighinejad, Sartaaj Khan, Sascha Klawohn, Suneel Kuman, Alvin Noe Ladines, Sarom Leang, Magdalena Lederbauer, Sheng-Lun, Liao, Hao Liu, Xuefeng Liu, Stanley Lo, Sandeep Madireddy, Piyush Ranjan Maharana, Shagun Maheshwari, Soroush Mahjoubi, José A. Márquez, Rob Mills, Trupti Mohanty, Bernadette Mohr, Seyed Mohamad Moosavi, Alexander Moßhammer, Amirhossein D. Naghdi, Aakash Naik, Oleksandr Narykov, Hampus Näsström, Xuan Vu Nguyen, Xinyi Ni, Dana O'Connor, Teslim Olayiwola, Federico Ottomano, Aleyna Beste Ozhan, Sebastian Pagel, Chiku Parida, Jaehee Park, Vraj Patel, Elena Patyukova, Martin Hoffmann Petersen, Luis Pinto, José M. Pizarro, Dieter Plessers, Tapashree Pradhan, Utkarsh Pratiush, Charishma Puli, Andrew Qin, Mahyar Rajabi, Francesco Ricci, Elliot Risch, Martiño Ríos-García, Aritra Roy, Tehseen Rug, Hasan M Sayeed, Markus Scheidgen, Mara Schilling-Wilhelmi, Marcel Schloz, Fabian Schöppach, Julia Schumann, Philippe Schwaller, Marcus Schwarting, Samiha Sharlin, Kevin Shen, Jiale Shi, Pradip Si, Jennifer D'Souza, Taylor Sparks, Suraj Sudhakar, Leopold Talirz, Dandan Tang, Olga Taran, Carla Terboven, Mark Tropin, Anastasiia Tsymbal, Katharina Ueltzen, Pablo Andres Unzueta, Archit Vasan, Tirtha Vinchurkar, Trung Vo, Gabriel Vogel, Christoph Völker, Jan Weinreich, Faradawn Yang, Mohd Zaki, Chi Zhang, Sylvester Zhang, Weijie Zhang, Ruijie Zhu, Shang Zhu, Jan Janssen, Calvin Li, Ian Foster, Ben Blaiszik

分类: cs.LG, cond-mat.mtrl-sci, physics.chem-ph

发布日期: 2024-11-20 (更新: 2025-01-03)

备注: Updating author information, the submission remains largely unchanged. 98 pages total

💡 一句话要点

材料科学与化学领域LLM应用:2024黑客松成果展示与未来展望

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 材料科学 化学 黑客松 知识提取

📋 核心要点

- 现有材料科学和化学研究面临数据量大、知识分散等挑战,传统方法难以高效利用信息。

- 利用LLM的强大语言理解和生成能力,构建各种应用,加速材料发现和化学研究。

- 黑客松成果表明LLM在性质预测、材料设计、自动化等领域潜力巨大,是科研的有力工具。

📝 摘要(中文)

本文介绍了第二届大型语言模型(LLM)在材料科学和化学应用黑客松的成果,该活动吸引了全球混合地点的参与者,共提交了34个团队的项目。这些项目涵盖了七个关键应用领域,展示了LLM在以下方面的多样化效用:(1)分子和材料性质预测;(2)分子和材料设计;(3)自动化和新型界面;(4)科学交流和教育;(5)研究数据管理和自动化;(6)假设生成和评估;(7)从科学文献中提取知识和推理。每个团队的提交都以摘要表的形式呈现,并附有代码链接和简短的论文。除了团队成果外,我们还讨论了黑客松活动及其混合形式,包括多伦多、蒙特利尔、旧金山、柏林、洛桑和东京的物理中心,以及全球在线中心,以实现本地和虚拟协作。总的来说,本次活动突显了自去年黑客松以来LLM能力的显著提高,表明LLM在材料科学和化学研究中的应用将持续扩展。这些成果展示了LLM作为多用途模型在各种机器学习任务和快速原型定制科学研究应用平台中的双重效用。

🔬 方法详解

问题定义:材料科学和化学领域的研究人员面临着海量科学文献和实验数据的挑战,如何从中高效地提取知识、进行推理和预测,并加速新材料的发现和设计,是亟待解决的问题。传统方法往往依赖于人工分析和领域专家的经验,效率低下且难以处理复杂的数据关系。

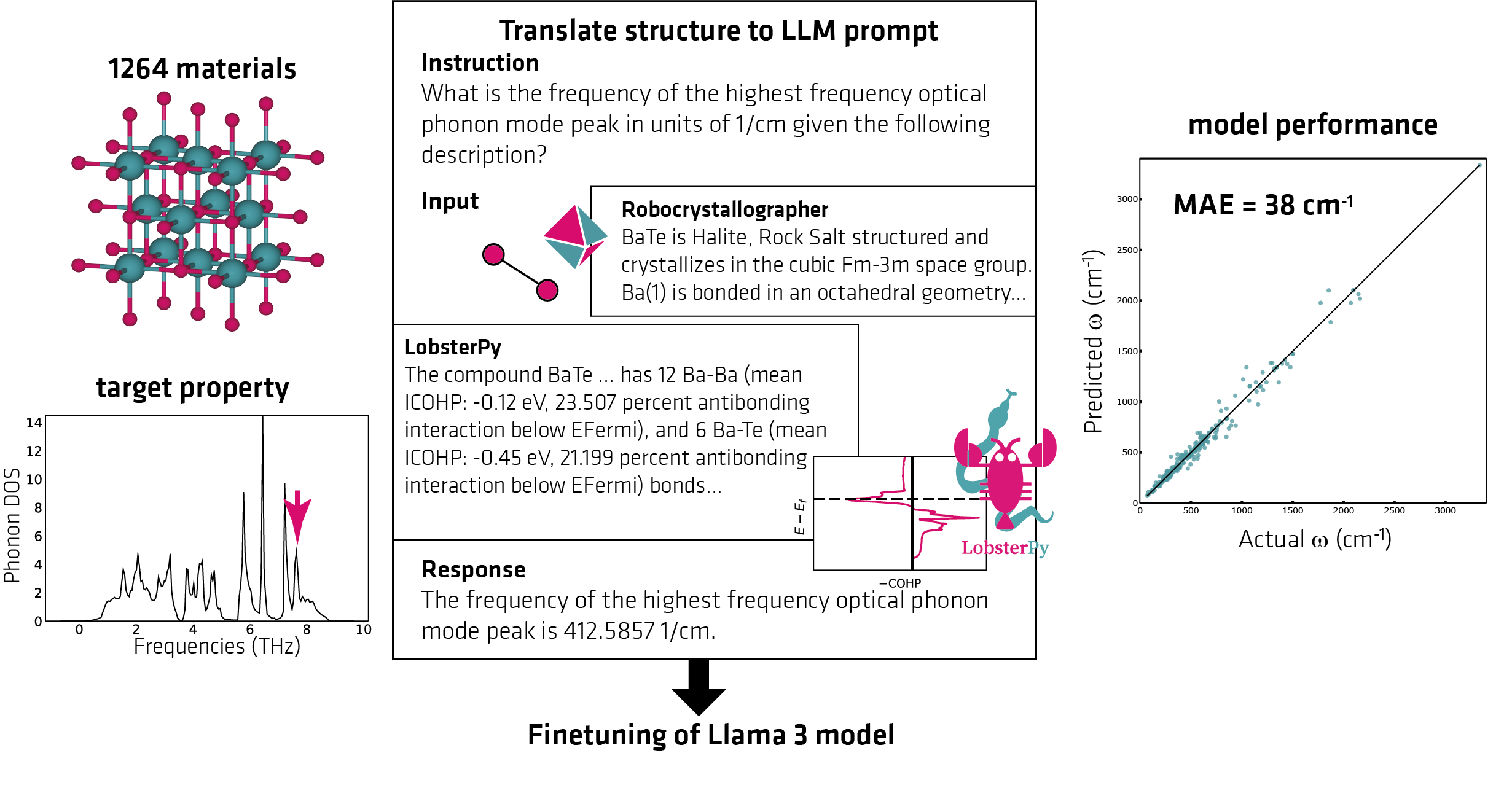

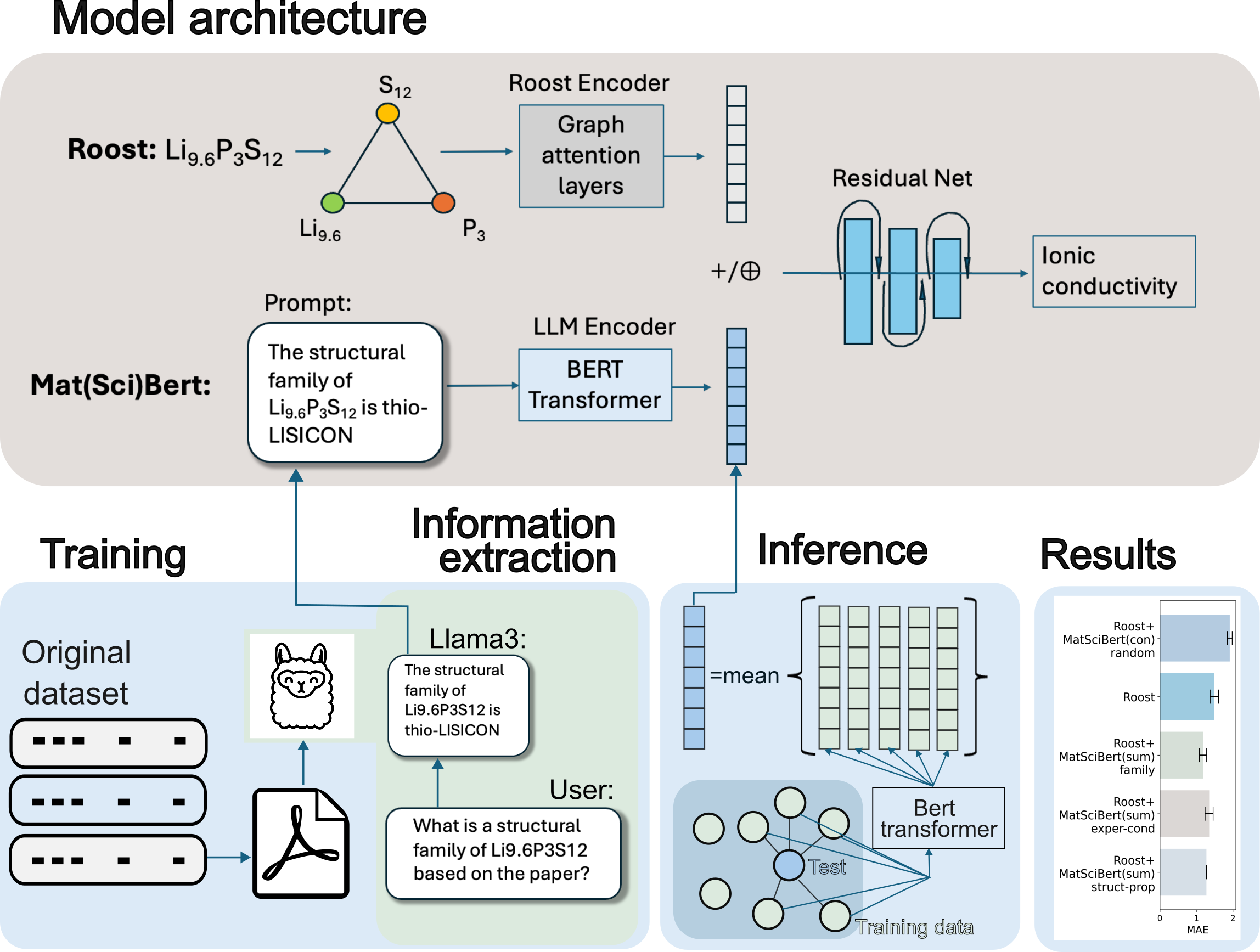

核心思路:利用大型语言模型(LLM)强大的自然语言处理能力,将材料科学和化学领域的知识融入LLM中,使其能够理解和生成相关的文本和数据。通过训练和微调,使LLM具备性质预测、材料设计、自动化等功能,从而辅助研究人员进行科学研究。

技术框架:本次黑客松的参与者利用各种LLM(具体模型未知)构建了不同的应用。整体框架通常包括以下几个阶段:1)数据准备:收集和整理材料科学和化学领域的文献、实验数据等;2)模型训练/微调:使用准备好的数据对LLM进行训练或微调,使其适应特定任务;3)应用开发:基于训练好的LLM,开发各种应用,如性质预测、材料设计、自动化等;4)评估和优化:对应用进行评估,并根据结果进行优化。

关键创新:本次黑客松的关键创新在于将LLM应用于材料科学和化学领域,探索了LLM在这些领域的潜力。与传统方法相比,LLM能够自动地从海量数据中学习知识,并进行推理和预测,大大提高了研究效率。此外,LLM还可以用于生成新的材料设计方案,为研究人员提供新的思路。

关键设计:由于是黑客松活动,各个团队的具体设计细节差异较大,无法统一描述。但通常会涉及到以下关键设计:1)提示工程(Prompt Engineering):设计合适的提示语,引导LLM生成期望的输出;2)数据增强:通过各种方法增加训练数据的数量和多样性;3)模型选择:选择合适的LLM,并根据任务进行微调;4)评估指标:选择合适的评估指标,评估模型的性能。

🖼️ 关键图片

📊 实验亮点

本次黑客松展示了LLM在材料科学和化学领域的多种应用,包括性质预测、材料设计、自动化等。虽然没有提供具体的性能数据,但参与者普遍认为LLM在这些任务上表现出了巨大的潜力,能够显著提高研究效率。与去年的黑客松相比,今年的成果表明LLM的能力有了显著提升,为未来的研究奠定了基础。

🎯 应用场景

该研究成果可广泛应用于材料科学和化学领域,例如加速新材料的发现和设计、优化化学反应路径、自动化实验流程、辅助科研人员进行文献检索和知识提取等。LLM的应用有望显著提高科研效率,降低研发成本,并推动相关领域的创新发展。未来,随着LLM技术的不断进步,其在材料科学和化学领域的应用前景将更加广阔。

📄 摘要(原文)

Here, we present the outcomes from the second Large Language Model (LLM) Hackathon for Applications in Materials Science and Chemistry, which engaged participants across global hybrid locations, resulting in 34 team submissions. The submissions spanned seven key application areas and demonstrated the diverse utility of LLMs for applications in (1) molecular and material property prediction; (2) molecular and material design; (3) automation and novel interfaces; (4) scientific communication and education; (5) research data management and automation; (6) hypothesis generation and evaluation; and (7) knowledge extraction and reasoning from scientific literature. Each team submission is presented in a summary table with links to the code and as brief papers in the appendix. Beyond team results, we discuss the hackathon event and its hybrid format, which included physical hubs in Toronto, Montreal, San Francisco, Berlin, Lausanne, and Tokyo, alongside a global online hub to enable local and virtual collaboration. Overall, the event highlighted significant improvements in LLM capabilities since the previous year's hackathon, suggesting continued expansion of LLMs for applications in materials science and chemistry research. These outcomes demonstrate the dual utility of LLMs as both multipurpose models for diverse machine learning tasks and platforms for rapid prototyping custom applications in scientific research.