LightLLM: A Versatile Large Language Model for Predictive Light Sensing

作者: Jiawei Hu, Hong Jia, Mahbub Hassan, Lina Yao, Brano Kusy, Wen Hu

分类: cs.LG, cs.AI, cs.CV, eess.SP

发布日期: 2024-11-20

备注: 15 pages, 14 figures, 5 tables

💡 一句话要点

LightLLM:用于预测性光感知的多功能大语言模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 光传感 微调 传感器融合 环境感知

📋 核心要点

- 现有光传感方法缺乏通用性和灵活性,难以适应新的环境和任务,且通常需要大量重新训练。

- LightLLM通过融合传感器数据编码器、上下文提示和预训练LLM,实现了对光传感任务的有效适应。

- 实验结果表明,LightLLM在定位精度和室内太阳能估计方面显著优于现有方法和ChatGPT-4。

📝 摘要(中文)

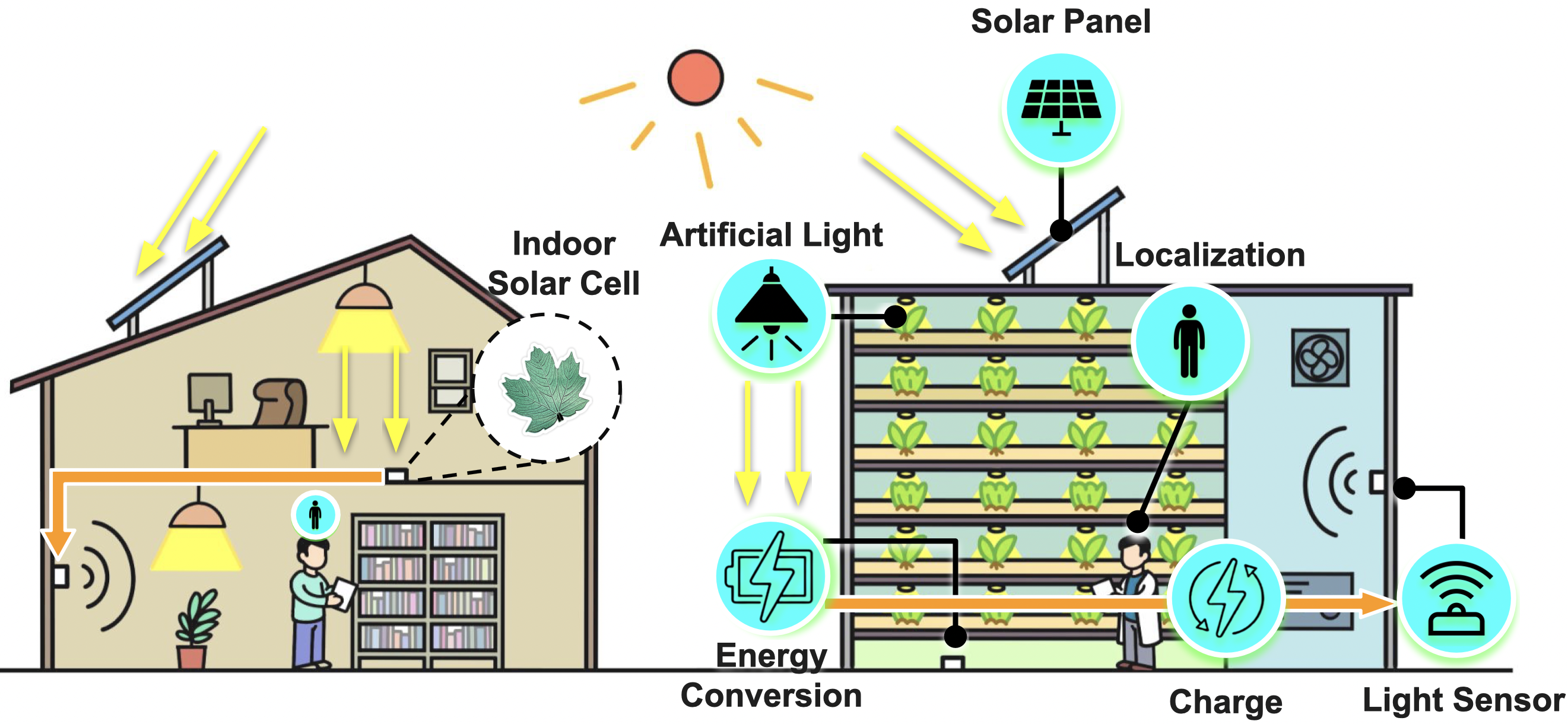

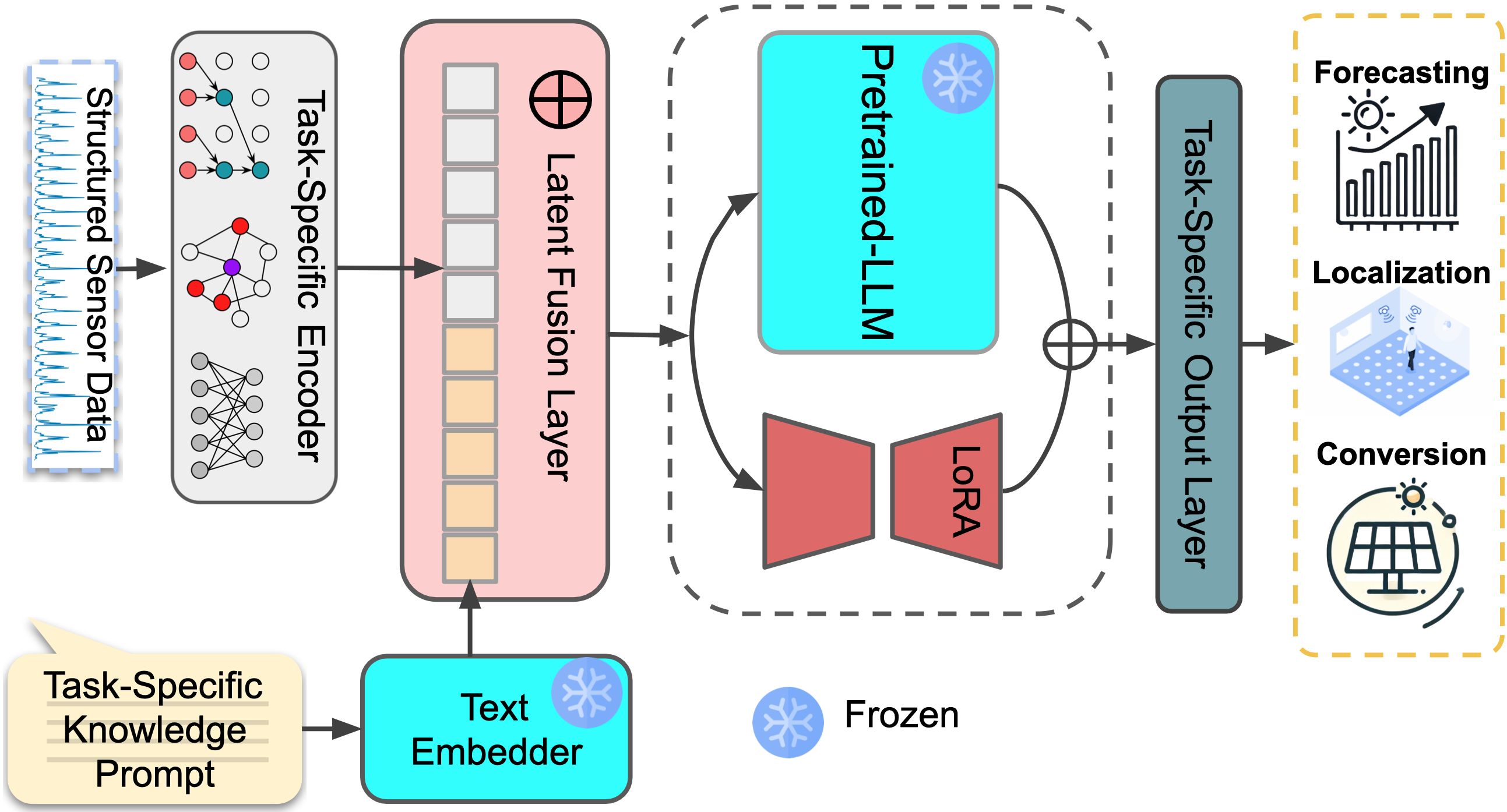

本文提出LightLLM,一个针对光传感任务微调预训练大语言模型(LLM)的模型。它集成了传感器数据编码器以提取关键特征,一个上下文提示以提供环境信息,以及一个融合层以将这些输入组合成统一的表示。然后,这个组合输入由预训练的LLM处理,LLM保持冻结状态,并通过添加轻量级的、可训练的组件进行微调,从而使模型能够适应新任务,而无需更改其原始参数。这种方法使得LLM能够灵活地适应专门的光传感任务,同时具有最小的计算开销和再训练工作量。我们已经为三个光传感任务实现了LightLLM:基于光的定位、室外太阳能预测和室内太阳能估计。使用真实世界的实验数据集,我们证明LightLLM显著优于最先进的方法,在先前未见的环境中测试时,定位精度提高了4.4倍,室内太阳能估计提高了3.4倍。我们进一步证明LightLLM优于直接提示的ChatGPT-4,突出了LightLLM的专用架构在传感器数据融合与文本提示方面的优势。

🔬 方法详解

问题定义:论文旨在解决现有光传感模型泛化能力差、需要大量重新训练的问题。现有方法难以有效融合传感器数据和环境上下文信息,导致在新环境下的性能显著下降。

核心思路:论文的核心思路是利用预训练大语言模型(LLM)的强大表示能力,通过微调使其适应光传感任务。关键在于设计一个轻量级的框架,能够将传感器数据和环境上下文信息有效地融入到LLM中,同时避免对LLM本身进行大规模的修改。

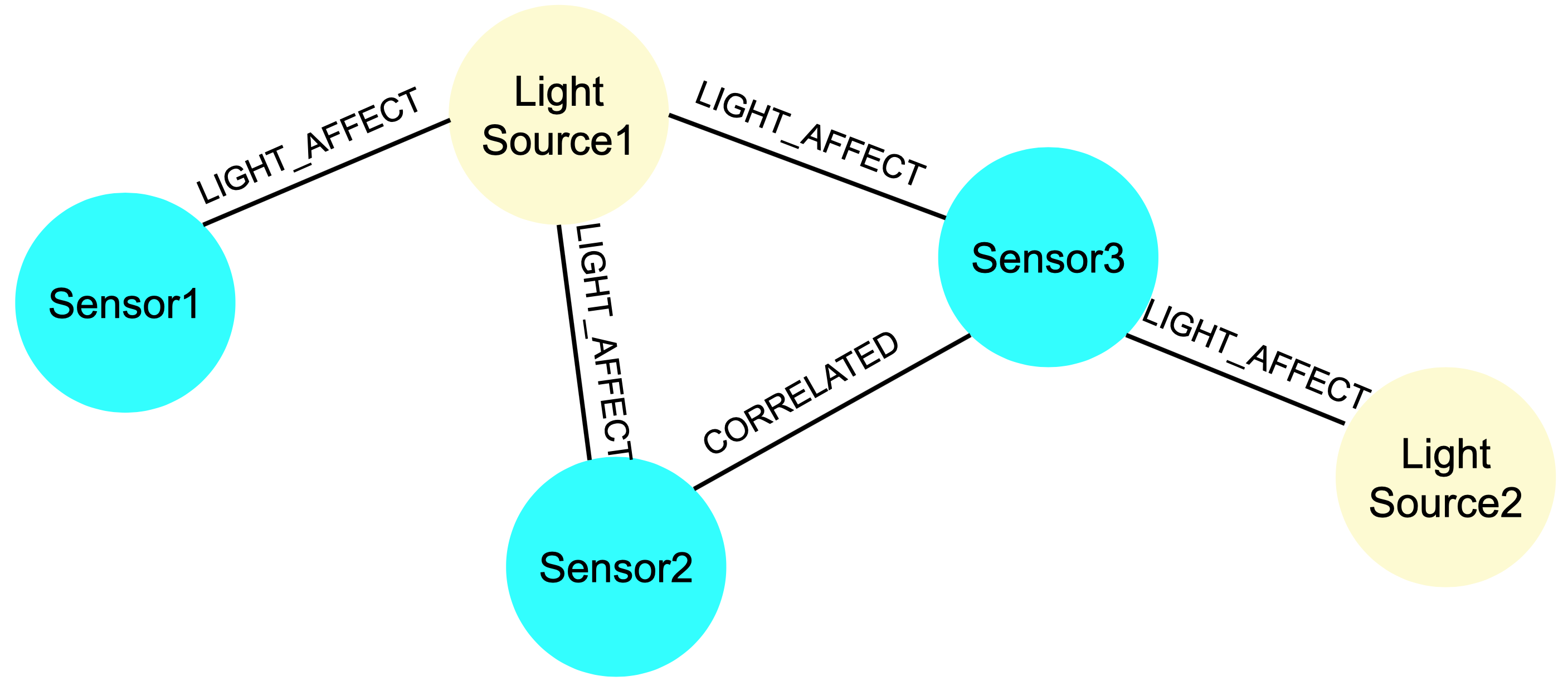

技术框架:LightLLM的整体架构包含三个主要模块:1) 传感器数据编码器:用于提取光传感器数据的关键特征。2) 上下文提示:提供环境信息,例如时间、地点等。3) 融合层:将传感器数据编码和上下文提示融合为统一的表示。这个融合后的表示被输入到冻结的预训练LLM中,并通过添加轻量级的可训练组件进行微调。

关键创新:LightLLM的关键创新在于其轻量级的微调框架,它允许LLM适应新的光传感任务,而无需改变其原始参数。这种方法显著降低了计算开销和再训练工作量,同时保持了LLM的强大表示能力。此外,融合传感器数据和上下文提示的设计也提高了模型在新环境下的泛化能力。

关键设计:传感器数据编码器可以使用各种现有的传感器数据处理方法,例如卷积神经网络(CNN)或循环神经网络(RNN)。上下文提示的设计需要根据具体的任务进行调整,可以采用自然语言描述或结构化数据。融合层可以使用简单的线性层或更复杂的注意力机制。损失函数通常采用交叉熵损失或均方误差损失,具体取决于任务类型。

🖼️ 关键图片

📊 实验亮点

LightLLM在三个光传感任务上进行了评估,包括基于光的定位、室外太阳能预测和室内太阳能估计。实验结果表明,LightLLM显著优于最先进的方法,在先前未见的环境中测试时,定位精度提高了4.4倍,室内太阳能估计提高了3.4倍。此外,LightLLM还优于直接提示的ChatGPT-4,证明了其专用架构的优势。

🎯 应用场景

LightLLM在智能家居、智慧城市、环境监测等领域具有广泛的应用前景。例如,它可以用于室内定位、太阳能预测、环境光照估计等任务,为用户提供更智能、更个性化的服务。此外,LightLLM还可以应用于机器人导航、自动驾驶等领域,提高机器人在复杂环境中的感知能力。

📄 摘要(原文)

We propose LightLLM, a model that fine tunes pre-trained large language models (LLMs) for light-based sensing tasks. It integrates a sensor data encoder to extract key features, a contextual prompt to provide environmental information, and a fusion layer to combine these inputs into a unified representation. This combined input is then processed by the pre-trained LLM, which remains frozen while being fine-tuned through the addition of lightweight, trainable components, allowing the model to adapt to new tasks without altering its original parameters. This approach enables flexible adaptation of LLM to specialized light sensing tasks with minimal computational overhead and retraining effort. We have implemented LightLLM for three light sensing tasks: light-based localization, outdoor solar forecasting, and indoor solar estimation. Using real-world experimental datasets, we demonstrate that LightLLM significantly outperforms state-of-the-art methods, achieving 4.4x improvement in localization accuracy and 3.4x improvement in indoor solar estimation when tested in previously unseen environments. We further demonstrate that LightLLM outperforms ChatGPT-4 with direct prompting, highlighting the advantages of LightLLM's specialized architecture for sensor data fusion with textual prompts.