LLMSteer: Improving Long-Context LLM Inference by Steering Attention on Reused Contexts

作者: Zhuohan Gu, Jiayi Yao, Kuntai Du, Junchen Jiang

分类: cs.LG, cs.CL

发布日期: 2024-11-20 (更新: 2024-11-21)

💡 一句话要点

LLMSteer:通过引导注意力重用上下文,提升长文本LLM推理效率

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本理解 注意力机制 推理加速 语言模型 上下文学习

📋 核心要点

- 现有LLM在处理长文本时,面临上下文理解不足和计算成本过高的挑战。

- LLMSteer通过查询无关的注意力引导,提升模型对重用上下文的关注度。

- 实验表明,LLMSteer显著提升了性能,并大幅降低了推理延迟。

📝 摘要(中文)

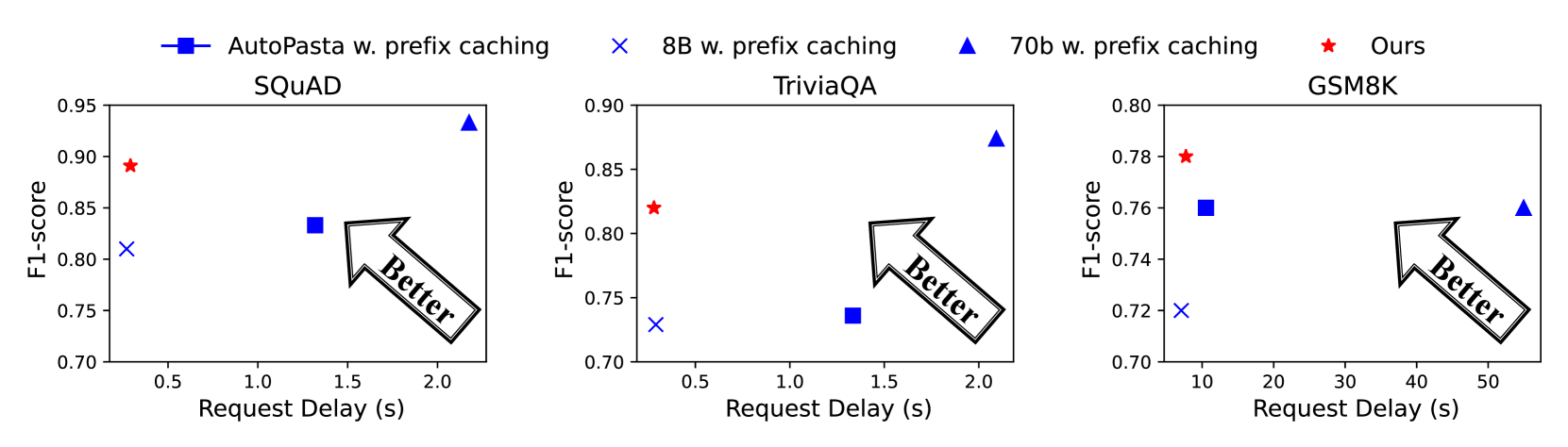

大型语言模型(LLMs)在复杂任务上表现出令人印象深刻的性能,但它们在更长的上下文理解和高计算成本方面仍然面临挑战。为了平衡效率和质量,我们引入了LLMSteer,这是一个无需微调的框架,通过查询无关的注意力引导来增强LLMs。在流行的LLMs和数据集上进行测试,LLMSteer缩小了与基线的性能差距65.9%,并且与最近的注意力引导方法相比,运行时间延迟最多减少了4.8倍。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在处理长上下文时面临的效率和理解问题。现有方法在长文本推理时,计算成本高昂,且对上下文的理解能力有限,导致性能下降。

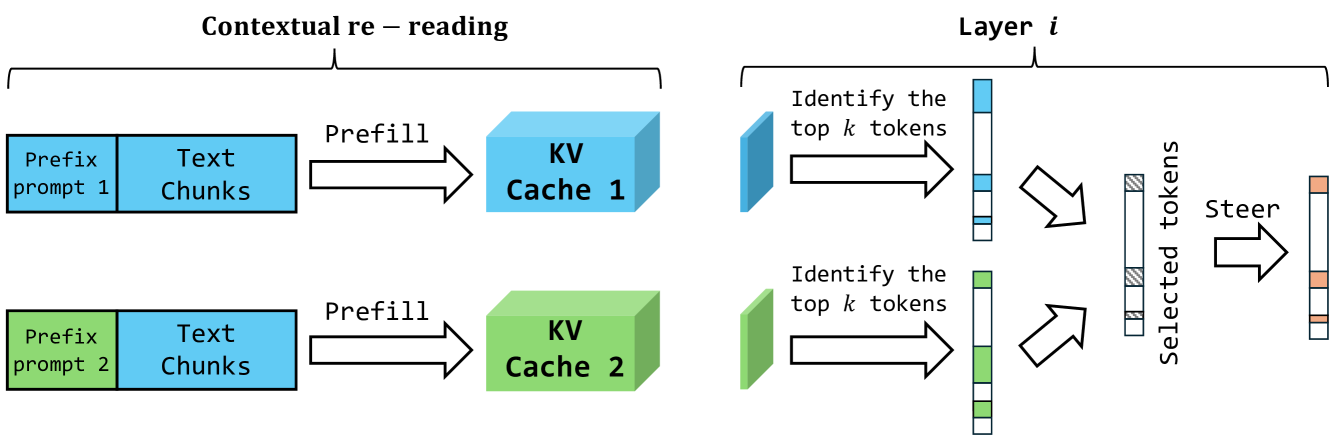

核心思路:LLMSteer的核心思路是通过注意力引导,使模型更加关注那些在推理过程中被重复使用的上下文信息。通过这种方式,模型可以更有效地利用上下文,从而提高性能并降低计算成本。这种方法无需对模型进行微调,因此具有很高的实用性。

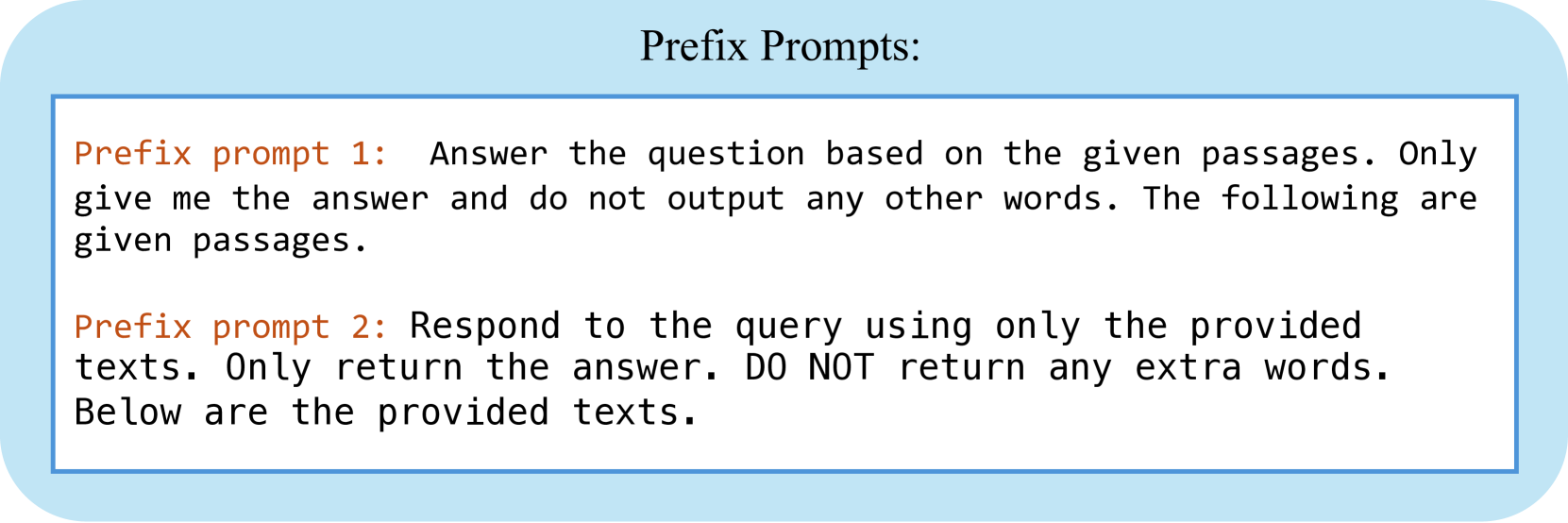

技术框架:LLMSteer是一个无需微调的框架,它通过在推理过程中调整注意力权重来实现上下文引导。具体来说,该框架包含一个注意力引导模块,该模块根据上下文的使用频率和重要性,动态地调整注意力权重。该模块是查询无关的,这意味着它不依赖于当前的查询,而是基于历史上下文信息进行调整。

关键创新:LLMSteer的关键创新在于其查询无关的注意力引导机制。与传统的注意力机制不同,LLMSteer的注意力引导模块不依赖于当前的查询,而是基于历史上下文信息进行调整。这种方法可以更有效地利用上下文信息,从而提高性能并降低计算成本。此外,LLMSteer无需微调,这使得它更容易部署和使用。

关键设计:LLMSteer的关键设计在于注意力引导模块的实现。该模块使用一个简单的线性层来计算注意力权重,该线性层的输入是上下文的使用频率和重要性。上下文的使用频率可以通过跟踪每个上下文单元被访问的次数来计算。上下文的重要性可以通过计算每个上下文单元的梯度来估计。该模块还包含一个可学习的温度参数,用于控制注意力权重的平滑程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LLMSteer在多个数据集上取得了显著的性能提升。与基线方法相比,LLMSteer缩小了性能差距65.9%,并且与最近的注意力引导方法相比,运行时间延迟最多减少了4.8倍。这些结果表明,LLMSteer是一种有效的长文本LLM推理优化方法。

🎯 应用场景

LLMSteer具有广泛的应用前景,可以应用于各种需要处理长文本的场景,例如文档摘要、机器翻译、问答系统和对话生成。通过提高LLM在长文本处理方面的效率和性能,LLMSteer可以显著提升这些应用的实用性和用户体验。未来,该技术有望推动LLM在更多领域的应用。

📄 摘要(原文)

As large language models (LLMs) show impressive performance on complex tasks, they still struggle with longer contextual understanding and high computational costs. To balance efficiency and quality, we introduce LLMSteer, a fine-tuning-free framework that enhances LLMs through query-independent attention steering. Tested on popular LLMs and datasets, LLMSteer narrows the performance gap with baselines by 65.9% and reduces the runtime delay by up to 4.8x compared to recent attention steering methods.