SkillTree: Explainable Skill-Based Deep Reinforcement Learning for Long-Horizon Control Tasks

作者: Yongyan Wen, Siyuan Li, Rongchang Zuo, Lei Yuan, Hangyu Mao, Peng Liu

分类: cs.LG, cs.AI

发布日期: 2024-11-19

💡 一句话要点

SkillTree:面向长时程控制任务的可解释技能型深度强化学习

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 深度强化学习 可解释性 决策树 分层强化学习 技能学习 连续控制 机器人控制

📋 核心要点

- 深度强化学习缺乏透明性,限制了其在实际控制任务中的应用,尤其是在需要解释性的场景。

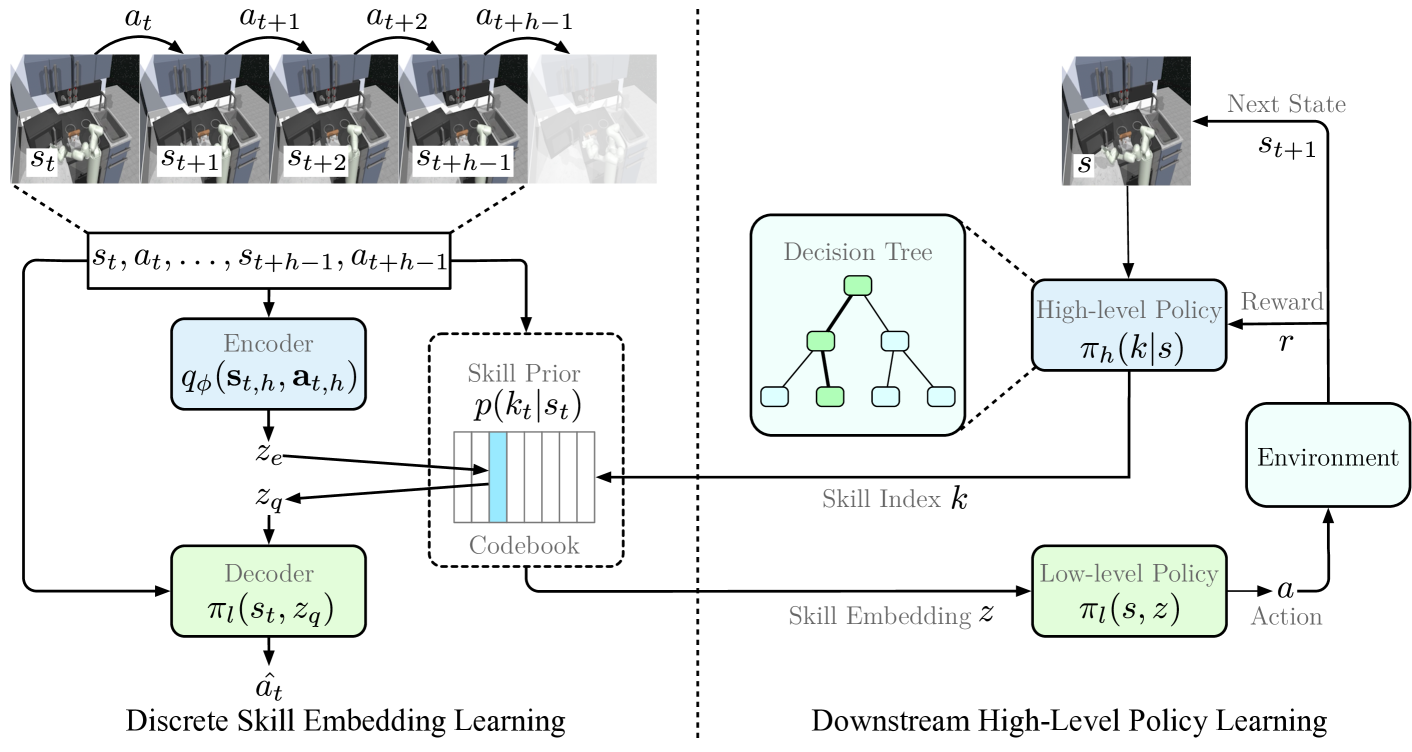

- SkillTree通过分层结构,将复杂连续动作空间分解为离散技能空间,并利用可微决策树生成技能嵌入。

- 实验表明,SkillTree在机械臂控制任务中性能与基于技能的神经网络相当,并提供了技能层面的可解释性。

📝 摘要(中文)

深度强化学习(DRL)在各个研究领域取得了显著成功。然而,它对神经网络的依赖导致缺乏透明性,限制了其在实际应用中的应用。为了实现可解释性,决策树已成为一种流行的、有前景的神经网络替代方案。然而,由于其有限的表达能力,传统的决策树难以处理高维长时程连续控制任务。本文提出了一种新的框架SkillTree,该框架将复杂的连续动作空间简化为离散的技能空间。我们的分层方法在高层策略中集成了一个可微决策树,以生成技能嵌入,然后指导低层策略执行技能。通过使技能决策具有可解释性,我们实现了技能层面的可解释性,从而增强了对复杂任务中决策过程的理解。实验结果表明,我们的方法在复杂的机械臂控制领域实现了与基于技能的神经网络相当的性能。此外,SkillTree提供了技能层面的解释,从而提高了决策过程的透明度。

🔬 方法详解

问题定义:现有的深度强化学习方法,特别是应用于连续控制任务时,由于其黑盒特性,缺乏可解释性。这使得理解智能体的决策过程变得困难,阻碍了其在需要安全性和可信度的实际场景中的应用。传统的决策树虽然具有可解释性,但表达能力有限,难以处理高维、长时程的连续控制任务。

核心思路:SkillTree的核心思路是将复杂的连续控制任务分解为一系列离散的技能,并利用可微决策树在高层策略中选择合适的技能。通过这种分层结构,将复杂的动作空间简化为技能空间,从而降低了决策的复杂性,并提高了可解释性。决策树的选择过程是透明的,可以清晰地展示智能体选择特定技能的原因。

技术框架:SkillTree采用分层强化学习框架,包含高层策略和低层策略。高层策略使用可微决策树,根据当前状态选择合适的技能嵌入。低层策略则根据高层策略提供的技能嵌入,执行具体的动作。整个框架通过端到端的方式进行训练,高层策略和低层策略协同工作,共同完成任务。

关键创新:SkillTree的关键创新在于将可微决策树引入到高层策略中,用于选择技能。这使得技能选择过程具有可解释性,从而提高了整个强化学习系统的透明度。此外,SkillTree采用分层结构,将复杂的连续控制任务分解为技能选择和技能执行两个阶段,降低了学习的难度。

关键设计:SkillTree的关键设计包括:1) 使用Gumbel-Softmax技巧使决策树可微,从而可以进行端到端训练;2) 设计合适的技能嵌入,用于指导低层策略执行技能;3) 使用合适的奖励函数,鼓励智能体学习有效的技能序列。具体的网络结构和参数设置需要根据具体的任务进行调整。

🖼️ 关键图片

📊 实验亮点

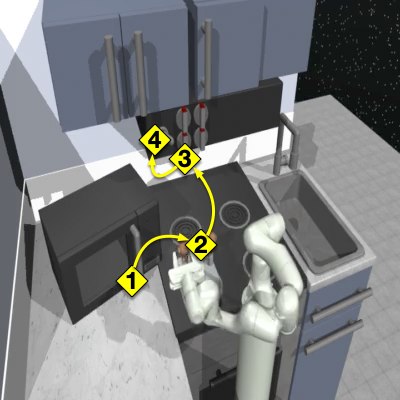

SkillTree在复杂的机械臂控制领域进行了实验验证,结果表明其性能与基于技能的神经网络相当。更重要的是,SkillTree提供了技能层面的解释,使得决策过程更加透明。例如,可以清晰地展示智能体在特定状态下选择某个技能的原因,从而提高了可解释性。

🎯 应用场景

SkillTree具有广泛的应用前景,例如在机器人控制、自动驾驶、游戏AI等领域。它可以应用于需要可解释性和安全性的场景,例如医疗机器人、工业自动化等。通过提供技能层面的解释,SkillTree可以帮助人们更好地理解智能体的决策过程,从而提高对智能体的信任度,并促进人机协作。

📄 摘要(原文)

Deep reinforcement learning (DRL) has achieved remarkable success in various research domains. However, its reliance on neural networks results in a lack of transparency, which limits its practical applications. To achieve explainability, decision trees have emerged as a popular and promising alternative to neural networks. Nonetheless, due to their limited expressiveness, traditional decision trees struggle with high-dimensional long-horizon continuous control tasks. In this paper, we proposes SkillTree, a novel framework that reduces complex continuous action spaces into discrete skill spaces. Our hierarchical approach integrates a differentiable decision tree within the high-level policy to generate skill embeddings, which subsequently guide the low-level policy in executing skills. By making skill decisions explainable, we achieve skill-level explainability, enhancing the understanding of the decision-making process in complex tasks. Experimental results demonstrate that our method achieves performance comparable to skill-based neural networks in complex robotic arm control domains. Furthermore, SkillTree offers explanations at the skill level, thereby increasing the transparency of the decision-making process.