Exploring Eye Tracking to Detect Cognitive Load in Complex Virtual Reality Training

作者: Mahsa Nasri, Mehmet Kosa, Leanne Chukoskie, Mohsen Moghaddam, Casper Harteveld

分类: cs.HC, cs.LG

发布日期: 2024-11-18

💡 一句话要点

利用眼动追踪技术检测复杂VR训练中的认知负荷

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 眼动追踪 认知负荷 虚拟现实 机器学习 VR训练 多层感知器 随机森林

📋 核心要点

- VR训练中认知负荷难以有效评估,现有方法缺乏客观性和实时性。

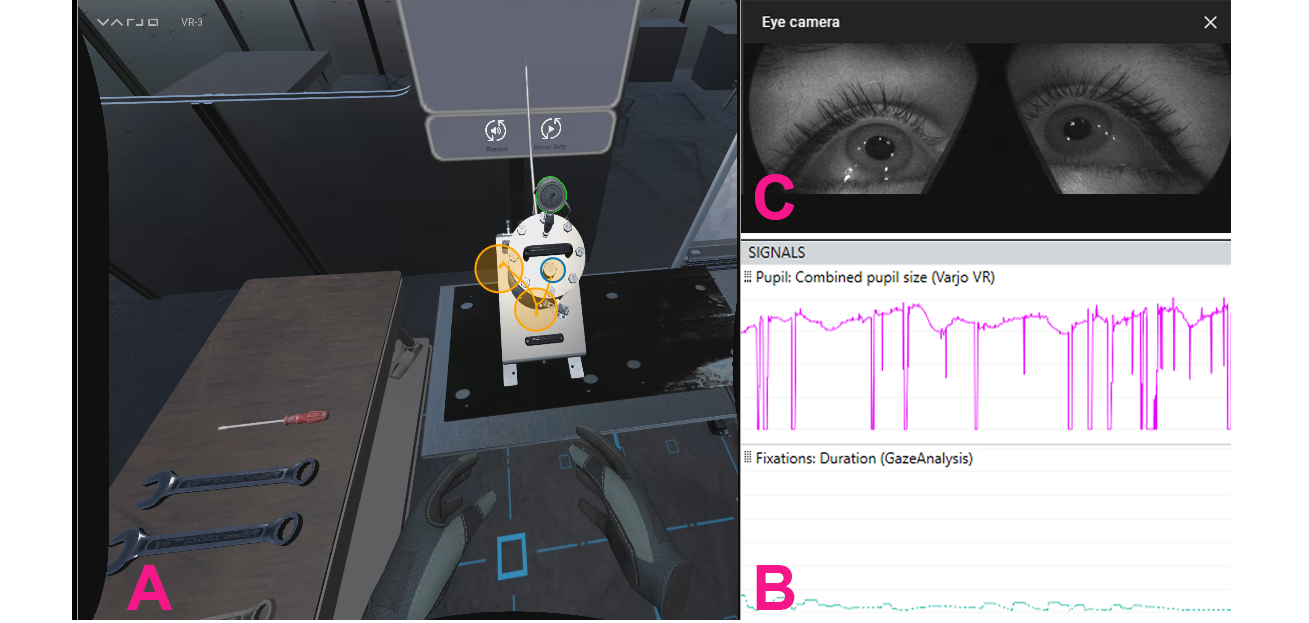

- 利用眼动追踪技术,结合机器学习模型,客观评估VR训练中的认知负荷。

- 初步实验表明,瞳孔扩张和注视时长等眼动指标可有效预测认知负荷。

📝 摘要(中文)

虚拟现实(VR)已成为先进制造等领域有益的培训工具。然而,由于VR硬件的使用或VR环境中的任务等多种因素,用户可能会经历较高的认知负荷。研究表明,眼动追踪具有检测认知负荷的潜力,但在VR和复杂的时空任务(如组装和拆卸)中,这方面的研究相对较少。本文介绍了一项正在进行的研究,该研究旨在使用基于眼动追踪的机器学习方法来检测用户的认知负荷。我们开发了一个用于冷喷涂的VR培训系统,并对22名参与者进行了测试,获得了19个有效的眼动追踪数据集和NASA-TLX评分。我们应用多层感知器(MLP)和随机森林(RF)模型来比较使用瞳孔扩张和注视持续时间预测认知负荷(即NASA-TLX)的准确性。初步分析表明,在复杂的时空VR体验中使用眼动追踪检测认知负荷是可行的,并激发了进一步的探索。

🔬 方法详解

问题定义:论文旨在解决在复杂VR训练环境中,如何有效且客观地检测用户的认知负荷问题。现有方法,如主观问卷调查(例如NASA-TLX),虽然常用,但依赖于用户的主观感受,缺乏实时性和客观性。此外,在VR环境中,用户的认知负荷受到多种因素的影响,使得准确评估认知负荷更具挑战性。

核心思路:论文的核心思路是利用眼动追踪技术,通过分析用户的眼动数据(如瞳孔扩张和注视持续时间),来客观地反映用户的认知负荷水平。眼动数据被认为与认知过程密切相关,可以提供关于用户注意力和信息处理状态的丰富信息。结合机器学习模型,可以建立眼动数据与认知负荷之间的映射关系。

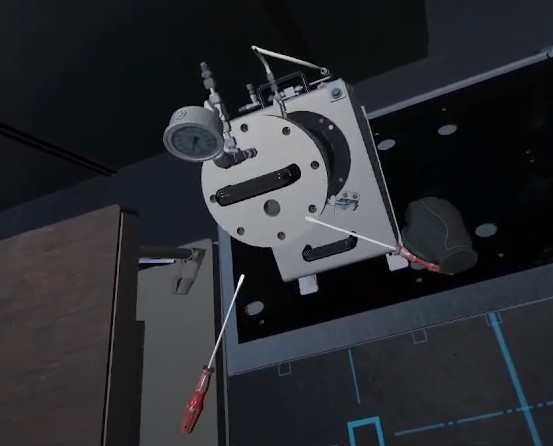

技术框架:整体框架包括以下几个主要阶段:1) VR训练系统开发:构建一个用于冷喷涂的VR训练系统,模拟真实的操作环境。2) 数据采集:招募参与者进行VR训练,同时使用眼动追踪设备记录他们的眼动数据,并使用NASA-TLX问卷评估他们的主观认知负荷。3) 数据预处理:对采集到的眼动数据进行清洗和处理,提取关键的眼动特征,如瞳孔扩张和注视持续时间。4) 模型训练与评估:使用机器学习模型(如多层感知器MLP和随机森林RF)训练眼动特征与NASA-TLX评分之间的映射关系,并评估模型的预测准确性。

关键创新:该研究的关键创新在于将眼动追踪技术应用于复杂时空VR训练环境中的认知负荷检测。与传统的认知负荷评估方法相比,该方法具有客观性和实时性。此外,该研究探索了瞳孔扩张和注视持续时间等眼动特征在预测认知负荷方面的有效性。

关键设计:论文使用了多层感知器(MLP)和随机森林(RF)两种机器学习模型。瞳孔扩张和注视持续时间被用作模型的输入特征。NASA-TLX评分被用作模型的输出目标。具体参数设置未知,但通常需要根据数据集的大小和特征进行调整。损失函数和网络结构等技术细节也未在摘要中详细说明。

🖼️ 关键图片

📊 实验亮点

初步实验结果表明,使用瞳孔扩张和注视持续时间等眼动特征,结合多层感知器(MLP)和随机森林(RF)模型,可以有效地预测VR训练中的认知负荷。虽然摘要中没有给出具体的性能数据和对比基线,但该研究验证了眼动追踪技术在复杂时空VR体验中检测认知负荷的可行性。

🎯 应用场景

该研究成果可应用于各种VR培训场景,例如航空航天、医疗手术和工业制造等领域。通过实时监测用户的认知负荷,可以动态调整训练难度,优化训练流程,提高培训效率和安全性。此外,该技术还可以用于评估VR系统的可用性和用户体验,为VR系统的设计和改进提供依据。

📄 摘要(原文)

Virtual Reality (VR) has been a beneficial training tool in fields such as advanced manufacturing. However, users may experience a high cognitive load due to various factors, such as the use of VR hardware or tasks within the VR environment. Studies have shown that eye-tracking has the potential to detect cognitive load, but in the context of VR and complex spatiotemporal tasks (e.g., assembly and disassembly), it remains relatively unexplored. Here, we present an ongoing study to detect users' cognitive load using an eye-tracking-based machine learning approach. We developed a VR training system for cold spray and tested it with 22 participants, obtaining 19 valid eye-tracking datasets and NASA-TLX scores. We applied Multi-Layer Perceptron (MLP) and Random Forest (RF) models to compare the accuracy of predicting cognitive load (i.e., NASA-TLX) using pupil dilation and fixation duration. Our preliminary analysis demonstrates the feasibility of using eye tracking to detect cognitive load in complex spatiotemporal VR experiences and motivates further exploration.