Preempting Text Sanitization Utility in Resource-Constrained Privacy-Preserving LLM Interactions

作者: Robin Carpentier, Benjamin Zi Hao Zhao, Hassan Jameel Asghar, Dali Kaafar

分类: cs.CR, cs.LG

发布日期: 2024-11-18 (更新: 2025-06-13)

💡 一句话要点

提出一种中间件架构,在资源受限场景下预判差分隐私文本清洗对LLM效用的影响,避免资源浪费。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 差分隐私 大型语言模型 文本清洗 资源优化 效用预测 小型语言模型 隐私保护

📋 核心要点

- 现有方法难以预测差分隐私文本清洗对LLM性能的影响,导致资源浪费和经济损失。

- 提出一种中间件架构,利用小型语言模型预测清洗后提示的效用,避免低效提示进入LLM。

- 实验表明,该架构能有效预防高达20%的提示造成的资源浪费,并在DP文本清洗方面有新的发现。

📝 摘要(中文)

与在线大型语言模型(LLM)的交互引发了隐私问题,因为服务提供商可以从用户提示中收集关于用户及其公司的敏感信息。虽然可以使用差分隐私(DP)来清洗文本提示,但我们发现很难预测LLM在经过清洗的提示上的性能。性能不佳会对按使用量付费的LLM服务产生明显的经济后果,并浪费大量的计算资源。为此,我们提出了一种中间件架构,利用小型语言模型(SLM)来预测给定清洗后的提示在发送到LLM之前的效用。我们通过摘要和翻译任务的实验表明,我们的架构有助于防止高达20%的提示造成的资源浪费。在我们的研究中,我们还重现了一篇关于使用DP进行文本清洗的被引用最多的论文中的实验,并表明一种潜在的性能驱动的实现选择会显著改变输出,而该论文并未明确承认这一点。

🔬 方法详解

问题定义:论文旨在解决在资源受限的隐私保护LLM交互中,如何避免因差分隐私(DP)文本清洗导致LLM性能下降,从而造成的计算资源浪费和经济损失的问题。现有方法的主要痛点在于,无法有效预测DP清洗后的文本提示对LLM下游任务(如摘要、翻译等)的效用,导致LLM在低质量输入上消耗资源。

核心思路:论文的核心思路是引入一个中间件,该中间件使用小型语言模型(SLM)来预测经过DP清洗后的文本提示的效用。通过预先评估提示的质量,可以决定是否将该提示发送到大型LLM进行处理,从而避免在低效提示上浪费计算资源。

技术框架:整体架构包含以下几个主要模块:1) 文本提示输入;2) 差分隐私文本清洗模块,对原始提示进行清洗;3) 小型语言模型(SLM),用于预测清洗后提示的效用;4) 效用评估模块,根据SLM的预测结果,决定是否将清洗后的提示发送到LLM;5) 大型语言模型(LLM),执行下游任务(如摘要、翻译等)。流程是:用户输入文本提示 -> DP清洗 -> SLM预测效用 -> 效用评估 -> (若效用高) LLM处理 -> 输出结果, (若效用低) 丢弃。

关键创新:最重要的技术创新点在于引入了SLM作为效用预测器,在DP清洗和LLM之间形成一个反馈环路。这种架构能够在不实际运行LLM的情况下,预先评估清洗后提示的质量,从而实现资源优化。与现有方法相比,该方法避免了盲目地将所有清洗后的提示都发送到LLM,从而减少了不必要的计算开销。

关键设计:论文中,SLM的选择和训练是关键。SLM需要足够小,以保证计算效率,同时又需要足够强大,以准确预测LLM的性能。具体的参数设置、损失函数和网络结构等技术细节在论文中可能有所描述,但根据摘要信息,这部分细节未知。

🖼️ 关键图片

📊 实验亮点

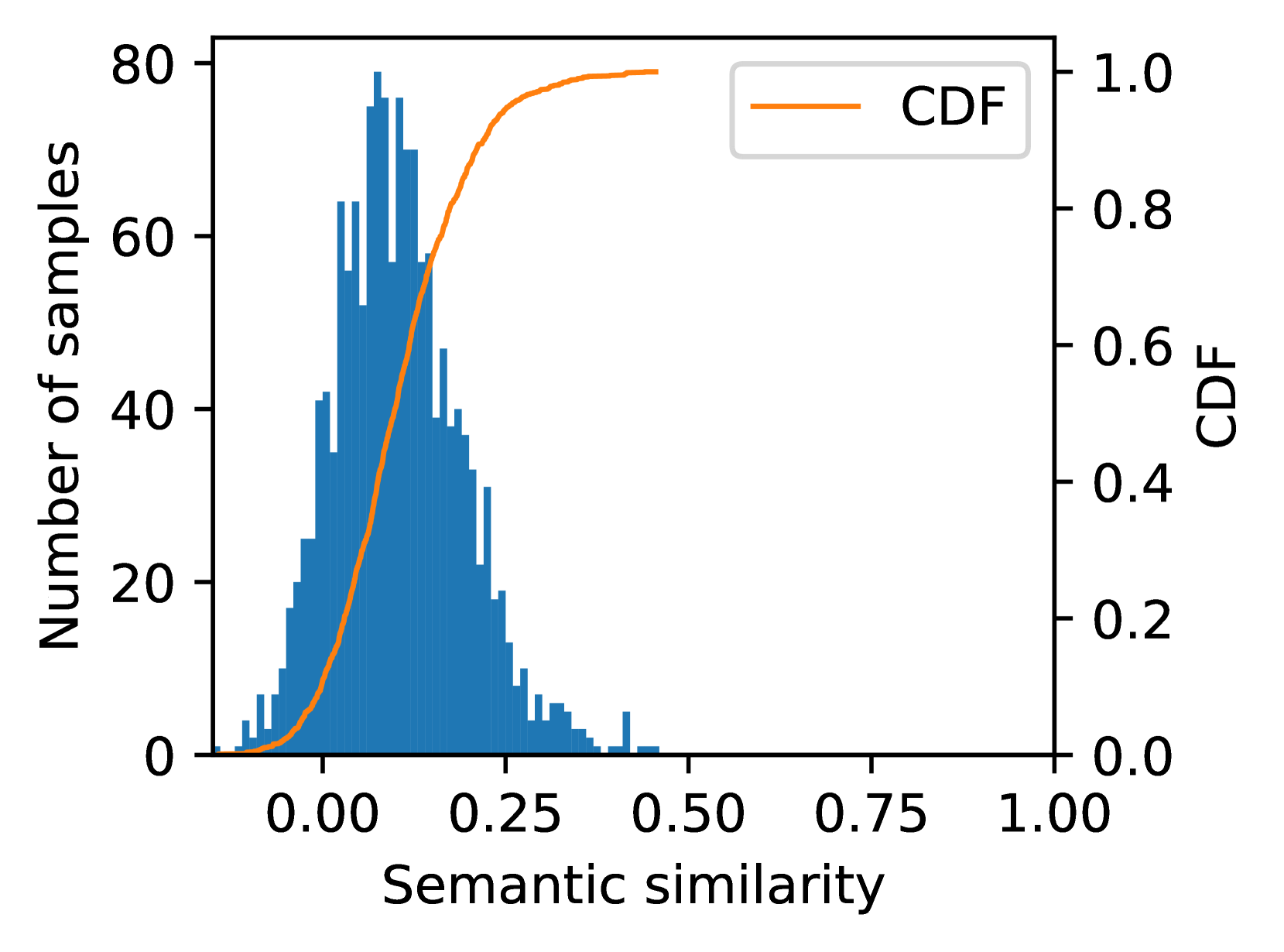

实验结果表明,该中间件架构能够有效预防高达20%的提示造成的资源浪费。此外,研究还重现了DP文本清洗领域一篇重要论文的实验,并发现性能驱动的实现选择可能会显著改变输出,这为DP文本清洗的实际应用提供了重要的参考。

🎯 应用场景

该研究成果可应用于各种需要保护用户隐私的在线LLM服务,例如智能客服、文本摘要、机器翻译等。通过预先评估清洗后文本的效用,可以显著降低计算成本,提高服务效率,并为用户提供更经济实惠的隐私保护方案。未来,该技术还可扩展到其他隐私保护技术和更复杂的LLM应用场景。

📄 摘要(原文)

Interactions with online Large Language Models raise privacy issues where providers can gather sensitive information about users and their companies from the prompts. While textual prompts can be sanitized using Differential Privacy, we show that it is difficult to anticipate the performance of an LLM on such sanitized prompt. Poor performance has clear monetary consequences for LLM services charging on a pay-per-use model as well as great amount of computing resources wasted. To this end, we propose a middleware architecture leveraging a Small Language Model to predict the utility of a given sanitized prompt before it is sent to the LLM. We experimented on a summarization task and a translation task to show that our architecture helps prevent such resource waste for up to 20% of the prompts. During our study, we also reproduced experiments from one of the most cited paper on text sanitization using DP and show that a potential performance-driven implementation choice dramatically changes the output while not being explicitly acknowledged in the paper.