FluidML: Fast and Memory Efficient Inference Optimization

作者: Jinjie Liu, Hang Qiu

分类: cs.LG

发布日期: 2024-11-14

💡 一句话要点

FluidML:一种快速且内存高效的推理优化框架,提升边缘设备模型性能。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 边缘计算 模型推理 运行时优化 内存管理 低延迟 低功耗 机器学习 模型部署

📋 核心要点

- 边缘设备算力受限与模型参数量日益增长的矛盾,导致推理速度慢、内存占用高。

- FluidML通过灵活转换模型执行蓝图,实现运行时内存管理和优化,提升推理效率。

- 实验表明,FluidML在不同平台上可显著降低推理延迟和峰值内存使用量,最高分别达25.38%和41.47%。

📝 摘要(中文)

本文提出了一种名为FluidML的通用运行时内存管理和优化框架,旨在灵活地转换模型执行蓝图,从而实现更快、更节省内存的推理。边缘设备上部署的机器学习模型催生了许多令人兴奋的新应用,但边缘设备上可用的计算资源无法跟上模型参数不断增长的步伐。随着模型变得更大更复杂,新颖而复杂的结构对推理运行时优化提出了挑战。在不同平台上的评估表明,与最先进的方法相比,FluidML可以持续降低流行语言模型的端到端推理延迟高达25.38%,并降低峰值内存使用量高达41.47%。FluidML的代码量约为3万行,专为通用目的而构建,并将作为开源推理运行时优化框架发布给社区。

🔬 方法详解

问题定义:论文旨在解决边缘设备上机器学习模型推理速度慢、内存占用高的问题。现有方法难以有效优化日益复杂的大型模型,无法充分利用有限的计算资源,导致推理延迟增加和内存溢出等问题。

核心思路:FluidML的核心思路是通过灵活地转换模型执行蓝图,实现运行时内存管理和优化。这意味着FluidML不是简单地优化单个算子,而是从整体执行流程的角度出发,动态调整计算顺序和内存分配,以达到最佳的性能和内存效率。

技术框架:FluidML是一个通用的运行时内存管理和优化框架,其整体架构未知,但可以推断其包含以下主要模块:模型解析器(用于理解模型结构)、执行蓝图生成器(用于生成不同的执行方案)、内存管理器(用于动态分配和释放内存)、以及运行时调度器(用于执行优化后的模型)。

关键创新:FluidML的关键创新在于其能够灵活地转换模型执行蓝图。传统的推理优化方法通常采用固定的执行流程,难以适应不同模型的特点。FluidML则可以根据模型的结构和硬件平台的特性,动态地生成不同的执行方案,并选择最优的方案执行。

关键设计:论文中没有详细描述关键设计细节,例如具体的内存分配策略、执行蓝图的生成算法、以及运行时调度的策略。这些细节是FluidML实现高性能和高内存效率的关键,但需要在开源代码发布后才能进一步分析。

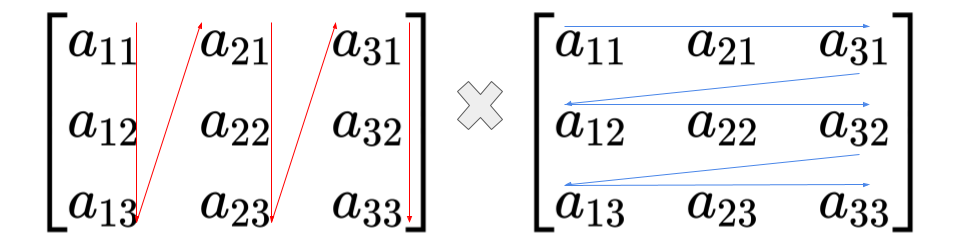

🖼️ 关键图片

📊 实验亮点

实验结果表明,FluidML在不同平台上均能有效降低推理延迟和峰值内存使用量。对于流行的语言模型,FluidML可以将端到端推理延迟降低高达25.38%,并将峰值内存使用量降低高达41.47%。这些显著的性能提升证明了FluidML在边缘设备推理优化方面的有效性。

🎯 应用场景

FluidML可广泛应用于各种边缘计算场景,例如人形机器人、AR眼镜、自动驾驶汽车等。通过优化模型推理性能,FluidML能够提升这些应用的实时性和用户体验,并降低硬件成本。未来,FluidML有望成为边缘AI领域重要的基础设施,推动更多创新应用的落地。

📄 摘要(原文)

Machine learning models deployed on edge devices have enabled numerous exciting new applications, such as humanoid robots, AR glasses, and autonomous vehicles. However, the computing resources available on these edge devices are not catching up with the ever-growing number of parameters in these models. As the models become bigger and more complicated, the novel yet sophisticated structure challenges the inference runtime optimization. We present FluidML, a generic runtime memory management and optimization framework that can flexibly transform the model execution blueprint to achieve faster and more memory-efficient inference. Evaluations across different platforms show that FluidML can consistently reduce the end-to-end inference latency by up to 25.38% for popular language models and reduce peak memory usage by up to 41.47%, compared to state-of-the-art approaches. FluidML is of ~30K line of codes, built for general-purpose usage, and will be released as an open-source inference runtime optimization framework to the community.