Balancing Multimodal Training Through Game-Theoretic Regularization

作者: Konstantinos Kontras, Thomas Strypsteen, Christos Chatzichristos, Paul Pu Liang, Matthew Blaschko, Maarten De Vos

分类: cs.LG, cs.AI, cs.CV, cs.GT, cs.MM

发布日期: 2024-11-11 (更新: 2025-10-01)

备注: 23 pages, 7 figures, 6 tables, 1 algorithm

🔗 代码/项目: GITHUB

💡 一句话要点

提出多模态竞争正则化器(MCR),解决多模态学习中的模态竞争问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 模态竞争 博弈论 互信息 正则化

📋 核心要点

- 多模态学习中,模态间竞争导致训练资源分配不均,部分模态优化不足,影响整体性能。

- 论文提出基于博弈论的多模态竞争正则化器(MCR),自适应平衡模态贡献,鼓励模态发挥信息作用。

- MCR在合成和真实数据集上均优于现有方法,证明了联合训练模态的性能优势。

📝 摘要(中文)

多模态学习通过捕捉跨数据源的依赖关系,有望实现更丰富的信息提取。然而,由于模态竞争现象,现有训练方法常常表现不佳,模态竞争导致某些模态的优化不足。本文提出了多模态竞争正则化器(MCR),其灵感来源于互信息(MI)分解,旨在防止多模态训练中竞争的负面影响。主要贡献包括:1)一个博弈论框架,通过鼓励每个模态最大化其在最终预测中的信息作用,自适应地平衡模态贡献。2)改进了每个MI项的上下界,以增强跨模态的任务相关独特和共享信息的提取。3)提出了用于条件MI估计的潜在空间排列,显著提高了计算效率。MCR优于所有先前建议的训练策略和简单基线,清楚地表明联合训练模态可以带来重要的性能提升,无论是在合成数据集还是大型真实世界数据集上。代码和模型已开源。

🔬 方法详解

问题定义:多模态学习旨在融合来自不同模态的信息以提升模型性能。然而,在训练过程中,不同模态之间可能存在竞争,导致某些模态被过度优化,而其他模态则被忽略,最终影响整体性能。现有方法难以有效解决这种模态竞争问题,导致多模态模型无法充分利用所有模态的信息。

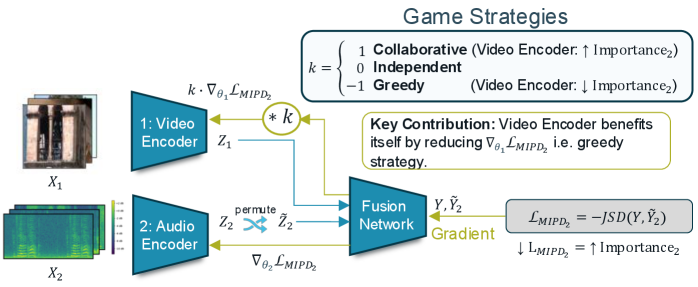

核心思路:论文的核心思路是引入一个基于博弈论的正则化项,称为多模态竞争正则化器(MCR)。MCR鼓励每个模态最大化其对最终预测的贡献,从而平衡不同模态之间的竞争关系。通过优化一个考虑了模态间互信息的博弈论目标函数,MCR能够自适应地调整每个模态的权重,确保所有模态都得到充分的训练。

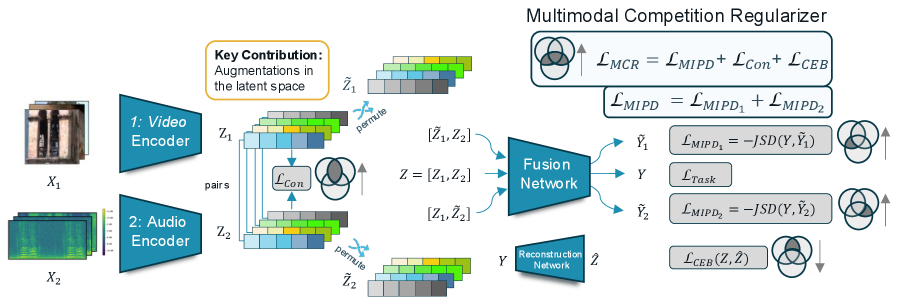

技术框架:MCR的技术框架主要包括以下几个模块:1) 特征提取模块:用于从每个模态中提取特征表示。2) 互信息估计模块:用于估计不同模态之间的互信息,包括共享信息和独特信息。3) 博弈论正则化模块:基于互信息估计结果,构建一个博弈论目标函数,并将其作为正则化项添加到原始损失函数中。4) 优化模块:使用梯度下降等优化算法,同时优化原始损失函数和博弈论正则化项。

关键创新:MCR的关键创新在于:1) 提出了一个基于博弈论的正则化框架,能够自适应地平衡不同模态之间的竞争关系。2) 改进了互信息估计方法,能够更准确地提取模态间的共享信息和独特信息。3) 提出了潜在空间排列方法,显著提高了条件互信息估计的计算效率。

关键设计:MCR的关键设计包括:1) 使用互信息分解来量化模态间的共享信息和独特信息。2) 使用博弈论中的 Shapley 值来衡量每个模态对最终预测的贡献。3) 使用对抗训练来提高互信息估计的准确性。4) 使用潜在空间排列来降低条件互信息估计的计算复杂度。具体而言,损失函数由原始任务损失和MCR正则化项组成,MCR正则化项基于Shapley值,鼓励每个模态最大化其独特贡献,同时促进模态间的有效信息共享。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MCR在多个合成和真实世界数据集上均优于现有方法。例如,在多模态情感识别任务中,MCR相比于基线方法取得了显著的性能提升。具体而言,MCR在CMU-MOSEI数据集上取得了SOTA的结果,相较于之前的最佳模型,性能提升了超过2%。实验结果充分验证了MCR在解决模态竞争问题方面的有效性。

🎯 应用场景

该研究成果可广泛应用于多模态数据分析领域,例如:多模态情感识别、多模态医学诊断、多模态机器人感知等。通过解决模态竞争问题,MCR能够提升多模态模型的性能和鲁棒性,从而改善相关应用的实际效果。未来,该方法有望扩展到更多模态和更复杂的任务中。

📄 摘要(原文)

Multimodal learning holds promise for richer information extraction by capturing dependencies across data sources. Yet, current training methods often underperform due to modality competition, a phenomenon where modalities contend for training resources leaving some underoptimized. This raises a pivotal question: how can we address training imbalances, ensure adequate optimization across all modalities, and achieve consistent performance improvements as we transition from unimodal to multimodal data? This paper proposes the Multimodal Competition Regularizer (MCR), inspired by a mutual information (MI) decomposition designed to prevent the adverse effects of competition in multimodal training. Our key contributions are: 1) A game-theoretic framework that adaptively balances modality contributions by encouraging each to maximize its informative role in the final prediction 2) Refining lower and upper bounds for each MI term to enhance the extraction of both task-relevant unique and shared information across modalities. 3) Proposing latent space permutations for conditional MI estimation, significantly improving computational efficiency. MCR outperforms all previously suggested training strategies and simple baseline, clearly demonstrating that training modalities jointly leads to important performance gains on both synthetic and large real-world datasets. We release our code and models at https://github.com/kkontras/MCR.