Hardware and Software Platform Inference

作者: Cheng Zhang, Hanna Foerster, Robert D. Mullins, Yiren Zhao, Ilia Shumailov

分类: cs.LG

发布日期: 2024-11-07 (更新: 2025-07-02)

🔗 代码/项目: GITHUB

💡 一句话要点

提出硬件和软件平台推断方法,用于识别黑盒机器学习模型的底层GPU架构和软件栈。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 硬件推断 软件平台推断 黑盒模型 GPU识别 模型安全

📋 核心要点

- 大型语言模型推理服务存在硬件和服务真实性验证难题,用户难以确认是否按约定使用高性能硬件。

- 论文提出硬件和软件平台推断(HSPI)方法,通过分析模型输入输出行为来识别底层GPU架构和软件栈。

- 实验表明,在白盒设置下,HSPI能以83.9%-100%的准确率区分不同GPU,黑盒设置下也显著优于随机猜测。

📝 摘要(中文)

由于高昂的硬件基础设施和能源成本,购买大型语言模型(LLM)推理服务而非自托管已成为常见的商业实践。然而,作为买方,缺乏验证所宣传服务的真实性的机制,例如,无法验证服务是否真的使用NVIDIA H100提供。此外,有报告表明,模型提供商可能会提供与宣传略有不同的模型,通常是为了使其在成本较低的硬件上运行。这样,客户为在更昂贵的硬件上访问高性能模型支付了高价,但最终却由(可能性能较差的)更便宜的模型在更便宜的硬件上提供服务。在本文中,我们介绍了一种硬件和软件平台推断(HSPI)方法,该方法仅基于黑盒机器学习模型的输入-输出行为来识别底层GPU架构和软件栈。我们的方法利用各种GPU架构和编译器固有的差异来区分不同的GPU类型和软件栈。通过分析模型输出中的数值模式,我们提出了一个分类框架,能够准确识别用于模型推理的GPU以及底层软件配置。我们的研究结果表明,从黑盒模型推断GPU类型是可行的。我们针对在不同真实硬件上提供的模型评估了HSPI,发现在白盒设置中,我们可以区分不同的GPU,准确率在83.9%到100%之间。即使在黑盒设置中,我们也能获得比随机猜测高3倍的结果。我们的代码可在https://github.com/ChengZhang-98/HSPI 获得。

🔬 方法详解

问题定义:论文旨在解决大型语言模型推理服务中,用户无法验证服务提供商是否按照约定使用指定硬件(如NVIDIA H100)进行推理的问题。现有方法无法从黑盒模型的输入输出行为推断出其底层硬件和软件平台,这使得服务提供商可能使用更廉价的硬件和服务,从而损害用户的利益。

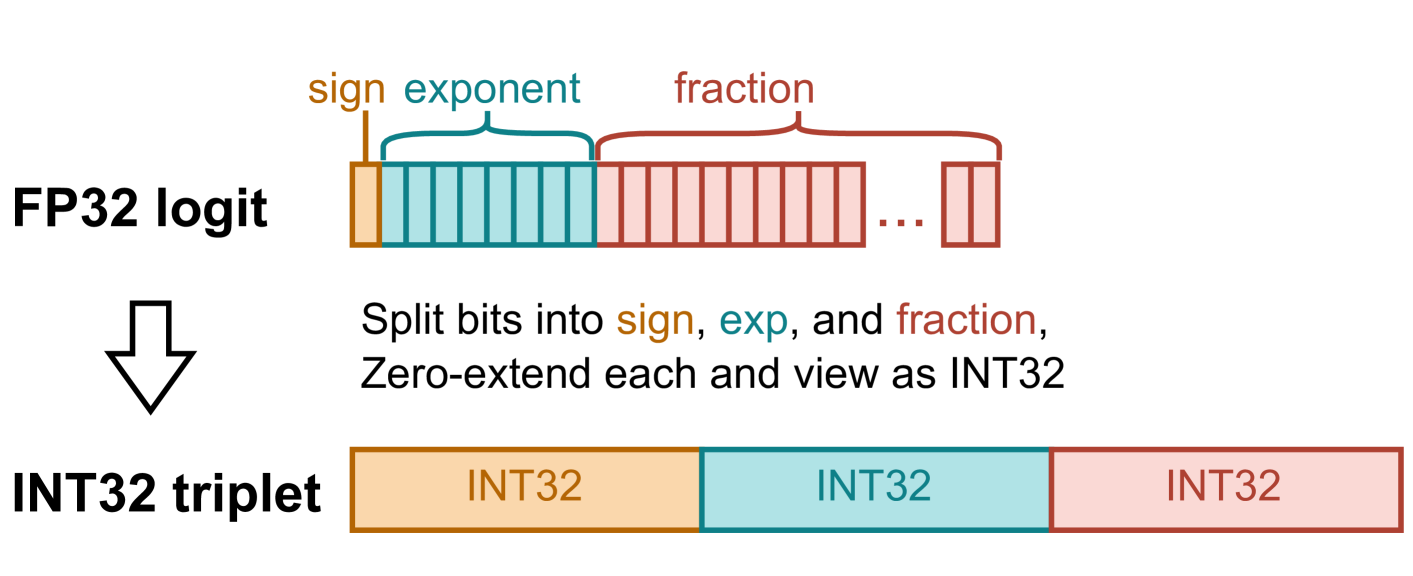

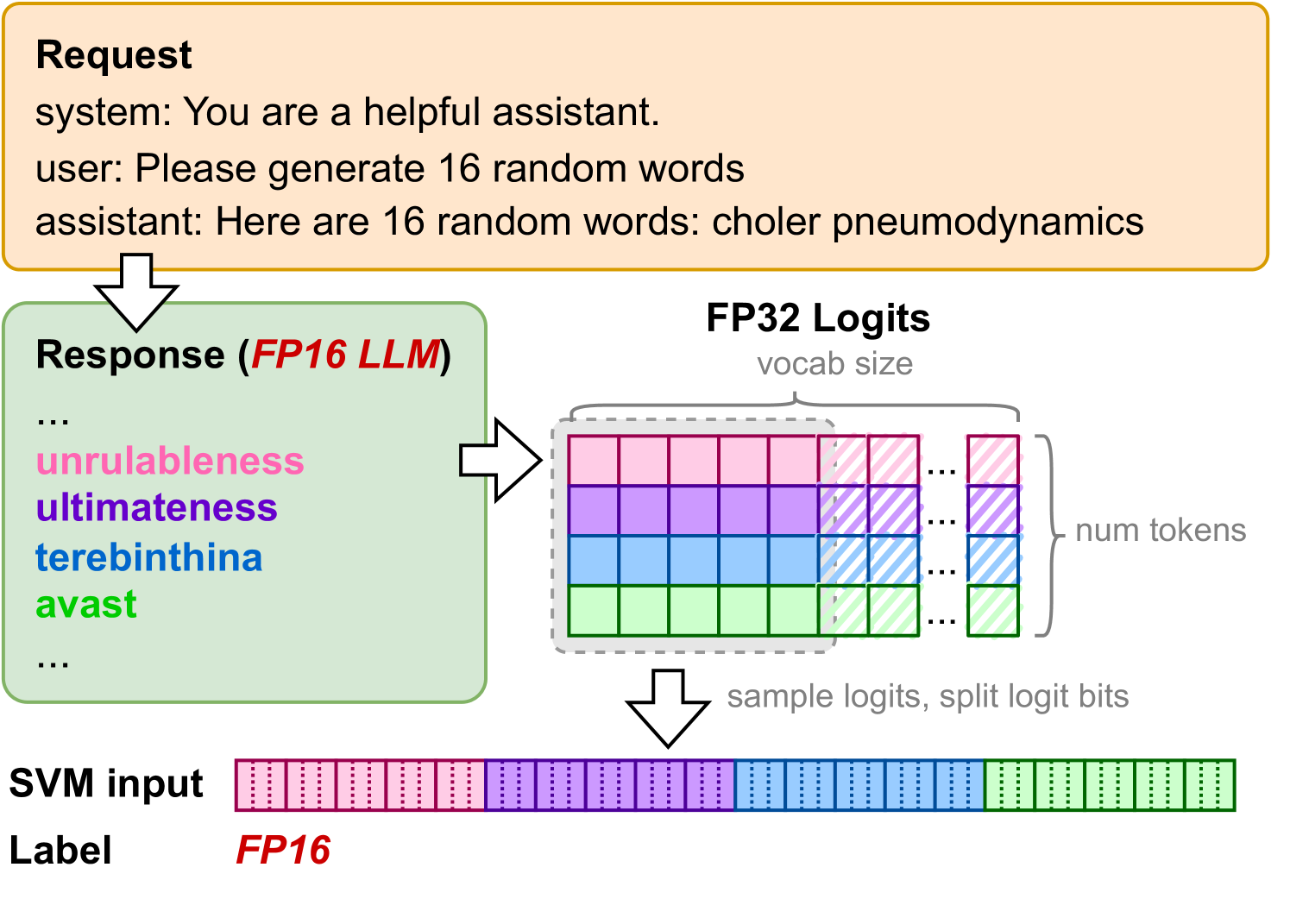

核心思路:论文的核心思路是利用不同GPU架构和编译器在数值计算上的细微差异。即使是相同的模型,在不同的GPU上运行,由于硬件架构和编译器的差异,其输出结果也会存在细微的数值模式。通过分析这些数值模式,可以推断出底层使用的GPU类型和软件栈。

技术框架:HSPI方法主要包含以下几个阶段:1) 数据收集:针对目标黑盒模型,构造一系列输入,并记录相应的输出。2) 特征提取:从模型的输出中提取数值特征,这些特征能够反映底层硬件和软件平台的特性。3) 模型训练:使用提取的特征训练分类模型,用于区分不同的GPU类型和软件栈。4) 推断:对于未知的黑盒模型,使用训练好的分类模型推断其底层硬件和软件平台。

关键创新:该方法最重要的创新点在于,它能够仅通过黑盒模型的输入输出行为来推断其底层硬件和软件平台。这与传统的硬件识别方法不同,传统方法通常需要访问底层硬件或软件,而HSPI方法不需要任何底层访问权限。

关键设计:论文的关键设计包括:1) 精心设计的输入数据,能够充分激发不同GPU架构和编译器之间的差异。2) 有效的特征提取方法,能够从模型的输出中提取出关键的数值模式。3) 选择合适的分类模型,能够准确地区分不同的GPU类型和软件栈。具体的参数设置、损失函数和网络结构等技术细节在论文中进行了详细描述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在白盒设置下,HSPI方法能够以83.9%到100%的准确率区分不同的GPU。即使在黑盒设置下,HSPI方法也能获得比随机猜测高3倍的准确率。这些结果表明,HSPI方法是一种有效的硬件和软件平台推断方法,具有很高的实用价值。

🎯 应用场景

该研究成果可应用于云服务安全、模型知识产权保护和硬件审计等领域。用户可以使用该方法验证云服务提供商是否按照约定使用高性能硬件,从而确保服务质量。模型开发者可以使用该方法检测模型是否被部署在未经授权的硬件上,从而保护知识产权。硬件厂商可以使用该方法进行硬件审计,从而发现潜在的安全漏洞。

📄 摘要(原文)

It is now a common business practice to buy access to large language model (LLM) inference rather than self-host, because of significant upfront hardware infrastructure and energy costs. However, as a buyer, there is no mechanism to verify the authenticity of the advertised service including the serving hardware platform, e.g. that it is actually being served using an NVIDIA H100. Furthermore, there are reports suggesting that model providers may deliver models that differ slightly from the advertised ones, often to make them run on less expensive hardware. That way, a client pays premium for a capable model access on more expensive hardware, yet ends up being served by a (potentially less capable) cheaper model on cheaper hardware. In this paper we introduce hardware and software platform inference (HSPI) -- a method for identifying the underlying GPU architecture and software stack of a (black-box) machine learning model solely based on its input-output behavior. Our method leverages the inherent differences of various GPU architectures and compilers to distinguish between different GPU types and software stacks. By analyzing the numerical patterns in the model's outputs, we propose a classification framework capable of accurately identifying the GPU used for model inference as well as the underlying software configuration. Our findings demonstrate the feasibility of inferring GPU type from black-box models. We evaluate HSPI against models served on different real hardware and find that in a white-box setting we can distinguish between different GPUs with between $83.9\%$ and $100\%$ accuracy. Even in a black-box setting we achieve results that are up to 3x higher than random guess accuracy. Our code is available at https://github.com/ChengZhang-98/HSPI.