Variational Low-Rank Adaptation Using IVON

作者: Bai Cong, Nico Daheim, Yuesong Shen, Daniel Cremers, Rio Yokota, Mohammad Emtiyaz Khan, Thomas Möllenhoff

分类: cs.LG, cs.AI, cs.CL, stat.ML

发布日期: 2024-11-07 (更新: 2024-11-09)

备注: Published at 38th Workshop on Fine-Tuning in Machine Learning (NeurIPS 2024). Code available at https://github.com/team-approx-bayes/ivon-lora. In version 2 we fixed a typo in the equation of prior in section 2

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于IVON的变分低秩自适应方法,提升LoRA精度与校准度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低秩自适应 LoRA 变分学习 IVON算法 大型语言模型 模型微调 贝叶斯优化

📋 核心要点

- 现有LoRA微调方法依赖AdamW等优化器,精度和校准度有待提升,尤其是在大型语言模型上。

- 论文提出使用IVON算法替代AdamW,利用变分学习的优势,提升LoRA的精度和校准度,同时控制计算成本。

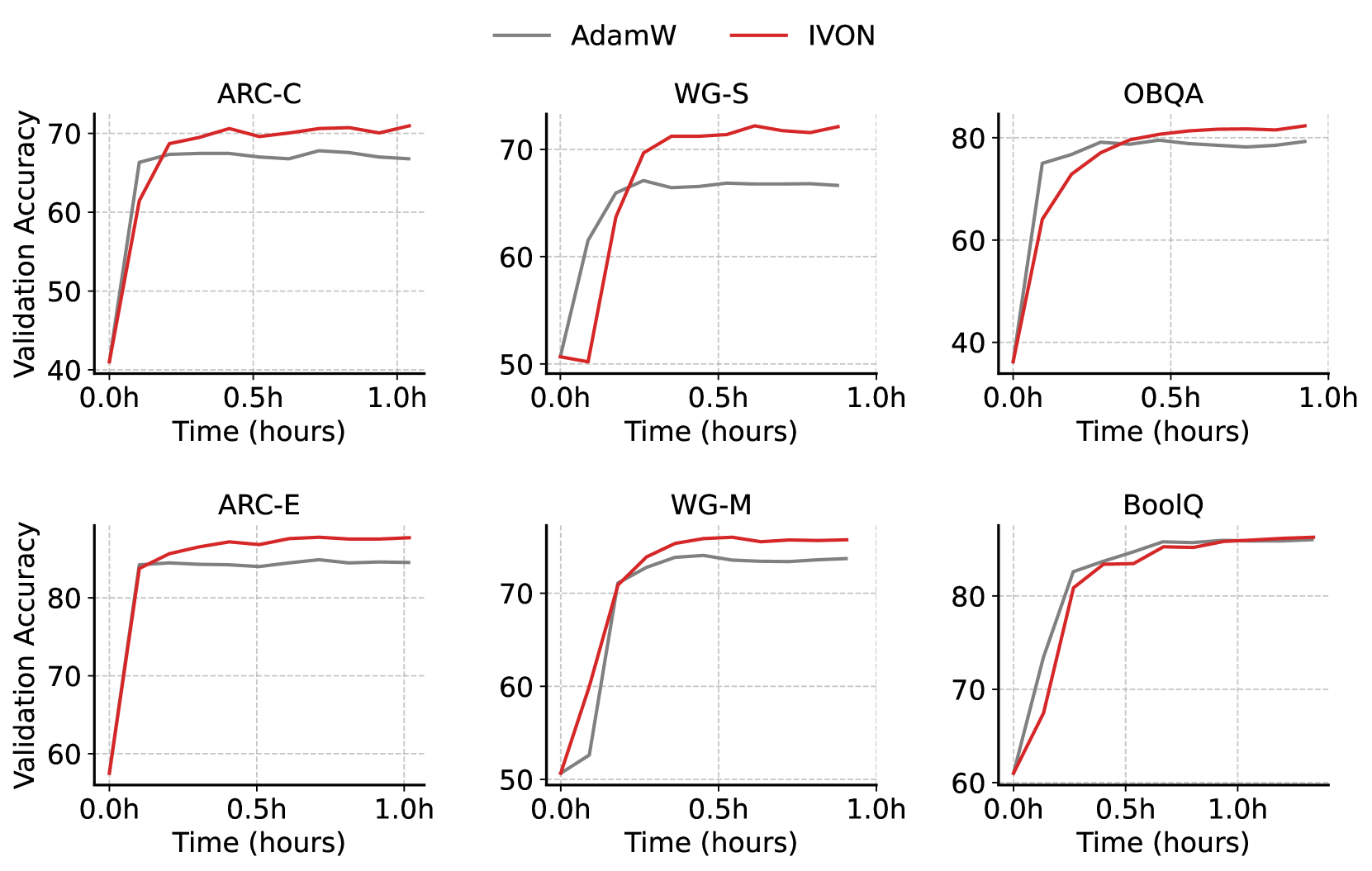

- 实验表明,在Llama-2 (7B)上,IVON相比AdamW精度提升2.8%,预期校准误差降低4.6%,且优于其他贝叶斯方法。

📝 摘要(中文)

本文提出使用变分学习显著提升低秩自适应(LoRA)的精度和校准度,且没有显著增加计算成本。具体而言,我们使用改进的变分在线牛顿(IVON)算法替代AdamW来微调大型语言模型。对于具有70亿参数的Llama-2模型,IVON相比AdamW将精度提高了2.8%,预期校准误差降低了4.6%。此外,IVON的精度优于其他贝叶斯方法,但成本更低,实现也更简单。这项工作为IVON在大型语言模型上的有效性提供了进一步的证据。代码已在https://github.com/team-approx-bayes/ivon-lora上发布。

🔬 方法详解

问题定义:论文旨在提升大型语言模型LoRA微调的精度和校准度。现有方法主要使用AdamW等优化器,这些方法在处理大型模型时可能存在泛化能力不足和校准不准确的问题,尤其是在数据有限的情况下。因此,如何提高LoRA微调的性能,同时保持较低的计算成本,是一个重要的研究问题。

核心思路:论文的核心思路是利用变分学习的优势,通过IVON算法对LoRA进行微调。IVON是一种贝叶斯优化算法,它能够更好地估计模型参数的不确定性,从而提高模型的泛化能力和校准度。通过将AdamW替换为IVON,可以在不显著增加计算成本的前提下,提升LoRA的性能。

技术框架:整体框架是标准的LoRA微调流程,主要区别在于优化器的选择。首先,对预训练的大型语言模型进行LoRA参数化,即引入低秩矩阵来更新模型参数。然后,使用IVON算法对这些低秩矩阵进行微调。在训练过程中,IVON算法会估计模型参数的后验分布,并利用该分布来更新参数。最后,将微调后的LoRA参数应用到原始模型中,得到微调后的模型。

关键创新:最重要的技术创新点在于使用IVON算法替代传统的AdamW优化器。IVON是一种变分在线牛顿算法,它能够更好地估计模型参数的不确定性,从而提高模型的泛化能力和校准度。与传统的优化器相比,IVON能够更有效地利用数据,并避免过拟合。此外,IVON的实现相对简单,易于集成到现有的LoRA微调流程中。

关键设计:IVON算法的关键设计在于其变分推断过程。它通过最小化KL散度来近似模型参数的后验分布。在每次迭代中,IVON会计算梯度和Hessian矩阵的近似值,并利用这些信息来更新模型参数。此外,IVON还采用了一种在线学习策略,即每次只使用一小部分数据来更新模型参数,从而降低计算成本。论文中没有特别提及损失函数或网络结构的修改,主要集中在优化器的替换上。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在Llama-2 (7B)模型上,使用IVON算法微调LoRA相比使用AdamW,精度提高了2.8%,预期校准误差降低了4.6%。此外,IVON的精度也优于其他贝叶斯方法,如SWAG,且计算成本更低。这些结果表明,IVON是一种有效的LoRA微调优化器,能够显著提升大型语言模型的性能。

🎯 应用场景

该研究成果可广泛应用于各种需要微调大型语言模型的场景,例如自然语言处理、文本生成、机器翻译等。通过提高LoRA的精度和校准度,可以提升下游任务的性能,并增强模型的可信度。此外,该方法还可以应用于其他低秩自适应方法,具有广泛的应用前景。

📄 摘要(原文)

We show that variational learning can significantly improve the accuracy and calibration of Low-Rank Adaptation (LoRA) without a substantial increase in the cost. We replace AdamW by the Improved Variational Online Newton (IVON) algorithm to finetune large language models. For Llama-2 with 7 billion parameters, IVON improves the accuracy over AdamW by 2.8% and expected calibration error by 4.6%. The accuracy is also better than the other Bayesian alternatives, yet the cost is lower and the implementation is easier. Our work provides additional evidence for the effectiveness of IVON for large language models. The code is available at https://github.com/team-approx-bayes/ivon-lora.