A scalable generative model for dynamical system reconstruction from neuroimaging data

作者: Eric Volkmann, Alena Brändle, Daniel Durstewitz, Georgia Koppe

分类: cs.LG, math.DS, nlin.CD, physics.data-an

发布日期: 2024-11-05

备注: 38th Conference on Neural Information Processing Systems (NeurIPS 2024)

💡 一句话要点

提出一种可扩展生成模型,用于从神经影像数据中重建动态系统。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 动态系统重建 神经影像数据 状态空间模型 Teacher Forcing BOLD信号

📋 核心要点

- 现有动态系统重建方法难以直接应用于神经影像数据,因为神经影像信号具有滤波特性,导致观测依赖于历史状态。

- 该论文提出一种新算法,利用控制理论训练状态空间模型,克服了信号滤波导致的解码器不可逆问题。

- 实验表明,该算法能够从短时BOLD信号中有效重建动态系统,并具有良好的可扩展性。

📝 摘要(中文)

本文提出了一种新的算法,用于从观测时间序列中推断生成动态系统。该方法特别针对神经科学领域,旨在克服传统方法需要手工设计模型以及难以自动推断个体间大脑动力学差异的问题。该算法利用控制理论的思想,特别是现代的Teacher Forcing变体,以确保在训练过程中稳定的损失梯度传播。与现有方法不同,该算法能够处理当前观测依赖于先前状态历史的数据,例如fMRI中的BOLD信号或Ca$^{2+}$成像数据。这些信号使得状态空间模型(SSM)的解码器模型不可逆,而这是先前基于Teacher Forcing方法的要求。实验证明,该算法能够从短BOLD时间序列中重建动态系统,包括其状态空间几何和长期时间特性,并且具有良好的模型维度和滤波器长度的可扩展性。

🔬 方法详解

问题定义:论文旨在解决从神经影像数据(如fMRI的BOLD信号)中重建动态系统的问题。现有的基于Teacher Forcing的状态空间模型训练方法,要求解码器模型可逆,而神经影像信号的滤波特性导致解码器不可逆,使得这些方法无法直接应用。此外,手工设计模型和推断个体间大脑动力学差异也存在挑战。

核心思路:论文的核心思路是利用控制理论的思想,改进状态空间模型的训练方式,使其能够处理解码器不可逆的情况。通过引入新的算法,克服了信号滤波带来的影响,从而能够从神经影像数据中准确地重建动态系统。

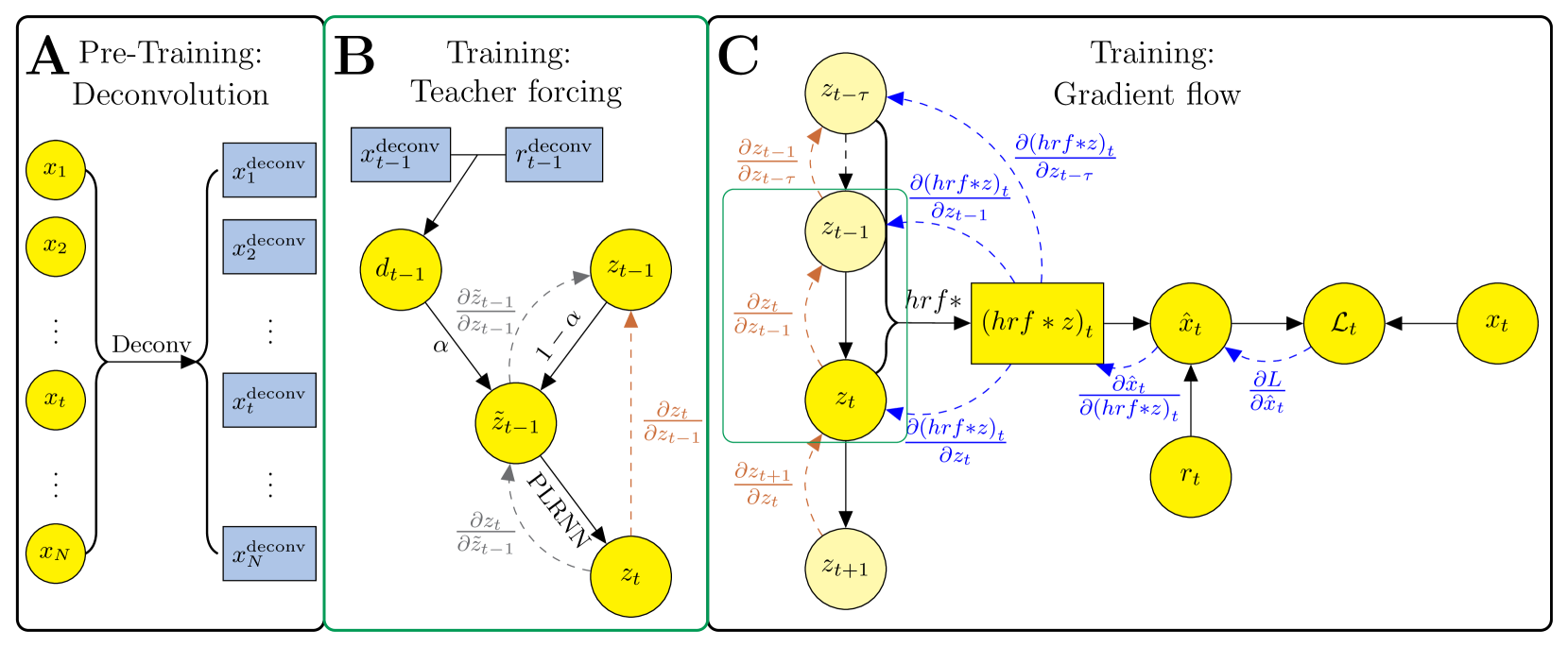

技术框架:该方法基于状态空间模型(SSM),整体框架包含编码器和解码器。编码器将观测到的时间序列映射到潜在状态空间,解码器则从潜在状态重建观测值。关键在于训练过程,采用了改进的Teacher Forcing方法,以确保梯度传播的稳定性,即使在解码器不可逆的情况下也能有效训练。

关键创新:最重要的创新点在于克服了神经影像信号滤波特性导致的解码器不可逆问题。传统的Teacher Forcing方法依赖于解码器的可逆性,而该论文提出的算法通过控制理论的手段,解决了这一限制,使得状态空间模型能够应用于更广泛的神经影像数据。

关键设计:具体的算法细节未知,但可以推测可能涉及对损失函数的修改,或者对Teacher Forcing训练过程的调整,以适应解码器不可逆的情况。此外,模型维度和滤波器长度的可扩展性也是一个重要的设计考虑因素,可能涉及到对网络结构的优化。

🖼️ 关键图片

📊 实验亮点

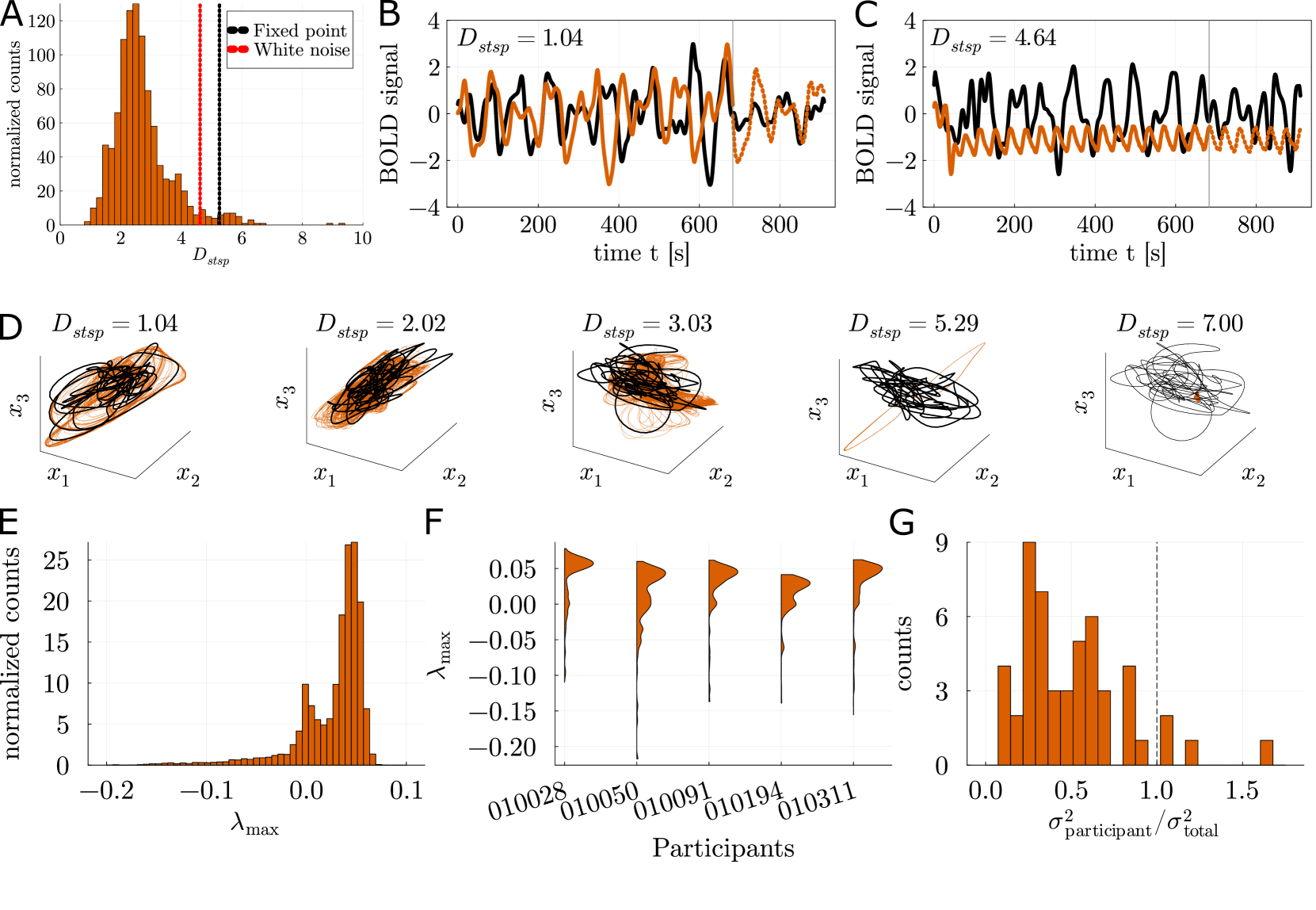

论文展示了该算法能够从短时BOLD时间序列中重建动态系统,包括其状态空间几何和长期时间特性。虽然具体的性能数据和对比基线未知,但强调了该算法在模型维度和滤波器长度上的可扩展性,表明其能够处理复杂的大脑动态系统。

🎯 应用场景

该研究成果可应用于神经科学领域,用于自动推断个体间大脑动力学差异,无需手工设计模型。潜在的应用包括:疾病诊断、认知功能研究、以及开发更有效的神经调控策略。通过重建大脑动态系统,可以更深入地理解大脑的工作机制,并为个性化治疗提供依据。

📄 摘要(原文)

Data-driven inference of the generative dynamics underlying a set of observed time series is of growing interest in machine learning and the natural sciences. In neuroscience, such methods promise to alleviate the need to handcraft models based on biophysical principles and allow to automatize the inference of inter-individual differences in brain dynamics. Recent breakthroughs in training techniques for state space models (SSMs) specifically geared toward dynamical systems (DS) reconstruction (DSR) enable to recover the underlying system including its geometrical (attractor) and long-term statistical invariants from even short time series. These techniques are based on control-theoretic ideas, like modern variants of teacher forcing (TF), to ensure stable loss gradient propagation while training. However, as it currently stands, these techniques are not directly applicable to data modalities where current observations depend on an entire history of previous states due to a signal's filtering properties, as common in neuroscience (and physiology more generally). Prominent examples are the blood oxygenation level dependent (BOLD) signal in functional magnetic resonance imaging (fMRI) or Ca$^{2+}$ imaging data. Such types of signals render the SSM's decoder model non-invertible, a requirement for previous TF-based methods. Here, exploiting the recent success of control techniques for training SSMs, we propose a novel algorithm that solves this problem and scales exceptionally well with model dimensionality and filter length. We demonstrate its efficiency in reconstructing dynamical systems, including their state space geometry and long-term temporal properties, from just short BOLD time series.