GraphXAIN: Narratives to Explain Graph Neural Networks

作者: Mateusz Cedro, David Martens

分类: cs.LG, cs.AI

发布日期: 2024-11-04 (更新: 2025-02-12)

备注: 19 pages, 9 figures, 2 tables

期刊: World Conference on Explainable Artificial Intelligence 2025

💡 一句话要点

GraphXAIN:利用自然语言叙事解释图神经网络的预测结果

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图神经网络解释 可解释AI 自然语言生成 大型语言模型 图数据 模型可解释性 GNN XAI

📋 核心要点

- 现有GNN解释方法输出的技术性结果难以被非专业人士理解,阻碍了GNN的广泛应用。

- GraphXAIN利用大型语言模型将解释性子图和特征重要性得分转化为自然语言叙事,提升可理解性。

- 实验表明,GraphXAIN在可理解性、满意度、说服力等方面均有提升,并被广泛认为是GNN解释的有益补充。

📝 摘要(中文)

图神经网络(GNNs)是图结构数据上强大的机器学习技术,但在可解释性方面面临挑战。现有的GNN解释方法通常产生技术性输出,如子图和特征重要性得分,非数据科学家难以理解,从而违背了解释的目的。受可解释AI(XAI)研究的启发,我们提出了GraphXAIN,一种生成自然语言叙事来解释GNN预测的方法。GraphXAIN是一种模型和解释器无关的方法,它使用大型语言模型(LLMs)将解释性子图和特征重要性得分转换为连贯的、故事般的GNN决策过程解释。在真实世界数据集上的评估表明,GraphXAIN能够改进图解释。对机器学习研究人员和从业者的调查显示,GraphXAIN增强了四个可解释性维度:可理解性、满意度、说服力和模型预测沟通的适用性。当与另一种图解释方法结合使用时,GraphXAIN进一步提高了可信度、洞察力、信心和可用性。值得注意的是,95%的参与者认为GraphXAIN是GNN解释方法的一个有价值的补充。通过结合自然语言叙事,我们的方法通过提供更清晰、更有效的解释,服务于图从业者和非专业用户。

🔬 方法详解

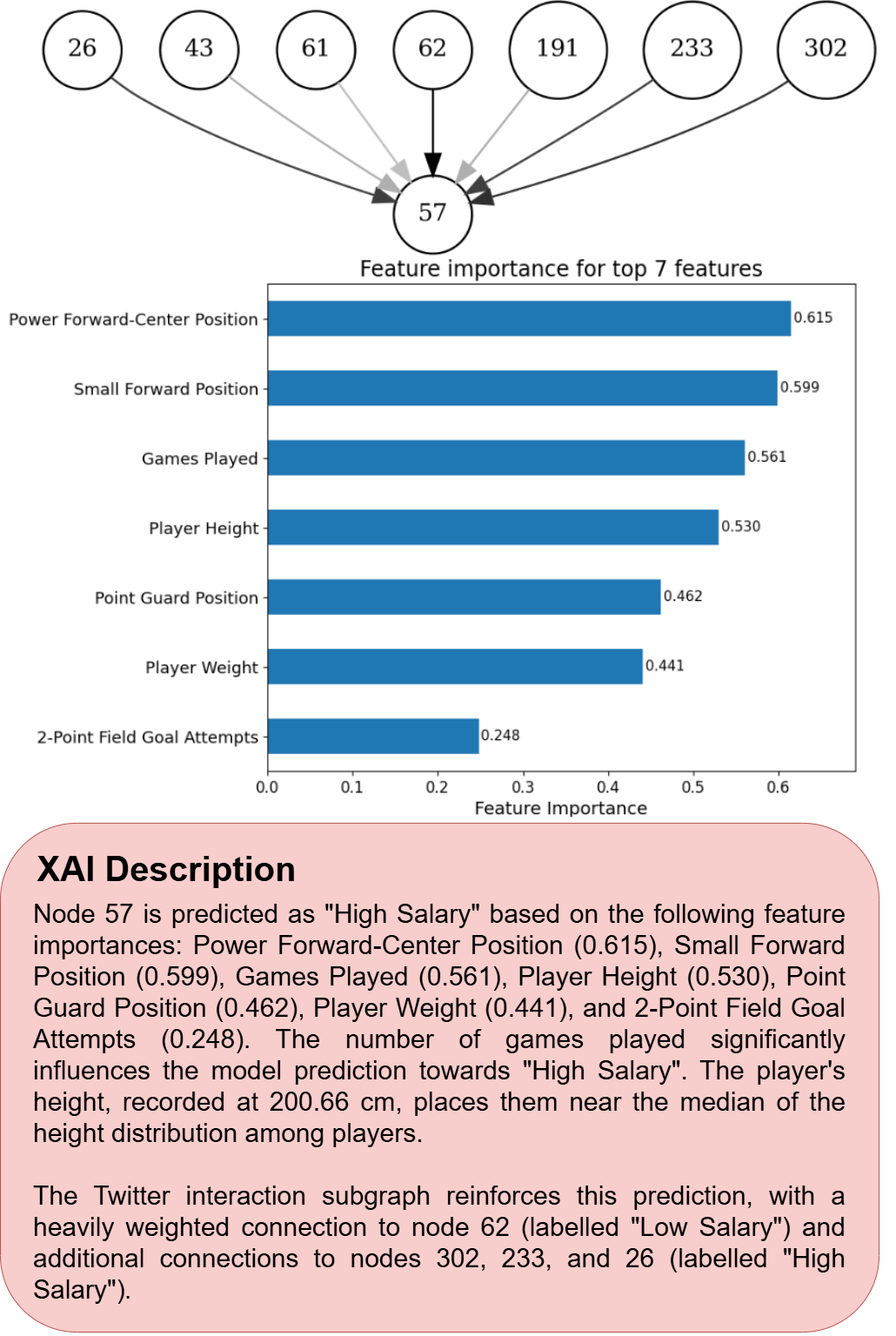

问题定义:现有GNN解释方法,例如子图突出显示或特征重要性排序,通常输出的是技术性的结果,对于非数据科学家来说难以理解。这限制了GNN在需要透明度和可解释性的场景中的应用,例如医疗诊断或金融风险评估。因此,如何将GNN的决策过程以一种易于理解的方式呈现给非专业人士是一个关键问题。

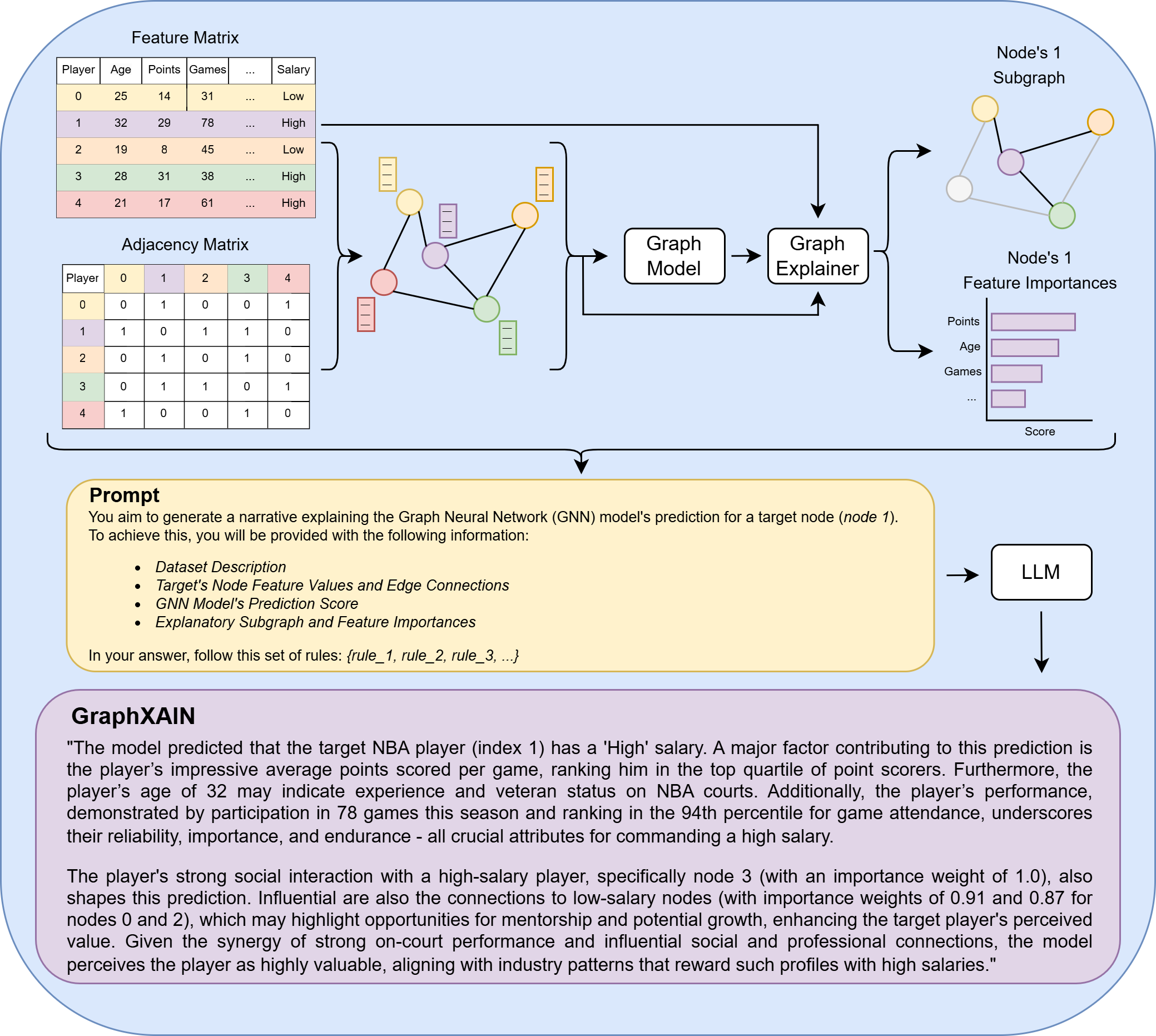

核心思路:GraphXAIN的核心思路是利用大型语言模型(LLMs)的强大自然语言生成能力,将GNN的解释性输出(例如,重要的子图结构和特征)转化为连贯的、故事般的叙述。这种叙述能够以一种更直观和易于理解的方式解释GNN的决策过程,从而提高GNN的可解释性和可用性。

技术框架:GraphXAIN的整体框架包含以下几个主要阶段:1. GNN预测:首先,使用GNN对图数据进行预测。2. 解释性子图提取/特征重要性计算:使用现有的GNN解释方法(例如,GNNExplainer, PGExplainer)提取解释性子图或计算特征重要性得分。3. 自然语言叙事生成:将提取的解释性子图和特征重要性得分作为输入,使用大型语言模型(例如,GPT-3, BART)生成自然语言叙事。4. 解释评估:通过用户调查或自动评估指标评估生成的解释的质量。

关键创新:GraphXAIN的关键创新在于它将大型语言模型引入到GNN解释领域,并提出了一种模型和解释器无关的方法,可以将任何GNN和任何GNN解释器的输出转化为自然语言叙事。这使得GNN的解释更加易于理解和使用,从而提高了GNN的可解释性和可用性。与现有方法相比,GraphXAIN不再局限于技术性的输出,而是提供了一种更人性化的解释方式。

关键设计:GraphXAIN的关键设计包括:1. 提示工程:设计合适的提示(prompts)来指导大型语言模型生成高质量的自然语言叙事。提示需要包含关于GNN模型、输入图数据和解释性子图/特征重要性得分的信息。2. 后处理:对大型语言模型生成的叙事进行后处理,例如,去除冗余信息、纠正语法错误等,以提高叙事的质量。3. 评估指标:使用合适的评估指标来评估生成的解释的质量,例如,可理解性、满意度、说服力等。

🖼️ 关键图片

📊 实验亮点

用户调查显示,GraphXAIN在可理解性、满意度、说服力和模型预测沟通的适用性方面均有显著提升。95%的参与者认为GraphXAIN是GNN解释方法的一个有价值的补充。当与另一种图解释方法结合使用时,GraphXAIN进一步提高了可信度、洞察力、信心和可用性。这些结果表明,GraphXAIN能够有效地提高GNN的可解释性和可用性。

🎯 应用场景

GraphXAIN可应用于需要高度可解释性的图神经网络应用场景,例如:金融风控、医疗诊断、社交网络分析等。通过提供易于理解的自然语言解释,GraphXAIN可以帮助领域专家更好地理解GNN的决策过程,从而提高模型的信任度和应用范围。未来,该方法可以进一步扩展到其他类型的机器学习模型,并与其他XAI技术相结合,以提供更全面和有效的解释。

📄 摘要(原文)

Graph Neural Networks (GNNs) are a powerful technique for machine learning on graph-structured data, yet they pose challenges in interpretability. Existing GNN explanation methods usually yield technical outputs, such as subgraphs and feature importance scores, that are difficult for non-data scientists to understand and thereby violate the purpose of explanations. Motivated by recent Explainable AI (XAI) research, we propose GraphXAIN, a method that generates natural language narratives explaining GNN predictions. GraphXAIN is a model- and explainer-agnostic method that uses Large Language Models (LLMs) to translate explanatory subgraphs and feature importance scores into coherent, story-like explanations of GNN decision-making processes. Evaluations on real-world datasets demonstrate GraphXAIN's ability to improve graph explanations. A survey of machine learning researchers and practitioners reveals that GraphXAIN enhances four explainability dimensions: understandability, satisfaction, convincingness, and suitability for communicating model predictions. When combined with another graph explainer method, GraphXAIN further improves trustworthiness, insightfulness, confidence, and usability. Notably, 95% of participants found GraphXAIN to be a valuable addition to the GNN explanation method. By incorporating natural language narratives, our approach serves both graph practitioners and non-expert users by providing clearer and more effective explanations.