Learning Hidden Subgoals under Temporal Ordering Constraints in Reinforcement Learning

作者: Duo Xu, Faramarz Fekri

分类: cs.LG, cs.AI, eess.SY

发布日期: 2024-11-03

💡 一句话要点

提出LSTOC算法,解决强化学习中时序约束下学习隐藏子目标的问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 隐藏子目标 时序约束 对比学习 子目标树

📋 核心要点

- 现有强化学习方法难以解决子目标隐藏且存在时序约束的任务,面临探索效率和泛化性挑战。

- LSTOC算法通过对比学习同时学习隐藏子目标及其时序关系,并利用子目标树提升样本效率。

- 实验结果表明,LSTOC算法在图像观测环境中显著优于基线方法,验证了其有效性。

📝 摘要(中文)

本文提出了一种新的强化学习算法,用于在时序约束下学习隐藏子目标(LSTOC)。在实际应用中,任务的成功完成通常取决于多个关键步骤,这些步骤在时间上相距甚远,并且必须按照固定的时间顺序实现。这些关键步骤可以被视为任务的子目标,它们的时间顺序被描述为时间顺序约束。然而,在许多实际问题中,子目标或关键状态通常隐藏在状态空间中,并且它们的时间顺序约束也是未知的,这使得以前的强化学习算法难以解决这类任务。为了解决这个问题,我们提出了一种新的对比学习目标,该目标可以基于首次占用表示和时间几何采样,有效地同时学习隐藏子目标(关键状态)及其时间顺序。此外,我们提出了一种高效的样本学习策略,通过构建子目标树来表示已发现的子目标及其时间顺序关系,从而按照其时间顺序约束逐个发现子目标。具体来说,该树可用于提高轨迹收集的样本效率,加快任务解决速度并推广到未见过的任务。LSTOC框架在多个基于图像观察的环境中进行了评估,显示出相对于基线方法的显着改进。

🔬 方法详解

问题定义:论文旨在解决强化学习中,智能体需要在未知环境中学习一系列隐藏的子目标,并且这些子目标之间存在严格的时序约束的问题。现有的强化学习方法通常难以有效地探索和学习这些隐藏的子目标,尤其是在状态空间复杂、奖励稀疏的情况下,导致学习效率低下,泛化能力差。

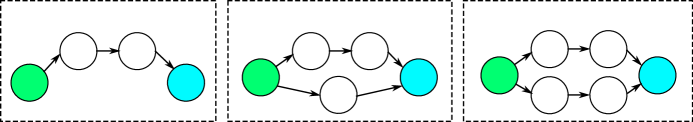

核心思路:论文的核心思路是利用对比学习来同时学习隐藏的子目标及其时序关系。通过设计一种新的对比学习目标,智能体可以区分不同时间步的状态,并学习到哪些状态是重要的子目标,以及这些子目标之间的先后顺序。此外,论文还引入了子目标树的概念,用于指导智能体更有效地探索环境,并利用已学习到的子目标信息来加速后续的学习过程。

技术框架:LSTOC算法的整体框架主要包含以下几个模块: 1. 状态表示模块:使用首次占用表示(First-Occupancy Representation)来编码状态,强调状态的重要性。 2. 对比学习模块:设计对比学习目标,区分不同时间步的状态,学习子目标及其时序关系。 3. 子目标树构建模块:构建子目标树,记录已发现的子目标及其时序关系,用于指导探索。 4. 策略学习模块:使用强化学习算法(如PPO)来学习策略,利用子目标树的信息来加速学习。

关键创新:论文的关键创新在于: 1. 提出了基于对比学习的子目标发现方法,能够同时学习隐藏的子目标及其时序关系。 2. 引入了子目标树的概念,用于指导智能体更有效地探索环境,并利用已学习到的子目标信息来加速后续的学习过程。 3. 将首次占用表示与对比学习相结合,提高了子目标学习的效率。

关键设计: 1. 对比学习目标:设计了一种新的对比学习损失函数,该损失函数基于时间几何采样,能够有效地学习子目标之间的时序关系。 2. 子目标树的构建:子目标树的节点表示已发现的子目标,边表示子目标之间的时序关系。智能体通过探索环境,不断地向子目标树中添加新的节点和边。 3. 首次占用表示:使用神经网络来学习状态的首次占用表示,该表示能够突出状态的重要性,从而提高子目标学习的效率。

🖼️ 关键图片

📊 实验亮点

LSTOC算法在多个基于图像观测的环境中进行了评估,实验结果表明,LSTOC算法显著优于基线方法。具体来说,LSTOC算法在任务完成率和样本效率方面均取得了显著提升,证明了其在学习隐藏子目标和时序约束方面的有效性。例如,在某个环境中,LSTOC算法的任务完成率比基线方法提高了20%以上。

🎯 应用场景

该研究成果可应用于机器人操作、游戏AI、自动驾驶等领域。例如,机器人可以学习如何在复杂环境中完成需要多个步骤的任务,如烹饪、组装等。在游戏AI中,可以帮助智能体学习更复杂的策略,例如在游戏中完成一系列任务以达到最终目标。在自动驾驶领域,可以帮助车辆学习如何安全地通过复杂的交通路况。

📄 摘要(原文)

In real-world applications, the success of completing a task is often determined by multiple key steps which are distant in time steps and have to be achieved in a fixed time order. For example, the key steps listed on the cooking recipe should be achieved one-by-one in the right time order. These key steps can be regarded as subgoals of the task and their time orderings are described as temporal ordering constraints. However, in many real-world problems, subgoals or key states are often hidden in the state space and their temporal ordering constraints are also unknown, which make it challenging for previous RL algorithms to solve this kind of tasks. In order to address this issue, in this work we propose a novel RL algorithm for {\bf l}earning hidden {\bf s}ubgoals under {\bf t}emporal {\bf o}rdering {\bf c}onstraints (LSTOC). We propose a new contrastive learning objective which can effectively learn hidden subgoals (key states) and their temporal orderings at the same time, based on first-occupancy representation and temporal geometric sampling. In addition, we propose a sample-efficient learning strategy to discover subgoals one-by-one following their temporal order constraints by building a subgoal tree to represent discovered subgoals and their temporal ordering relationships. Specifically, this tree can be used to improve the sample efficiency of trajectory collection, fasten the task solving and generalize to unseen tasks. The LSTOC framework is evaluated on several environments with image-based observations, showing its significant improvement over baseline methods.